Kubernetes 平台实现 Jenkins的 Master-Slave 分布式构建方案(上)

一、传统的Master-Slave方案的缺陷

-

Master节点发生单点故障时,整个流程都不可用了

-

每个 Slave节点的配置环境不一样,来完成不同语言的编译打包等操作,但是这些差异化的配置导致管理起来非常不方便,维护起来也是比较费劲

-

资源分配不均衡,有的 Slave节点要运行的job出现排队等待,而有的Slave节点处于空闲状态

-

资源浪费,每台 Slave节点可能是实体机或者VM,当Slave节点处于空闲状态时,也不会完全释放掉资源

-

解决方案:引入Kubernates来解决

二、持续集成架构解析

1. 架构图

大致工作流程:手动/自动构建 -> Jenkins 调度 K8S API ->动态生成 Jenkins Slave pod -> Slave pod 拉取 Git 代码/编译/打包镜像 ->推送到镜像仓库 Harbor -> Slave 工作完成,Pod 自动销毁 ->部署到测试或生产 Kubernetes平台。(完全自动化,无需人工干预)

2. 持续集成优点

-

服务高可用:

当 Jenkins Master 出现故障时,Kubernetes 会自动创建一个新的 Jenkins Master

容器,并且将 Volume 分配给新创建的容器,保证数据不丢失,从而达到集群服务高可用。 -

动态伸缩,合理使用资源:

每次运行 Job 时,会自动创建一个 Jenkins Slave,Job 完成后,Slave 自动注销并删除容器,资源自动释放,而且 Kubernetes 会根据每个资源的使用情况,动态分配Slave 到空闲的节点上创建,降低出现因某节点资源利用率高,还排队等待在该节点的情况。 -

扩展性好:

当 Kubernetes 集群的资源严重不足而导致 Job 排队等待时,可以很容易的添加一个 Kubernetes Node 到集群中,从而实现扩展。

三、K8S 集群部署

1. 环境配置

| 主机名称 | IP地址 | 安装的软件 |

|---|---|---|

| 代码托管服务器 | 192.168.8.18 | Gitlab-12.4.2 |

| harbor仓库服务器 | 192.168.8.20 | Harbor1.9.2 |

| k8s-master | 192.168.8.12 | kube-apiserver、kube-controller-manager、kube- scheduler、docker、etcd、calico,NFS |

| k8s-node1 | 192.168.8.13 | kubelet、kubeproxy、Docker18.06.1-ce |

| k8s-node2 | 192.168.8.14 | kubelet、kubeproxy、Docker18.06.1-ce |

三台k8s服务器上操作

hostnamectl set-hostname k8s-master && su

hostnamectl set-hostname k8s-node1 && su

hostnamectl set-hostname k8s-node2 && su

cat >> /etc/hosts << EOF

192.168.8.12 k8s-master

192.168.8.13 k8s-node1

192.168.8.14 k8s-node2

EOF

#关闭防火墙,selinux,swap

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

swapoff -a

vim /etc/fstab

#永久关闭需注释掉以下段

/dev/mapper/cl-swap swap swap defaults 0 0

#设置系统参数,加载br_netfilter模块

modprobe br_netfilter

#设置允许路由转发,不对bridge的数据进行处理创建文件

cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

vm.swappiness = 0

EOF

sysctl -p /etc/sysctl.d/k8s.conf

#kube-proxy开启ipvs的前置条件

cat > /etc/sysconfig/modules/ipvs.modules <<EOF

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

EOF

chmod 755 /etc/sysconfig/modules/ipvs.modules && bash

/etc/sysconfig/modules/ipvs.modules && lsmod | grep -e ip_vs -e nf_conntrack_ipv4

2. 安装 docker

三台k8s服务器操作

#安装依赖包

yum install -y yum-utils device-mapper-persistent-data lvm2

#设置阿里云镜像源

cd /etc/yum.repos.d/

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

#安装 docker-ce 社区版

yum install -y docker-ce

systemctl start docker

systemctl enable docker

#配置镜像加速

mkdir -p /etc/docker

tee /etc/docker/daemon.json <<-'EOF'

{

"registry-mirrors": ["https://t466r8qg.mirror.aliyuncs.com"],

"insecure-registries": ["192.168.8.20:85"]

}

EOF

systemctl daemon-reload

systemctl restart docker

#网络优化

vim /etc/sysctl.conf

net.ipv4.ip_forward=1

sysctl -p

systemctl restart network

systemctl restart docker

docker version

3. 安装kubelet、kubeadm、kubectl

kubeadm: 用来初始化集群的指令。

kubelet: 在集群中的每个节点上用来启动 pod 和 container 等。

kubectl: 用来与集群通信的命令行工具。

- 环境配置

三台k8s服务器上配置

#清空yum缓存

yum clean all

#设置yum安装源

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

#安装

yum install -y kubelet-1.17.0 kubeadm-1.17.0 kubectl-1.17.0

#kubelet设置开机启动(注意:先不启动,现在启动的话会报错)

systemctl enable kubelet

#查看版本

kubelet --version

- Master节点上进行配置

#运行初始化命令

kubeadm init --kubernetes-version=1.17.0 \

--apiserver-advertise-address=192.168.8.12 \

--image-repository registry.aliyuncs.com/google_containers \

--service-cidr=10.1.0.0/16 \

--pod-network-cidr=10.244.0.0/16

#这里需要等待,最后会提示节点安装的命令,需要复制下来后面加入集群的时候使用

kubeadm join 192.168.8.12:6443 --token 194r8i.zjurd7efw9oo9vur \

--discovery-token-ca-cert-hash sha256:4c08eace8dd99c89913315b3035557452795db4822cb6973b00a4be7724eb66a

注意:

apiserver-advertise-address这个地址必须是 master 机器的 IP

常见错误如下:

错误① :

[WARNING IsDockerSystemdCheck]: detected "cgroupfs" as the Docker cgroup driver

作为Docker cgroup驱动程序。,Kubernetes推荐的Docker驱动程序是“systemd”

解决方案:

#修改Docker的配置,加入下面的配置,然后重启docker

vim /etc/docker/daemon.json

{

"exec-opts":["native.cgroupdriver=systemd"]

}

错误②:

[ERROR NumCPU]: the number of available CPUs 1 is less than the required 2

解决方案:

修改机器的CPU核数,最少二个

- 启动kubelet

systemctl restart kubelet

- 配置kubectl工具

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

4. 安装Calico

master节点

mkdir /root/k8s

cd /root/k8s

#不检查凭证下载calico.yaml文件

wget --no-check-certificate https://docs.projectcalico.org/v3.10/getting-started/kubernetes/installation/hosted/kubernetes-datastore/calico-networking/1.7/calico.yaml

#地址更改,方便从节点通信

sed -i 's/192.168.0.0/10.244.0.0/g' calico.yaml

kubectl apply -f calico.yaml

- 查看所有Pod的状态,需要确保所有Pod都是Running状态

kubectl get pod --all-namespaces -o wide

5. Slave节点配置

#使用master节点生成的命令,让slave节点加入集群

kubeadm join 192.168.8.12:6443 --token 194r8i.zjurd7efw9oo9vur \

--discovery-token-ca-cert-hash sha256:4c08eace8dd99c89913315b3035557452795db4822cb6973b00a4be7724eb66a

#启动kubelet

systemctl start kubelet

6. 验证部署结果

回到Master节点查看,如果Status全部为Ready,代表集群环境搭建成功

kubectl get nodes

四、部署配置 NFS

NFS(Network FileSystem):

它最大的功能就是可以通过网络,让不同的机器、不同的操作系统可以共享彼此的文件。

我们可以利用NFS共享Jenkins运行的配置文件、Maven的仓库依赖文件等

1. 安装NFS服务

所有K8S的节点都需要安装

yum install -y nfs-utils

2. 创建共享目录

mkdir -p /opt/nfs/jenkins

vim /etc/exports #添加下面的参数

/opt/nfs/jenkins *(rw,no_root_squash)

3. 启动服务

systemctl enable nfs

systemctl start nfs

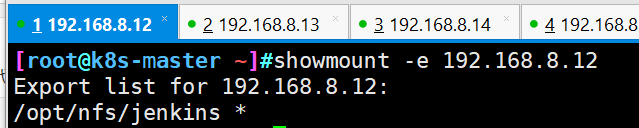

4. 查看NFS共享目录

showmount -e 192.168.8.12