OpenCV-初探

OpenCV初探

文章目录

- OpenCV初探

-

- 配置环境

- pyhton简单操作

-

-

- 利用PIL库实现一些图像处理

-

- C++简单操作

-

- 读取滑动条时老是抛出异常&解决

- 一些变换

-

- 高斯平滑(模糊)

- 使用高斯模糊对图像实现基2的降采样

- Canny边缘检测器

- 结合图像金字塔&Canny边缘检测器

- 从摄像头中读取

- 写入AVL文件

配置环境

pycharm配置非常简单,就在此略过了。

主要是c++的找了好久的方法。

我配置的是VS2017+OpenCV,然后推荐大家看这个,我是通过这篇博客解决了配置的问题。

当时更改了库目录以及包目录和环境变量以及依赖项所有能更改的。但是还是提醒找不到#include这个文件。

后来看了博客推测问题可能出在:VS2017应该设置的环境变量是vc15下的,但是当时看其他博客配置的是vc14的。

但是这个配置完了记得改debug X86为X64。

over!

pyhton简单操作

import cv2 as cv

img = cv.imread('一张图片的绝对路径')

cv.namedWindow("Image")

cv.imshow("Image",img)# 在界面显示

cv.waitKey(0)# 等待时间,ms级,0表示按任意键终止

cv.destroyWindow("Image")# 可以有参数也可以没有

print(img)

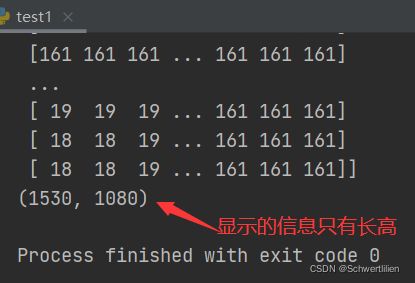

print(img.shape)# (x,x,3)表示是RGB通道,但是在cv里面是BGR类型

# 所以一般实现的时候别用plot库,这个是RGB类型,二者切换会出现事故

img = cv.imread('xxx.jpg',cv.IMREAD_COLOR)# 显示的是彩色图像

img = cv.imread('xxx.jpg',cv.IMREAD_GRAYSCALE)# 显示的是灰度图像

# 其他的一些函数

# 保存

cv2.imwrite("图片保存的名字",img)

# 打印类型

type(img)# 这个是将视频转换为灰度的视频。

但是总感觉转换.mp4文件为灰度播放,失败了。

然后是貌似只把人像变成了蓝色,好怪喔)

vcvc = cv2.VideoCapture(r"C:\Users\林颐\PycharmProjects\pythonProject\练习3\test01.MP4")

if vcvc.isOpened():

oepn, frame = vcvc.read()

else:

open = False

while open:

ret, frame = vcvc.read()

if frame is None:

break

if ret == True:

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB)

cv2.imshow('result', gray)

if cv2.waitKey(100) & 0xFF == 27:

break

vcvc.release()

cv2.destroyAllWindows()

利用PIL库实现一些图像处理

pil_im=Image.open(r'D:\cmttmmderijisc\2020-08-14 191734.jpg')

print(pil_im)

# 将图片转换为灰度图片并显示

pil_im=Image.open(r'D:\cmttmmderijisc\2020-08-14 191734.jpg').convert('L')

pil_im.show()# 删除需要自己手动按叉叉

# 创建缩略图

pil_im.thumbnail((128,128))

pil_im.show()

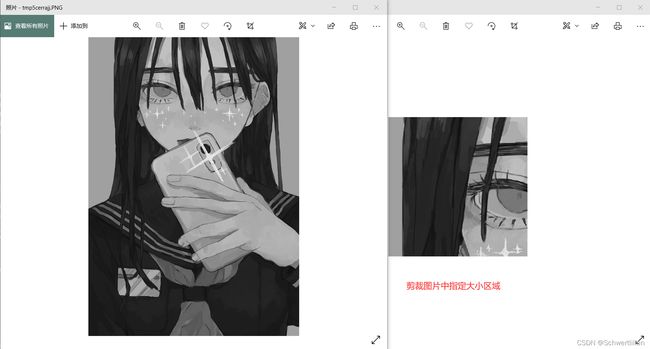

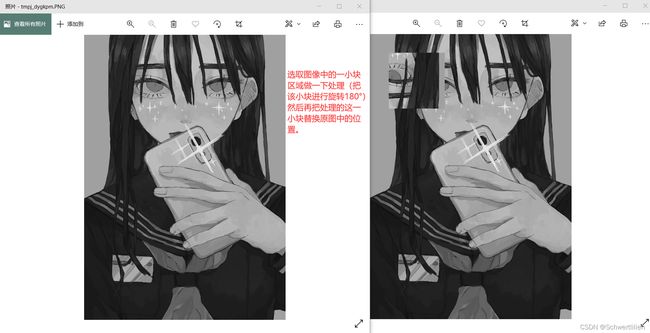

# 复制粘贴图像区域

box=(100,100,400,400)

region=pil_im.crop(box)# crop从一副图像中剪裁指定区域

region=region.transpose(Image.ROTATE_180)

pil_im.paste(region,box)

pil_im.show()

region.show()

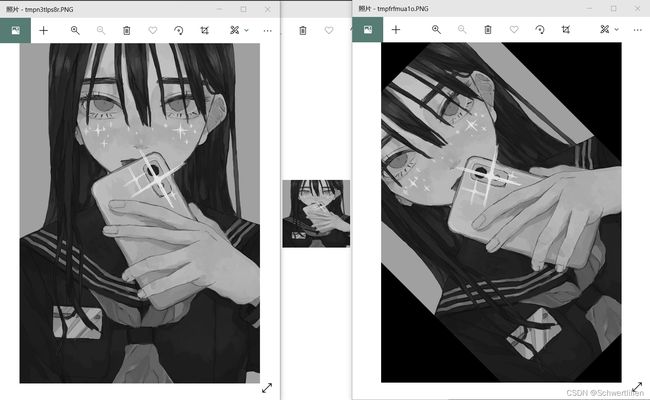

# 调整尺寸和旋转

out=pil_im.resize((128,128))# 使用resize调整尺寸

out.show()

out=pil_im.rotate(45)# rotate逆时针旋转45°

out.show()

# 画图

from pylab import *

from PIL import Image

im = array(Image.open(r'D:\cmttmmderijisc\2020-08-14 191734.jpg'))

imshow(im)

x=[100,100,400,400]

y=[200,500,200,500]

plot(x,y,'r*')

plot(x[:2],y[:2])

axis('off')# 移除坐标轴

title("ploting")# 为显示的图像命名

show()

但是我设置好了vs+opencv,就不想写python了)。

C++简单操作

果然、虽然它麻烦,可我还是更愿意写这个。

以下是简单的打开图片以及视频。

# include以上打开视频,在显示视频的时候不可以快速跳转。于是:

- 加一个滑动条,使得用户可以进行视频跳转。

- 允许用户按下S键-暂停(单步),R键-恢复。

- 无论何时用户滑动条跳转到视频的一个新的时间点,都使用但不模式在该点播放。

读取滑动条时老是抛出异常&解决

先放一下代码,就是照书写的。

#include然后找到是因为g_run的那一条语句写错,导致不能使用 s & r 来暂停以及恢复。

如果是非正常退出,比如点了叉叉退出,就会抛出异常,比如这样。

但是如果是正常的滑动条读完或者按Esc键退出是不会出现的)

一些变换

高斯平滑(模糊)

高斯模糊是?关于高斯模糊的详细解释

高斯模糊,也叫高斯平滑,英文为:Gaussian Blur,是图像处理中常用的一种技术,主要用来降低图像的噪声和减少图像的细节。高斯模糊在许多图像处理软件中也得到了广泛的应用。

话说在画画中我会经常用到呢)

#include "opencv2/highgui/highgui.hpp"

#include "opencv2/imgproc/imgproc.hpp"

#include "iostream"

#include "fstream"

using namespace std;

using namespace cv;

//加载图像并显示之前平滑处理的图像

void smooth(const Mat &image) {

namedWindow("in", WINDOW_AUTOSIZE);

namedWindow("out", WINDOW_AUTOSIZE);

imshow("in", image);

Mat Out;

GaussianBlur(image, Out, Size(5, 5), 3, 3);

GaussianBlur(Out, Out, Size(5, 5), 3, 3);

imshow("out", Out);

waitKey(0);

destroyAllWindows();

}

int main(){

Mat img = imread("E:\\CV\\pict_lib\\1.jpg");

smooth(img);

}

高斯平滑只适合特定的照片,有时会破坏一些图片的特性。

使用高斯模糊对图像实现基2的降采样

降采样?对上采样、降采样、图像金字塔的解释

(个人理解一下这句话,就是模糊+缩小)

在OpenCV中高斯模糊+降采样通过cv::pyrDown()函数实现。

cv::pyrDown():创建一个新的图像,其宽高均为原始图像的一半。

int main() {

Mat img1, img2;

namedWindow("demo1", WINDOW_AUTOSIZE);

namedWindow("demo2", WINDOW_AUTOSIZE);

img1 = imread("E:\\CV\\pict_lib\\1.jpg");

imshow("demo1", img1);

pyrDown(img1, img2);

imshow("demo2", img2);

waitKey(0);

destroyAllWindows();

return 0;

}

(或许你不太能看出来有高斯模糊,但是我个人是感觉这项图片变小,但是是好的方面变小)

于是我又放了张图,这个就比较明显,确实是高斯模糊+降采样了。

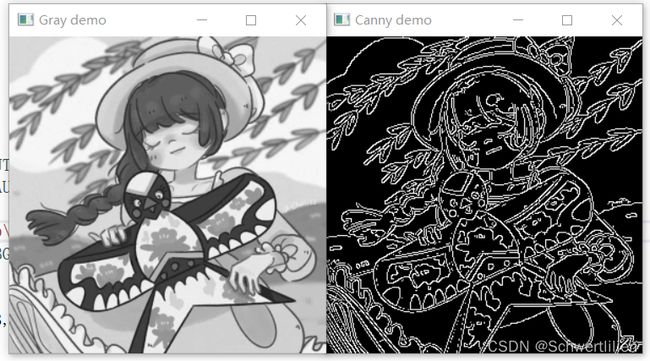

Canny边缘检测器

边缘检测?有关于边缘检测的详细解释

Canny边缘检测器:cv:Canny()

cv::cvtColor():边缘检测器通过该函数生成一个和原图一样大小,但是只有一个通道的图像。从而将RGB图像转换为灰度图。

或者是在imread的时候输入IMREAD_GRAYSCALE,直接读取灰度图。

这个操作在OpenCV中被定义为宏:cv:COLOR2GRAY。(在python中使用过,但是貌似感觉失败了)

int main() {

Mat img_rgb, img_gry, img_cny;

namedWindow("Gray demo", WINDOW_AUTOSIZE);

namedWindow("Canny demo", WINDOW_AUTOSIZE);

img_rgb = imread("E:\\CV\\pict_lib\\2.jpg");

cvtColor(img_rgb, img_gry, COLOR_BGR2GRAY);

imshow("Gray demo", img_gry);

Canny(img_gry, img_cny, 10, 100, 3, true);

imshow("Canny demo", img_cny);

waitKey(0);

destroyAllWindows();

return 0;

}

Mat img_gry;

namedWindow("Gray demo2", WINDOW_AUTOSIZE);

img_gry = imread("E:\\CV\\pict_lib\\2.jpg",IMREAD_GRAYSCALE);

也可以直接这样得到灰度图,然后再进行边缘检测。

可以看到结果基本上是一样的。

虽然目前Canny算子是理论上最完善的,但是我们也可以看见该图上丢失了一些细节。

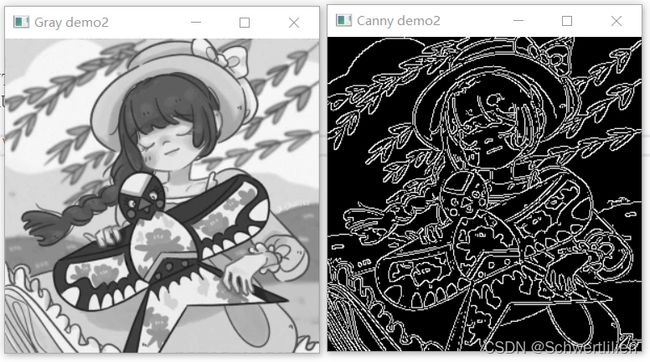

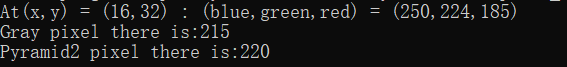

结合图像金字塔&Canny边缘检测器

简单应用:收缩两次图像,然后寻找两次收缩过程中的图像的边缘。

int main() {

Mat img_gry, img_cny,img_pyr,img_pyr2;

namedWindow("Gray demo3", WINDOW_AUTOSIZE);

namedWindow("Canny demo3", WINDOW_AUTOSIZE);

img_gry = imread("E:\\CV\\pict_lib\\2.jpg",IMREAD_GRAYSCALE);

imshow("Gray demo3", img_gry);

pyrDown(img_gry, img_pyr);

pyrDown(img_pyr, img_pyr2);

Canny(img_pyr2, img_cny, 10, 100, 3, true);

imshow("Canny demo3", img_cny);

waitKey(0);

destroyAllWindows();

return 0;

}

读写其像素值

int main() {

Mat img_rgb,img_gry, img_cny,img_pyr,img_pyr2;

img_rgb = imread("E:\\CV\\pict_lib\\2.jpg");

cvtColor(img_rgb, img_gry, COLOR_BGR2GRAY);

pyrDown(img_gry, img_pyr);

pyrDown(img_pyr, img_pyr2);

Canny(img_pyr2, img_cny, 10, 100, 3, true);

int x = 16, y = 32;

Vec3b intensity = img_rgb.at<Vec3b>(y, x);//或者是(x,y)[0]

uchar blue = intensity[0];

uchar green = intensity[1];

uchar red = intensity[2];

std::cout << "At(x,y) = (" << x << "," << y << ") : (blue,green,red) = (" << (unsigned int)blue << "," << (unsigned int)green << "," << (unsigned int)red << ")" << std::endl;

std::cout << "Gray pixel there is:" << (unsigned int)img_gry.at<uchar>(y, x) << std::endl;//读取(32,16)处的像素值

x /= 4;

y /= 4;

std::cout << "Pyramid2 pixel there is:" << (unsigned int)img_pyr2.at<uchar>(y, x) << std::endl;

img_cny.at<uchar>(x, y) = 128;//为什么要把这里的像素值设置为128?我不李姐

return 0;

}

从摄像头中读取

为实现和某种摄像头中读取的实时数据流进行交互,OpenCV中的HighGUI模块提供了一个简单的方法。

对于cv::VideoCapture:

从硬盘读取文件:需要指示读取文件名的路径

从摄像头读取视频:需要有一个相机的ID(一般PC只有一个摄像头连接,这个ID通常=0)

若ID=-1,此时表示:任意选择一个。

int main() {

namedWindow("demo", WINDOW_AUTOSIZE);

VideoCapture cap;

Mat frame;

cap.open(0);

if (!cap.isOpened()) {

std::cerr << "Couldn't open capture." << endl;

return -1;

}

while (true){

cap >> frame; //捕获图像

if (frame.empty())return 0;

imshow("demo", frame); //显示图像

if (waitKey(30)>=0) break;//按下任意键退出

}

cap.release(); //释放相机捕获对象

destroyAllWindows(); //关闭所有窗口

return 0;

}

(我敲,写错字了,请忽略)

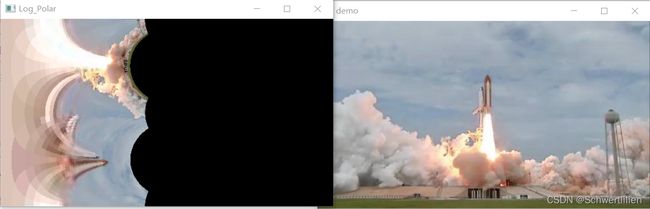

写入AVL文件

cv::VideoWriter我们可以创建一个写入对象以便将帧依次输入到一个视频文件中。

cv::VideoWriter.release():在将每一帧图像输入到cv::VideoWriter对象中后调用。

int main(){

namedWindow("demo", WINDOW_AUTOSIZE);

namedWindow("Log_Polar", WINDOW_AUTOSIZE);

//获取视频

VideoCapture cap("C:\\Users\\林颐\\Desktop\\shuttle.avi");

//获取帧率

double fps = cap.get(CAP_PROP_FPS);

//获取宽高

Size size(

(int)cap.get(CAP_PROP_FRAME_WIDTH),

(int)cap.get(CAP_PROP_FRAME_HEIGHT)

);

VideoWriter writer;

//参数一:输出文件名;参数二:编码方式;参数三:帧率;参数四:单帧图像分辨率

writer.open("C:\\Users\\林颐\\Desktop\\out.avi", VideoWriter::fourcc('M', 'J', 'P', 'G'), fps, size);

//用于运动的jpeg图像编码的字符为MJPG,所以指定VideoWriter::fourcc('M', 'J', 'P', 'G')

Mat logpolar_frame, bgr_frame;

while(true){

cap >> bgr_frame;

if (bgr_frame.empty())break;

imshow("demo", bgr_frame);

//将视频转化为对极数视频

logPolar(

bgr_frame,

logpolar_frame,

Point2f(bgr_frame.cols / 2,bgr_frame.rows / 2),

40,

WARP_FILL_OUTLIERS

);

imshow("Log_Polar", logpolar_frame);

writer << logpolar_frame;//写入新的视频文件

if (waitKey(10) == 27)break;

}

cap.release();

return 0;

}

不然就会xiu的一下出现屏幕,然后又xiu的一下不见,还不会报错orz。