SANAPHOR: Ontology-Based Coreference Resolution笔记

这篇文章是iswc(International Semantic Web Conference)2015年的论文。属于Entity Resolution and Linking类别

要记笔记,就写在这里啦。方便以后查看(2016/4/13)

读了TRank,以及BLANC里面的metric。(2016/4/14)

修改及整理了一些内容(2016/4/16更新)

-----------------------------------------------------------我是分割线-----------------------------------------------------------------------------------------------

Coreference Resolution&Anaphora Resolution

共指消解与指代消解

共指就是两个mention指向的同一个entity;e.g:iphone 和苹果手机(虽然貌似需要语言一样==)

指代就是后面的mention需要前面的mention来解析,存在一定的关系;e.g:(小明迟到了,这真是奇怪。”这“需要”小明“来解析,但是属于不同的entity,一个指的是一件事,一个指的是一个人)

两者的结合就是,后面的mention需要前面的mention来解析,并且两个mention指的是同一个entity。e.g:(还是前面的例子,小明迟到了,他不经常迟到的。”他“需要前面的”小明“来解析,而且两个都是指小明这个人)。

Named Entity Recognition(NER)命名实体识别

最大熵模型与条件随机域模型

ontology&entity&mention(这三个名词真是==)

本体&实体&提及

本体就是一个比较虚的东西,来自哲学概念,主要指的描述概念及概念之间关系的概念模型,通过概念之间的关系来描述概念的语义。

实体就是mention指向的东西,具有实际的意义。

提及就是在文中提到的短语什么的。

总的来说就是一个文本中会有很多mention;这些mention可能指向同一个实体,或者不同的实体;然后这些实体可能都属于一个本体类别下(比如都属于语言学等等)。

参考资料:

本体一词是指对客观世界存在的事物的系统描述,在信息科学的领域中,1991年Neches等人最早给出的定义是:给出构成相关领域词汇的基本术语和关系,以及利用这些术语和关系构成,规定这些词汇外延规则。1993年Gruber将其定义表述为“概念模型的明确的规范说明”。1997年Borst进一步完善了该本体的定义,表述为“共享概念模型的形式化规范说明”,增加了“共享”和“形式化”两个限定语。1998年Studer等人在对Gruber和Borst的定义进行了深入研究后,将本体进一步表述为“共享概念模型的明确的形式化规范说明”并从此形成了目前信息学界对本体概念比较一致的看法。

根据斯坦福大学医学院发本体的构建七步法,构建本体有如下七个步骤:

(1) 确定本体的专业领域与范畴

(2) 考察复用现有本体的可能性

(3) 列出本体中的重要术语

(4) 定义类和类的等级关系

(5) 定义类的属性

(6) 定义属性的分面

(7) 创建实例

以上所述的七步法仅适用于某一专业或学科领域本体的构建。本体的体系结构主要包括3个要素:核心元素集、元素间的交互作用以及这些元素到规范语义间的映射关系。对于本体的一般构造过程,可以用以下公式进行表示:

本体 = 概念(Concept)+ 属性(Property) + 公理(Axiom)+ 取值(Value)+ 名义(Nominal)

从以上的一般公式中,我们还可以归纳出本体当中的基本关系类型,共有四类:

(1) part-of关系,表达概念之间部分和整体的关系

(2) kind-of关系,表达概念之间的集成关系

(3) instance-of关系,表达概念的实例和概念之间的关系

(4) attribute-of关系,表达某个概念是另一个概念的属性

DBpedia&Wikipedia&YAGO

DBpedia:

关联数据是一种推荐的最佳实践,用来在与以往中使用URI和RDF发布、分享、连接各类数据、信息和知识,发布和部署实例数据和类数据,从而通过HTTP协议解释并获取这些数据同时强调数据的相互关联、相互联系以及有益于人际理解的语境信息。在目前的具体实践中,数据往往以RDF文件的形式发布到互联网络上,存储在关联数据知识库中。而大多数需要使用这些关联数据的网站可以直接从在线关联数据知识库的数据接口获取RDF文件并提取其中的相关信息反馈给用户,从而实现信息和数据的跨网站共享。从上面不难看出,在线关联数据知识库在当前的关联数据语义网构想中占据着核心位置。

DBpedia就是这样一个在线关联数据知识库项目。它从维基百科的词条中抽取结构化数据,以提供更准确和直接的维基百科搜索,并在其他数据集和维基百科之间创建连接,并进一步将这些数据以关联数据的形式发布到互联网上,提供给需要这些关联数据的在线网络应用、社交网站或者其他在线关联数据知识库。同时,与一些同时期的关联数据知识库项目不同,DBpedia提供的关联数据知识内容并不受限于某一较小的专业或学科领域,到2012年为止,DBpedia知识库项目已有超过3640000个条目,这些条目涉及人名、地名、音乐专辑、电影、组织、种族等等多个类目。在大数量和宽范围的前提下,DBpedia知识库的条目组织就成为决定其运行效率的关键因素。DBpedia知识库以构建本体的形式对条目进行组织,起到了一定的效果。

在DBpedia知识库一例中,由于所需要构建本体的是维基百科条目,因此其专业领域与范畴无法简单确定,因此在DBpedia的本体构建中,采用了类似于以叙词表为基础的自动化本体转换的方式。但同样的,维基百科的词条表并非规范的叙词表,其类目划分也无法简单归于某一专业分类之下,词语的专指度不可避免的出现不足,因此,在DBpedia的本体构建中,类目划分和定义基本是人工完成,之后的条目转换才使用了自动转换的方式。

Semantic Annotation(语义标注)

实现语义网目标的一个重要前提是利用本体词汇标注 Web 资源。本体在 Tim Berners-Lee提出的语义网的七层体系结构中位于第四层,其目的是为捕获相关领域的知识,提供对该领域知识的共同理解,确定该领域内共同认可的词汇,并给出这些词汇(术语)和词汇间相互关系的明确定义,通过概念之间的关系来描述概念的语义[16]。基于本体的语义标注利用由专家定义好的本体支持内容创建者在 Web 页面中添加语义元数据,使其内容能被人和机器所理解,与大众标注相比较这是一种自顶向下的分类法,属于受控词汇的标注方法。利用语

义标注工具可以对现有的大量 Web 信息进行标注,使得当前的 Web 页面内容成为机器可识别的数据,从而构成语义网的基础.

语义标注与词义消歧( WSD, word sense disambiguation)本质上属于同一个问题,都是根据上下文决定词语的意义。但严格上讲,语义标注与 WSD有一定的区别, WSD 主要是针对一词多义的现象提出的,一般要给出词在所处语境中的释义,而语义标注则是一种广义的词义区分,所用的类别标签通常较为抽象.

语义标注的方法目前来说有3类①人工标注,由专门人员确定标注资源适用的概念集、解析资源内容结构、选择元数据元素、建立用RDF或HTML语言标记的语义数据。这个过程往往在一定编辑器、概念集和标注过程知识库支持下进行,是一个智力密集和劳动密集过程,难以应付浩瀚和不断变化的网络资源。②领域文档类型定义(DTD)和文档模式进行概念映射和标注。由于SGML/XML文档的DTD或Schema详细定义文档内容结构和各内容元素,我们可以建立特定概念和特定DTD/Schema之间的映射关系,从而自动地将SGML/XML文档中的DTD/Schema内容元素标记转换为对应的概念元数据标注。但由于DTD/Schema的适用领域及其体系结构往往不协调不兼容,因此难以准确映射,还需要人工进行审查和修改。③利用词汇语义分析进行标注,自动词汇抽取和分析技术已较成熟,可在此基础上建立词汇集合与概念类别之间的映射关系,然后通过自动词汇分析找出文档或文档片断的概念类别,甚至与其它类别的语义关系,利用这些概念类别进行标注。该标注方法最好限制在一定的应用领域和资源类型内,而且需要进行人工审查。

语义标注工具,网站http://annotation.semanticweb.org/tools列出了目前已有13种工具:KIMSemanticAnnotationPlatform、Onto mat Annotizer、MnM、SHOE Knowledge Annotator、Annotea,Annozilla,SMORE,Yawas,Melita,GATE,Briefing As—sociate、SemanticWord和SemanticMarkupPlug—inforIntemetExplore。从本体技术的角度上来说,现有工具普遍存在以下的不足旧:①没有工具支持最新的本体语言OWL:②多数工具不支持本体词汇扩充,这与语义Web的应用环境相悖:③语义标注过程中本体查询、辅助推理支持以及元数据产生的自动化程度还不够。

entity linking

实体连接:就是把mention连接到具体指的什么时实体上面去。分为三步:mention detection, link generation, and disambiguation

涉及方法及技术<待补充>

LDA&Interger Linear Programming

<待补充>

TRank

是一个给实体类型排序的系统。具体详情

论文:TRank: Ranking Entity Types Using the Web of Data

文章出现三次对论文TRank的引用:

1)In the context of this paper, both NER and Entity Linking are prerequisites for coreference resolution as we take advantage of external knowledge to improve

the resolution of coreferences and hence must first identify and link as many entity mentions as possible to their counterparts in the knowledge base. Since,

however, those two tasks are not the focus of this work, we decided to use in this paper the TRank pipeline because of its simplicity and its good performance inpractice on our dataset (前言部分entity linking)

2)TRank is a system for ranking entity types given the textual context in which they appear(前言部分 entity types)

3)For the mentions linked in the previous step, we employ the mappings between DBPedia and YAGO ontologies provided by TRank Hierarchy to map DBPedia types to YAGO ones.(semantic annotation部分,semantic typing)

文章的4部分 Approaches to Entity Type Ranking

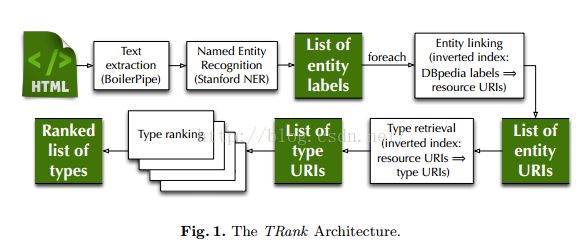

主体结构为:输入网页->利用NER选取出entity->得到entityURI->得到URI的所有types URI->排序type

First,given a Web page (e.g., a news article), we identify entities mentioned in the textual content of the document using state-of-the-art NER focusing on persons,locations, and organizations.

Next, we use an inverted index constructed over DBpedia literals attached to its URIs and use the extracted entity as a query to the index to select the best-matching URI for that entity.

Then,given an entity URI, we retrieve (for example, thanks to a SPARQL query to a knowledge base) all the types attached to the entity.

Finally, our system produces a ranking of the resulting types based on the textual context where the entity has been mentioned

排序的方法:

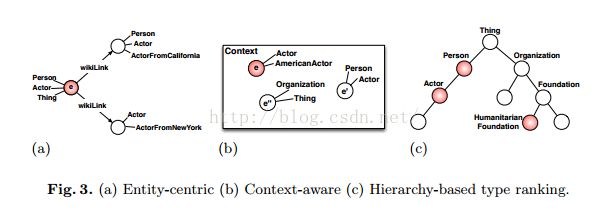

The proposed approaches for entity type ranking can be grouped in entity-centric, context-aware, and hierarchy-based

主要方法介绍:

(a)Entity-Centric Ranking Approaches

PREQ:根据类型在背景知识库下面的频率(frequency),

WIKILINK:利用给定的实体和背景知识库的拓展实体的关系。对相邻实体进行计数,可以利用SPARQL来做。

LABEL:舍弃文本相似的方法,计算标签e与背景知识库中其他的标签的TF-IDF相似度来找到关联实体,使用最相关的实体来给e的类型排序。挑选出top-10个与e有最相似的标签的实体,基于frequency对实体排序。

(b)Context-Aware Ranking Approaches

SAMETYPE:当相同的URI类型被e和e'使用的时候,或者e和e'有共同的标签的时候,是一个匹配。

PATH:利用类型层次和e出现的上下文。根据从root到t的路径的相似度来排序。

(c)Hierarchy-Based Ranking Approaches

使用类型层次评估实体类型ti关联到实体e的深度来评价关联性。

ANCESTORS:how many ancestors ofti∈Teare also a type ofe. That is, ifAncestors(ti) is the set of ancestors of tiin the integrated type hierarchy, then

we define the score oftias the size of the set{tj|tj∈Ancestors(ti)∧ tj∈Te}.

For example, in Figure 3c we rank first the type ‘Actor’ because ‘Person’ is its ancestor and it is also a type of e. On the other hand, the type ‘Humanitarian Foundation’ has a bigger depth but no ancestor which is also a type of e.

ANC_DEPTH:considers not just the number of such ancestors oftibut also their depth

使用训练集找到最好的方法来联合不同的技术,使用决策树和线性回归模型来联合排序的方法。决策树使用M5。

TF-IDF

TF词频(Term Frequency),表示词条在文档d中出现的频率

IDF逆向文件频率(Inverse Document Frequency)。IDF的主要思想是:如果包含词条t的文档越少,也就是n越小,IDF越大,则说明词条t具有很好的类别区分能力。如果某一类文档C中包含词条t的文档数为m,而其它类包含t的文档总数为k,显然所有包含t的文档数n=m+k,当m大的时候,n也大,按照IDF公式得到的IDF的值会小,就说明该词条t类别区分能力不强。但是实际上,如果一个词条在一个类的文档中频繁出现,则说明该词条能够很好代表这个类的文本的特征,这样的词条应该给它们赋予较高的权重,并选来作为该类文本的特征词以区别与其它类文档。这就是IDF的不足之处

词频(term frequency,TF)指的是某一个给定的词语在该文件中出现的频率。这个数字是对词数(term count)的归一化,以防止它偏向长的文件。(同一个词语在长文件里可能会比短文件有更高的词数,而不管该词语重要与否。)对于在某一特定文件里的词语来说,它的重要性可表示为:

![]()

式子中分子是该词在文件中的出现次数,而分母则是在文件中所有字词的出现次数之和。

逆向文件频率(inverse document frequency,IDF)是一个词语普遍重要性的度量。某一特定词语的IDF,可以由总文件数目除以包含该词语之文件的数目,再将得到的商取对数得到

![]()

|D|:语料库中的文件总数

:包含词语的文件数目(即的文件数目)如果该词语不在语料库中,就会导致分母为零,因此一般情况下使用![]() 作为分母

作为分母

TF-IDF

某一特定文件内的高词语频率,以及该词语在整个文件集合中的低文件频率,可以产生出高权重的TF-IDF。因此,TF-IDF倾向于过滤掉常见的词语,保留重要的词语

![]()

Metrics

Recall&Presicion&F1召回率:Recall,又称“查全率”。

准确率:Precision,又称“精度”、“正确率”。

在一个大规模数据集合中检索文档时,可把集合中的所有文档分成四类:

相关的 不相关的

检索到的 A B

未检索到的 C D

A:检索到的,相关的 (搜到的也想要的)

B:检索到的,但是不相关的 (搜到的但没用的)

C:未检索到的,但却是相关的 (没搜到,然而实际上想要的)

D:未检索到的,也不相关的 (没搜到也没用的)

通常我们希望:数据库中相关的文档,被检索到的越多越好,这是追求“查全率”,即A/(A+C),越大越好。

同时我们还希望:检索到的文档中,相关的越多越好,不相关的越少越好,这是追求“准确率”,即A/(A+B),越大越好。

归纳如下:

召回率:检索到的相关文档 比 库中所有的相关文档

准确率:检索到的相关文档 比 所有被检索到的文档

“召回率”与“准确率”虽然没有必然的关系(从上面公式中可以看到),然而在大规模数据集合中,这两个指标却是相互制约的。

由于“检索策略”并不完美,希望更多相关的文档被检索到时,放宽“检索策略”时,往往也会伴随出现一些不相关的结果,从而使准确率受到影响。

而希望去除检索结果中的不相关文档时,务必要将“检索策略”定的更加严格,这样也会使有一些相关的文档不再能被检索到,从而使召回率受到影响。

凡是设计到大规模数据集合的检索和选取,都涉及到“召回率”和“准确率”这两个指标。而由于两个指标相互制约,我们通常也会根据需要为“检索策略”选择一个合适的度,不能太严格也不能太松,寻求在召回率和准确率中间的一个平衡点。这个平衡点由具体需求决定。

Recall:the ability to remember sth. that you have learned or sth.that has happened in the past.

Recall就是指:检索系统能“回忆”起那些事的多少细节,通俗来讲就是“回忆的能力”。能回忆起来的细节数除以 系统知道这件事的所有细节,就是“记忆率”,也就是recall——召回率。

F-Measure是Precision和Recall的加权调和平均:

F=(a*a+1)P*R/(a*a(P+R))

当a=1时,就是常见的F1

F1=2*P*R/(P+R)

可见,当F1较大时,实验结果比较理想

参考网址:

[2] 张坤, 刘妍, 王达. 针对最大熵模型和条件随机域模型的研究[J]. 黑龙江科技信息, 2007(12X):31-31.

[3] 傅柱, 王曰芬. 语义标注研究的发展与趋势[C]// 全国知识组织与知识链接学术交流会. 2013.

[5] Tonon A, Catasta M, Demartini G, et al. TRank: Ranking Entity Types Using the Web of Data[M]// The Semantic Web – ISWC 2013. Springer Berlin Heidelberg, 2013:640-656.

[8]http://baike.baidu.com/link?url=_p0KLUg2qX2p7qXuhPSIQT8MVc2eUP0aYeOR9MkPu95vvql92Kl4sCeHZ3eLJ__zl4XUVmukbaFTqehHkGhRaa