深度学习——注意力分数(笔记+代码)

1.注意力分数

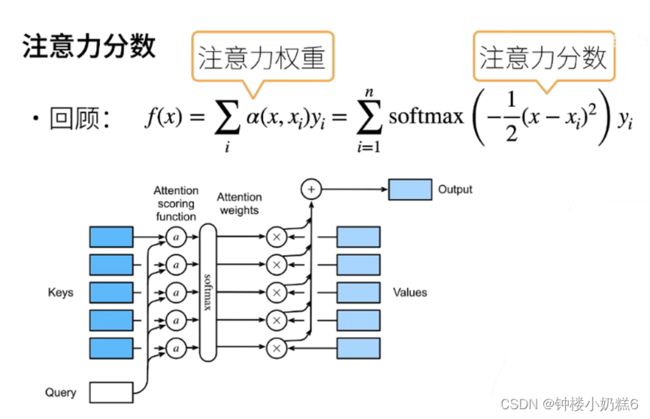

①α(x,xi):注意力权重,权重是一组大于等于0,相加和为1的数

②注意力分数:高斯核的指数部分,相当于注意力权重归一化之前的版本

③上图展示:假设已知一些key-value对和一个query。首先将query和每一个key通过注意力分数函数a和softmax运算得到注意力权重(与key对应的值概率分布),这些注意力权重与已知的value进行加权求和,最终得到输出

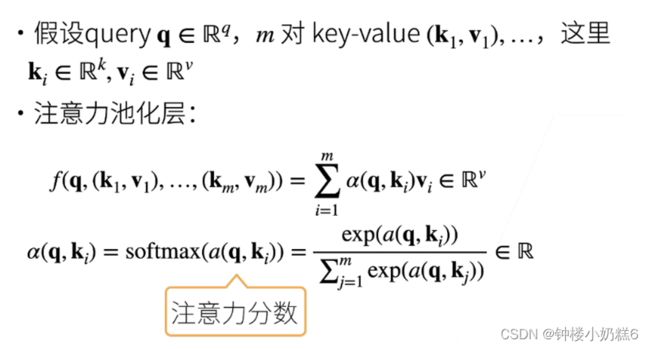

2.如何将key和value扩展到更高的维度

①假设query是一个长为q的向量,ki是长为k的向量,vi是长为v的向量。(key和value的长度可以不同)

②其中query和ki的注意力权重(标量)是通过注意力评分函数a将两个向量映射成标量,再经过softmax运算得到的。

3.遮蔽softmax操作

Softmax操作是用于输出一个概率分布作为注意力权重,但是在某些情况下,不是所有的值都应该被纳入到注意力汇聚中

①处理文本数据集的时候,采用填充的方式让文本序列有相同的长度。便于小批量进行加载,会存在一些填充没有意义的词源。如

②为了让有意义的词元作为值获取注意力汇聚,指定一个有效序列的长度。超出长度遮蔽为0,便于softmax过滤掉超出范围的位置。

def masked_softmax(X, valid_lens):

'''通过最后一个轴上遮蔽元素来执行softmax操作'''

# X:3D张量,valid_lens 1D或2D张量

if valid_lens is None:

return nn.functional.softmax(X, dim=-1)

else:

shape = X.shape

if valid_lens.dim() == 1:

valid_lens = torch.repeat_interleave(valid_lens, shape[1])

else:

valid_lens = valid_lens.reshape(-1)

# 最后一个轴上被屏蔽元素使用非常大的负值替换,使softmax输出为0

X = d2l.sequence_mask(X.reshape(-1, shape[-1]), valid_lens, value=-1e6)

return nn.functional.softmax(X.reshape(shape), dim=-1)4.注意力分数a的设计

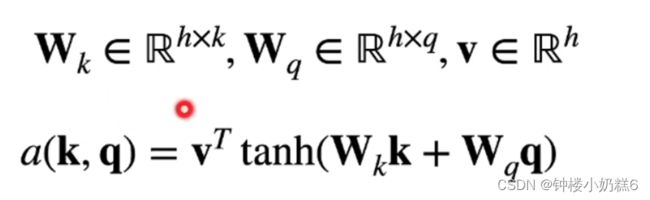

①当query和key是不同长度的矢量时,可以使用加性注意力作为注意力分数

②可学参数有3个

h:超参数

Wk:key从k map到h(将key向量长度从k转化为h)

Wq:query从q map到h(将query向量长度从q转化为h)

Wk,Wq是矩阵,v是向量

Tanh是激活函数

③上式中,k是长为k的向量,q是长为q的向量

④等价于将query和key合并起来变成一个长为k+q的向量,然后将其输入到一个隐藏层大小为h,输出大小为1的但隐藏层是MLP,最终得到输出

⑤优点是key,value向量长度是任意的,可以不同。

class AdditiveAttention(nn.Module):

'''加性注意力'''

def __init__(self, key_size, query_size, num_hiddens, dropout, **kwargs):

super(AdditiveAttention, self).__init__(**kwargs)

self.W_k = nn.Linear(key_size, num_hiddens, bias=False)

self.W_q = nn.Linear(query_size, num_hiddens, bias=False)

self.w_v = nn.Linear(num_hiddens, 1, bias=False)

self.dropout = nn.Dropout(dropout)

def forward(self, queries, keys, values, valid_lens):

queries, keys = self.W_q(queries), self.W_k(keys)

# 在维度扩展后,queries的形状(batch_size,查询的个数,1,num_hidden)

# key(batch_size,1,"K_V"个数,num_hiddens)

# 使用广播方式进行求和

features = queries.unsqueeze(2) + keys.unsqueeze(1)

features = torch.tanh(features)

# self.w_v仅有一个输出,因此形状移除最后一个维度

# scores的形状(batch_size,查询的个数,"K-V"个数)

scores = self.w_v(features).squeeze(-1)

self.attention_weights = masked_softmax(scores, valid_lens)

# values形状:batch`_size,"k-v"个数,值得维度

return torch.bmm(self.dropout(self.attention_weights), values)5.缩短点积注意力

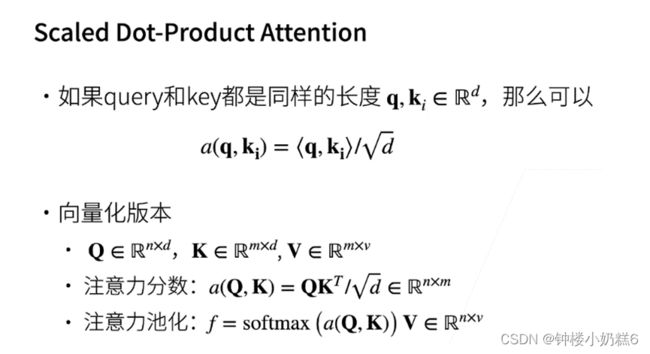

①使用点积可以得到计算效率更高的评分函数,但是点积操作要求query和key具有相同的长度

②针对key和query长度相同的情况

③假设query和key的所有元素都是独立的随机变量,并且都满足零均值和单位方差,那么两个向量的点积的均值为0,方差为d

④不需要学习任何东西,利用

(除以根号d的目的是为了降低对ki的长度的敏感度,使得 无论向量的长度如何,点积的方差都在不考虑向量长度情况下是1)

class DotProductAttention(nn.Module):

'''缩短点积注意力'''

def __init__(self, dropout, **kwargs):

super(DotProductAttention, self).__init__(**kwargs)

self.dropout = nn.Dropout(dropout)

# queries的形状:(batch_size,查询的个数,d)

# keys的形状:(batch_size,“键-值”对的个数,d)

# values的形状:(batch_size,“键-值”对的个数,值的维度)

# valid_lens的形状:(batch_size,)或者(batch_size,查询的个数)

def forward(self, queries, keys, values, valid_lens=None):

d = queries.shape[-1]

# 设置transpose_b=True为了交换keys的最后两个维度

scores = torch.bmm(queries, keys.transpose(1, 2)) / math.sqrt(d)

self.attention_weights = masked_softmax(scores, valid_lens)

return torch.bmm(self.dropout(self.attention_weights), values)

【总结】

①注意力分数是query和key的相似度,注意力权重是注意力分数的softmax的结果(0到1之间的数)

②两种常见的注意力分数的计算

Ⅰ有参数版本:将query和key合并起来进入一个单隐藏层单输出的MLP(query和key长度不同)

Ⅱ无参数版本:将query和key做内积(query和key长度相同),效率高