Hadoop的搭建

hadoop的安装与配置

一:配置Linux免密登录,安装hadoop前要先配置Java 环境变量,点我的主页有详细的配置步骤,这里就不做详细的讲解。

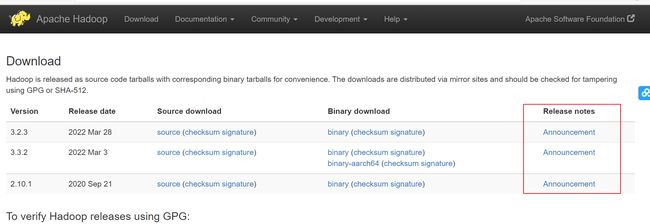

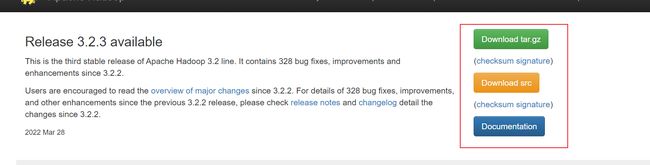

二:下载地址为:链接https://hadoop.apache.org/.

一:

注意:不推荐下载太高版本

①:关闭防火墙–永久关闭

三台都要操作,关闭防火墙为了后续登录50070端口

systemctl stop firewalld

systemctl disable firewalld

②:上传Hadoop的压缩包,到Linux下的home路径下,tar -zxvf hadoopx.x.x.tar 解压

③:在hadoop-2.7.3目录下创建四个目录:tmp、hdfs、hdfs/data、hdfs/name tmp:用来存储Hadoop临时文件,hdfs/data目录存储hdfs的文件块,hdfs/name目录用来存储元数据信息

④:配置hadoop-env.sh中的环境变量、

export PATH=.:$HADOOP_HOME/bin:$JAVA_HOME/bin:$PATH

# JAVA_HOME指定的路径根据自己的安装目录不要自己拷贝

export JAVA_HOME=/usr/java/jdk

export HADOOP_HOME=/usr/hadoop/hadoop-2.7.4

⑤:yarn-env.sh

export JAVA_HOME=/usr/java/jdk

export YARN_LOG_DIR=/usr/hadoop/hadoop-2.7.4/logs/yarn

⑥:配置hadoop的环境变量

vi /etc/profile

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME

export HADOOP_HOME=/usr/hadoop/hadoop-2.7.4

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

二:配置文件

文件位置:hadoop/etc/hadoop

配置core-site.xml文件

fs.defaultFS

hdfs://server-1:9000

hadoop.tmp.dir

# 这里是你创建的tmp路径

file:/usr/local/zhitu/hadoop-2.7.3/tmp

io.file.buffer.size

131702

配置hdfs-site.xml文件

进入hadoop目录下的etc/hadoop目录下,修改hdfs-site.xml文件,该文件主要是hdfs系统的相关配置,在配置中增加如下配置项:

dfs.namenode.name.dir :使用之前我们创建的hdfs/name目录

dfs.datanode.data.dir:使用之前我们创建的hdfs/data目录

dfs.replication: 文件保存的副本数

dfs.namenode.secondary.http-address:http访问hdfs系统的地址(一般使用服务器名称)和端口

dfs.webhdfs.enabled:是否开启web访问hdfs系统。设置为true可以让外部系统使用http协议访问hdfs系统。

dfs.namenode.name.dir

file:/usr/local/zhitu/hadoop-2.7.3/hdfs/name

dfs.datanode.data.dir

file:/usr/local/zhitu/hadoop-2.7.3/hdfs/data

dfs.replication

2

dfs.namenode.secondary.http-address

server-1:9001

dfs.webhdfs.enabled

true

3.4、配置mapred-site.xml文件

mappred.xml文件中主要配置mapreduce相关的配置。

进入hadoop-2.7.3目录下的etc/hadoop目录下,将文件mapred-site.xml.template使用mv命令重命名为mapred-site.xml,并修改该文件增加如下配置项:

mapreduce.framework.name :运行mapreduce使用的框架,2.0以上的都是用的yarn

mapreduce.jobhistory.address:历史服务器的地址

mapreduce.jobhistory.webapp.address: 历史服务器的web访问地址

mapreduce.framework.name

yarn

mapreduce.jobhistory.address

server-1:10020

mapreduce.jobhistory.webapp.address

server-1:19888

配置yarn-site.xml文件

yarn-site.xml文件中主要配置yarn框架相关的配置。

进入hadoop-2.7.3目录下的etc/hadoop目录下,修改yarn-site.xml文件,增加如下配置项:

yarn.nodemanager.aux-services:NodeManager上运行的附属服务。需配置成mapreduce_shuffle,才可运行MapReduce程序

yarn.nodemanager.auxservices.mapreduce.shuffle.class:mapreduce执行shuffle使用的class

yarn.resourcemanager.address:resourceManager的地址,客户端通过该地址向RM提交应用程序,杀死应用程序等

yarn.resourcemanager.scheduler.address:ResourceManager 对ApplicationMaster暴露的访问地址。ApplicationMaster通过该地址向RM申请资源、释放资源

yarn.resourcemanager.resource-tracker.address: ResourceManager 对NodeManager暴露的地址.。NodeManager通过该地址向RM汇报心跳,领取任务等

yarn.resourcemanager.admin.address:ResourceManager 对管理员暴露的访问地址。管理员通过该地址向RM发送管理命令。

yarn.resourcemanager.webapp.address:ResourceManager对外web ui地址。用户可通过该地址在浏览器中查看yarn框架中运行的任务状态

yarn.nodemanager.resource.memory-mb:NodeManager运行所需要的内存,单位MB。

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.nodemanager.auxservices.mapreduce.shuffle.class

org.apache.hadoop.mapred.ShuffleHandler

yarn.resourcemanager.address

主节点名称:8032

yarn.resourcemanager.scheduler.address

主节点名称:8030

yarn.resourcemanager.resource-tracker.address

主节点名称:8031

yarn.resourcemanager.admin.address

主节点名称:8033

yarn.resourcemanager.webapp.address

主节点名称:8088

yarn.nodemanager.resource.memory-mb

1536

8.修改 slaves 删除localhost添加从节点主机名。

将Hadoop复制到各从服务器

通过以上步骤我们基本已经配置好了hadoop的集群配置,现在我们需要将我们配置好的文件复制到其他的服务器上。将文件copy到从服务器上的方法有很多,建议使用scp命令。

9.格式化namenode

在主服务器上,进入hadoop目录下,格式化namenode。

bin/hdfs namenode -format

10.启动Hadoop

在主服务器上,进入hadoop目录下,启动Hadoop集群。

sbin/start-all.sh

用 jps,检测主节点从节点的进程是否启动成功!