动手学习深度学习(总结梳理)——10. GPU的使用

目录

1. 计算设备

2. 张量和CPU

2.1 存储在CPU上

2.2 复制

2.3. 旁注

3. 神经网络和GPU

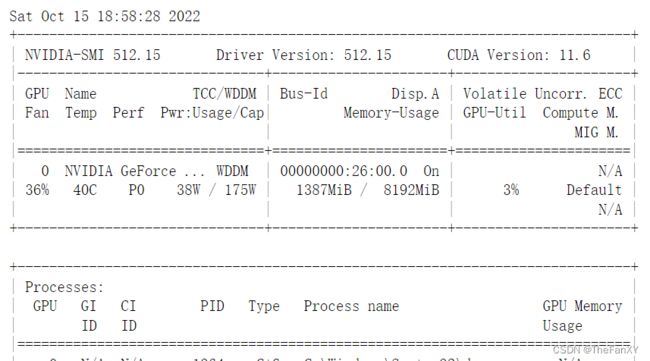

本节,我们将讨论如何利用这种计算性能进行研究。 首先是如何使用单个GPU,然后是如何使用多个GPU和多个服务器(具有多个GPU)。我们先看看如何使用单个NVIDIA GPU进行计算。 首先,确保你至少安装了一个NVIDIA GPU。

!nvidia-smi在PyTorch中,每个数组都有一个设备(device), 我们通常将其称为上下文(context)。 默认情况下,所有变量和相关的计算都分配给CPU。 有时上下文可能是GPU。 当我们跨多个服务器部署作业时,事情会变得更加棘手。 通过智能地将数组分配给上下文, 我们可以最大限度地减少在设备之间传输数据的时间。 例如,当在带有GPU的服务器上训练神经网络时, 我们通常希望模型的参数在GPU上。

要运行此部分中的程序,至少需要两个GPU。 注意,对于大多数桌面计算机来说,这可能是奢侈的,但在云中很容易获得。 例如,你可以使用AWS EC2的多GPU实例。

1. 计算设备

我们可以指定用于存储和计算的设备,如CPU和GPU。 默认情况下,张量是在内存中创建的,然后使用CPU计算它。

在PyTorch中,CPU和GPU可以用

torch.device('cpu')和torch.device('cuda')表示。 应该注意,cpu设备意味着所有物理CPU和内存, 这意味着PyTorch的计算将尝试使用所有CPU核心。 然而,gpu设备只代表一个卡和相应的显存。 如果有多个GPU,我们使用torch.device(f'cuda:{i}')来表示第i块GPU(i从0开始)。且cuda:0和cuda是等价的。

import torch

from torch import nn

torch.device('cpu'), torch.device('cuda'), torch.device('cuda:1') '''

(device(type='cpu'), device(type='cuda'), device(type='cuda', index=1)) '''我们可以查询可用gpu的数量。

torch.cuda.device_count() '''

output : 2 '''现在我们定义了两个方便的函数, 这两个函数允许我们在不存在所需所有GPU的情况下运行代码。

def try_gpu(i=0):

"""如果存在,则返回gpu(i),否则返回cpu()"""

if torch.cuda.device_count() >= i + 1:

return torch.device(f'cuda:{i}')

return torch.device('cpu')

def try_all_gpus():

"""返回所有可用的GPU,如果没有GPU,则返回[cpu(),]"""

devices = [torch.device(f'cuda:{i}')

for i in range(torch.cuda.device_count())]

return devices if devices else [torch.device('cpu')]

try_gpu(), try_gpu(10), try_all_gpus() '''

(device(type='cuda', index=0),

device(type='cpu'),

[device(type='cuda', index=0), device(type='cuda', index=1)]) '''2. 张量和CPU

我们可以查询张量所在的设备。 默认情况下,张量是在CPU上创建的。

x = torch.tensor([1, 2, 3])

x.device '''

device(type='cpu') '''需要注意的是,无论何时我们要对多个项进行操作, 它们都必须在同一个设备上。 例如,如果我们对两个张量求和, 我们需要确保两个张量都位于同一个设备上, 否则框架将不知道在哪里存储结果,甚至不知道在哪里执行计算。

2.1 存储在CPU上

有几种方法可以在GPU上存储张量。 例如,我们可以在创建张量时指定存储设备。接下来,我们在第一个gpu上创建张量变量X。 在GPU上创建的张量只消耗这个GPU的显存。 我们可以使用nvidia-smi命令查看显存使用情况。 一般来说,我们需要确保不创建超过GPU显存限制的数据。

X = torch.ones(2, 3, device=try_gpu())

X '''

tensor([[1., 1., 1.],

[1., 1., 1.]], device='cuda:0') '''假设你至少有两个GPU,下面的代码将在第二个GPU上创建一个随机张量。

Y = torch.rand(2, 3, device=try_gpu(1))

Y '''

tensor([[0.1379, 0.4532, 0.9869],

[0.4779, 0.7426, 0.9622]], device='cuda:1') '''2.2 复制

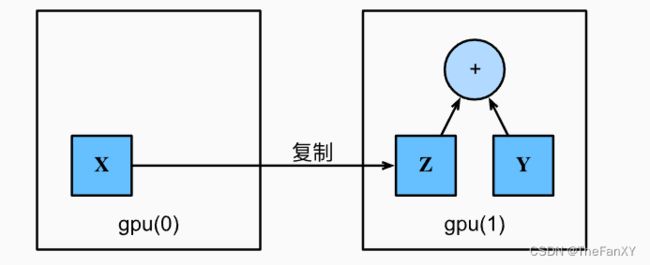

如果我们要计算X + Y,我们需要决定在哪里执行这个操作。 例如如下图所示, 我们可以将X传输到第二个GPU并在那里执行操作。 不要简单地X加上Y,因为这会导致异常, 运行时引擎不知道该怎么做:它在同一设备上找不到数据会导致失败。 由于Y位于第二个GPU上,所以我们需要将X移到那里, 然后才能执行相加运算。

Z = X.cuda(1)

print(X)

print(Z) '''

tensor([[1., 1., 1.],

[1., 1., 1.]], device='cuda:0')

tensor([[1., 1., 1.],

[1., 1., 1.]], device='cuda:1') '''现在数据在同一个GPU上(Z和Y都在),我们可以将它们相加。

Y + Z '''

tensor([[1.1379, 1.4532, 1.9869],

[1.4779, 1.7426, 1.9622]], device='cuda:1') '''假设变量Z已经存在于第二个GPU上。 如果我们还是调用Z.cuda(1)会发生什么? 它将返回Z,而不会复制并分配新内存。

Z.cuda(1) is Z '''

output: True '''2.3. 旁注

人们使用GPU来进行机器学习,因为单个GPU相对运行速度快。 但是在设备(CPU、GPU和其他机器)之间传输数据比计算慢得多。 这也使得并行化变得更加困难,因为我们必须等待数据被发送(或者接收), 然后才能继续进行更多的操作。 这就是为什么拷贝操作要格外小心。 根据经验,多个小操作比一个大操作糟糕得多。 此外,一次执行几个操作比代码中散布的许多单个操作要好得多(除非你确信自己在做什么)。 如果一个设备必须等待另一个设备才能执行其他操作, 那么这样的操作可能会阻塞。 这有点像排队订购咖啡,而不像通过电话预先订购: 当你到店的时候,咖啡已经准备好了。

最后,当我们打印张量或将张量转换为NumPy格式时, 如果数据不在内存中,框架会首先将其复制到内存中, 这会导致额外的传输开销。 更糟糕的是,它现在受制于全局解释器锁,使得一切都得等待Python完成。

3. 神经网络和GPU

类似地,神经网络模型可以指定设备。 下面的代码将模型参数放在GPU上。

net = nn.Sequential(nn.Linear(3, 1))

net = net.to(device=try_gpu())

net(X) '''

tensor([[-0.0132],

[-0.0132]], device='cuda:0', grad_fn=)''' 让我们确认模型参数存储在同一个GPU上。

net[0].weight.data.device '''

device(type='cuda', index=0)'''