安装和部署elasticsearch

文章目录

- 一、安装elasticsearch

-

- 1.1 部署单点elasticsearch

-

- 1.1.1 创建网络

- 1.1.2 安装镜像

- 1.1.3 部署

- 1.1.4 测试

- 1.2 部署kibana

-

- 1.2.1 安装镜像

- 1.2.2 部署

- 1.2.3 测试

- 1.2.4 DevTools工具

- 1.3 安装IK分词器

-

- 1.3.1 安装ik插件

- 1.3.2 查找数据卷目录

- 1.3.3 上传至容器

- 1.3.4 测试

一、安装elasticsearch

1.1 部署单点elasticsearch

1.1.1 创建网络

创建一个网络,让让elasticsearch和kibana容器可以互联:

docker network create es-net

1.1.2 安装镜像

方式一:在线拉取

#这边使用的是7.12.1版本

docker pull elasticsearch:7.12.1

方式二:从本地加载

如果本地存在镜像包,使用命令加载镜像即可:

# 导入数据

docker load -i es.tar

1.1.3 部署

使用docker命令,部署单点elasticsearch:

#-d 后台运行

docker run -d \

#--name 设置容器名称

--name es \

#-e 设置环境变量

#ES_JAVA_OPTS配置JVM的堆内存大小

#discovery.type配置运行模式,single-node单点模式

-e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \

-e "discovery.type=single-node" \

#-v 数据卷挂载

#es-data 设置es数据保存的目录

#es-plugins 设置es插件的目录

-v es-data:/usr/share/elasticsearch/data \

-v es-plugins:/usr/share/elasticsearch/plugins \

#授予逻辑卷访问权

--privileged \

#--network 加入网络

--network es-net \

#-p 端口映射

#9200 http协议端口

-p 9200:9200 \

#9300 各个节点互联的端口

-p 9300:9300 \

elasticsearch:7.12.1

1.1.4 测试

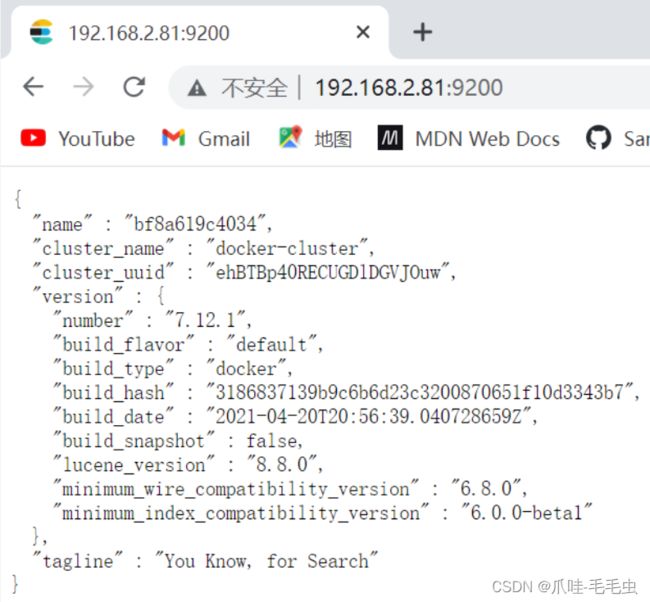

在浏览器中输入:IP地址:9200 即可看到elasticsearch的响应结果:

1.2 部署kibana

kibana可以给我们提供一个elasticsearch的可视化界面,便于我们学习。

1.2.1 安装镜像

方式一:在线拉取

#这边使用的是7.12.1版本

docker pull kibana:7.12.1

方式二:从本地加载

如果本地存在镜像包,使用命令加载镜像即可:

# 导入数据

docker load -i kibana.tar

1.2.2 部署

运行docker命令,部署kibana:

#-d 后台运行

docker run -d \

#--name 设置容器名称

--name kibana \

#-e 设置环境变量

#ELASTICSEARCH_HOSTS elasticsearch地址

-e ELASTICSEARCH_HOSTS=http://es:9200 \

#--network 加入网络

--network=es-net \

#-p 端口映射

-p 5601:5601 \

kibana:7.12.1

1.2.3 测试

在浏览器中输入:IP地址:5601 即可看到kibana的响应结果:

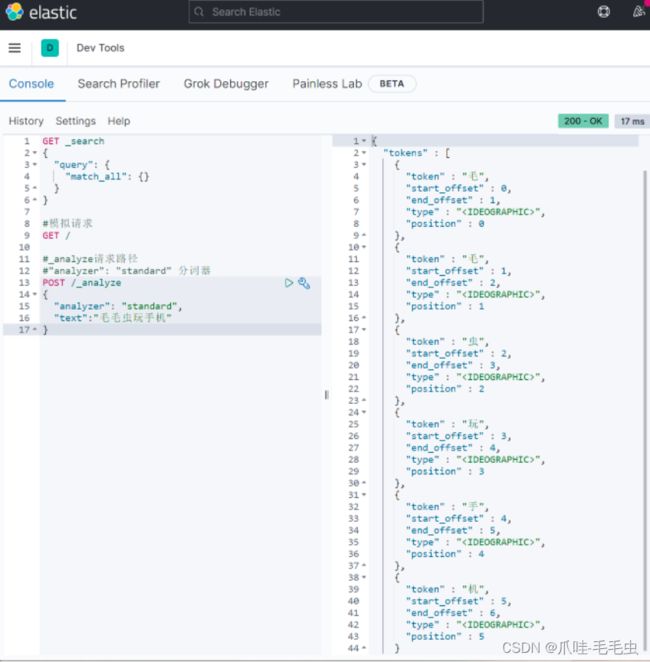

1.2.4 DevTools工具

kibana中提供了一个DevTools界面:

这个界面中可以编写DSL来操作elasticsearch。并且对DSL语句有自动补全功能,但是在进行分词的时候不能对中文进行有效拆分,这时候就需要安装IK分词器插件。

1.3 安装IK分词器

1.3.1 安装ik插件

- 在线安装

# 进入容器内部

docker exec -it elasticsearch /bin/bash

# 在线下载并安装

./bin/elasticsearch-plugin install https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.12.1/elasticsearch-analysis-ik-7.12.1.zip

#退出

exit

#重启容器

docker restart elasticsearch

- 离线安装ik插件(推荐)

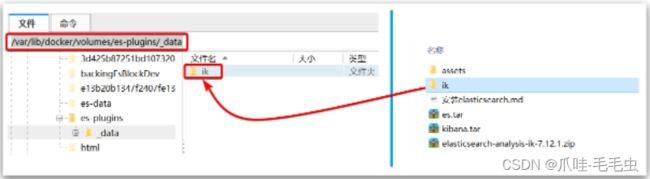

1.3.2 查找数据卷目录

安装插件需要知道elasticsearch的plugins目录位置,这里使用了数据卷挂载,因此需要查看elasticsearch的数据卷目录,通过下面命令查看:

docker volume inspect es-plugins

显示结果:

[

{

"CreatedAt": "2022-05-06T10:06:34+08:00",

"Driver": "local",

"Labels": null,

"Mountpoint": "/var/lib/docker/volumes/es-plugins/_data",

"Name": "es-plugins",

"Options": null,

"Scope": "local"

}

]

说明plugins目录被挂载到了:/var/lib/docker/volumes/es-plugins/_data 这个目录中。

1.3.3 上传至容器

把下载的ik分词器解压缩,重命名为ik,上传到es容器的插件数据卷中,也就是/var/lib/docker/volumes/es-plugins/_data :

最后重启容器

docker restart es

1.3.4 测试

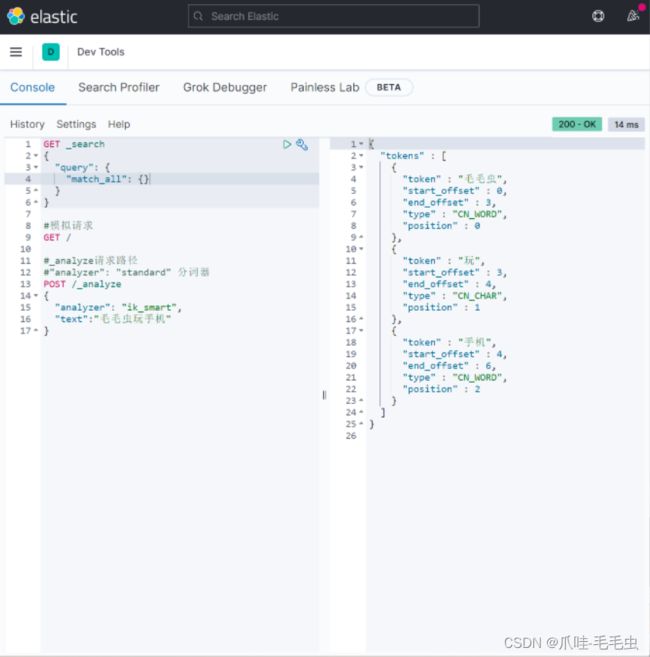

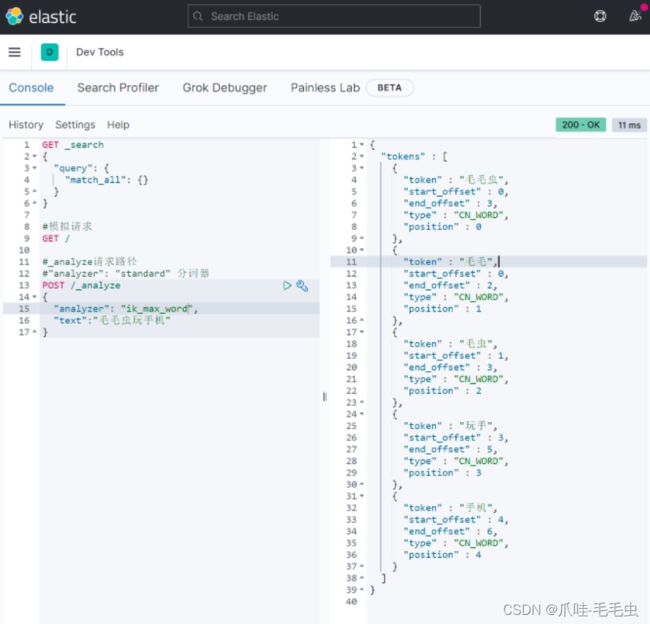

IK分词器包含两种模式:

-

ik_smart:最少切分 -

ik_max_word:最细切分

测试一:

测试二: