- Python连接SQL SEVER数据库全流程

m0_74824865

面试学习路线阿里巴巴数据库pythonsql

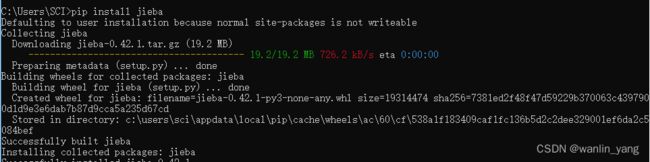

背景介绍在数据分析领域,经常需要从数据库中获取数据进行分析和处理。而SQLServer是一种常用的关系型数据库管理系统,因此学习如何使用Python连接SQLServer数据库并获取数据是非常有用的。以下是Python使用pymssql连接SQLServer数据库的全流程:安装pymssql库本地账号设置脚本连接数据导入函数实现一、安装pymssqlpymssql是Python连接SQLServe

- 网络安全工具 AWVS 与 Nmap:原理、使用及代码示例

阿贾克斯的黎明

网络安全安全web安全网络

目录网络安全工具AWVS与Nmap:原理、使用及代码示例AWVS:Web漏洞扫描的利器1.工具概述2.工作原理3.使用方法4.代码示例(Python调用AWVSAPI进行扫描)Nmap:网络探测与端口扫描的神器1.工具概述2.工作原理3.使用方法4.代码示例(Python调用Nmap进行扫描)总结在网络安全领域,AWVS(AcunetixWebVulnerabilityScanner)和Nmap是

- 深入剖析 Weblogic、ThinkPHP、Jboss、Struct2 历史漏洞

阿贾克斯的黎明

网络安全web安全

目录深入剖析Weblogic、ThinkPHP、Jboss、Struct2历史漏洞一、Weblogic漏洞(一)漏洞原理(二)漏洞利用代码(Python示例)(三)防范措施二、ThinkPHP漏洞(一)漏洞原理(二)漏洞利用代码(示例,假设存在漏洞的代码片段)(三)防范措施三、Jboss漏洞(一)漏洞原理(二)漏洞利用代码(Java示例,用于构造恶意序列化数据)(三)防范措施四、Struct2漏洞

- 【Python专栏】Python的发展历程

雾岛心情

Python入门到精通python开发语言

Python的创始人为吉多·范罗苏姆(GuidovanRossum),人称龟叔1989年,为了打发圣诞节假期,Guido开始写Python语言的编译器。Python这个名字,来自Guido所挚爱的电视剧MontyPython’sFlyingCircus。他希望这个新的叫做Python的语言,能符合他的理想:创造一种C和shell之间,功能全面,易学易用,可拓展的语言。Python的具体发展历史和版

- Stable diffusion 3.5本地运行环境配置记录

寸先生的牛马庄园

扩散模型stablediffusion

1.环境配置创建虚环境condacreate-nsd3.5python=3.10Pytorch(>2.0)condainstallpytorch==2.2.2torchvision==0.17.2torchaudio==2.2.2pytorch-cuda=12.1-cpytorch-cnvidiaJupyter能使用Anaconda虚环境condainstallipykernelpython-mi

- 阿里巴巴DIN模型原理与Python实现

eso1983

python开发语言算法推荐算法

阿里巴巴的DeepInterestNetwork(DIN)是一种用于点击率预测(CTR)的深度学习模型,特别针对电商场景中用户兴趣多样化和动态变化的特性设计。其核心思想是通过注意力机制动态捕捉用户历史行为中与当前候选商品相关的兴趣。1.DIN模型原理1.核心问题传统推荐模型(如Embedding+MLP)将用户历史行为视为固定长度的向量,忽略了用户兴趣的多样性。例如,用户历史行为中可能包含多个互不

- pytorch基础-比较矩阵是否相等

yuweififi

pytorch人工智能

1、使用NumPy库NumPy是Python中用于科学计算的常用库,它提供了array_equal和allclose函数来判断矩阵是否相等。array_equal用于精确比较,allclose用于考虑一定误差范围的近似比较,适合浮点数矩阵。importnumpyasnp#创建示例矩阵matrix_a=np.array([[1,2,3],[4,5,6]])matrix_b=np.array([[1,

- 一学就会:A*算法详细介绍(Python)

不去幼儿园

人工智能(AI)#启发式算法算法python人工智能机器学习开发语言

本篇文章是博主人工智能学习以及算法研究时,用于个人学习、研究或者欣赏使用,并基于博主对相关等领域的一些理解而记录的学习摘录和笔记,若有不当和侵权之处,指出后将会立即改正,还望谅解。文章分类在启发式算法专栏:【人工智能】-【启发式算法】(6)---《一学就会:A*算法详细介绍(Python)》一学就会:A*算法详细介绍(Python)目录A*算法介绍A*算法的核心概念A*算法的特点A*算法示例:迷宫

- 电竞赛事数据分析:LNG vs BLG的胜利背后

烧瓶里的西瓜皮

python自动驾驶人工智能数据可视化机器学习

电竞赛事数据分析:LNGvsBLG的胜利背后摘要在S14瑞士轮次日,LNG以1:0战胜BLG,取得了开赛二连胜。本文将通过Python进行数据处理与分析,结合机器学习算法预测比赛结果,并使用数据可视化工具展示关键指标。通过对这场比赛的数据深入挖掘,揭示LNG获胜的关键因素。引言电子竞技(Esports)已经成为全球范围内的一项重要娱乐活动,而《英雄联盟》(LeagueofLegends,LoL)作

- 如何使用Python编程实现捕获笔记本电脑麦克风的音频并通过蓝牙耳机实时传输

winfredzhang

python音视频实时传输蓝牙耳机

在现代的工作和生活环境中,音频传输的需求日益增加。无论是远程会议、在线教育,还是家庭娱乐,音频的实时传输都扮演着至关重要的角色。今天,我将向大家介绍一个简单而实用的应用程序,它能够捕获笔记本电脑麦克风的音频,并通过蓝牙耳机实时传输。这款应用程序特别适用于需要在会议室等场景中远程听取声音的情况。接下来,我将详细讲解这个应用程序的实现过程,并提供完整的代码和使用指南。引言想象一下这样的场景:你需要离开

- 网络安全加密python代码

黑客Ash

web安全安全

点击文末小卡片,免费获取网络安全全套资料,资料在手,涨薪更快网络信息安全中遇到的各种攻击是防不胜防的,采取适当的防护措施就能有效地保护网络信息的安全,包括防火墙、入侵检测系统、漏洞扫描技术以及加密技术等多种防护措施。而信息安全的本质就是要保护信息本身和信息系统在存储、传输中的完整性和保密性,保障不被攻击和篡改,上述的主动攻击、被动攻击和病毒袭击都会造成信息的破坏和泄密,我们以信息安全中的基础理论出

- 网站内容更新后百度排名下降怎么办?有效策略有哪些?

qiufeng_xinqing

SEO

转自网站内容更新后百度排名下降怎么办?有效策略有哪些?网站内容更新是促进网站优化的关键环节,但是频繁修改网站内容会对网站的搜索引擎排名造成很大的影响。为了保持网站排名,我们需要采取一些措施来最小化对百度排名的影响。网站内容更新后百度排名下降怎么办?有效策略有哪些?一:了解百度算法对网站内容修改的影响百度的搜索引擎算法将网站的历史数据纳入排名考量因素之一。频繁的修改网站内容会降低网站历史数据的稳定性

- python 商城 性能,python商城项目总结

Yvetzy

python商城性能

importhashlib#实例化md5对象md5=hashlib.md5()#md5.update()方法的参数必须是字节型数据md5.update(bytes(request.POST['password'],encoding="UTF-8"))#以16进制格式存储md5.hexdigest()'''这里有个坑必须注意:md5.update()方法会将每次加密的字符进行拼接,所以每次加密前都要

- 用Python写一个商城系统

潮水岩

如果要用Python写一个商城系统,可以先定义需要实现的功能,再按照功能模块分别进行开发。下面是一个简单的开发流程:数据模型设计:需要定义商品、订单、用户等数据模型,并且将它们存储在数据库中。用户模块:用户可以注册、登录、查看个人信息、修改密码等。商品模块:商家可以发布商品、管理商品信息、查看商品列表等;用户可以查看商品详情、加入购物车等。订单模块:用户可以下单、查看订单详情、取消订单、评价订单等

- python pandas 读取数据库_Python+Pandas 获取数据库并加入DataFrame的实例

weixin_39955149

pythonpandas读取数据库

Python+Pandas获取数据库并加入DataFrame的实例实例如下所示:importpandasaspdimportsysimportimpimp.reload(sys)fromsqlalchemyimportcreate_engineimportcx_Oracledb=cx_Oracle.connect('userid','password','10.10.1.10:1521/dbins

- python导出结果_Python连接Oracle数据查询导出结果

weixin_39712821

python导出结果

python连接oracle,需用用到模块cx_oracle,可以直接pip安装,如网络不好,可下载离线后本地安装本人由于工作需要,期望便捷查询所得结果,且固定输出某个格式具体代码如下:#!coding:utf-8importcx_Oracleconn=cx_Oracle.connect('username/password@IP/连接名')cur=conn.cursor()cur.execute

- Python—kafka操作

蓝魔Y

Python编程kafka

文档结构1、概念简介2、环境搭建3、操作实践1、概念简介2、环境搭建接口手册:https://kafka-python.readthedocs.io/en/master/Python操作kafka的模块为:kafka-python模块安装pipinstallkafka-python3、操作实践=============================================over====

- python使用kafka原理详解_Python操作Kafka原理及使用详解

形象顧問Aking

Python操作Kafka原理及使用详解一、什么是KafkaKafka是一个分布式流处理系统,流处理系统使它可以像消息队列一样publish或者subscribe消息,分布式提供了容错性,并发处理消息的机制二、Kafka的基本概念kafka运行在集群上,集群包含一个或多个服务器。kafka把消息存在topic中,每一条消息包含键值(key),值(value)和时间戳(timestamp)。kafk

- python把oracle的查询结果导出为insert语句

优游的鱼

oraclepython数据库开发语言

可以使用cx_Oracle库在Python中连接Oracle数据库并执行查询。然后,可以使用pandas库将查询结果读取为DataFrame,并使用to_sql()方法将其导出为insert语句。示例代码如下:importcx_Oracleimportpandasaspd#ConnecttoOracledatabaseconn=cx_Oracle.connect('username/passwor

- python画出roc曲线 auc计算逻辑_Python画ROC曲线和AUC值计算

路过炊烟

python画出roc曲线auc计算逻辑

前言ROC(ReceiverOperatingCharacteristic)曲线和AUC常被用来评价一个二值分类器(binaryclassifier)的优劣。这篇文章将先简单的介绍ROC和AUC,而后用实例演示如何python作出ROC曲线图以及计算AUC。AUC介绍AUC(AreaUnderCurve)是机器学习二分类模型中非常常用的评估指标,相比于F1-Score对项目的不平衡有更大的容忍性,

- 【spug】使用

勤不了一点

CI/CDpythondjangoci/cd运维devops

目录简介下载与安装初始化配置启动与日志版本更新登录与使用工作台主机管理批量执行配置中心应用发布系统管理监控与告警使用问题简介手动部署|Spugwalle的升级版本轻量级无Agent主机管理主机批量执行主机在线终端文件在线上传下载应用发布部署在线任务计划配置中心监控报警如果有测试错误请指出。下载与安装测试环境:Python3.7.8CentOSLinuxrelease7.4.1708(Core)sp

- 记一次从mysql数据迁移到oralce (基于python和pandas)

qq_36532060

mysqloraclepandaspython

记一次从mysql数据迁移到oralce(基于python)前景提要具体实现创建数据库链接读取mysql数据写入orcale结语前景提要公司最近有个从mysql迁移数据到oracle的需求,于是进行了一下方案调研和分析,但作为一个之前从没接触过Oracle的人真的感到好难,但再难也难上,这篇文章主要是记录一下做这件事时遇到的坑以及分享一下最终的方案及代码。具体实现创建数据库链接其实我觉得这个算是最

- python调用kafka

smile__su

pythonpythonkafka

先启动hadoop,zookeeper,kafka启动命令hadoop启动命令sbin/start-all.shzookeeper启动命令./bin/zkServer.shstart每台机器都要启动kafka启动命令bin/kafka-server-start.shconfig/server.properties每台机器都要启动进行以下操作的前提是将hadoop,zookeeper,kafka安装

- python实现从oracle数据库查询数据生成excel透视表发送outlook

niceme!

python

#-*-coding:utf-8-*-#http://pypi.cq.pegatroncorp.com/simple--trusted-hostpypi.cq.pegatroncorp.comimportchardetimportdatetimeimporttimeimportxlwtimportwin32com.clientaswin32fromwin32com.clientimportcons

- pip 与当前python环境版本不匹配,python安装库成功,还是提示没有该库

灿灿的金

pythonpip开发语言

解决pip版本不一致在使用pip命令前加上python-m即可让pip版本和当前python版本一致因此,当使用pip安装依赖时,需要在命令前添加python-m来配合使用,比如安装一个pillow库,命令如下python-mpipinstallpillow你同时安装了python2和python3pipinstallPillow可能下载的是python3的库,而你代码跑的是python2可以通过

- 【Python-ML】SKlearn库性能指标ROC-AUC

fjssharpsword

Bigdatapython专栏

#-*-coding:utf-8-*-'''Createdon2018年1月19日@author:Jason.F@summary:ROC(receiveroperatorcharacteristic,基于模型真正率和假正率等性能指标评估分类模型'''importpandasaspdfromsklearn.preprocessingimportLabelEncoderfromsklearn.cros

- 使用Python导出Oracle数据库数据表目录

SeanData

Python数据分析pythonoracle数据目录导出

###Oracle数据库数据表目录导出###导入包importpandasaspdimportcx_Oracle###数据库信息username='xxx'password='yyy'ipaddr='100.28.60.132'port='1521'service_name='service_name'connect_string=ipaddr+":"+port+"/"+service_name#

- 《Python入门+Python爬虫》——6Day 数据库可视化——Flask框架应用

不摆烂的小劉

pythonpythonflask爬虫

Python学习版本:Python3.X观看:Python入门+Python爬虫+Python数据分析1.Flask入门1.1关于Flask1.1.1了解框架Flask作为Web框架,它的作用主要是为了开发Web应用程序。那么我们首先来了解下Web应用程序。Web应用程序(WorldWideWeb)诞生最初的目的,是为了利用互联网交流工作文档。一切从客户端发起请求开始。所有Flask程序都必须创建

- 【python 机器学习】sklearn ROC曲线与AUC指标

人才程序员

杂谈机器学习pythonsklearn人工智能深度学习神经网络目标检测

文章目录sklearnROC曲线与AUC指标1.什么是ROC曲线与AUC?通俗介绍:学术解释:2.在`sklearn`中绘制ROC曲线与计算AUC2.1导入库和数据2.2加载数据集2.3训练模型2.4预测概率2.5计算FPR、TPR和AUC2.6绘制ROC曲线3.解析ROC曲线和AUC值4.总结sklearnROC曲线与AUC指标在机器学习中,评估分类模型的性能不仅仅依赖于准确率,还需要使用一些更

- python操作kafka

您懂我意思吧

python开发kafka分布式python

一、参考阿里云的官方链接:使用PythonSDK接入Kafka收发消息_云消息队列Kafka版(Kafka)-阿里云帮助中心二、安装python环境三、添加python依赖库pipinstallconfluent-kafka==1.9.2四、新建一个setting.py文件配置信息kafka_setting={'sasl_plain_username':'XXX',#如果是默认接入点实例,请删除该

- ASM系列四 利用Method 组件动态注入方法逻辑

lijingyao8206

字节码技术jvmAOP动态代理ASM

这篇继续结合例子来深入了解下Method组件动态变更方法字节码的实现。通过前面一篇,知道ClassVisitor 的visitMethod()方法可以返回一个MethodVisitor的实例。那么我们也基本可以知道,同ClassVisitor改变类成员一样,MethodVIsistor如果需要改变方法成员,注入逻辑,也可以

- java编程思想 --内部类

百合不是茶

java内部类匿名内部类

内部类;了解外部类 并能与之通信 内部类写出来的代码更加整洁与优雅

1,内部类的创建 内部类是创建在类中的

package com.wj.InsideClass;

/*

* 内部类的创建

*/

public class CreateInsideClass {

public CreateInsideClass(

- web.xml报错

crabdave

web.xml

web.xml报错

The content of element type "web-app" must match "(icon?,display-

name?,description?,distributable?,context-param*,filter*,filter-mapping*,listener*,servlet*,s

- 泛型类的自定义

麦田的设计者

javaandroid泛型

为什么要定义泛型类,当类中要操作的引用数据类型不确定的时候。

采用泛型类,完成扩展。

例如有一个学生类

Student{

Student(){

System.out.println("I'm a student.....");

}

}

有一个老师类

- CSS清除浮动的4中方法

IT独行者

JavaScriptUIcss

清除浮动这个问题,做前端的应该再熟悉不过了,咱是个新人,所以还是记个笔记,做个积累,努力学习向大神靠近。CSS清除浮动的方法网上一搜,大概有N多种,用过几种,说下个人感受。

1、结尾处加空div标签 clear:both 1 2 3 4

.div

1

{

background

:

#000080

;

border

:

1px

s

- Cygwin使用windows的jdk 配置方法

_wy_

jdkwindowscygwin

1.[vim /etc/profile]

JAVA_HOME="/cgydrive/d/Java/jdk1.6.0_43" (windows下jdk路径为D:\Java\jdk1.6.0_43)

PATH="$JAVA_HOME/bin:${PATH}"

CLAS

- linux下安装maven

无量

mavenlinux安装

Linux下安装maven(转) 1.首先到Maven官网

下载安装文件,目前最新版本为3.0.3,下载文件为

apache-maven-3.0.3-bin.tar.gz,下载可以使用wget命令;

2.进入下载文件夹,找到下载的文件,运行如下命令解压

tar -xvf apache-maven-2.2.1-bin.tar.gz

解压后的文件夹

- tomcat的https 配置,syslog-ng配置

aichenglong

tomcathttp跳转到httpssyslong-ng配置syslog配置

1) tomcat配置https,以及http自动跳转到https的配置

1)TOMCAT_HOME目录下生成密钥(keytool是jdk中的命令)

keytool -genkey -alias tomcat -keyalg RSA -keypass changeit -storepass changeit

- 关于领号活动总结

alafqq

活动

关于某彩票活动的总结

具体需求,每个用户进活动页面,领取一个号码,1000中的一个;

活动要求

1,随机性,一定要有随机性;

2,最少中奖概率,如果注数为3200注,则最多中4注

3,效率问题,(不能每个人来都产生一个随机数,这样效率不高);

4,支持断电(仍然从下一个开始),重启服务;(存数据库有点大材小用,因此不能存放在数据库)

解决方案

1,事先产生随机数1000个,并打

- java数据结构 冒泡排序的遍历与排序

百合不是茶

java

java的冒泡排序是一种简单的排序规则

冒泡排序的原理:

比较两个相邻的数,首先将最大的排在第一个,第二次比较第二个 ,此后一样;

针对所有的元素重复以上的步骤,除了最后一个

例题;将int array[]

- JS检查输入框输入的是否是数字的一种校验方法

bijian1013

js

如下是JS检查输入框输入的是否是数字的一种校验方法:

<form method=post target="_blank">

数字:<input type="text" name=num onkeypress="checkNum(this.form)"><br>

</form>

- Test注解的两个属性:expected和timeout

bijian1013

javaJUnitexpectedtimeout

JUnit4:Test文档中的解释:

The Test annotation supports two optional parameters.

The first, expected, declares that a test method should throw an exception.

If it doesn't throw an exception or if it

- [Gson二]继承关系的POJO的反序列化

bit1129

POJO

父类

package inheritance.test2;

import java.util.Map;

public class Model {

private String field1;

private String field2;

private Map<String, String> infoMap

- 【Spark八十四】Spark零碎知识点记录

bit1129

spark

1. ShuffleMapTask的shuffle数据在什么地方记录到MapOutputTracker中的

ShuffleMapTask的runTask方法负责写数据到shuffle map文件中。当任务执行完成成功,DAGScheduler会收到通知,在DAGScheduler的handleTaskCompletion方法中完成记录到MapOutputTracker中

- WAS各种脚本作用大全

ronin47

WAS 脚本

http://www.ibm.com/developerworks/cn/websphere/library/samples/SampleScripts.html

无意中,在WAS官网上发现的各种脚本作用,感觉很有作用,先与各位分享一下

获取下载

这些示例 jacl 和 Jython 脚本可用于在 WebSphere Application Server 的不同版本中自

- java-12.求 1+2+3+..n不能使用乘除法、 for 、 while 、 if 、 else 、 switch 、 case 等关键字以及条件判断语句

bylijinnan

switch

借鉴网上的思路,用java实现:

public class NoIfWhile {

/**

* @param args

*

* find x=1+2+3+....n

*/

public static void main(String[] args) {

int n=10;

int re=find(n);

System.o

- Netty源码学习-ObjectEncoder和ObjectDecoder

bylijinnan

javanetty

Netty中传递对象的思路很直观:

Netty中数据的传递是基于ChannelBuffer(也就是byte[]);

那把对象序列化为字节流,就可以在Netty中传递对象了

相应的从ChannelBuffer恢复对象,就是反序列化的过程

Netty已经封装好ObjectEncoder和ObjectDecoder

先看ObjectEncoder

ObjectEncoder是往外发送

- spring 定时任务中cronExpression表达式含义

chicony

cronExpression

一个cron表达式有6个必选的元素和一个可选的元素,各个元素之间是以空格分隔的,从左至右,这些元素的含义如下表所示:

代表含义 是否必须 允许的取值范围 &nb

- Nutz配置Jndi

ctrain

JNDI

1、使用JNDI获取指定资源:

var ioc = {

dao : {

type :"org.nutz.dao.impl.NutDao",

args : [ {jndi :"jdbc/dataSource"} ]

}

}

以上方法,仅需要在容器中配置好数据源,注入到NutDao即可.

- 解决 /bin/sh^M: bad interpreter: No such file or directory

daizj

shell

在Linux中执行.sh脚本,异常/bin/sh^M: bad interpreter: No such file or directory。

分析:这是不同系统编码格式引起的:在windows系统中编辑的.sh文件可能有不可见字符,所以在Linux系统下执行会报以上异常信息。

解决:

1)在windows下转换:

利用一些编辑器如UltraEdit或EditPlus等工具

- [转]for 循环为何可恨?

dcj3sjt126com

程序员读书

Java的闭包(Closure)特征最近成为了一个热门话题。 一些精英正在起草一份议案,要在Java将来的版本中加入闭包特征。 然而,提议中的闭包语法以及语言上的这种扩充受到了众多Java程序员的猛烈抨击。

不久前,出版过数十本编程书籍的大作家Elliotte Rusty Harold发表了对Java中闭包的价值的质疑。 尤其是他问道“for 循环为何可恨?”[http://ju

- Android实用小技巧

dcj3sjt126com

android

1、去掉所有Activity界面的标题栏

修改AndroidManifest.xml 在application 标签中添加android:theme="@android:style/Theme.NoTitleBar"

2、去掉所有Activity界面的TitleBar 和StatusBar

修改AndroidManifes

- Oracle 复习笔记之序列

eksliang

Oracle 序列sequenceOracle sequence

转载请出自出处:http://eksliang.iteye.com/blog/2098859

1.序列的作用

序列是用于生成唯一、连续序号的对象

一般用序列来充当数据库表的主键值

2.创建序列语法如下:

create sequence s_emp

start with 1 --开始值

increment by 1 --増长值

maxval

- 有“品”的程序员

gongmeitao

工作

完美程序员的10种品质

完美程序员的每种品质都有一个范围,这个范围取决于具体的问题和背景。没有能解决所有问题的

完美程序员(至少在我们这个星球上),并且对于特定问题,完美程序员应该具有以下品质:

1. 才智非凡- 能够理解问题、能够用清晰可读的代码翻译并表达想法、善于分析并且逻辑思维能力强

(范围:用简单方式解决复杂问题)

- 使用KeleyiSQLHelper类进行分页查询

hvt

sql.netC#asp.nethovertree

本文适用于sql server单主键表或者视图进行分页查询,支持多字段排序。KeleyiSQLHelper类的最新代码请到http://hovertree.codeplex.com/SourceControl/latest下载整个解决方案源代码查看。或者直接在线查看类的代码:http://hovertree.codeplex.com/SourceControl/latest#HoverTree.D

- SVG 教程 (三)圆形,椭圆,直线

天梯梦

svg

SVG <circle> SVG 圆形 - <circle>

<circle> 标签可用来创建一个圆:

下面是SVG代码:

<svg xmlns="http://www.w3.org/2000/svg" version="1.1">

<circle cx="100" c

- 链表栈

luyulong

java数据结构

public class Node {

private Object object;

private Node next;

public Node() {

this.next = null;

this.object = null;

}

public Object getObject() {

return object;

}

public

- 基础数据结构和算法十:2-3 search tree

sunwinner

Algorithm2-3 search tree

Binary search tree works well for a wide variety of applications, but they have poor worst-case performance. Now we introduce a type of binary search tree where costs are guaranteed to be loga

- spring配置定时任务

stunizhengjia

springtimer

最近因工作的需要,用到了spring的定时任务的功能,觉得spring还是很智能化的,只需要配置一下配置文件就可以了,在此记录一下,以便以后用到:

//------------------------定时任务调用的方法------------------------------

/**

* 存储过程定时器

*/

publi

- ITeye 8月技术图书有奖试读获奖名单公布

ITeye管理员

活动

ITeye携手博文视点举办的8月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。

8月试读活动回顾:

http://webmaster.iteye.com/blog/2102830

本次技术图书试读活动的优秀奖获奖名单及相应作品如下(优秀文章有很多,但名额有限,没获奖并不代表不优秀):

《跨终端Web》

gleams:http

![]()

![]()

![]()