同样是做大模型的科技公司,为啥差距这么大呢?

2022年OpenAI亏了30多亿元,

站在风口上,谁的压力会小呢?

【科技明说 | 每日看点】站在风口上。OpenAI公司在2022年亏得十分“灿烂”,和往年同比几乎翻了一倍,亏损约达5.4亿美元,折合人民币约31亿元。

就算是这样翻倍地亏损,OpenAI也没有商汤科技SenseTime表现强烈,商汤科技财报显示2022年亏损约61亿元左右。

比烧钱速度,更要比创新速度

如果非得再对比一下年营收,商汤科技可谓赢得太漂亮了,OpenAI的2022年营收才多少钱?商汤科技2022年营收高达38亿元,令OpenAI的老板们羡慕嫉妒恨了么?OpenAI虽然估值接近300亿美元,约超2000亿元人民币,但2022年营收却少得可怜,约3600万美元,约合人民币2.5亿元,2023年预估能到2亿美元,也就是约合人民币不到14亿元。

然而,亏了30多亿元的OpenAI,引领着全球ChatGPT的AI大潮;亏了61亿元的商汤科技,带来了大家意想不到的“商量 SenseChat、秒画 SenseMirage、如影 SenseAvatar、琼宇 SenseSpace、格物 SenseThings,以及日日新SenseNova。

其名字确实非常亮眼,达到行业国际水平的同时,有一种赶超OpenAI,将ChatGPT踩在脚下磨擦的气势。但能否引领全球AI趋势却是一个大问题,不过,有着这样丰富的大模型产品方向,我想商汤科技至少在中国应是AI行业领先水平了吧?

业内传说商汤科技拥有有2.7万张AI专用GPU。目前7000张GPU对外服务8家大型客户,实现算力Infrastructure as a Service。其自然语言大模型Sense Chat已经可以实现基本的语言交互、写故事、法律专业领域的文本分析、代码编程、医疗问诊。当然商汤科技不能算是一个公有云厂商,但已经在着手提供类似云服务的算力与GPT输出了。

我不禁想问一下:同样是做大模型AI领域的科技公司,为啥差距这么大呢?

我只能这么说,大型人工智能(AI)语言模型是一项昂贵的业务,但贵有贵的道理,花了高价钱可以看到真正的技术引领,真金白银换创新也是值得的。

然而更悲催的是,业界传言说OpenAI虽然牛气冲天,实际上是靠挖了一些谷歌、苹果等科技公司AI领域的高手过来做ChatGPT。挖人成本高,所以亏损大。这个逻辑我感觉不对,靠挖人可以做到世界第一,我觉得是非常成功的了。就算亏得一塌糊涂也是可以看到未来的,毕竟微软也不断在给OpenAI输血,据说累计投资OpenAI已经高达130亿美元了,这个投资节奏可能不会变化,还会继续高投入,抢未来。

即便OpenAI烧钱速度快,但其GPT迭代速度也是惊人的,在GPT-4出来后不久,就已经开启了开源战略。可以想象一下,未来的AI世界除了OpenAI,还会有谁呢?有谁还可以如OpenAI这样吸金,这样烧钱,这样高速创新GPT呢?

你觉得还会有谁,请空了告诉我一下。谢谢。

字节跳动悄然在GPT上“练舞”

不过我们再看看另外一个科技公司:字节跳动ByteDance有啥GPT“动作”。

业内也盛传字节跳动在大模型上也在低调潜行,并且在2022年底专门组建了一个针对GPT模型研究的团队,主要研究人员也是来自字节跳动的搜索业务部门、AI Lab和AML(应用机器学习)等团队成员。在多模态场景下,字节跳动在视频、图片、语音等数据比较丰富,训练起来还是非常有基础。基于技术研究的成熟度,字节跳动对外透露的消息称,前期主要针对在语言和图像两种模态发力,后期针对视频方面的研究也将是一个重要的目标。

只是,字节跳动还有一条重要的发展路线就是火山引擎。2023年4月18日,火山引擎正式推出自研DPU等系列云产品,并推出新版机器学习平台:支持万卡级大模型训练、微秒级延迟网络,弹性计算可节省70%算力成本。有着更丰富与更强大性能的自研DPU的GPU实例,对于后期在GPT领域的自研与探索将带来很好的基础支持,当然火山引擎云也是字节跳动对外输出AI能力的重要途径之一。

业内朋友评论说到,要做大模型,必须“背靠大数”(也是大树)才可以。比如OpenAI背后的微软,可以百亿美元地投入眼睛都不眨一下。字节跳动不仅有海量数据的“大数”,也有庞大的技术团队“大树”。

没有对比就没有鉴别。就此来看看,字节跳动的发展非常迅速,在2022年,字节跳动跻身“年营收5000亿元俱乐部”,开始看齐三巨头,京东、阿里巴巴和腾讯。

5000亿元年营收,意味着什么呢?

纵观2022年全年,年营收5000亿元俱乐部的中国科技公司主要有,京东、阿里巴巴、腾讯和字节跳动。

京东集团2022年全年净收入10462亿元人民币(约1517亿美元),同比增长9.9%。归属于普通股股东的净利润为104亿元,2021年为134亿元,同比下降22%。

阿里巴巴2022年自然年营收为8645.39亿元,因为财年与自然年出入比较大,这里仅作营收的自然年统计。对于净利润而言,业内有数字在说息税折旧及摊销前利润 (EBITDA)约为227亿美元,但这个数字未得到正确途径证实。

腾讯控股2022年营收5545.5亿元(约796亿美元),同比下滑1%;归属于普通股股东全年净利润1882.4亿元,同比下滑16%,

字节跳动2022年收入超800亿美元,折合人民币超5000亿元。这比2021年的约600亿美元增长了30%以上。由此字节跳动也正式入围“年营收5000亿元俱乐部”。同时业内有传言说,2022年字节跳动息税折旧及摊销前利润 (EBITDA)约为250亿美元(1718亿元),同比增长79%。 如果这个数据是真实的话,对比阿里巴巴、京东、腾讯而言,在净利润表现上字节跳动稳赢了。

据业内分析,字节跳动的收入增长贡献最大的来源于在中国大陆的核心广告业务,2022这部分业务带来的收入与2021年同比增长了2.5倍,达到100亿美元左右。

除此之外,BAT中的百度2022年实现营收1236.75亿元,归属百度的净利润(非美国通用会计准则)206.8亿元,同比增长10%。假如只是从年营收来看,百度距离京东、阿里巴巴、腾讯和字节跳动的距离还不小。

当然,5000元年营收,意味着进入这个阶段的科技企业拥有更为全面的市场竞争力与影响力,大者恒大的效应也将放大。

假如这个分析正确的话,那么小者会不会恒小呢?还是说小者求大?

对于大模型的研究投入,前卫的OpenAI亏得吓人,火力全开的商汤科技亏得也厉害。相对而言,字节跳动植根自己的数据基础与研发队伍,一步一步地尝试,身体力行,从大模型软件与DPU、GPU云产品双管齐下,积极进取不冒进的这个思路值得一看。

公有云厂商的ChatGPT之变

大模型如此这般火热,也引发了业界正在热议的另外一个话题:ChatGPT发展大放异彩,公有云格局会不会大变?

首先得明确,AI风暴来袭,云与ChatGPT到底啥关系?

在看到公有云厂商纷纷开始大模型发布,开始GPT的融入之时,我是在想AI风暴来袭,在担心AI带给人类危险的同时,更想知道公有云与ChatGPT到底关系如何?

业内有朋友说,公有云可能会吃掉ChatGPT,要不然就是ChatGPT会吃掉公有云。

也有业内朋友指出,这最终云厂商卖的还是算力,核心还是GPU。

这么说还是商汤最牛了,业内朋友传说商汤科技至少手里握了上万张英伟达的卡。有卡的不一定牛逼,可能是最大的韭菜。会卖韭菜也是能力,就看商汤科技的AI创新能力到底如何了。还有卖给谁很重要,像我这样的人,肯定不喜欢吃韭菜。但不少人还是喜欢韭菜盒子,韭菜鸡蛋饺子。罗卜白菜各有所爱,就看谁喜欢了吧?

但在算力上叠加GPT和模型,价值还是可以挖,只是我感觉很难。云厂商做通用GPT,搭上行业模型,还是有机会。只是比较难做,因为做行业模型就必须另外找团队,需要投资更多钱,现在云厂商盈利都难,这个事情很矛盾。

如果这个事情可以做通,再扩展一下,专门提供有行业属性GPT+行业模型的行业云打包卖。

现在,在ChatGPT与公有云结合上,公有云厂商怎么接招?拆招?

看看亚马逊云科技AWS是这样做的,宣布Amazon EC2 Trn1n 和 Amazon EC2 Inf2实例正式可用:最具成本效益的生成式AI云基础设施,与此同时AWS亚马逊云科技顺应潮流也推出了自己的大模型,Amazon Titan基础模型目前包括了两个全新的大语言模型。

再看看阿里云是这样做的,随着通义千问的大模型发布,阿里巴巴集团董事会主席兼CEO、阿里云智能集团CEO张勇在阿里云北京峰会上强调说,阿里所有产品未来将接入大模型全面升级。

再看看腾讯云在阿里云发布通义千问的大模型之后发布的新一代HCC高性能计算集群,采用最新一代星星海自研服务器,搭载NVIDIA H800 Tensor Core GPU。基于自研网络、存储架构,带来3.2T超高互联带宽,TB级吞吐能力和千万级IOPS。

腾讯云给出的实测结果显示,新一代集群算力性能较前代提升3倍。而在2022年10月,腾讯完成首个万亿参数的AI大模型——混元NLP大模型训练。在同等数据集下,将训练时间由50天缩短到11天。如果基于新一代集群,训练时间将进一步缩短至4天。目前针对新一代HCC高性能计算集群,用户需要通过腾讯云的官方通道申请参与内测,什么时候公开GA值得关注一下。

百度算是国内发布大模型很早的科技公司了,文言一心并没有为百度带来意想不到的收获,相反,更多的是迈向ChatGPT领域的教训与经验。当然,至少对百度的中文搜索引擎带来更贴身用户的搜索结果,不过,很遗憾的是不少像我这样的百度用户却对搜索结果中包含众多软性广告感到十分麻烦。

虽然华为的大模型并没有像百度的文言一心那样高调发布,但华为大模型发布比百度还要早,2021年就公开了,从时间上来看华为领先了许多。盘古大模型由NLP大模型、CV大模型、多模态大模型、科学计算大模型等多个大模型构成,这样看来华为做事情还是讲究专业,专业的事情做起来对旁观者而言就显得复杂。

另外,在ChatGPT与公有云结合路线上,业界大牛还是微软莫属,微软投巨资支持的OpenAI公司在2023年4月推出了GPT-4,开始真正成就了一个大型多模态模型,能接受图像和文本输入,再输出正确的文本回复。实验表明,GPT-4 在各种专业测试和学术基准上的表现与人类水平相当。例如,它通过了模拟律师考试,且分数在应试者的前10%左右;相比之下,GPT-3.5的得分在倒数10%左右。

在过去的两年里,OpenAI重建了整个深度学习堆栈,并与微软Azure一起为ChatGPT工作负载从头开始设计了一台超级计算机。这台超级计算机基于微软的Azure云基础设施,使用了上万颗Nvidia H100和A100Tensor Core GPU,同时采用了Quantum-2 InfiniBand高速网络架构。不仅如此,微软还将ChatGPT的能力全面加持在了全球著名的办公软件、搜索引擎bing等产品领域,微软已经走上了全面ChatGPT化。

不过就此分析,在GPT不断融入公有云的进程上,公有云厂商的业务本质依然不变,还是卖资源。也有人对我问道,ChatGPT不断融入云上,云服务会越来越便宜么?我认为不会,而是越来越实惠。对于用户来说,云带来的只是实惠,而不是便宜。因为只有重度的公有云长期用户就深有体会,公有云到底是便宜还是昂贵。

正因为如此,业内有朋友一直认为,ChatGPT与公有云没有关系,一是一二是二,如果1+2可以结合的话,依然还是等于1+2而不是新的数字3。

由此分析来看,公有云想方设法将ChatGPT融入云服务之中,最终目的还是希望带动云资源的销售增长,更进一步让云的用户成其为云的深度使用者。从这个角度来分析,公有云因ChatGPT而变化并非真正实现迭代的进化,加持AI能力并不能代表公有云主流业务的本质改变。

进一步分析来看,对于用户而言,将会更容易深度绑定在公有云之上,一旦业务发展变化需要下云落地之时,用户需要付出的代价将会更高。当然,对于自身业务必须架构在公有云之上的用户而言,这样“云+GPT”的变化不存在这个方面的下云落地问题,反而更有利于其业务加速创新。

此外,对于开发者,利用AI平台的便利性确实可以带来很多帮助,节省开发流程的时间。亚马逊云科技推了CodeWHisperer,这么好的AI编程工具,全开源全免费,可谓程序员的最佳日常伴侣,人见人爱花见花开……如果1000人采用无所谓改变啥,试想1000万人使用了,将会怎样?

科学客观认知GPT发展之势

值得一提的是,最近埃森哲(Accenture)的研究指出,在现实世界和数字世界越来越密不可分的今天,生成式人工智能等技术的迅速演进正在创造更为广阔的全新商业未来。随着ChatGPT的快速兴起,生成式人工智能展现了其显著增强人类能力的本领,成为了全球焦点。

据埃森哲测算,在各行业,有四成的工作时间可由基于语言的人工智能技术提供支持或得到增值。全球的受访企业高管几乎一致(98%)认为,未来三至五年内,人工智能基础模型会对企业组织战略产生极为关键的影响。

同时,埃森哲《技术展望2023》揭示了四大趋势,帮助企业开启数实融合的新发展历程,即:通用智能、数字身份、数据透明和前沿探索。其中针对通用智能,无论是担任个人助手、创意搭档或者专业顾问,生成式人工智能将不断提升人类能力。几乎所有受访高管都认为,这类工具可以激发出巨大的创造力和创新力(比例达98%),开启企业级智能的新时代(95%)。

由这个研究可以看到,ChatGPT虽然不能彻底革新公有云的主流业务,但改善改进增加云服务的本身的价值还是很值得发展。

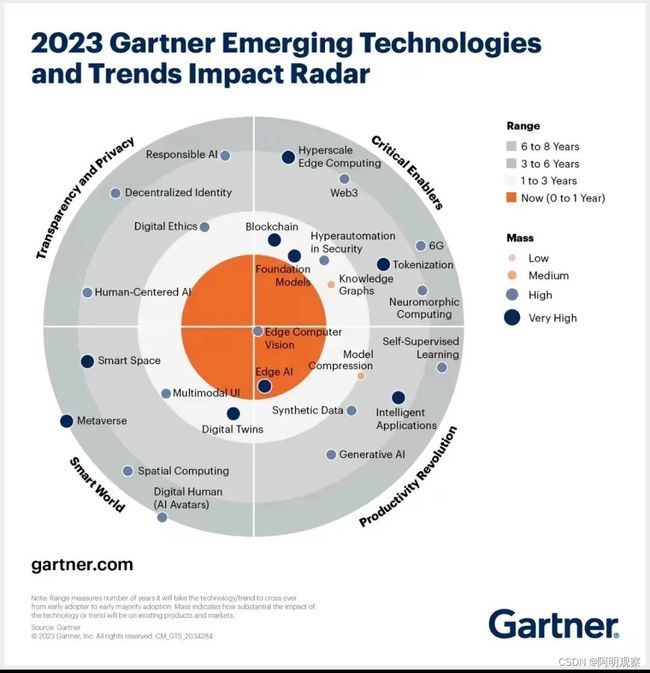

在Gartner的一份报告《2023 Gartner Emerging Technologies and Trends Impact Radar》新兴技术及趋势影响雷达中提到26项最具影响力的新兴技术和趋势可以看到,边缘AI、基础模型Foundation Models、Model Compression的发展将会更为迅猛,特别是模型压缩(model compression)可以将大模型压缩成小模型,压缩后的小模型也能得到和大模型接近的性能,这对于ChatGPT进入垂直行业领域带来更大可能。

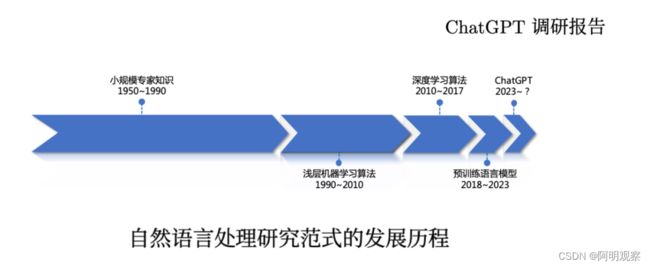

然后,我还在哈工大自然语言处理研究所(HIT-NLP)出品的《ChatGPT调研报告》,是现在为止我看到的对ChatGPT比较全面分析了。其中分析指出,从自然语言处理技术发展阶段的角度看,可以发现一个有趣的现象,即每一个技术阶段的发展时间,大概是上一个阶段的一半。小规模专家知识发展了40年,浅层机器学习是20年,之后深度学习大概10年,预训练语言模型发展的时间是5年,那么以ChatGPT为代表的技术能持续多久呢?如果大胆预测,可能是2到3年,也就是到2025年大概又要更新换代了。

经过近70年的发展,自然语言处理技术先后经历了五次范式的变迁,随着ChatGPT的产生,人们也看到了实现通用人工智能(AGI)的曙光。在这个过程中,自然语言处理技术呈现了明显的“同质化”和“规模化”的发展趋势,使用参数量越来越大的模型,从越来越多的文本数据中进行学习。同时分析指出,自然语言处理未来需要融入更多的多模态信息。此外,还需要智能体能够同物理世界以及人类社会进行交互,这样才能真正理解现世界中的各种概念,从而实现真正的通用人工智能。

对于哈工大自然语言处理研究所(HIT-NLP)出品的《ChatGPT调研报告》有兴趣的朋友,可以私信留言加阿明好友,阿明可以看情况私下分享业内学习参考。

不过,现在在AI与大模型领域逐渐呈现出百花齐放的态势。来自新浪数科COO于冬琪的几段观点在朋友圈传播,他个人最喜欢这么几个项目:如改善盲人读屏效率和为盲人用户读出图片上信息。帮助农民找到地里的冬虫夏草,提高挖掘效率。AI诊断皮肤问题。AI帮律师们快速整理法条、给出建议。 帮助刑警们基于目击者描述,绘制出嫌疑人画像。帮助医生们,把语音自动录入成病例。

他没想到的是,现在有很多团队有自研的技术和论文。甚至于有人做出来了可部署在个人电脑上、基于本地数据的丐版大模型。

综合来看,AI风暴来袭,公有云与ChatGPT关系越来越亲密,也越来越复杂。到底该如何去发展,不管是微软还是亚马逊还是阿里云还是其他公有云厂商,都在摸着石头过河,就看谁更会探索,更会迅速了吧。

未雨绸缪,如何看AI威胁论?

再进一步看看针对AI的法律监管领域。不少国家开始出台法律法规监管AI,随着GPT发展越来越快,相关监管规定也将加速出台。

当然,从通用大模型走向行业大模型,行业数据安全监管也是需要重视。

对此,我们又不得不再讨论一下AI的人类威胁论。

至少当前要思考对AI能力边界做一些框架限定,并有利于社会进步与人类社会的发展。据外媒消息说,马斯克(Elon Musk)、苹果联合创始人沃兹尼亚克(Steve Wozniak)等1000多名科技研究人员和高管呼吁“暂停”OpenAI的GPT等先进人工智能系统的训练6个月,用来开发和实施一套协议,使这些强大的人工智能系统更加准确、透明和值得信赖。

可能,这又是一次人类的觉醒,幸好马斯克们在AI道路上没有完全痴迷不悟! 然后,也有非营利活动组织Future of Life Institute发表了一封公开信,在发表后几小时,已有来自学术界和科技行业的1100多人签名。所有签名的人都十分担心,AI系统的智能可以与人类相媲美,可能对社会和人类构成严重威胁。

全球存储观察的阿明对此表示,“百年后,我们的子孙后代看到现在我们,他们会怎样想现在的AI疯狂?”

另有业内人士分析指出,国内现在还不用太担心这个方面的问题,因为像国内顶级“ChatGPT”啥时候和GPT-4一样聪明了再说吧。

- END-

你

怎

么

看

?

欢迎文末评论补充!

【全球存储观察 | 全球云观察 | 阿明观察 |科技明说】专注科技公司分析,用数据说话,带你看懂科技。本文和作者回复仅代表个人观点,不构成任何投资建议。