LVS负载均衡群集——NAT模式

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

- 一、群集概述

-

- 1.1 群集的含义

- 1.2 使用群集的原因

- 1.3 群集的目的

- 二、企业群集分类

-

- 2.1 负载均衡群集(Load Balance Cluster)

- 2.2 高可用群集(High Availability Cluster)

- 2.3 高性能运算群集(High Performance Computer Cluster)

- 三、负载均衡群集

-

- 3.1 负载均衡群集架构

- 3.2 负载均衡群集的工作模式

-

- 3.2.1 NAT模式(地址转换)

- 3.2.2 TUN模式(IP隧道)

- 3.2.3 DR模式(直接路由)

- 四、LVS虚拟服务器

-

- 4.1 LVS虚拟服务器简介

- 4.2 LVS相关术语

- 4.3 LVS的负载调度算法

- 4.3 加载 ip_vs 通用模块

- 4.4 加载 LVS 所有的负载调度算法

- 五、ipvsadm工具

- 六、LVS-NAT模式操作实例

- 总结

一、群集概述

1.1 群集的含义

Cluster,集群、群集

由多台主机构成,但对外只表现为一一个整体,只提供一-个访问入口(域名或IP地址), 相当于一台大型计算机。

1.2 使用群集的原因

问题:

互联网应用中,随着站点对硬件性能、响应速度、服务稳定性、数据可靠性等要求越来越高,单台服务器已经无法满足负载均衡及高可用的要求。

解决方法:

使用价格昂贵的小型机、大型机。(纵向扩容)

使用多台相对廉价的普通服务器构建服务群集。(横向扩容)

LVS群集技术:

在企业中常用的一种群集技术一LVS (Linux Virtual Server, Linux虚拟服务器)

通过整合多台服务器,使用LVS来达到服务器的高可用和负载均衡,并以同一个IP地址对外提供相同的服务。

1.3 群集的目的

提高性能:计算密集应用。如天气预报,核试验模拟。

降低成本:相对百万美元的超级计算机,价格便宜。

提高可扩展性:只要增加集群节点即可。

增强可靠性:多个节点完成相同功能,避免单点失败。

二、企业群集分类

根据群集所针对的目标差异,可分为三种类型:

负载均衡群集

高可用群集

高性能运算群集

2.1 负载均衡群集(Load Balance Cluster)

提高应用系统的响应能力、尽可能处理更多的访问请求、减少延迟为目标,获得高并发、负载(LB)的整体性能;

LB的负载分配依赖于主节点的分流算法,将来自客户机的访问请求分担给多个服务器节点,从而缓解整个系统的负载压力。例如,“DNS轮询”、“反向代理” 等。

2.2 高可用群集(High Availability Cluster)

提高应用系统的可靠性、尽可能地减少中断时间为目标,确保服务的连续性,达到高可用(HA) 的容错效果。

HA的工作方式包括双工和主从两种模式,双工即所有节点同时在线;主从则只有主节点在线,但当出现故障时从节点能自动切换为主节点。例如,“故障切换” 、“双机热备” 等。

2.3 高性能运算群集(High Performance Computer Cluster)

以提高应用系统的CPU运算速度、扩展硬件资源和分析能力为目标,获得相当于大型、超级计算机的高性能运算(HPC)能力。

高性能依赖于"分布式运算”、 “并行计算”,通过专用硬件和软件将多个服务器的CPU、内存等资源整合在一起,实现只有大型、超级计算机才具备的计算能力。例如,'云计算”、 “网格计算”等。

三、负载均衡群集

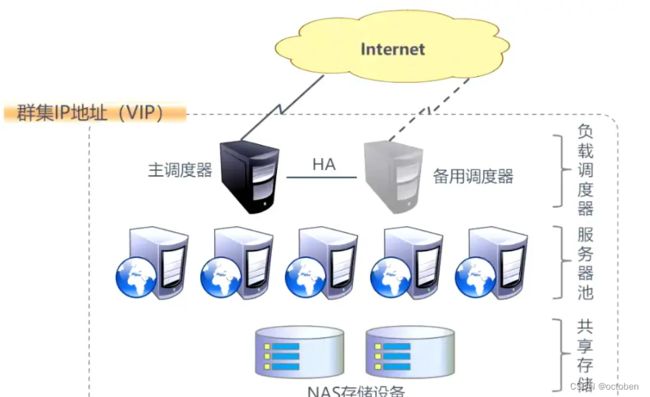

3.1 负载均衡群集架构

第一层,负载调度器(Load Balancer或Director) 负载均衡层

访问整个群集系统的唯一入口,对外使用所有服务器共有的VIP地址,也称为群集 IP地址。通常会配置主、备两台调度器实现热备份,当主调度器失效以后能够平滑 替换至备用调度器,确保高可用性。

第二层,服务器池(Server Pool) WEB应用层

群集所提供的应用服务、由服务器池承担,其中每个节点具有独立的RIP地址(真 实IP),只处理调度器分发过来的客户机请求。当某个节点暂时失效时,负载调度 器的容错机制会将其隔离,等待错误排除以后再重新纳入服务器池。

第三层,共享存储(Share Storage) 确保多台服务器使用的是相同的资源

为服务器池中的所有节点提供稳定、一致的文件存取服务,确保整个群集的统一性 共享存储可以使用NAS设备,或者提供NFS共享服务的专用服务器。

(因为节点服务器的资源都是由NAS或NFS提供,所以NAS或NFS需要做主备、或分布式,从而实现高可用。)

3.2 负载均衡群集的工作模式

负载均衡群集是目前企业用得最多的群集类型。

群集的负载调度技术有三种工作模式:

1、地址转换(NAT模式)

2、IP隧道(IP-TUN)

3、直接路由(DR模式)

通常使用 NAT和DR,使用最多的是DR模式。

3.2.1 NAT模式(地址转换)

地址转换

Network Address Translation,简称NAT模式

类似于防火墙的私有网络结构,负载调度器作为所有服务器节点的网关,即作为客户机 的访问入口,也是各节点回应客户机的访问出口。

服务器节点使用私有IP地址,与负载调度器位于同一个物理网络,安全性要优于其他两 种方式。

缺点:由于NAT的负载均衡器既作为用户的访问请求入口,也作为节点服务器响应请求的出口,承载两个方向的压力,调度器的性能会成为整个集群的瓶颈。

3.2.2 TUN模式(IP隧道)

IP隧道:

IP Tunnel ,简称TUN模式。

采用开放式的网络结构,负载调度器仅作为客户机的访问入口,各节点通过各自的Internet连接直接回应客户机,而不再经过负载调度器。承载的压力比NAT小。

服务器节点分散在互联网中的不同位置,具有独立的公网IP地址,通过专用IP隧道与负载调度器相互通信。

缺点:成本很高。

这种模式一般应用于特殊场景,比如将节点服务器分布在全国各地,防止被物理攻击(如地震、战争等),做灾备。

3.2.3 DR模式(直接路由)

直接路由:

Direct Routing,简称DR模式。

采用半开放式的网络结构,与TUN模式的结构类似,负载调度器仅作为客户机的访问入口,各节点通过各自的Internet连接直接回应客户机,而不再经过负载调度器。承载的压力比NAT小。

但各节点并不是分散在各地,而是与调度器位于同一个物理网络。

负载调度器与各节点服务器通过本地网络连接,不需要建立专用的IP隧道。

四、LVS虚拟服务器

4.1 LVS虚拟服务器简介

Linux Virtual Server:

针对Linux内核开发的负载均衡

1998年5月,由我国的章文嵩博士创建

官方网站:www.linuxvirtualserver.org/

LVS实际上相当于基于IP地址的虚拟化应用,为基于IP地址和内容请求分发的负载均衡提出来一种高效的解决方法

4.2 LVS相关术语

DS:Director Server。指的是前端负载均衡器。

RS:Real Server。节点服务器,后端真实的工作服务器。

VIP:向外部直接面向用户请求,作为用户请求的目标的IP地址。

DIP:Director Server IP,主要用于和内部主机通讯的IP地址。

RIP:Real Server IP,后端服务器的IP地址。

CIP:Client IP,访问客户端的IP地址。

4.3 LVS的负载调度算法

***(1)固定调度算法:rr, wrr, dh,sh

rr:轮询算法(Round Robin)***

将请求依次分配给不同的RS节点,即RS节点中均摊分配。适合于RS所有节点处理性能接近的情况。

将收到的访问请求安装顺序轮流分配给群集指定各节点(真实服务器),均等地对待每一台服务器,而不管服务器实际的连接数和系统负载。

wrr:加权轮询调度(Weighted Round Robin)

依据不同RS的权重值分配任务。权重值较高的RS将优先获得任务,并且分配到的连接数将比权值低的RS更多。相同权值的RS得到相同数目的连接数。

保证性能强的服务器承担更多的访问流量。

dh:目的地址哈希调度(destination hashing)

以目的地址为关键字查找一个静态hash表来获得所需RS。

sh:源地址哈希调度(source hashing)

以源地址为关键字查找–个静态hash表来获得需要的RS。

(2)动态调度算法: wlc,lc,1blc

lc:最小连接数调度( Least Connections)

ipvs表存储了所有活动的连接。LB会比较将连接请求发送到当前连接最少的RS。

根据真实服务器已建立的连接数进行分配,将收到的访问请求优先分配给连接数最少的节点。

wlc:加权最小连接数调度(Weighted Least Connections)

假设各台RS的权值依次为Wi,当前tcp连接数依次为Ti,依次取Ti/Wi为最小的RS作为下一个分配的RS。

在服务器节点的性能差异较大时,可以为真实服务器自动调整权重。

性能较高的节点将承担更大比例的活动连接负载。

lblc:基于地址的最小连接数调度(locality-based least-connection)

将来自同一个目的地址的请求分配给同一-台RS,此时这台服务器是尚未满负荷的。否则就将这个请求分配给连接数最小的RS,并以它作为下一次分配的首先考虑。

4.3 加载 ip_vs 通用模块

LVS现在已成为 Linux 内核的一部分,默认编译为 ip_vs 模块,必要时能够自动调动。

在CentOS 7 系统中,手动加载 ip_vs 模块的命令如下:

modprobe ip_vs //手动加载 ip_vs 模块

cat /proc/net/ip_vs //查看当前系统中ip_vs模块的版本信息

4.4 加载 LVS 所有的负载调度算法

LVS 所有的负载调度算法文件在 /usr/lib/modules/3.10.0-693.el7.x86_64/kernel/net/netfilter/ipvs/ 目录下:

[root@guo ipvs]# pwd

/usr/lib/modules/3.10.0-693.el7.x86_64/kernel/net/netfilter/ipvs

[root@guo ipvs]# ls

ip_vs_dh.ko.xz ip_vs_lc.ko.xz ip_vs_sh.ko.xz

ip_vs_ftp.ko.xz ip_vs_nq.ko.xz ip_vs_wlc.ko.xz

ip_vs.ko.xz ip_vs_pe_sip.ko.xz ip_vs_wrr.ko.xz

ip_vs_lblc.ko.xz ip_vs_rr.ko.xz

ip_vs_lblcr.ko.xz ip_vs_sed.ko.xz

加载所有的负载调度算法:

[root@guo ipvs]# ls | grep -o "^[^.]*" //过滤出所有调度算法的名称

ip_vs_dh

ip_vs_ftp

ip_vs

ip_vs_lblc

ip_vs_lblcr

ip_vs_lc

ip_vs_nq

ip_vs_pe_sip

ip_vs_rr

ip_vs_sed

ip_vs_sh

ip_vs_wlc

ip_vs_wrr

[root@guo ipvs]# for i in $(ls /usr/lib/modules/$(uname -r)l/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modF filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

ip_vs_dh

ip_vs_ftp

ip_vs

ip_vs_lblc

ip_vs_lblcr

ip_vs_lc

ip_vs_nq

ip_vs_pe_sip

ip_vs_rr

ip_vs_sed

ip_vs_sh

ip_vs_wlc

ip_vs_wrr

可以将加载调度算法的命令写入脚本中:

#!/bin/bash

a=$(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*")

for i in $a

do

echo $i

#查看单个模块的详细信息

/sbin/modinfo -F filename $i >/dev/null 2>&1

#加载算法模块

/sbin/modprobe $i

done

五、ipvsadm工具

ipvsadm是一个工具,同时它也是一条命令,用于管理LVS的策略规则。

ipvsadm是ipvs的管理器,需要yum安装。

ipvsadm工具的作用:

LVS群集创建与管理:

创建虚拟服务器

添加、删除服务器节点

查看群集及节点情况

保存负载分配策略

ipvsadm 命令选项说明:

六、LVS-NAT模式操作实例

总结

提示:这里对文章进行总结:

例如:以上就是今天要讲的内容,本文仅仅简单介绍了pandas的使用,而pandas提供了大量能使我们快速便捷地处理数据的函数和方法。