WAIC2023丨AI图像内容安全“黑科技”如何助力科技向善发展?

〇、前言

7月7日下午,2023世界人工智能大会(WAIC)“聚焦·大模型时代AIGC新浪潮—可信AI”论坛在上海世博中心红厅举行。人工智能等技术前沿领域的著名专家与学者、投资人和领军创业者汇聚一堂,共同探索中国科技创新的驱动力量。

在本届世界人工智能大会上,中国信息通信研究院围绕 “多模态基础大模型的可信AI”主题 举办了专项论坛。AIGC安全成为当前人工智能研究发展的重要议题。

文章目录

- 〇、前言

- 一、可信人工智能

- 二、AI图像安全

-

- 1️⃣AI图像篡改检测技术

- 2️⃣生成式图像鉴别

- 3️⃣OCR对抗攻击技术

- 三、总结

一、可信人工智能

可信人工智能(Trusted AI)是指在人工智能应用中注重可信度和可靠性的概念。

中国科学院院士何积丰认为,“不能再将人工智能视为简单的技术工作,而是成为整个组织的变革引擎。可信人工智能要致力于保障数据安全可信、系统行为可追责、算法模型可解释、网络环境可信、法律伦理可信等问题。”

随着人工智能技术的不断发展,越来越多的人们对于人工智能系统的透明性、公正性和可控性提出了要求。 可信人工智能需要满足以下几个方面的要求:

-

透明性:人工智能系统的决策过程和算法应该是可解释的和可理解的,用户应该能够了解系统是怎样做出判断和决策的。

-

公正性:人工智能系统应该避免对不同群体或个体存在歧视性的待遇,不应该根据种族、性别、年龄等个人属性做出不公正的决策。

-

隐私保护:人工智能系统在处理个人数据时,应该保护用户的隐私权,确保个人信息不被滥用或泄露。

-

安全性:人工智能系统应该具备防范恶意攻击和滥用的能力,保障系统的安全性和可靠性。

-

可控性:人工智能系统应该具备一定的可控性,用户应该能够对系统进行监督和管理,确保系统行为符合用户的期望并满足法律和伦理的要求。

二、AI图像安全

中国科学技术大学电子工程与信息科学系教授谢洪涛教授曾提到,“在AIGC爆发的时代,普通民众都可以利用AI算法生成高质量的文本,图像,音频内容。其中,由Midjourney, Stable Diffusion等图像生成方法制作的图像,其逼真程度让人赞叹,人眼已经难以对其真假进行区分。这不禁唤起了人们的隐忧:大量虚假图片将会在互联网上广泛传播。虚假图片的泛滥会引发多种社会安全问题”

利用AI进行图像造假的行为,是AI可信化发展需要应对的重点问题。

目前,人工智能的深度学习和算法越来越先进,深度合成应用呈指数级增长,滥用该技术的行为正带来肉眼可见的伦理问题。除了用AI换脸诈骗,还有人用它制作他人不雅视频、冒充明星带货等。在支付场景日益丰富的今天,人类的面部、声音、指纹、虹膜等生物信息的使用越来越广泛,隐私泄露等风险隐患也随之增多。

恰如那句网络流行语:你永远不知道网络的对面是一个人还是一条狗。如果不对此类技术加以限制,AI技术不仅容易威胁到人身财产安全、伤害个人尊严和隐私,还可能构成更大社会危害。

图像是承载信息的重要媒介,同时也是信息安全的重要关注对象。 随着图像编辑软件的发展和普及,制作虚假图像的门槛逐渐降低,导致大量基于虚假图片的诈骗案件和网络暴力事件在全球范围内造成了严重的影响。

随着生成式造假技术的兴起,人们对图像内容的安全性和可信性也越来越关注。然而,在图像内容领域中,“可信AI”才刚刚起步。

在论坛上,合合信息AI图像内容安全技术方案获得了业界人士的广泛关注。 该方案可精准定位截图篡改痕迹,对生成式图片进行智能判别,防止不法分子利用技术手段非法爬取图片上的信息。

合合信息一直致力于在文档智能领域中探索前沿技术,特别关注"AI+OCR"技术的应用。研究了视觉差异伪造图像的鉴别技术,致力于提供能够加密证件文档图片信息的解决方案。此外,他们还关注生成式图像判别和文档图像完整性保护等行业焦点的议题。通过技术输出和产品服务,帮助个人和企业增强图像内容的安全性。

在本次世界人工智能大会可信AI论坛上,合合信息展示了 “三大技术,一项标准”,探索AI在图像内容安全领域可信化发展的多重可能。

合合信息AI图像安全技术方案主要包括三项重点技术:AI图像篡改检测、生成式图像鉴别、OCR对抗攻击技术,以应对日益高发的恶意P图、生成式造假和个人信息非法提取现象。

1️⃣AI图像篡改检测技术

合合信息智能创新事业部总经理唐琪介绍,去年的世界人工智能大会上,合合信息首次展示了“PS篡改检测”技术,在识别证件、票据等各类重要商业材料中的PS痕迹方面具有了“火眼金睛”。

该技术基于深度学习,提供图像篡改检测技术及相关系统。该技术通过学习图像被篡改后的统计特征变化,智能地捕捉图像在篡改过程中留下的微小痕迹。使用热力图的形式展示图像中篡改的区域,这项技术已经成功应用在银行、保险等领域。

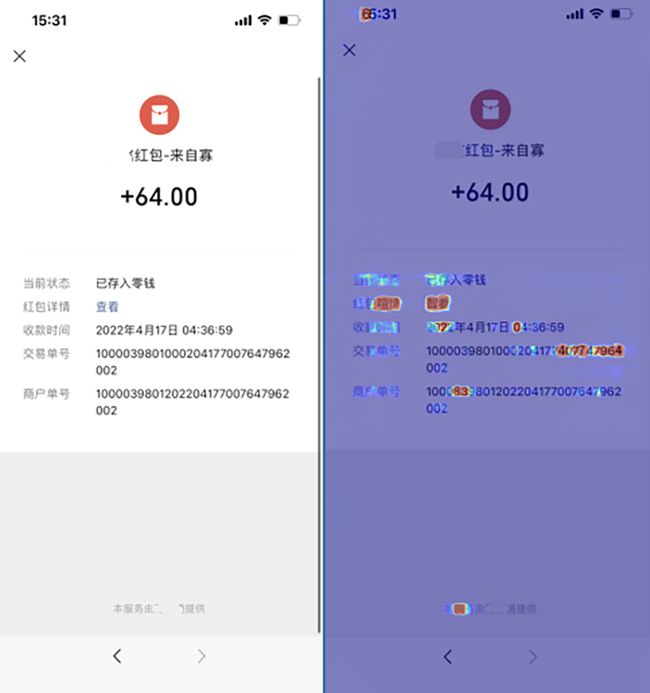

今年,图像篡改检测技术持续优化升级,并拓展到了"截图篡改检测"领域。过去,图像篡改检测技术主要应用于自然场景图像,但实际上,资质证书、文档、截图等被篡改的图像更容易对人们的生活造成风险。合合信息的人工智能图像篡改检测技术可以检测多种截图,例如转账记录、交易记录、聊天记录等。无论是通过从原始图像中"抠取"关键要素并将其移动至其他地方的"复制移动"图像篡改手段,还是采用"擦除"、"重打印"等方式,图像篡改检测技术都能准确识别假图像。

该技术的主要难点在于,能否从没有明显视觉差异的图片中找出被篡改的截图,以及找出的图片中是误检率是否可控。与证照篡改检测相比,截图检测难度更大。 因此,合合信息提出了一种基于HRNet的编码器-解码器结构的模型。该模型结合了图像自身的信息,包括但不限于噪声、频谱等,以捕捉到细粒度的视觉差异,充分利用HRNet的优势,从而实现高精度的图像真实性鉴别效果。

2️⃣生成式图像鉴别

近年来,以语言生成和视觉生成为代表的人工智能生成内容引发了社会对于图文内容的可信度问题的讨论。不法分子利用生成的图片规避版权、身份验证等手段,非法获取利益并给人们带来财产损失。

在这样的背景下,合合信息开发了AI生成式图片鉴别技术,旨在帮助个人和机构识别判断生成的图片是否来自AI生成,防止虚假的虚拟人诈骗行为,并解决生成式AI所面临的伦理问题,推动生成式AI的健康发展。

该项目的难点主要有两个方面:一是生成的图像场景非常多样,无法通过穷举的方式来解决,也无法通过特定领域细分来一一训练;二是有些生成的图像和真实图片相似度非常高,很难以区别。合合信息通过建立空域和频域之间的关系模型,能够在不需要穷举图像的情况下,利用多维度特征来区分真实图片和生成式图片之间的微小差异。

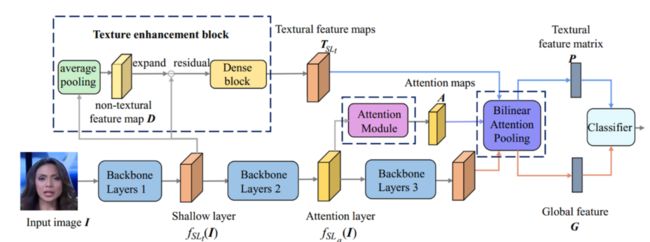

模型结构如下图所示:

该模型使用多个空间注意力头关注输入图片的空间特征,并通过纹理增强模块来突出浅层特征中的细微伪影,从而提高对真实人脸和伪造人脸的感知和判断准确性。

生成式图像检测技术在反诈骗、版权保护等领域有着广泛的应用。例如,在金融行业中,不法分子可能使用人工智能合成技术来盗刷线上资金,威胁公民的财产安全。这项技术可以通过对支付环节进行干预,降低资金盗刷的风险。在传媒行业中,某些图片供应商使用软件自动生成海报等图片,故意隐瞒来源并出售给第三方,第三方在不知情的情况下商用这些图片导致侵权问题。相关的检测技术可以在一定程度上解决这些问题。

3️⃣OCR对抗攻击技术

人们会出于生活、工作需要,拍摄自己的相关证件、文件并发送给第三方,这些图片上承载的个人信息可能被不法分子使用OCR技术识别提取并泄露。

为了满足个人和企业对于文件资料保密的需求,合合信息进行了创新技术的探索,开发了OCR对抗攻击技术,用于对文档图片进行"加密"。为了防止上述情况发生,OCR对抗攻击技术被用来对场景文本或文档内的文本进行干扰,将个人或企业的重要文件 “上锁”,从而防止第三方通过OCR系统读取和保存图片中的所有文字内容,降低数据泄露的风险,并实现隐私信息的保护。

该技术可以在不影响肉眼观看和判断的情况下,对场景文本或文档内的文字进行扰动,对包含中文、英文、数字等关键信息的内容进行"攻击"。 这样做可以防止第三方通过OCR系统读取并保存图像中的所有文字内容,从而降低数据泄露的风险,保护信息的安全。同时,这种技术不会对人眼的观看和判断造成影响,使得文档的可读性不受影响。

三、总结

人工智能的发展面临着正面和负面两种可能性,不法分子和守护者们之间的争斗每天都在无形中进行。关键在于,哪一方拥有更强大的技术实力,决定了是道高一尺还是魔高一丈。

AI图像安全新技术的实现,得益于合合信息在文档图像领域十余年的深耕攒下的底蕴。作为一家人工智能公司,过硬的科技实力是合合信息突破行业难题,培育创新技术的底气。正是这种科技实力使得合合信息能够在这个不断变化的领域中保持竞争优势,并为社会提供更安全的图像解决方案。

现阶段,合合信息已获得超百项自主知识产权发明专利,为全球超过200个国家和地区的上亿用户提供智能文字识别产品及AI服务。未来,合合信息将持续关注图像领域新需求、新动态,用“过硬”的AI为行业发展注入安全感。