k8s概念-pv和pvc

回到目录

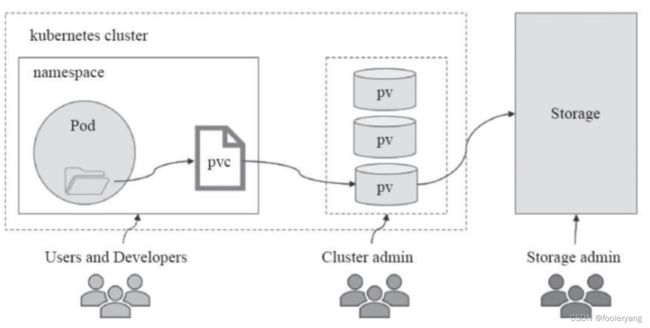

kubernetes存储卷的分类太丰富了,每种类型都要写相应的接口与参数才行,这就让维护与管理难度加大。

persistenvolume(PV) 是配置好的一段存储(可以是任意类型的存储卷)

-

也就是说将网络存储共享出来,配置定义成PV。

PersistentVolumeClaim(PVC)是用户pod使用PV的申请请求。

-

用户不需要关心具体的volume实现细节,只需要关心使用需求。

持久卷(PersistentVolume,PV) 是集群中的一块存储,可以由管理员事先制备, 或者使用存储类(Storage Class)来动态制备。 持久卷是集群资源,就像节点也是集群资源一样。PV 持久卷和普通的 Volume 一样, 也是使用卷插件来实现的,只是它们拥有独立于任何使用 PV 的 Pod 的生命周期。 此 API 对象中记述了存储的实现细节,无论其背后是 NFS、iSCSI 还是特定于云平台的存储系统。

持久卷声明(PersistentVolumeClaim,PVC) 表达的是用户对存储的请求。概念上与 Pod 类似。 Pod 会耗用节点资源,而 PVC 申领会耗用 PV 资源。Pod 可以请求特定数量的资源(CPU 和内存);同样 PVC 申领也可以请求特定的大小和访问模式 (例如,可以要求 PV 卷能够以 ReadWriteOnce、ReadOnlyMany 或 ReadWriteMany 模式之一来挂载,参见访问模式)。

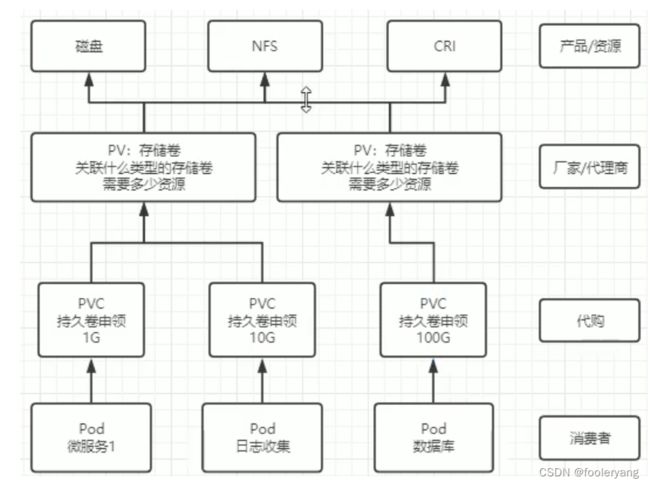

1 pv和pvc的关系

-

pv提供存储资源(生产者)

-

pvc使用存储资源(消费者)

-

使用pvc绑定pv

2 生命周期

构建、绑定、使用、回收

2.1 构建

静态构建、动态构建

2.1.1 静态构建

集群管理员创建若干 PV 卷。这些卷对象带有真实存储的细节信息, 并且对集群用户可用(可见)。PV 卷对象存在于 Kubernetes API 中,可供用户消费(使用)

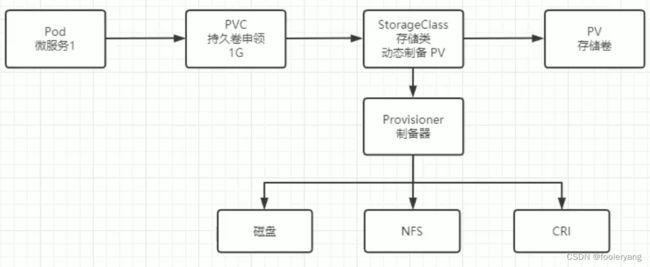

2.1.2 动态构建

如果集群中已经有的 PV 无法满足 PVC 的需求,那么集群会根据 PVC 自动构建一个 PV,该操作是通过 StorageClass 实现的。

想要实现这个操作,前提是 PVC 必须设置 StorageClass,否则会无法动态构建该 PV,可以通过启用 DefaultStorageClass 来实现 PV 的构建

2.2 绑定

当用户创建一个 PVC 对象后,主节点会监测新的 PVC 对象,并且寻找与之匹配的 PV 卷,找到 PV 卷后将二者绑定在一起。

如果找不到对应的 PV,则需要看 PVC 是否设置 StorageClass 来决定是否动态创建 PV,若没有配置,PVC 就会一致处于未绑定状态,直到有与之匹配的 PV 后才会申领绑定关系

2.3 使用

Pod 将 PVC 当作存储卷来使用,集群会通过 PVC 找到绑定的 PV,并为 Pod 挂载该卷。

Pod 一旦使用 PVC 绑定 PV 后,为了保护数据,避免数据丢失问题,PV 对象会受到保护,在系统中无法被删除

2.4 回收

当用户不再使用其存储卷时,他们可以从 API 中将 PVC 对象删除, 从而允许该资源被回收再利用。PersistentVolume 对象的回收策略告诉集群, 当其被从申领中释放时如何处理该数据卷。 目前,数据卷可以被 Retained(保留)、Recycled(回收)或 Deleted(删除)

2.4.1 Retain

回收策略 Retain 使得用户可以手动回收资源。当 PersistentVolumeClaim 对象被删除时,PersistentVolume 卷仍然存在,对应的数据卷被视为"已释放(released)"。 由于卷上仍然存在这前一申领人的数据,该卷还不能用于其他申领。 管理员可以通过下面的步骤来手动回收该卷:

-

删除 PersistentVolume 对象。与之相关的、位于外部基础设施中的存储资产 (例如 AWS EBS、GCE PD、Azure Disk 或 Cinder 卷)在 PV 删除之后仍然存在。

-

根据情况,手动清除所关联的存储资产上的数据。

-

手动删除所关联的存储资产。

如果你希望重用该存储资产,可以基于存储资产的定义创建新的 PersistentVolume 卷对象

2.4.2 Delete

对于支持 Delete 回收策略的卷插件,删除动作会将 PersistentVolume 对象从 Kubernetes 中移除,同时也会从外部基础设施(如 AWS EBS、GCE PD、Azure Disk 或 Cinder 卷)中移除所关联的存储资产。 动态制备的卷会继承其 StorageClass 中设置的回收策略, 该策略默认为 Delete。管理员需要根据用户的期望来配置 StorageClass; 否则 PV 卷被创建之后必须要被编辑或者修补

2.4.3 Recycle

警告: 回收策略 Recycle 已被废弃。取而代之的建议方案是使用动态制备。

如果下层的卷插件支持,回收策略 Recycle 会在卷上执行一些基本的擦除 (rm -rf /thevolume/*)操作,之后允许该卷用于新的 PVC 申领

3 pv

yaml

apiVersion: v1

kind: PersistentVolume # 资源类型 PersistenVlume

metadata:

name: pv0001 # pv的名称

spec:

capacity: # 容量限制

storage: 5Gi # 容量为5G

volumeMode: Filesystem # 存储类型为文件系统

accessModes: # 访问模式

# ReadWriteOnce、ReadWriteMany、ReadOnlyMany

- ReadWriteOnce # 可被单节点独写

persistentVolumeReclaimPolicy: Recycle # 回收策略

storageClassName: slow # 创建 PV 的存储类名,需要与 pvc 的相同

mountOptions: # 加载配置

- hard

- nfsvers=4.1

nfs: # 连接到 nfs

path: /data/nfs/rw/test-pv # 存储路径

server: 192.168.113.121 # nfs 服务地址访问模式

-

ReadWriteOnce

只能被一个pvc绑定,pvc可读写,即服务独享该存储卷

-

ReadWriteMany

可被多个pvc绑定,pvc可读写,即多个服务可共享

-

ReadOnlyOnce

只能被一个pvc绑定,pvc仅读操作,即服务独享读

-

ReadOnlyMany

可被多个pvc绑定,pvc仅读操作,即多个服务共享读内容

pv的状态

| 状态 | 含义 |

|---|---|

| Available | 空闲,未被绑定 |

| Bound | 已经被 PVC 绑定 |

| Released | PVC 被删除,资源已回收,但是 PV 未被重新使用 |

| Failed | 自动回收失败 |

4 pvc

yaml文件

不指定选择器,则k8s通过资源要求等配置相同的进行自动选择绑定pv

apiVersion: v1

kind: PersistentVolumeClaim # 资源类型

metadata:

name: nfs-pvc # pvc名称

spec:

accessModes:

- ReadWriteOnce # 权限需要与对应的 pv 相同

volumeMode: Filesystem # 存储类型

resources:

requests:

storage: 5Gi # 资源可以小于 pv 的,但是不能大于,如果大于就会匹配不到 pv

storageClassName: slow # 名字需要与对应的 pv 相同,slow自带的strogeClass

# selector: # 使用选择器选择对应的 pv matchLabels:标签选择,表达式选择matchExpressions

# matchLabels:

# release: "stable"

# matchExpressions:

# - {key: environment, operator: In, values: [dev]} pod如何绑定pvc

#在 pod 的挂载容器配置中,增加 pvc 挂载

containers:

......

volumeMounts:

- mountPath: /tmp/pvc # 挂载到容器里的路径

name: nfs-pvc-test # 挂载数据卷的名称

volumes:

- name: nfs-pvc-test # 数据卷名

persistentVolumeClaim: # 类型为pvc

claimName: nfs-pvc # pvc 的名称5 StorageClass

k8s 中提供了一套自动创建 PV 的机制,就是基于 StorageClass 进行的,通过 StorageClass 可以实现仅仅配置 PVC,然后交由 StorageClass 根据 PVC 的需求动态创建 PV

制备器

Provisioner,每个 StorageClass 都有一个制备器(Provisioner),用来决定使用哪个卷插件制备 PV

准备Storage [nfs]

前提:需要提前安装nfs

官方插件是不支持NFS动态供给的,但是我们可以用第三方的插件来实现

-

RBAC配置

因为storage自动创建pv需要经过kube-apiserver,所以需要授权

-

provisioner配置

-

storageclass配置

RBAC配置

名称:rbac.yaml

用途:授权账号

账号:nfs-client-provisioner

apiVersion: v1

kind: ServiceAccount

metadata:

name: nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

---

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: nfs-client-provisioner-runner

rules:

- apiGroups: [""]

resources: ["nodes"]

verbs: ["get", "list", "watch"]

- apiGroups: [""]

resources: ["persistentvolumes"]

verbs: ["get", "list", "watch", "create", "delete"]

- apiGroups: [""]

resources: ["persistentvolumeclaims"]

verbs: ["get", "list", "watch", "update"]

- apiGroups: ["storage.k8s.io"]

resources: ["storageclasses"]

verbs: ["get", "list", "watch"]

- apiGroups: [""]

resources: ["events"]

verbs: ["create", "update", "patch"]

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: run-nfs-client-provisioner

subjects:

- kind: ServiceAccount

name: nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

roleRef:

kind: ClusterRole

name: nfs-client-provisioner-runner

apiGroup: rbac.authorization.k8s.io

---

kind: Role

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: leader-locking-nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

rules:

- apiGroups: [""]

resources: ["endpoints"]

verbs: ["get", "list", "watch", "create", "update", "patch"]

---

kind: RoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: leader-locking-nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

subjects:

- kind: ServiceAccount

name: nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

roleRef:

kind: Role

name: leader-locking-nfs-client-provisioner

apiGroup: rbac.authorization.k8s.ionfs-provisioner

deploy-nfs-client-provisioner.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nfs-client-provisioner

labels:

app: nfs-client-provisioner

# replace with namespace where provisioner is deployed

namespace: default

spec:

replicas: 1

strategy:

type: Recreate

selector:

matchLabels:

app: nfs-client-provisioner

template:

metadata:

labels:

app: nfs-client-provisioner

spec:

serviceAccountName: nfs-client-provisioner

containers:

- name: nfs-client-provisioner

image: registry.cn-beijing.aliyuncs.com/pylixm/nfs-subdir-external-provisioner:v4.0.0

volumeMounts:

- name: nfs-client-root

mountPath: /persistentvolumes

env:

- name: PROVISIONER_NAME

value: k8s-sigs.io/nfs-subdir-external-provisioner #storageclass通过该名称绑定

- name: NFS_SERVER

value: 10.199.99.201

- name: NFS_PATH

value: /home/data/nfs

volumes:

- name: nfs-client-root

nfs:

server: 10.199.99.201

path: /home/data/nfsstorageclass配置

storageclass-nfs.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:

annotations:

storageclass.kubernetes.io/is-default-class: "true"

name: nfs-client

provisioner: k8s-sigs.io/nfs-subdir-external-provisioner # or choose another name, must match deployment's env PROVISIONER_NAME'

parameters:

archiveOnDelete: "false"操作

#1. 在/opt/k8s/下创建目录storageclass,-d标识没有上级目录也创建

mkdir -d /opt/k8s/storageclass

#2. 进入目录,创建storageclass-nfs-rbac.yaml,将上面4.2.1内容复制

#3. 创建

[root@k8s-master1 storageclass]# kubectl apply -f storageclass-nfs-rbac.yaml

serviceaccount/nfs-client-provisioner created

clusterrole.rbac.authorization.k8s.io/nfs-client-provisioner-runner created

clusterrolebinding.rbac.authorization.k8s.io/run-nfs-client-provisioner created

role.rbac.authorization.k8s.io/leader-locking-nfs-client-provisioner created

rolebinding.rbac.authorization.k8s.io/leader-locking-nfs-client-provisioner created

#4. 创建制备器 deploy-nfs-client-provisioner.yml

[root@k8s-master1 storageclass]# kubectl apply -f deploy-nfs-client-provisioner.yml

deployment.apps/nfs-client-provisioner created

#5. 创建storageclass storageclass-nfs.yaml

[root@k8s-master1 storageclass]# kubectl apply -f storageclass-nfs.yaml

storageclass.storage.k8s.io/managed-nfs-storage created验证

#查看存储类sc

[root@k8s-master1 storageclass]# kubectl get sc

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE

nfs-client k8s-sigs.io/nfs-subdir-external-provisioner Delete Immediate

#查看制备器provisioner

[root@k8s-master1 storageclass]# kubectl get deploy

NAME READY UP-TO-DATE AVAILABLE AGE

nfs-client-provisioner 1/1 1 1 28m

#查看制备器po

[root@k8s-master1 storageclass]# kubectl get po

NAME READY STATUS RESTARTS AGE

nfs-client-provisioner-5b788667db-85hrp 1/1 Running 0 24m创建一个statefulset,验证是否自动制备

---

apiVersion: v1

kind: Service

metadata:

name: nginx

labels:

app: nginx

spec:

ports:

- port: 80

name: web

clusterIP: None

selector:

app: nginx

---

apiVersion: apps/v1

kind: StatefulSet

metadata:

name: web

spec:

selector:

matchLabels:

app: nginx

serviceName: "nginx"

replicas: 2

template:

metadata:

labels:

app: nginx

spec:

imagePullSecrets:

- name: huoban-harbor

terminationGracePeriodSeconds: 10

containers:

- name: nginx

image: nginx:latest

ports:

- containerPort: 80

name: web

volumeMounts:

- name: www

mountPath: /usr/share/nginx/html

volumeClaimTemplates:

- metadata:

name: www

spec:

accessModes: [ "ReadWriteOnce" ]

storageClassName: "nfs-client" #storageclass 名称

resources:

requests:

storage: 1Gi[root@k8s-master storageclass]# kubectl get pv

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

pvc-243c7f89-23ff-40b3-821f-f7014d14ec99 1Gi RWO Delete Bound default/www-web-0 nfs-client 4s

[root@k8s-master storageclass]# kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

www-web-0 Bound pvc-243c7f89-23ff-40b3-821f-f7014d14ec99 1Gi RWO nfs-client 8s