Kubernetes:(一)基本概念

目录

一、K8S的由来

1.公有云类型说明:IAAS,PAAS,SAAS

二:Kubernetes部署方式的演变

三:为什么要使用kubernetes

3.1Kubernetes 特点

3.2kubernetes特性

四:kubernetes集群架构与组件

4.1kubernetes 组件

4.1.1master组件

4.1.2node组件

4.2 K8S工作流程

五:Kubernetes核心概念

5.1Pod

小结

5.2Label

5.3Service

5.4Ingress

5.5Name

5.6Namespace

六:总结

前言:Kubernetes 是一个可移植、可扩展的开源平台,用于管理容器化工作负载和服务,有助于声明式配置和自动化。它拥有庞大且快速发展的生态系统。

Kubernetes是什么意思?为什么又称作K8S?

Kubernetes的名字来自希腊语,意思是“舵手” 或 “领航员”。K8s是将8个字母“ubernete”替换为“8”的缩写

Kubernetes是一个可移植的、可扩展的开源平台,用于管理容器化的工作负载和服务,可促进声明式配置和自动化。Kubernetes拥有一个庞大且快速增长的生态系统。Kubernetesd的服务、支持和工具广泛可用

Kubernetes(通常称为K8s,K8s是将8个字母“ubernete”替换为“8”的缩写)是一个以容器为中心的基础架构,可以实现在物理集群或虚拟机集群上调度和运行容器,提供容器自动部署、扩展和管理的开源平台。满足了应用程序在生产环境中的一些通用需求:应用实例副本、水平自动扩展、命名与发现、负载均衡、滚动升级、资源监控等。

Kubernetes 是一个可移植、可扩展的开源平台,用于管理容器化工作负载和服务,有助于声明式配置和自动化。它拥有庞大且快速发展的生态系统。

①Kubernetes 是Google在2014年开源的一个容器集群管理系统,Kubernetes简称K8S。

②K8S用于容器化应用程序的部署,扩展和管理。

③K8S提供了容器编排,资源调度,弹性伸缩,部署管理,服务发现等-一系列功能。

④Kubernetes目标是让部署容器化应用简单高效。

作用:

- 用于自动部署、扩展和管理“容器化( containerized) 应用程序"的开源系统。

- 可以理解成K8S是负责自动化运维管理多个容器化程序(比如Docker)的集群,是一个生态极其丰富的容器编排框架工具。

一、K8S的由来

1.公有云类型说明:IAAS,PAAS,SAAS

在云计算的概念中,我们可以把公有云分为三个层面,IAAS(基础设施即服务),PAAS(平台即服务),SAAS(软件即服务)

1、IAAS:基础设施即服务。

Infrastructure-as-a-Service(IAAS),国内做的最好的就是阿里云

2、Platform-as-a-Service(PAAS),某些时候也叫做中间件, PAAS公司在网上提供各种开发和分发应用的解决方案,比如虚拟服务器和操作系统。

一些大的PAAS提供者有Google App Engine,Microsoft Azure,Force.com,Heroku,Engine Yard等

国内做的最好的就是新浪云

3、SAAS:软件即服务。

Software-as-a-Service(SAAS),列举一些例子:如Google Apps、Dropbox、Salesforce、Cisco WebEx、Concur和GoToMeeting等

做的比较好的是Microsoft Office 365

二:Kubernetes部署方式的演变

在部署应用程序的方式上,主要经历了三个时代:

传统部署:互联网早期,会直接将应用程序部署在物理机上

优点:简单,不需要其它技术的参与

缺点:不能为应用程序定义资源使用边界,很难合理地分配计算资源,而且程序之间容易产生影响

虚拟化部署:可以在一台物理机上运行多个虚拟机,每个虚拟机都是独立的一个环境

优点:程序环境不会相互产生影响,提供了一定程度的安全性

缺点:增加了操作系统,浪费了部分资源

容器化部署:与虚拟化类似,但是共享了操作系统

优点:

可以保证每个容器拥有自己的文件系统、CPU、内存、进程空间等

运行应用程序所需要的资源都被容器包装,并和底层基础架构解耦

容器化的应用程序可以跨云服务商、跨Linux操作系统发行版进行部署

容器化部署方式给带来很多的便利,但是也会出现一些问题,比如说:

一个容器故障停机了,怎么样让另外一个容器立刻启动去替补停机的容器

当并发访问量变大的时候,怎么样做到横向扩展容器数量

这些容器管理的问题统称为容器编排问题,为了解决这些容器编排问题,就产生了一些容器编排的软件:

1、Swarm:Docker自己的容器编排工具

Docker Swarm,是一个非常轻量的群集管理工具,只有几十MB大小

Swarm 是 Docker官方提供的一款集群管理工具,其主要作用是把若干台 Docker 主 机抽象为一个整体,并且通过一个入口统一管理这些 Docker 主机上的各种 Docker 资源。但是Swarm 和 Kubernetes 比较类似,因为更加轻,所以具有的功能也较 kubernetes 更少一些。大概在2019年7月份,阿里云宣布将Docker Swarm 从选择列 表中剔除,这也意味着在不久得将来,Docker Swarm 也会像Mesos一样慢慢被淘汰掉。

2、Mesos:Apache的一个资源统一管控的工具,需要和Marathon结合使用

MESOS:Mesos是Apache旗下的开源分布式资源管理框架,它被称为是分布式系统的内核,后来在twitter得到广泛使用

Twitter也是mesos的最大客户,但是大概在2019年5月份,Twitter 宣布不再使用MESOS,而改用 Kubernetes,至此,Mesos已经是慢慢的被淘汰了

3、Kubernetes:Google开源的的容器编排工具

kubernetes是一个可移植的、可扩展的开源平台,用于管理容器化的工作负载和服务,可促进声明式配置和自动化。Kubernetes拥有一个庞大且快速增长的生态系统。Kubernetesd的服务、支持和工具广泛可用

用于自动部署、扩展和管理容器化(containerized)应用程序的开源系统。

可以理解成K8S是负责自动化运维管理多个容器化程序(比如docker)的集群,是一个生态机器丰富的容器编排框架工具

三:为什么要使用kubernetes

kubernetes是一个容器编排工具,可以高效、批量的去管理容器。但docker有自带的docker-compose(单机编排)和docker-Swarm(多机编排),为什么还要用k8s,Docker-Compose的运用可以充分地把单物理服务器的性能充分利用起来,并且可以快速地进行持续交付,那如何高效地进行监控各个容器的健康运行情况以及崩溃后如何迁移服务呢?也就是常见的集群管理问题,此时的docker Swarm技术解决了这个问题,但是如何更加高效、智能的管理容器集群呢?这时谷歌公司内部使用很久k8s横空出世,抢占了近80%的市场份额,成为行业领头羊,为什么k8s能击败docker Swarm呢?那是因为kubernetes的这些优点:

快速部署功能:定义对应的charts,可以方便把大型的应用部署上去。

自愈功能:某个节点的服务崩溃了,可以自动迁移到另外一个服务器节点来恢复来实现高可用。

智能的负载均衡:利用Ingress,可以实现流量通过域名访问进来时候,进行流量的分流到不同服务器上。

智能的滚动升降级:升级或者降级时候,会逐个替换,当自定义数量的服务升级OK后,才会进行其他的升级以及真正销毁旧的服务。

容器是打包和运行应用程序的好方式。在生产环境中,你需要管理运行应用程序的容器,并确保不会停机。例如,如果一个容器发生故障,则需要启动另一个容器。如果系统处理此行为,会不会更容易。

这就是Kubernetes来解决这些问题的方法!Kubernetes为你提供了一个可弹性运行分布式系统的框架。Kubernetes会满足扩展要求,故障转移,部署模式等

K8S是Google开源的容器集群管理系统,在Docker等容器技术的基础上,为容器化的应用提供部署运行、资源调度、服务发现和动态伸缩等一系列完整功能,提高了大规模容器集群管理的便捷性。其主要功能如下

使用Docker等容器技术对应应用程序包装(package)、实例比(instantiate)、运行(run)

以集群的方式运行、管理跨机器的容器

解决Docker跨机器容器之间的通讯问题

K8S的自我修复机制使得容器集群总数运行在用户期望的状态

3.1Kubernetes 特点

- 可移植: 支持公有云,私有云,混合云,多重云(multi-cloud)

- 可扩展: 模块化, 插件化, 可挂载, 可组合

- 自动化: 自动部署,自动重启,自动复制,自动伸缩/扩展

- 快速部署应用,快速扩展应用

- 无缝对接新的应用功能

- 节省资源,优化硬件资源的使用

3.2kubernetes特性

- 轻量级:一些解释性语言:例如Python/JavaScript / Perl /Shell,效率较低,占用内存资源较多,使用go语言——》编译型语言,语言级别支持进程管理,不需要人为控制,所以以go开发的资源消耗占用资源小

- 开源

- 自我修复:在节点故障时重新启动失败的容器,替换和重新部署,保证预期的副本数量;杀死健康检查失败的容器,并且在未准备好之前不会处理客户端请求,确保线上服务不中断

- 弹性伸缩:使用命令、UI或者基于CPU使用情况自动快速扩容和缩容应用程序实例,保证应用业务高峰并发时的高可用性;业务低峰时回收资源,以最小成本运行服务

- 自动发布(默认滚动发布模式)和回滚:K8S采用滚动策略更新应用,一个更新一个Pod,而不是同时删除所有的Pod,如果更新过程中出现问题,将回滚更改,确保升级不收影响业务

- 集中化配置管理和密钥管理:管理机密数据和应用程序配置,而不需要把敏感数据暴露在镜像里,提高敏感数据安全性,并可以将一些常用的配置存储在K8S中,方便应用程序使用

- 存储编排:支持外挂存储并对外挂存储资源进行编排,挂载外部存储系统,无论是来自本地存储,公有云(如:AWS),还是网络存储(如:NFS、Glusterfs、Ceph)都作为集群资源的一部分使用,极大提高存储使用灵活性

- 任务批量处理运行:提供一次性任务,定时任务,满足批量数据处理和分析的场景

k8s解决了裸跑docker的若干痛点:

- 单机使用,无法有效集群

- 随着容器数量的上升,管理成本攀升

- 没有有效的容灾,自愈机

- 没有预设编排模板,无法实现快速,大规模容器调

- 没有统一的配置管理中心工

- 没有容器生命周期的管理工

- 没有图形化运维管理工具

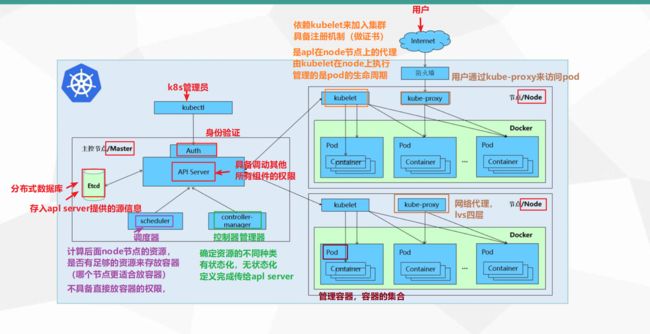

四:kubernetes集群架构与组件

4.1kubernetes 组件

K8S是属于主从设备模型(Master-slave 架构),即有Master 节点负责集群的调度、管理和运维,Slave 节点是集群中的运算工作负载节点。

在K8S中,主节点一般被称为Master 节点,而从节点则被称为Worker Node节点,每个Node都会被Master分配一些工作负载。

Master组件可以在群集中的任何计算机上运行,但建议Master节点占据一个独立的服务器。因为Master是整个集群的大脑,如果Master所在节点宕机或不可用,那么所有的控制命令都将失效。除了Master, 在K8S集群中的其他机器被称为Worker Node节点,当某个Node宕机时,其上的工作负载会被Master自动转移到其他节点上去。

| 组件 |

作用 |

| master节点 |

|

| apiserver |

所有服务的访问入口 |

| controller-manager |

负责根据预设模板创建pod,维持pod等资源的副本期望数目 |

| scheduler |

负责调度pod,通过预选策略、优选策略选择最合适的node节点分配pod |

| etcd |

分布式键值对数据库,负责存储K8S集群的重要信息(持久化) |

| work node节点 |

|

| Kubelet |

跟apiserver通信汇报当前node节点上的资源使用情况和状态,接受apiserver的指令跟容器引擎交互实现容器的生命周期管理 |

| Kube-proxy |

在node节点上实现pod的网络代理,维护网络规则和四层负载均衡规则,负责写入规则到iptables或ipvs实现服务映射访问 |

| 容器运行时docker |

运行容器,负责本机的容器创建和管理工作 |

4.1.1master组件

master:集群的控制平面,负责集群的决策 ( 管理 )

①kube-apiserver

Kubernetes API,集群的统一入口,各组件协调者,以Restful API提供接口服务,所有对象资源的增删改查和监听操作都交给APIServer处理后再提交给Etcd存储

用于暴露Kubernetes API,任何资源请求或调用操作都是通过kube-apiserver 提供的接口进行。以HTTP Restful API提供接口服务,所有对象资源的增删改查和监听操作都交给API Server 处理后再提交给Etcd 存储(相当于分布式数据库,以键值对方式存储)。

可以理解成API Server 是K8S的请求入口服务。API server 负责接收K8S所有请求(来自UI界面或者CLI 命令行工具),然后根据用户的具体请求,去通知其他组件干活。可以说API server 是K8S集群架构的大脑。

②kube-controller-manager (控制器管理中心-定义资源类型)

- 运行管理控制器,是k8s集群中处理常规任务的后台线程,是k8s集群里所有资源对象的自动化控制中心。

- 在k8s集群中,一个资源对应一个控制器,而Controller manager 就是负责管理这些控制器的

- 由一系列控制器组成,通过API Server监控整个集群的状态,并确保集群处于预期的工作状态,比如当某个Node意外宕机时,Controller Manager会及时发现并执行自动化修复流程,确保集群始终处于预期的工作状态

| 控制器 | 功能 |

| NodeContrpller(节点控制器) | 负责在节点出现故障时发现和响应 |

| Replication Controller ( 副本控制器) | 负责保证集群中一个RC (资源对象ReplicationController) 所关联的Pod副本数始终保持预设值。可以理解成确保集群中有且仅有N个Pod实例,N是RC中定义的Pod副本数量 |

| Endpoints Controller (端点控制器) | 填充端点对象(即连接Services 和Pods) ,负责监听Service 和对应的Pod 副本的变化。可以理解端点是一个服务暴露出来的访问点, 如果需要访问一个服务,则必须知道它的 endpoint |

| Service Account & Token Controllers (服务帐户和令牌控制器) | 为新的命名空间创建默认帐户和API访问令牌 |

| ResourceQuotaController(资源配额控制器) | 确保指定的资源对象在任何时候都不会超量占用系统物理资源 |

| Namespace Controller (命名空间控制器) | 管理namespace的生命周期 |

| Service Controller (服务控制器) | 属于K8S集群与外部的云平台之间的一个接口控制器 |

③kube-scheduler

- 根据调度算法(预选/优选的策略)为新创建的Pod选择一个Node节点,可以任意部署,可以部署在同一个节点上,也可以部署在不同的节点上

- 可以理解成K8S所有Node 节点的调度器。当用户要部署服务时,scheduler 会根据调度算法选择最合适的Node 节点来部署Pod

④etcd(存储中心)

- 分布式键值存储系统(特性:服务自动发现)。用于保存集群状态数据,比如Pod、Service等对象信息

- k8s中仅API Server 才具备读写权限,其他组件必须通过API Server 的接口才能读写数据

⑤AUTH :认证模块

K8S 内部支持使用RBAC认证的方式进行认证

⑥cloud-controller-manager

云控制器管理器是指嵌入特定云的控制逻辑的 控制平面组件。 云控制器管理器允许您链接集群到云提供商的应用编程接口中, 并把和该云平台交互的组件与只和您的集群交互的组件分离开。

cloud-controller-manager 仅运行特定于云平台的控制回路。 如果你在自己的环境中运行 Kubernetes,或者在本地计算机中运行学习环境, 所部署的环境中不需要云控制器管理器。

与 kube-controller-manager 类似,cloud-controller-manager 将若干逻辑上独立的 控制回路组合到同一个可执行文件中,供你以同一进程的方式运行。 你可以对其执行水平扩容(运行不止一个副本)以提升性能或者增强容错能力

下面的控制器都包含对云平台驱动的依赖:

– ● 节点控制器(Node Controller): 用于在节点终止响应后检查云提供商以确定节点是否已被删除

– ● 路由控制器(Route Controller): 用于在底层云基础架构中设置路由

– ● 服务控制器(Service Controller): 用于创建、更新和删除云提供商负载均衡器

4.1.2node组件

①kubelet

Node节点的监视器,以及与Master节点的通讯器。Kubelet是Master节点安插在Node节点上的"眼线",它会定时向API server汇报自己Node节点上运行的服务状态,并接收来自Master节点的指示采取调整措施

从Master节点获取自己节点上Pod的期望状态(比如运行什么容器、运行的副本数量、网络或者存储如何配置等),直接跟容器引擎交互实现容器的生命周期管理,如果自己节点上Pod的状态与期望状态不一致,则调用对应的容器平台接口(即docker的接口)达到这个状态。管理镜像和容器的清理工作,保证节点上镜像不会占满磁盘空间,退出的容器不会占用太多资源

②kube-proxy(四层)

在每个Node节点上实现Pod网络代理,是Kubernetes service资源的载体,负责维护网络规划和四层负载均衡工作。负责写入规则至iptables、ipvs实现服务映射访问的

Kube-proxy本身不是直接给Pod提供网络,Pod的网络是由Kubelet提供的,Kube-proxy实际上维护的是虚拟的Pod集群网络

Kube-apiserver通过监控Kube-proxy进行对Kubernetes service的更新和端点的维护

Kube-proxy是K8S集群内部的负载均衡器。它是一个分布式代理服务器,在K8S的每个节点上都会运行一个Kube-proxy

③docker或rocket

容器引擎,运行容器

4.2 K8S工作流程

首先,运维人员使用kubectl命令行工具向API Server发送请求,API Server接收到请求后会写入到etcd中,API Server会让Controller-manager按照预设的模板去创建pod,Controller-manager通过API Server读取etcd中用户的预设信息,再通过API Server去找Scheduler可以为新创建的pod选择最合适的node节点。scheduler会通过API Server在etcd存储中心根据存储的node节点元信息、剩余资源等,用预选和优选策略选最优的node节点。

scheduler确定node节点后通过API Server交给这个node节点上的kubele进行pod资源的创建,kubele调用容器引擎交互创建pod,同时将pod监控信息通过API Server存储到etcd中。

用户访问时,通过kube-proxy负载、转发,访问相应的pod

决定创建pod清单的是Controller-manager控制器,而kubelet、容器引擎都是干活的

- 首先经过auth认证(鉴权),然后传递给API Server进行处理

- API Server将请求信息提交给etcd

- scheduler和controller-manager会watch(监听)API Server,监听请求

- 在scheduler和controller-manager监听到请求后,scheduler会提交给API Server一个list清单-----》包含的是获取node节点信息。

- 此时API Server就会向etcd获取后端node节点信息,获取到后,被scheduler监听到,然后scheduler进行预选优选进行打分,最后将结果给API Server。

- 此时API Server也会被controller-manager 监听,controller-manager会根据请求创建Pod的配置信息(需求什么控制器),然后把控制器资源给API Server。

- 此时API Server会提交清单给与对应节点的kubelet(代理)。

- kubelet代理通过K8S与容器的接口(例如containerd)进行交互,假设是docker容器,那么此时kubelet就会通过dockershim以及runc接口与docker的守护进程docker-server进行交互,来创建对应的容器,再生成对应的Pod。

- kubelet同时会借助于metric server收集本节点的所有状态信息,然后再提交给API Server。最后API Server会提交list清单给与etcd来存储(最后api-server会将数据维护在etcd中)。

简化版

1、首先kubectl 转化为json后,向api-server 提交创建Pod请求

2、api-server将请求信息记录在etcd中

3、scheduler 监听api-server处理的请求,然后向api-server申请后端节点信息

4、api-server 从etcd中获取后端节点信息后,给与scheduler

5、scheduler 进行预选优选、打分,然后提交结果给api-server

6、controller-manager 监听api-server处理的请求信息,并将所需的控制器资源给与api-server

7、api-server 对接node节点的kubelet

8、kubelet调用资源创建pod,并将统计信息返回给api-server

9、api-server将信息记录在etcd中

五:Kubernetes核心概念

Kubernetes包含多种类型的资源对象: Pod、 Label、 Service、 Replication Controller 等。

所有的资源对象都可以通过Kubernetes 提供的kubectl 工具进行增、删、改、查等操作,并将其保存在etcd 中持久化存储。

Kubernets其实是一个高度自动化的资源控制系统,通过跟踪对比etcd存储里保存的资源期望状态与当前环境中的实际资源状态的差异,来实现自动控制和自动纠错等高级功能。

5.1Pod

Pod是Kubernetes 创建或部署的最小/最简单的基本单位,一个Pod代表集群上正在运行的一个进程。

1、可以把Pod理解成豌豆荚,而同一个Pod内的每个容器是一个个豌豆

2、一个Pod由一个或多个容器组成,Pod中容器共享网络、存储和计算资源,在同一台Docker主机上运行

3、一个Pod里可以运行多个容器,又叫边车(SideCar)模式。而在生产环境中一般都是单个容器或者具有强关联互补的多个容器组成一个Pod

4、同一个Pod之间的容器可以通过localhost互相访问,并且可以挂载Pod内的所有的数据卷;但是不同的Pod之间的容器不能泳localhost访问,也不能挂载其它Pod的数据卷

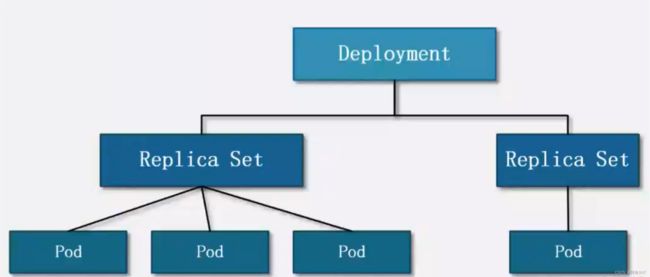

Pod控制器

Pod控制器是Pod启动的一种模板,用来保证在K8S里启动的Pod应始终按照用户的预期运行(副本数、生命周期、健康状态检查等)。K8S内提供了众多的Pod控制器,常用的有以下几种:

- Deployment:无状态应用部署。Deployment的作用就是管理和控制Pod和ReplicaSet,管控它们在运行在用户期望的状态中

Deployment–无状态应用部署:Nginx这种类型的服务,只开启反向代理的功能的时候,假设nginx宕了,重新跑一个新的,替换过来,可以直接用。没有差异化成为无状态

无状态服务:LVS(加入集群后,无特殊性需求)

- 服务不依赖自身的状态,实例的状态数据可以维护在内存中

- 任何一个请求都可以被任意一个实例处理

- 不存储状态数据,实例可以水平扩展,通过负载均衡将请求分发到各个节点

- 在一个封闭的系统中,只存在一个数据闭环

- 通常在于单体架构集群中

- Replicaset:确保预期的Pod副本数量。Replicaset的作用就是管理和控制Pod,管控他们好好干活。但是Replicaset受控于Deployment。可以理解成Deployment就是总包工头,主要负责监督底下的工人 Pod干活,确保每时每刻有用户要求数量的 Pod 在工作。如果一旦发现某个工人 Pod 不行了,就赶紧新拉一个 Pod 过来替换它。而ReplicaSet 就是总包工头手下的小包工头。从 K8S 使用者角度来看,用户会直接操作 Deployment 部署服务,而当Deployment 被部署的时候,K8S 会自动生成要求的 ReplicaSet 和 Pod。用户只需要关心 Deployment而不操心 ReplicaSet。资源对象 Replication Controller 是 ReplicaSet 的前身,官方推荐用Deployment 取代 Replication Controller 来部署服务。

- Daemonset:确保所有节点运行同一类Pod,保证每 个节点上都有一个此类Pod运行,通常用于实现系统级后台任务。

- Statefulset:有状态应用部署

里面运行的是MySQL,MySQL宕了,配置一样,不能直接用,数据有差异性,加入集群后满足特定规则,存储数据的规则,才能使用,有差异化称为有状态

有状态服务:例如数据库

由特殊状态需求,例如需要持久化,需要特定的数据支持

- 服务本身依赖或者存在局部的状态数据,这些数据需要自身持久化或者通过其它节点恢复

- 一个请求只能被某个节点(或者同等状态下的节点)处理

- 存储状态数据,实例的拓展需要整个系统参与状态的迁移

- 在一个封闭的系统中,存在多个数据闭环,需要考虑这些闭环的数据一致性问题

- 通常存在于分布式架构中

- Job:一次性任务: 根据用户的设置,Job管理的Pod把任务成功完成就自动退出了。

- Cronjob:周期性计划性任务

小结

有状态:需要持久化,多次请求之间需要共享一些信息

无状态:一次性,不需要持久化的特殊状态,每次请求都是一条新的数据

无状态服务:就是没有特殊状态的服务,各个请求对于服务器来说同一无差别处理,请求自身携带了所有服务端所需要的所有参数(服务端自身不存储跟请求相关的任何数据,不包括数据库存储信息)

有状态服务:与之相反,有状态服务在服务端保留之前请求的信息,用以处理当前请求,比如session等

对于docker来说,更适合应用无状态服务,而kubernetes,提供了一种解决方案----》多种存储类型

—》例如

configmap(配置管理中心),主要存储配置文件

PS:configmap是一个独立的资源,类似于docker run -itd -v /nginx conf:/usr/nginx/conf nginx:1.21 /bin/bash

把nginx.conf---->写成一个nginx-confimap.yaml文件

把nginx---->pod nginx.yaml ,通过相同的标签:label=nginx来关联

Secret:用户密码、需要加密的文件

mysql-secrets.yml加密形式的配置文件(账号密码)和mysql.yaml通过标签关联在一起

volume:基本数据(网页文件),docker run -itd -v /nginx_html:/usr/local/nginx/html/ nginx:1.21 /bin/bash

PV/PVC:动态创建过程

5.2Label

- 标签,是K8S特色的管理方式,便于分类管理资源对象。

- Label可以附加到各种资源对象.上,例如Node、Pod、Service、 RC等,用于关联对象、查询和筛选。

- 一个Label 是一个key-value 的键值对,其中key 与value 由用户自己指定。

- 一个资源对象可以定义任意数量的Label,同一个Label也可以被添加到任意数量的资源对象中,也可以在对象创建后动态添加或者删除。

- 可以通过给指定的资源对象捆绑一个或多个不同的Label,来实现多维度的资源分组管理功能。

- 与Label 类似的,还有Annotation (注释)

- 区别在于有效的标签值必须为63个字符或更少,并且必须为空或以字母数字字符( [a-z0-9A-Z])开头和结尾,中间可以包含横杠(-)、下划线(_)、点(.)和字母或数字。注释值则没有字符长度限制。

Label选择器(Label selector )

给某个资源对象定义一个Label,就相当于给它打了一个标签;随后可以通过标签选择器( Label selector) 查询和筛选拥有某些Label的资源对象。

标签选择器目前有两种:基于等值关系(等于、不等于)和基于集合关系(属于、不属于、存在)。

5.3Service

在K8s的集群里,虽然每个Pod会被分配一个单独的IP地址,但由于Pod是有生命周期的(它们可以被创建,而且销毁之后不会再启动),随时可能会因为业务的变更,导致这个IP地址也会随着Pod 的销毁而消失。

Service就是用来解决这个问题的核心概念。

K8S中的Service并不是我们常说的“服务"的含义,而更像是网关层,可以看作一组提供相同服务的Pod的对外访问接口、流量均衡器。

Service作用于哪些Pod是通过标签选择器来定义的。

在K8S集群中,service 可以看作一组提供相同服务的Pod的对外访问接口。客户端需要访问的服务就是service对象。每个service都有一个固定的虛拟ip (这个ip也被称为Cluster IP) ,自动并且动态地绑定后端的Pod, 所有的网络请求直接访问Service 的虚拟ip,service会自动向后端做转发。

Service除了提供稳定的对外访问方式之外,还能起到负载均衡(Load Balance)的功能,自动把请求流量分布到后端所有的服务.上,Service可以做到对客户透明地进行水平扩展(scale)。

而实现service 这一功能的关键, 就是kube-proxy。 kube-proxy 运行在每个节点上,监听API Server 中服务对象的变化,

可通过以下三种流量调度模式:userspace (废弃)、iptables ( 濒临废弃)、ipvs (推荐,性能最好)来实现网络的转发。

Service 是K8S服务的核心,屏蔽了服务细节,统一对外暴露服务接口,真正做到了“微服务”。比如我们的一个服务A,部署了3个副本,也就是3个Pod;

对于用户来说,只需要关注一个Service 的入口就可以,而不需要操心究竞应该请求哪一个Pod。

优势非常明显:一方 面外部用户不需要感知因为Pod. 上服务 的意外崩溃、K8S重新拉起Pod 而造成的IP变更,外部用户也不需要感知因升级、变更服务带来的Pod替换而造成的IP变化。

5.4Ingress

Service主要负责K8S集群内部的网络拓扑,那么集群外部怎么访问集群内部呢?这个时候就需要Ingress 了。Ingress 是整个K8S集群的接入层,负责集群内外通讯。

Ingress是K8S 集群里工作在oSI网络参考模型下,第7层的应用,对外暴露的接口,典型的访问方式是http/https.

Service只能进行第四层的流量调度,表现形式是iptport。 Ingress 则可以调度不同业务域、不同URL访问路径的业务流量。

比如:客户端请求http://www. kgc。com:port ---> Ingress ---> Service ---> Pod

5.5Name

由于K8S内部,使用“资源”来定义每一种逻辑概念(功能),所以每种“资源”,都应该有自己的“名称”。

“资源”有api 版本(apiversion) 、类别(kind) 、元数据(metadata) 、定义清单(spec) 、状态(status) 等配置信息。

“名称”通常定义在“资源”的“元数据”信息里。在同一个namespace 空间中必须是唯一的。

5.6Namespace

随着项目增多、人员增加、集群规模的扩大,需要一.种能够逻辑.上隔离K8S内各种“资源”的方法,这就是Namespace 。

Namespace是为了把一个K8S集群划分为若干个资源不可共享的虚拟集群组而诞生的。

不同Namespace 内的“资源”名称可以相同,相同Namespace 内的同种“资源”,“名称”不能相同。

合理的使用K8S的Namespace,可以使得集群管理员能够更好的对交付到K8S里的服务进行分类管理和浏览。

K8S里默认存在的Namespace 有: default、kube-system、kube-public等。

查询K8S里特定“资源”要带上相应的Namespace

六:总结

kubernetes的本质是一组服务器集群,它可以在集群的每个节点上运行特定的程序,来对节点中的容器进行管理。目的是实现资源管理的自动化,