- 大数据处理技术:分布式文件系统HDFS

茜茜西西CeCe

hdfshadoop大数据HDFS-JAVA接口文件头歌Java

目录1实验名称:2实验目的3实验内容4实验原理5实验过程或源代码5.1HDFS的基本操作5.2HDFS-JAVA接口之读取文件5.3HDFS-JAVA接口之上传文件5.4HDFS-JAVA接口之删除文件6实验结果6.1HDFS的基本操作6.2HDFS-JAVA接口之读取文件6.3HDFS-JAVA接口之上传文件6.4HDFS-JAVA接口之删除文件1实验名称:分布式文件系统HDFS2实验目的1.理

- Linux教程(4)----[hive数据仓库工具]

.房东的猫

Linux教程(完善中~~)linux

Hive基本概念Hive简介什么是HiveHive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供类SQL查询功能。为什么使用Hive直接使用hadoop所面临的问题人员学习成本太高

- 【Hadoop】onekey_install脚本

菜萝卜子

Linuxhadoop大数据分布式

hosts[root@kafka01hadoop-script]#cat/etc/hosts127.0.0.1localhostlocalhost.localdomainlocalhost4localhost4.localdomain4::1localhostlocalhost.localdomainlocalhost6localhost6.localdomain6192.168.100.150k

- cdh6.3.2的hive使用apache paimon格式只能创建不能写报错的问题

明天,今天,此时

hivepaimon

前言 根据官网paimon安装教程,看上去简单,实则报错阻碍使用的信心。解决方法 原带的jars下的zstd开头的包旧了,重新下载zstd较新的包单独放到每个节点的hive/lib下; 然后将hdfsyarn用户下的mr-framework.tar.gz中的zstdjar包替换成新的版本。 重启就可以了总结 国外软件问题,尽量使用英文搜索,特别是google.。方法来源:http

- Hadoop与云原生集成:弹性扩缩容与OSS存储分离架构深度解析

Hadoop与云原生集成的必要性Hadoop在大数据领域的基石地位作为大数据处理领域的奠基性技术,Hadoop自2006年诞生以来已形成包含HDFS、YARN、MapReduce三大核心组件的完整生态体系。根据CSDN技术社区的分析报告,全球超过75%的《财富》500强企业仍在使用Hadoop处理EB级数据,其分布式文件系统HDFS通过数据分片(默认128MB块大小)和三副本存储机制,成功解决了P

- ETL可视化工具 DataX -- 简介( 一)

dazhong2012

软件工具数据仓库dataxETL

引言DataX系列文章:ETL可视化工具DataX–安装部署(二)ETL可视化工具DataX–DataX-Web安装(三)1.1DataX1.1.1DataX概览DataX是阿里云DataWorks数据集成的开源版本,在阿里巴巴集团内被广泛使用的离线数据同步工具/平台。DataX实现了包括MySQL、Oracle、OceanBase、SqlServer、Postgre、HDFS、Hive、ADS、

- Hive简介

文章目录Hive简介Hive特点Hive和RDBMS的对比Hive的架构Hive的数据组织Hive数据类型Hive简介1、Hive由Facebook实现并开源2、是基于Hadoop的一个数据仓库工具3、可以将结构化的数据映射为一张数据库表4、并提供HQL(HiveSQL)查询功能5、底层数据是存储在HDFS上6、Hive的本质是将SQL语句转换为MapReduce任务运行7、使不熟悉MapRedu

- python基于Hadoop的NBA球员大数据分析与可视化系统

目录技术栈介绍具体实现截图系统设计研究方法:设计步骤设计流程核心代码部分展示研究方法详细视频演示试验方案论文大纲源码获取/详细视频演示技术栈介绍Django-SpringBoot-php-Node.js-flask本课题的研究方法和研究步骤基本合理,难度适中,本选题是学生所学专业知识的延续,符合学生专业发展方向,对于提高学生的基本知识和技能以及钻研能力有益。该学生能够在预定时间内完成该课题的设计。

- 大数据技术之集群数据迁移

dfs.namenode.rpc-address.nameservice1.namenode30hadoop104:8020dfs.namenode.rpc-address.nameservice1.namenode37hadoop106:8020dfs.namenode.http-address.nameservice1.namenode30hadoop104:9870dfs.namenode.

- HIVE(二)

2301_78012738

hive数据仓库

目录访问HIVE的三种方式DDLDML数据操作向表中装载数据数据导出常用函数Like和RLike分组Join排序分区表和分桶表访问HIVE的三种方式启动Hive命令,CtrlC退出客户端,执行测试语句,与sql一致[wyc@hadoop102hive]$bin/hive经验小结:在hive中执行语句报错:ExecutionError,returncode2fromorg.apache.hadoop

- 安全运维的 “五层防护”:构建全方位安全体系

KKKlucifer

安全运维

在数字化运维场景中,异构系统复杂、攻击手段隐蔽等挑战日益突出。保旺达基于“全域纳管-身份认证-行为监测-自动响应-审计溯源”的五层防护架构,融合AI、零信任等技术,构建全链路安全运维体系,以下从技术逻辑与实践落地展开解析:第一层:全域资产纳管——筑牢安全根基挑战云网基础设施包含分布式计算(Hadoop/Spark)、数据流处理(Storm/Flink)等异构组件,通信协议繁杂,传统方案难以全面纳管

- ftp文件服务器有连接数限制,查看ftp服务器连接数命令

赵承铭

ftp文件服务器有连接数限制

查看ftp服务器连接数命令内容精选换一换本章节适用于MRS3.x之前版本。Loader支持以下多种连接,每种连接的配置介绍可根据本章节内容了解。obs-connectorgeneric-jdbc-connectorftp-connector或sftp-connectorhbase-connector、hdfs-connector或hive-connectorOBS连接是Loa“数据导入”章节适用于

- Hive 事务表(ACID)问题梳理

文章目录问题描述分析原因什么是事务表概念事务表和普通内部表的区别相关配置事务表的适用场景注意事项设计原理与实现文件管理格式参考博客问题描述工作中需要使用pyspark读取Hive中的数据,但是发现可以获取metastore,外部表的数据可以读取,内部表数据有些表报错信息是:AnalysisException:org.apache.hadoop.hive.ql.metadata.HiveExcept

- ClickHouse高频面试题

野老杂谈

数据库

ClickHouse高频面试题1、简单介绍一下ClickHouse2、ClickHouse具有哪些特点3、ClickHouse作为一款高性能OLAP数据库,存在哪些不足4、ClickHouse有哪些表引擎5、介绍下Log系列表引擎应用场景共性特点不支持6、简单介绍下MergeTree系列引擎7、简单介绍下外部集成表引擎ODBCJDBCMySQLHDFSKafkaRabbitMQ8、ClickHou

- Docker快速构建Hive测试环境

静谧星光

dockerhive容器编程

Docker是一种流行的容器化平台,可以帮助我们快速构建和管理应用程序的环境。在本文中,我们将学习如何使用Docker快速构建Hive测试环境。Hive是一个基于Hadoop的数据仓库基础设施,它提供了一种类似于SQL的查询语言,用于分析和处理大规模数据集。步骤1:安装Docker和DockerCompose首先,我们需要安装Docker和DockerCompose。您可以根据您的操作系统类型,从

- HDFS 伪分布模式搭建与使用全攻略(适合初学者 & 开发测试环境)

huihui450

hdfshadoop大数据

HDFS(HadoopDistributedFileSystem)作为Hadoop生态系统的核心组件,广泛应用于海量数据的分布式存储场景。对于开发者而言,伪分布模式提供了一种低成本、高还原度的学习与测试方式。本文将详细介绍如何在本地搭建并使用HDFS的伪分布模式,包括环境准备、配置过程、常用命令及常见问题排查,帮助你快速入门Hadoop分布式文件系统的实践操作。一、什么是伪分布模式?Hadoop有

- MapReduce学习笔记

1.MapReduce做什么Mapper负责“分”,即把复杂的任务分解为若干个“简单的任务”来处理。Reducer负责对map阶段的结果进行汇总。2.MapReduce工作机制实体一:客户端,用来提交MapReduce作业。实体二:JobTracker,用来协调作业的运行。实体三:TaskTracker,用来处理作业划分后的任务。实体四:HDFS,用来在其它实体间共享作业文件。3.编写MapRed

- YARN container cpu超核如何解决

fzip

YARN超核

在ApacheHadoopYARN中,ContainerCPU超核(即Container使用的CPU资源超过分配量)是一个常见问题,可能导致集群性能下降或不稳定。以下是解决该问题的详细步骤:1.问题诊断1.1确认超核现象查看YARNWebUI:访问http://:8088,检查Container的CPU使用率是否持续超过分配的vCore数。检查NodeManager日志:查看/var/log/ha

- Hadoop-Mapreduce入门

Hadoop-Mapreduce入门MapReduce介绍mapreduce设计MapReduce编程规范入门案例WordCountMapReduce介绍MapReduce的思想核心是“分而治之”,适用于大量复杂的任务处理场景(大规模数据处理场景)。知识。Map负责“分”,把复杂的任务分解为若干个“简单的任务”来并行处理。可以进行拆分的前提是这些小任务可以并行计算,彼此间几乎没有依赖关系。Redu

- Hadoop MapReduce入门

且行且安~

数据分析进阶之路Linux命令hadoopMapReduce入门

入门简介计算过程分为两个阶段Map和ReduceMap阶段并行处理输入数据Reduce阶段对Map结果进行汇总针对python语言来说:map函数或者reduce函数来说,输出的数据格式为元组tuple一个简单的MapReduce程序只需要指定map()reduce()input()output()剩下的由框架完成。Linux常见命令:-读取文件(文本文件,在Windows下使用记事本打开的文件)

- Hadoop MapReduce 入门

一、Hadoop3.0.4环境准备1.环境要求Java8(Hadoop3.0.4不支持Java11+)单节点或多节点Linux系统(推荐Ubuntu18.04+)至少4GB内存(建议8GB+)50GB以上磁盘空间2.安装Java#安装Java8sudoapt-getinstallopenjdk-8-jdk#验证安装java-version3.下载与安装Hadoop3.0.4#下载Hadoop3.0

- 管理大数据存储的十大技巧

weixin_34238633

大数据数据库运维

在1990年,每一台应用服务器都倾向拥有直连式系统(DAS)。SAN的构建则是为了更大的规模和更高的效率提供共享的池存储。Hadoop已经逆转了这一趋势回归DAS。每一个Hadoop集群都拥有自身的——虽然是横向扩展型——直连式存储,这有助于Hadoop管理数据本地化,但也放弃了共享存储的规模和效率。如果你拥有多个实例或Hadoop发行版,那么你就将得到多个横向扩展的存储集群。而我们所遇到的最大挑

- MapReduce数据处理过程2万字保姆级教程

大模型大数据攻城狮

mapreduce大数据yarncdhhadoop大数据面试shuffle

目录1.MapReduce的核心思想:分而治之的艺术2.HadoopMapReduce的架构:从宏观到微观3.WordCount实例:从代码到执行的完整旅程4.源码剖析:Job.submit的魔法5.Map任务的执行:从分片到键值对6.Shuffle阶段:MapReduce的幕后英雄7.Reduce任务的执行:从数据聚合到最终输出8.Combiner的魔法:提前聚合的性能利器9.Partition

- Hadoop核心组件最全介绍

Cachel wood

大数据开发hadoop大数据分布式spark数据库计算机网络

文章目录一、Hadoop核心组件1.HDFS(HadoopDistributedFileSystem)2.YARN(YetAnotherResourceNegotiator)3.MapReduce二、数据存储与管理1.HBase2.Hive3.HCatalog4.Phoenix三、数据处理与计算1.Spark2.Flink3.Tez4.Storm5.Presto6.Impala四、资源调度与集群管

- 数据仓库技术及应用(Hive 产生背景与架构设计,存储模型与数据类型)

娟恋无暇

数据仓库笔记hive

1.Hive产生背景传统Hadoop架构存在的一些问题:MapReduce编程必须掌握Java,门槛较高传统数据库开发、DBA、运维人员学习门槛高HDFS上没有Schema的概念,仅仅是一个纯文本文件Hive的产生:为了让用户从一个现有数据基础架构转移到Hadoop上现有数据基础架构大多基于关系型数据库和SQL查询Facebook诞生了Hive2.Hive是什么官网:https://hive.ap

- 缺少关键的 MapReduce 框架文件

计算圆周率时提醒Hadoop集群缺少关键的MapReduce框架文件mr-framework.tar.gz在http://master:7180/cmf/services/4/status里直接安装再次运行代码:

- 大数据 ETL 工具 Sqoop 深度解析与实战指南

一、Sqoop核心理论与应用场景1.1设计思想与技术定位Sqoop是Apache旗下的开源数据传输工具,核心设计基于MapReduce分布式计算框架,通过并行化的Map任务实现高效的数据批量迁移。其特点包括:批处理特性:基于MapReduce作业实现导入/导出,适合大规模离线数据迁移,不支持实时数据同步。异构数据源连接:支持关系型数据库(如MySQL、Oracle)与Hadoop生态(HDFS、H

- 安装Hadoop集群&入门&源码编译

只年

大数据Hadoophadoop大数据分布式

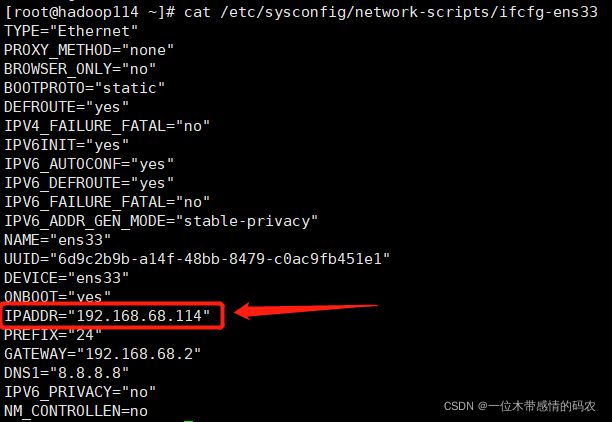

安装Hadoop集群完全分布式先决条件准备三台机器NameStaticIPDESCbigdata102192.168.1.102DataNode、NodeManager、NameNodebigdata103192.168.1.103DataNode、NodeManager、ResourceManagerbigdata104192.168.1.104DataNode、NodeManager、Seco

- Hadoop之HDFS

只年

大数据HadoopHDFShadoophdfs大数据

Hadoop之HDFSHDFS的Shell操作启动Hadoop集群(方便后续测试)[atguigu@hadoop102~]$sbin/start-dfs.sh[atguigu@hadoop102~]$sbin/start-yarn.sh-help:输出这个命令参数[atguigu@hadoop102~]$hadoopfs-helprm-ls:显示目录信息[atguigu@hadoop102~]$h

- 安装Python3.12报错:HTTP 429 TOO MANY REQUESTS for url <https://mirrors.ustc.edu.cn/anaconda/pkgs/free/li

安装Python3.12报错(base)[xxx@hadoop104python_shell]$condacreate--namepythonThirteenpython=3.12报错如下:Retrievingnotices:…working…ERRORconda.notices.fetch:get_channel_notice_response(63):Requesterrorforchanne

- web前段跨域nginx代理配置

刘正强

nginxcmsWeb

nginx代理配置可参考server部分

server {

listen 80;

server_name localhost;

- spring学习笔记

caoyong

spring

一、概述

a>、核心技术 : IOC与AOP

b>、开发为什么需要面向接口而不是实现

接口降低一个组件与整个系统的藕合程度,当该组件不满足系统需求时,可以很容易的将该组件从系统中替换掉,而不会对整个系统产生大的影响

c>、面向接口编口编程的难点在于如何对接口进行初始化,(使用工厂设计模式)

- Eclipse打开workspace提示工作空间不可用

0624chenhong

eclipse

做项目的时候,难免会用到整个团队的代码,或者上一任同事创建的workspace,

1.电脑切换账号后,Eclipse打开时,会提示Eclipse对应的目录锁定,无法访问,根据提示,找到对应目录,G:\eclipse\configuration\org.eclipse.osgi\.manager,其中文件.fileTableLock提示被锁定。

解决办法,删掉.fileTableLock文件,重

- Javascript 面向对面写法的必要性?

一炮送你回车库

JavaScript

现在Javascript面向对象的方式来写页面很流行,什么纯javascript的mvc框架都出来了:ember

这是javascript层的mvc框架哦,不是j2ee的mvc框架

我想说的是,javascript本来就不是一门面向对象的语言,用它写出来的面向对象的程序,本身就有些别扭,很多人提到js的面向对象首先提的是:复用性。那么我请问你写的js里有多少是可以复用的,用fu

- js array对象的迭代方法

换个号韩国红果果

array

1.forEach 该方法接受一个函数作为参数, 对数组中的每个元素

使用该函数 return 语句失效

function square(num) {

print(num, num * num);

}

var nums = [1,2,3,4,5,6,7,8,9,10];

nums.forEach(square);

2.every 该方法接受一个返回值为布尔类型

- 对Hibernate缓存机制的理解

归来朝歌

session一级缓存对象持久化

在hibernate中session一级缓存机制中,有这么一种情况:

问题描述:我需要new一个对象,对它的几个字段赋值,但是有一些属性并没有进行赋值,然后调用

session.save()方法,在提交事务后,会出现这样的情况:

1:在数据库中有默认属性的字段的值为空

2:既然是持久化对象,为什么在最后对象拿不到默认属性的值?

通过调试后解决方案如下:

对于问题一,如你在数据库里设置了

- WebService调用错误合集

darkranger

webservice

Java.Lang.NoClassDefFoundError: Org/Apache/Commons/Discovery/Tools/DiscoverSingleton

调用接口出错,

一个简单的WebService

import org.apache.axis.client.Call;import org.apache.axis.client.Service;

首先必不可

- JSP和Servlet的中文乱码处理

aijuans

Java Web

JSP和Servlet的中文乱码处理

前几天学习了JSP和Servlet中有关中文乱码的一些问题,写成了博客,今天进行更新一下。应该是可以解决日常的乱码问题了。现在作以下总结希望对需要的人有所帮助。我也是刚学,所以有不足之处希望谅解。

一、表单提交时出现乱码:

在进行表单提交的时候,经常提交一些中文,自然就避免不了出现中文乱码的情况,对于表单来说有两种提交方式:get和post提交方式。所以

- 面试经典六问

atongyeye

工作面试

题记:因为我不善沟通,所以在面试中经常碰壁,看了网上太多面试宝典,基本上不太靠谱。只好自己总结,并试着根据最近工作情况完成个人答案。以备不时之需。

以下是人事了解应聘者情况的最典型的六个问题:

1 简单自我介绍

关于这个问题,主要为了弄清两件事,一是了解应聘者的背景,二是应聘者将这些背景信息组织成合适语言的能力。

我的回答:(针对技术面试回答,如果是人事面试,可以就掌

- contentResolver.query()参数详解

百合不是茶

androidquery()详解

收藏csdn的博客,介绍的比较详细,新手值得一看 1.获取联系人姓名

一个简单的例子,这个函数获取设备上所有的联系人ID和联系人NAME。

[java]

view plain

copy

public void fetchAllContacts() {

- ora-00054:resource busy and acquire with nowait specified解决方法

bijian1013

oracle数据库killnowait

当某个数据库用户在数据库中插入、更新、删除一个表的数据,或者增加一个表的主键时或者表的索引时,常常会出现ora-00054:resource busy and acquire with nowait specified这样的错误。主要是因为有事务正在执行(或者事务已经被锁),所有导致执行不成功。

1.下面的语句

- web 开发乱码

征客丶

springWeb

以下前端都是 utf-8 字符集编码

一、后台接收

1.1、 get 请求乱码

get 请求中,请求参数在请求头中;

乱码解决方法:

a、通过在web 服务器中配置编码格式:tomcat 中,在 Connector 中添加URIEncoding="UTF-8";

1.2、post 请求乱码

post 请求中,请求参数分两部份,

1.2.1、url?参数,

- 【Spark十六】: Spark SQL第二部分数据源和注册表的几种方式

bit1129

spark

Spark SQL数据源和表的Schema

case class

apply schema

parquet

json

JSON数据源 准备源数据

{"name":"Jack", "age": 12, "addr":{"city":"beijing&

- JVM学习之:调优总结 -Xms -Xmx -Xmn -Xss

BlueSkator

-Xss-Xmn-Xms-Xmx

堆大小设置JVM 中最大堆大小有三方面限制:相关操作系统的数据模型(32-bt还是64-bit)限制;系统的可用虚拟内存限制;系统的可用物理内存限制。32位系统下,一般限制在1.5G~2G;64为操作系统对内存无限制。我在Windows Server 2003 系统,3.5G物理内存,JDK5.0下测试,最大可设置为1478m。典型设置:

java -Xmx355

- jqGrid 各种参数 详解(转帖)

BreakingBad

jqGrid

jqGrid 各种参数 详解 分类:

源代码分享

个人随笔请勿参考

解决开发问题 2012-05-09 20:29 84282人阅读

评论(22)

收藏

举报

jquery

服务器

parameters

function

ajax

string

- 读《研磨设计模式》-代码笔记-代理模式-Proxy

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.lang.reflect.InvocationHandler;

import java.lang.reflect.Method;

import java.lang.reflect.Proxy;

/*

* 下面

- 应用升级iOS8中遇到的一些问题

chenhbc

ios8升级iOS8

1、很奇怪的问题,登录界面,有一个判断,如果不存在某个值,则跳转到设置界面,ios8之前的系统都可以正常跳转,iOS8中代码已经执行到下一个界面了,但界面并没有跳转过去,而且这个值如果设置过的话,也是可以正常跳转过去的,这个问题纠结了两天多,之前的判断我是在

-(void)viewWillAppear:(BOOL)animated

中写的,最终的解决办法是把判断写在

-(void

- 工作流与自组织的关系?

comsci

设计模式工作

目前的工作流系统中的节点及其相互之间的连接是事先根据管理的实际需要而绘制好的,这种固定的模式在实际的运用中会受到很多限制,特别是节点之间的依存关系是固定的,节点的处理不考虑到流程整体的运行情况,细节和整体间的关系是脱节的,那么我们提出一个新的观点,一个流程是否可以通过节点的自组织运动来自动生成呢?这种流程有什么实际意义呢?

这里有篇论文,摘要是:“针对网格中的服务

- Oracle11.2新特性之INSERT提示IGNORE_ROW_ON_DUPKEY_INDEX

daizj

oracle

insert提示IGNORE_ROW_ON_DUPKEY_INDEX

转自:http://space.itpub.net/18922393/viewspace-752123

在 insert into tablea ...select * from tableb中,如果存在唯一约束,会导致整个insert操作失败。使用IGNORE_ROW_ON_DUPKEY_INDEX提示,会忽略唯一

- 二叉树:堆

dieslrae

二叉树

这里说的堆其实是一个完全二叉树,每个节点都不小于自己的子节点,不要跟jvm的堆搞混了.由于是完全二叉树,可以用数组来构建.用数组构建树的规则很简单:

一个节点的父节点下标为: (当前下标 - 1)/2

一个节点的左节点下标为: 当前下标 * 2 + 1

&

- C语言学习八结构体

dcj3sjt126com

c

为什么需要结构体,看代码

# include <stdio.h>

struct Student //定义一个学生类型,里面有age, score, sex, 然后可以定义这个类型的变量

{

int age;

float score;

char sex;

}

int main(void)

{

struct Student st = {80, 66.6,

- centos安装golang

dcj3sjt126com

centos

#在国内镜像下载二进制包

wget -c http://www.golangtc.com/static/go/go1.4.1.linux-amd64.tar.gz

tar -C /usr/local -xzf go1.4.1.linux-amd64.tar.gz

#把golang的bin目录加入全局环境变量

cat >>/etc/profile<

- 10.性能优化-监控-MySQL慢查询

frank1234

性能优化MySQL慢查询

1.记录慢查询配置

show variables where variable_name like 'slow%' ; --查看默认日志路径

查询结果:--不用的机器可能不同

slow_query_log_file=/var/lib/mysql/centos-slow.log

修改mysqld配置文件:/usr /my.cnf[一般在/etc/my.cnf,本机在/user/my.cn

- Java父类取得子类类名

happyqing

javathis父类子类类名

在继承关系中,不管父类还是子类,这些类里面的this都代表了最终new出来的那个类的实例对象,所以在父类中你可以用this获取到子类的信息!

package com.urthinker.module.test;

import org.junit.Test;

abstract class BaseDao<T> {

public void

- Spring3.2新注解@ControllerAdvice

jinnianshilongnian

@Controller

@ControllerAdvice,是spring3.2提供的新注解,从名字上可以看出大体意思是控制器增强。让我们先看看@ControllerAdvice的实现:

@Target(ElementType.TYPE)

@Retention(RetentionPolicy.RUNTIME)

@Documented

@Component

public @interface Co

- Java spring mvc多数据源配置

liuxihope

spring

转自:http://www.itpub.net/thread-1906608-1-1.html

1、首先配置两个数据库

<bean id="dataSourceA" class="org.apache.commons.dbcp.BasicDataSource" destroy-method="close&quo

- 第12章 Ajax(下)

onestopweb

Ajax

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- BW / Universe Mappings

blueoxygen

BO

BW Element

OLAP Universe Element

Cube Dimension

Class

Charateristic

A class with dimension and detail objects (Detail objects for key and desription)

Hi

- Java开发熟手该当心的11个错误

tomcat_oracle

java多线程工作单元测试

#1、不在属性文件或XML文件中外化配置属性。比如,没有把批处理使用的线程数设置成可在属性文件中配置。你的批处理程序无论在DEV环境中,还是UAT(用户验收

测试)环境中,都可以顺畅无阻地运行,但是一旦部署在PROD 上,把它作为多线程程序处理更大的数据集时,就会抛出IOException,原因可能是JDBC驱动版本不同,也可能是#2中讨论的问题。如果线程数目 可以在属性文件中配置,那么使它成为

- 推行国产操作系统的优劣

yananay

windowslinux国产操作系统

最近刮起了一股风,就是去“国外货”。从应用程序开始,到基础的系统,数据库,现在已经刮到操作系统了。原因就是“棱镜计划”,使我们终于认识到了国外货的危害,开始重视起了信息安全。操作系统是计算机的灵魂。既然是灵魂,为了信息安全,那我们就自然要使用和推行国货。可是,一味地推行,是否就一定正确呢?

先说说信息安全。其实从很早以来大家就在讨论信息安全。很多年以前,就据传某世界级的网络设备制造商生产的交

![]()

![]()

![]()

![]()