大模型基础原理与未来的机遇挑战

点击蓝字

关注我们

AI TIME欢迎每一位AI爱好者的加入!

大模型如今正成为人工智能领域的热点话题,引发了大众广泛的兴趣与探讨。作为一项前沿的技术,大模型为我们带来了无尽的可能性,它们能够模仿并创造人类语言,解答各种问题,并在多个领域中展现出卓越的能力。

2023年8月10日,由北京科技国际交流中心支持的大模型主题科普论坛暨首都海智创新链接系列活动,邀请了宾夕法尼亚大学副教授苏炜杰,中国人民大学副教授刘勇。两位嘉宾从大模型基础理论、ChatGPT原理、机遇与挑战等角度为观众带来一场精彩纷呈的大模型科普论坛,让大家对大模型的底层逻辑和未来发展有了更深入的认识。本次活动共吸引了超2万人线上观看。

语言模型基础理论科普:关于对齐技术的应用与挑战

苏炜杰老师首先介绍了大语言模型的概念和影响。大语言模型使用了Transformer架构,是一种基于注意力机制神经网络架构,主要使用next token prediction进行训练,输入与输出都是以文本形式。此外,大语言模型的影响力也无处不在,比如:它让图灵测试看起来有点过时,它擅长代码、写作和总结,能够以更快的方式获取长文本中的信息,它对劳动力市场有着较大的影响,它有着巨大的商业价值,可以增加生产力。它也将极大地改变教育形式,提供了实时学习的可能性……

苏老师介绍到其最近关于数据科学的一篇工作《What Should Data Science Education Do with Large Language Models?》,其中指出在大语言模型来临之后,对人类纯粹记忆性能力的要求会有所降低,现在更强调一种抽象的能力,对未来人才的培养需要更看重对问题本质的剖析能力,这样才能更好地评价和改进AI对人类问题做出的解答。关于大模型对劳动市场的影响,苏老师提出了“Complete-information”的概念,如果工作的输入和输出信息比较完整并且边界清晰,那么这种形式的工作会更容易被取代,比如程序员、会计、司机等职业。理论计算机科学家、物理学家、数学家等对人类智商要求较高的工作也有可能被AI取代。总体而言,AI可以做的事情与人类相比是有很大不同的。

如何更好地进行大语言模型的相关研究?

从计算资源来讲,大语言模型的研究需要大量的GPU,大多数的团队都很难有充足的计算资源,比如A100等;其次,GPT-3的参数众多,十分复杂,截至目前学术圈尚不能够对next-token prediction的理论作出解释。因此,从个人的层面看,Alignment是进行大语言模型研究的一个机遇。

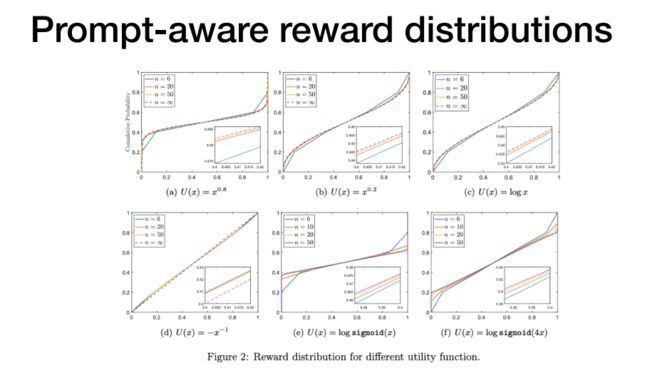

Alignment使得GPT-3发展成为ChatGPT真正出圈,它的本质是让大语言模型的行为方式与人的价值和思想变得一致,它也是LLM训练过程中必不可少的一步。苏老师介绍了一篇工作《Reward Collapse in Aligning Large Language Models》。RLHF即基于人类反馈的强化学习,首先根据人工标注数据微调监督模型,然后训练一个奖励函数,最后在奖励模型上通过近端策略优化进行强化学习。该篇工作提出了一种通过实验发现并理论分析的“Reward Collapse”现象,即训练奖励模型时,不同的提示可能会产生相同的奖励分布。该现象在训练的终端阶段发生。此外,文中还提出了一种原则性的方法来缓解“Reward Collapse”问题,即根据提示使用不同的效用函数来训练奖励模型,以使得奖励分布可以根据提示是开放式还是封闭式而广泛分散或紧密集中。

关于未来alignment发展的思考

第一,公平和隐私问题:大语言模型需要更好地反映每一个人的想法,每个人的观点需要被平等地表达。大语言模型也可能存在泄露敏感信息的风险,造成不利后果,未来需要不断改进数据和算法,深入探讨大语言模型的内在机理,从而降低这类风险。

第二,Alignment tax:随着能力的增加,对齐的代价会趋于零吗?或者这种代价永远不会消失?这在未来需要深入探索。

Alignment in superhuman era:未来十年之内是否一定会出现AGI,是否会对alignment造成一定冲击?

未来发展的机遇和问题

大语言模型的预测能力和解释能力是会有矛盾的,在某些特定领域我们可以有所侧重。比如在医学上我们更关注可解释性,那么就需要稍微牺牲预测能力,用一个相对较弱的AI进行预测,用一个更强的AI进行解释。此外,人类应该设计一种机制让一部分AI保护自己,同时依赖多个AI,让AI之间相互竞争,形成对抗。

大模型未来的发展还面临诸多重要的问题,如ChatGPT训练语料中有受专利保护的数据,数据资源间如何形成市场,训练数据的输出能够保证被验证,next token prediction如何保持一致等。

ChatGPT:原理、机遇与挑战

ChatGPT是什么?

刘勇老师首先为大家介绍了ChatGPT的基本概念,并从人工智能分级的角度阐述了ChatGPT受众广泛的原因。ChatGPT本质上是通过从大规模语料库中学习语言规律,从而生成与人类语言相似的输出。它表现为一个对话机器人,能够理解自然语言,进行高质量的多轮对话,成为人类工作、生活的重要智能助手。根据已有程序是否具有人的特性,如灵活性、自适应性、可解释性等,可以将人工智能分级为五级,0级完成固定流程任务;1级完成特定任务,模型自学习;2级-具有多任务自适应性,能完成推理任务的通用性AI;3级-具有创造性;4级-具有自我意识。而ChatGPT已经具备了一些通用人工智能的特性,能够进行人机对话,完成多种形式的任务。

ChatGPT的特点

ChatGPT的优点:

知识广博:上知天文、下知地理,不仅能写文章、还能写代码;

有条有理:能有逻辑地组合知识形成答案,具有一定的推理能力;

善解人意:能准确理解用户意图,三观比较正,并且承认自己不知道;

交互能力强:在多轮对话中不走神,交互聚焦主题;

逻辑性强、正确性高:能够根据所给信息推断出正确答案,在综合能力测试中显示出较高的水平。

ChatGPT的缺点:

无法实时纳入新知识,特定领域的专业知识不足,可能会一本正经地胡说八道,仅支持文本生成,算力消耗巨大。

ChatGPT基本原理

传统的监督学习方法需要大量人工标注的数据,但是数据标注耗时且成本较高,于是,自监督学习应运而生。对于无标签数据,通过设计辅助任务来挖掘数据自身的表征特性作为监督信息,来提升模型的特征提取能力,解决了大量标注数据的问题。

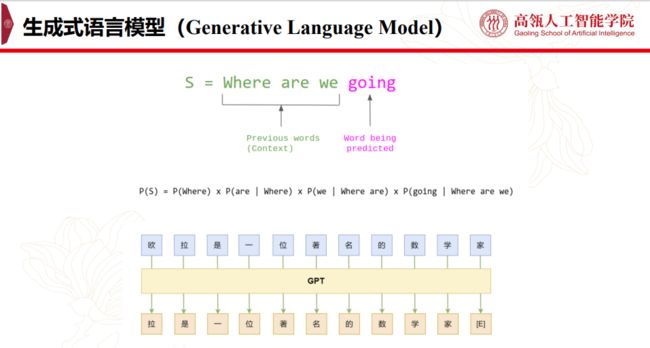

关于文本的标注,在掩码语言模型中,基于“完形填空”的思想,在预训练任务直接将输入文本中的部分单词Mask(遮住),并通过深层Transformer模型还原为原单词,迫使模型使用被遮住的词的上下文信息进行预测该词。ChatGPT基于生成式语言模型,利用上下文信息和语义理解生成连贯的句子或段落。

ChatGPT法宝

首先,ChatGPT是大力出奇迹的典范,具有大数据、大模型、大算力,有强大的涌现能力和参数化的知识能力;

其次,思维链使得大模型更好地进行逻辑训练,可以将大问题拆分成多个简单的小问题,或者给出一个提示,引导大模型逐步解决问题。

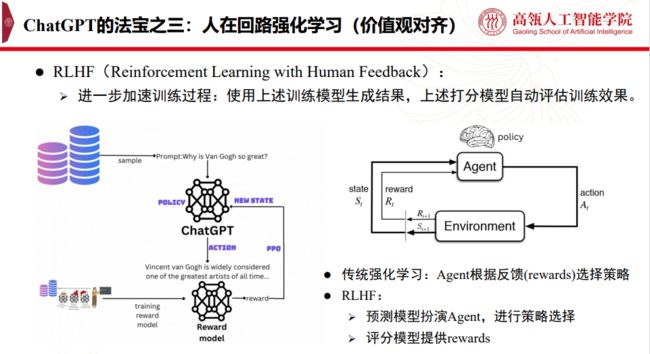

第三,利用强化学习实现价值观对齐,ChatGPT先收集人类真实指令用于初始训练,然后使用模型得到预测结果并按照回答质量排序,训练出打分模型,最后进一步加速训练过程。

第四,ChatGPT的背后有着高质量的数据和优秀的工程团队,持续改进使得ChatGPT有了如今的效果。

ChatGPT的影响与风险

刘勇老师以一位博士生的课题为例,将其论文引言中的案例输入ChatGPT能够得到较为全面的回答,甚至效果优于专业领域,ChatGPT对特定研究领域的专业人才造成一定冲击。同时也会对教育行业带来一定挑战,传统的灌输式教育会被颠覆,对于学生的“创新”能力考核有一定难度,它会替代某些职业,迫使我们反思人才培养的能力体系设计。

除此之外,ChatGPT还会带来虚假信息风险,如学术不端、虚假信息传播、价值观风险等,如ChatGPT训练数据本身隐含着特定的价值倾向,训练方法也使得人们有机会将特定的价值观融入模型中。例如黑箱风险,ChatGPT输出的结果具有不确定性会产生误导性回答,AI设计者有可能通过操纵数据等方式影响AI的输出,从而影响用户的思想和行为,带来一定的社会风险;侵权风险,如ChatGPT训练使用的数据可能包含受著作权保护的作品,使用不当会侵犯著作权。

ChatGPT的挑战与机遇

ChatGPT的门槛很高,人类历史上很少出现过这样的复杂系统,研究这类模型需要大数据、大算力、大模型算法人才及用户反馈。此外,ChatGPT尚未开源,国内无法直接访问,训练ChatGPT的高性能显卡在国内禁售。

对于工业界,备受关注的ChatGPT,有望引发新一轮产业革命,这也是未来新的商机,但是首批掌握技术的公司会有先发优势。

对于学术界,ChatGPT已经被公认为是重大科技突破,使学者看到了通用人工智能的曙光。它将会根本性改变人工智能和人工智能+的研究范式,首批掌握该技术的学校会有先发优势,但是学术界面临的挑战是很难拥有限制ChatGPT的算力和数据。

对未来的展望

迈向通用人工智能的一条可能路径已经清晰,新的超级智能、超级工具已经出现,新的科技革命、研究范式已在眼前,未来我们要积极地拥抱大模型,拥抱大变革!

北京科技国际交流中心 (BISTEC)

北京科技国际交流中心(简称“中心”)在中国科协的指导下和市委市政府的领导下,按照市科协工作部署,围绕国际科技组织、海外科技人才以及国际及港澳台科技交流等开展具体工作,充分发挥科协系统民间科技交流渠道优势,深化对外科技交流成果,服务于国际科学传播,服务于海外人才成长发展,服务于基层科技创新,为加快建设国际科技创新中心、国际交往中心及高水平人才高地贡献力量。

通过建设首都海智基地,开展“创新链接”活动,搭建海外人才交流沟通平台,扩大联络海外科技人才覆盖面,创新服务海外人才工作模式,团结引领海外智力服务首都高质量发展。

整理:陈研

审核:苏炜杰、刘勇

提醒

点击“阅读原文”可以观看回放哦

往期精彩文章推荐

记得关注我们呀!每天都有新知识!

关于AI TIME

AI TIME源起于2019年,旨在发扬科学思辨精神,邀请各界人士对人工智能理论、算法和场景应用的本质问题进行探索,加强思想碰撞,链接全球AI学者、行业专家和爱好者,希望以辩论的形式,探讨人工智能和人类未来之间的矛盾,探索人工智能领域的未来。

迄今为止,AI TIME已经邀请了1100多位海内外讲者,举办了逾550场活动,超600万人次观看。

我知道你

在看

哦

~

点击 阅读原文 观看回放!