梯度下降之线性回归模型

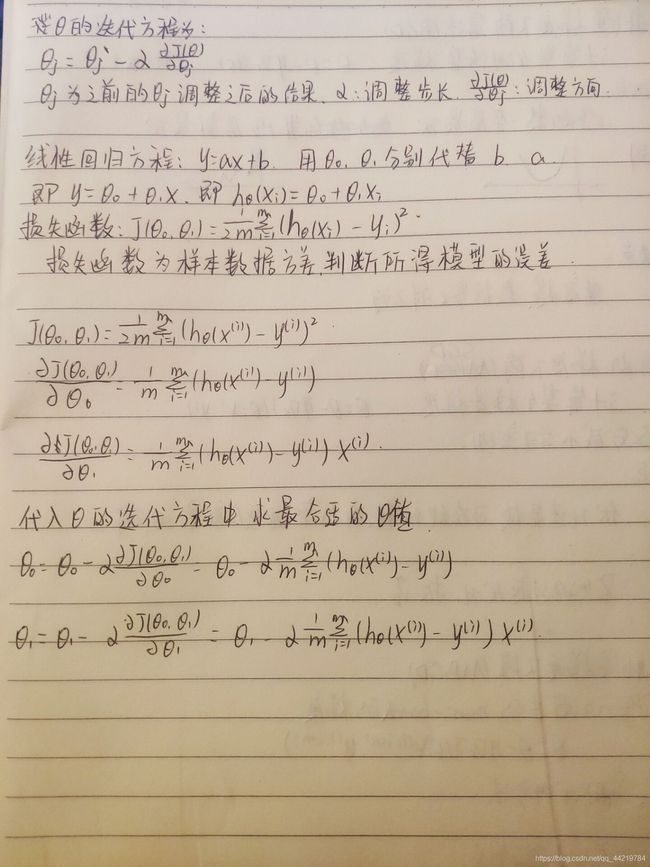

相关原理

线性回归的模型为:y=ax+b 我们就是利用已知的数据即x,y求出a,b

相关公式

梯度下降的求法

一、BGD(批量梯度下降)

此方法就是对所有的数据进行训练,找出最优解,如果对象为凸函数找出的为全局最优,非凸函数为局部最优,但是速度慢,数据量大的时候不适用

import matplotlib.pyplot as plt

import numpy as np

from math import pow

#引库

x=[1.5,2.0,2.5,3.0,3.5,4.0,6.0]

y=[6.45,7.45,8.45,9.45,11.45,15.45,18.45]

#需要引用的数据

#画出初始图像

#参数设置

alpha=0.1#步长

theta0=0

theta1=0

epsilon=0.01#允许误差值

m=len(x)

theta00=[]

theta11=[]

loss=[]

count=0

for time in range(10000):

count+=1

temp0=0

temp1=0

diss=0

for i in range (m):

temp0+=(theta0+theta1*x[i]-y[i])/m

temp1+=((theta0+theta1*x[i]-y[i])/m)*x[i]#theta1 theta0 的导数

theta0=theta0-alpha*temp0

theta1=theta1-alpha*temp1#theta1 theta0的更新值

theta00.append(theta0)

theta11.append(theta1)#存到数组里 方便画图

for i in range(m):

diss+=0.5*(1/m)*pow(theta0+theta1*x[i]-y[i],2)#判断误差

loss.append(diss)

if diss<=epsilon:

break#小于设定误差则跳出循环

theta1*=100

print("运行结果为: ")

print("theta0为:{} theta1为:{}\n".format(theta0,theta1))

plt.scatter(range(count),theta00,color='r')

plt.scatter(range(count),theta11,color='blue')

plt.scatter(range(count),loss,color='black')

plt.show()

#蓝色为theta1 红色为theta0 黑色为误差

二、SGD(随机梯度下降)

从样本中随机抽取数据进行训练,判断是否符合规定,优化速度快,有几率跳出局部最优解,但是容易过度优化,形成震荡

import matplotlib.pyplot as plt

import numpy as np

from math import pow

#引库

x=[1.5,2.0,2.5,3.0,3.5,4.0,6.0]

y=[6.45,7.45,8.45,9.45,11.45,15.45,18.45]

#需要引用的数据

#画出初始图像

#参数设置

alpha=0.1#步长

theta0=0

theta1=0

epsilon=0.01#允许误差值

m=len(x)

theta00=[]

theta11=[]

loss=[]

count=0

for time in range(10000):

count+=1

temp0=0

temp1=0

diss=0

for i in range (m):

temp0+=(theta0+theta1*x[i]-y[i])/m

temp1+=((theta0+theta1*x[i]-y[i])/m)*x[i]

theta0=theta0-alpha*temp0

theta1=theta1-alpha*temp1

theta00.append(theta0)

theta11.append(theta1)

rand_i=np.random.randint(0,m)

diss+=0.5*(1/m)*pow(theta0+theta1*x[rand_i]-y[rand_i],2)

loss.append(diss)

if diss<=epsilon:

break

theta1*=100

print("运行结果为: ")

print("theta0为:{} theta1为:{}\n".format(theta0,theta1))

plt.scatter(range(count),theta00,color='r')

plt.scatter(range(count),theta11,color='blue')

plt.scatter(range(count),loss,color='black')

plt.show()

#蓝色为theta1 红色为theta0 黑色为误差

三、MBGD(小批量梯度下降)

结合了BGD和SGD的优点,博主很懒,没有代码。