Zookeeper介绍及实战(一)

一、ZooKeeper介绍

ZooKeeper 是一个开源的分布式协调框架,是Apache Hadoop 的一个子项目,主要用来解决分布式集群中应用系统的一致性问题。Zookeeper 的设计目标是将那些复杂且容易出错的分布式一致性服务封装起来,构成一个高效可靠的原语集,并以一系列简单易用的接口提供给用户使用。

官方:Apache ZooKeeper

ZooKeeper本质上是一个分布式的小文件存储系统(Zookeeper=文件系统+监听机制)。提供基于类似于文件系统的目录树方式的数据存储,并且可以对树中的节点进行有效管理,从而用来维护和监控存储的数据的状态变化。通过监控这些数据状态的变化,从而可以达到基于数据的集群管理、统一命名服务、分布式配置管理、分布式消息队列、分布式锁、分布式协调等功能。

Zookeeper从设计模式角度来理解:是一个基于观察者模式设计的分布式服务管理框架,它负责存储和管理大家都关心的数据,然后接受观察者的注册,一旦这些数据的状态发生变化,Zookeeper 就将负责通知已经在Zookeeper上注册的那些观察者做出相应的反应。

二、Zookeeper实战

1、Zookeeper安装

下载地址:Apache ZooKeeper

运行环境:jdk8

1)修改配置文件

解压安装包后进入conf目录,复制zoo_sample.cfg,修改为zoo.cfg

cp zoo_sample.cfg zoo.cfg

修改 zoo.cfg 配置文件,将 dataDir=/tmp/zookeeper 修改为指定的data目录

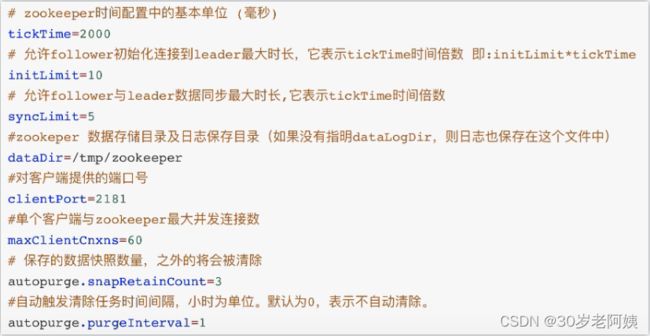

zoo.cfg中参数含义:

2)启动zookeeper server

# 可以通过 bin/zkServer.sh 来查看都支持哪些参数

# 默认加载配置路径conf/zoo.cfg

bin/zkServer.sh start conf/zoo.cfg

# 查看zookeeper状态

bin/zkServer.sh status3)启动zookeeper client连接Zookeeper server

bin/zkCli.sh

# 连接远程的zookeeper server

bin/zkCli.sh -server ip:port客户端命令行操作

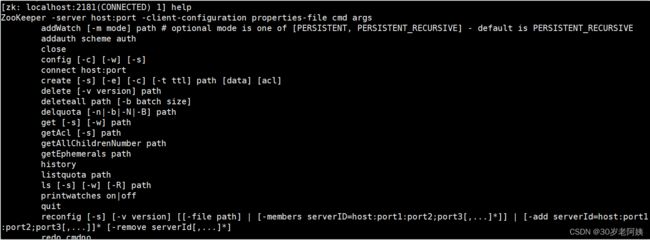

输入命令 help 查看zookeeper支持的所有命令:

常见cli命令

ZooKeeper: Because Coordinating Distributed Systems is a Zoo

| 命令基本语法 |

功能描述 |

| help |

显示所有操作命令 |

| ls [-s] [-w] [-R] path |

使用 ls 命令来查看当前 znode 的子节点 [可监听] -w: 监听子节点变化 -s: 节点状态信息(时间戳、版本号、数据大小等) -R: 表示递归的获取 |

| create [-s] [-e] [-c] [-t ttl] path [data] [acl] |

创建节点 -s : 创建有序节点。 -e : 创建临时节点。 -c : 创建一个容器节点。 t ttl] : 创建一个TTL节点, -t 时间(单位毫秒)。 data:节点的数据,可选,如果不使用时,节点数据就为null。 acl:访问控制 |

| get [-s] [-w] path |

获取节点数据信息 -s: 节点状态信息(时间戳、版本号、数据大小等) -w: 监听节点变化 |

| set [-s] [-v version] path data |

设置节点数据 -s:表示节点为顺序节点 -v: 指定版本号 |

| getAcl [-s] path |

获取节点的访问控制信息 -s: 节点状态信息(时间戳、版本号、数据大小等) |

| setAcl [-s] [-v version] [-R] path acl |

设置节点的访问控制列表 -s:节点状态信息(时间戳、版本号、数据大小等) -v:指定版本号 -R:递归的设置 |

| stat [-w] path |

查看节点状态信息 |

| delete [-v version] path |

删除某一节点,只能删除无子节点的节点。 -v: 表示节点版本号 |

| deleteall path |

递归的删除某一节点及其子节点 |

| setquota -n|-b val path |

对节点增加限制 n:表示子节点的最大个数 b:数据值的最大长度,-1表示无限制 |

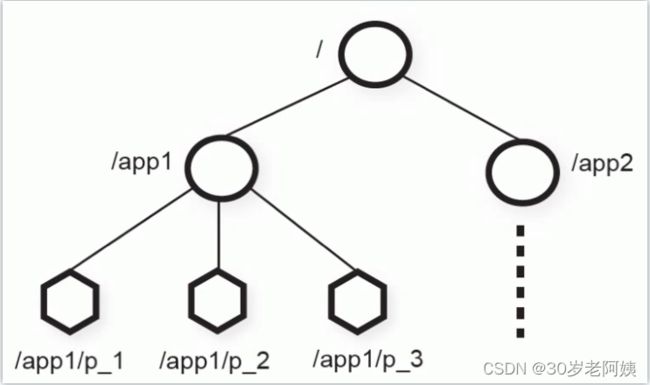

ZooKeeper数据结构

ZooKeeper 数据模型的结构与 Unix 文件系统很类似,整体上可以看作是一棵树,每个节点称做一个 ZNode。

ZooKeeper的数据模型是层次模型,层次模型常见于文件系统。层次模型和key-value模型是两种主流的数据模型。ZooKeeper使用文件系统模型主要基于以下两点考虑:

- 文件系统的树形结构便于表达数据之间的层次关系

- 文件系统的树形结构便于为不同的应用分配独立的命名空间( namespace )

ZooKeeper的层次模型称作Data Tree,Data Tree的每个节点叫作Znode。不同于文件系统,每个节点都可以保存数据,每一个 ZNode 默认能够存储 1MB 的数据,每个 ZNode 都可以通过其路径唯一标识,每个节点都有一个版本(version),版本从0开始计数。

public class DataTree {

private final ConcurrentHashMap nodes =

new ConcurrentHashMap();

private final WatchManager dataWatches = new WatchManager();

private final WatchManager childWatches = new WatchManager();

}

public class DataNode implements Record {

byte data[];

Long acl;

public StatPersisted stat;

private Set children = null;

} 节点分类

一个znode可以使持久性的,也可以是临时性的:

1. 持久节点(PERSISTENT): 这样的znode在创建之后即使发生ZooKeeper集群宕机或者client宕机也不会丢失。

2. 临时节点(EPHEMERAL ): client宕机或者client在指定的timeout时间内没有给ZooKeeper集群发消息,这样的znode就会消失。

如果上面两种znode具备顺序性,又有以下两种znode :

3. 持久顺序节点(PERSISTENT_SEQUENTIAL): znode除了具备持久性znode的特点之外,znode的名字具备顺序性。

4. 临时顺序节点(EPHEMERAL_SEQUENTIAL): znode除了具备临时性znode的特点之外,zorde的名字具备顺序性。

zookeeper主要用到的是以上4种节点。

5. Container节点 (3.5.3版本新增):Container容器节点,当容器中没有任何子节点,该容器节点会被zk定期删除(定时任务默认60s 检查一次)。 和持久节点的区别是 ZK 服务端启动后,会有一个单独的线程去扫描,所有的容器节点,当发现容器节点的子节点数量为 0 时,会自动删除该节点。可以用于 leader 或者锁的场景中。

6. TTL节点: 带过期时间节点,默认禁用,需要在zoo.cfg中添加 extendedTypesEnabled=true 开启。 注意:ttl不能用于临时节点

#创建持久节点

create /servers xxx

#创建临时节点

create -e /servers/host xxx

#创建临时有序节点

create -e -s /servers/host xxx

#创建容器节点

create -c /container xxx

# 创建ttl节点

create -t 10 /ttl

节点状态信息

- cZxid :Znode创建的事务id。

- ctime:节点创建时的时间戳。

- mZxid :Znode被修改的事务id,即每次对znode的修改都会更新mZxid。

对于zk来说,每次的变化都会产生一个唯一的事务id,zxid(ZooKeeper Transaction Id),通过zxid,可以确定更新操作的先后顺序。例如,如果zxid1小于zxid2,说明zxid1操作先于zxid2发生,zxid对于整个zk都是唯一的,即使操作的是不同的znode。

- pZxid: 表示该节点的子节点列表最后一次修改的事务ID,添加子节点或删除子节点就会影响子节点列表,但是修改子节点的数据内容则不影响该ID(注意: 只有子节点列表变更了才会变更pzxid,子节点内容变更不会影响pzxid)

- mtime:节点最新一次更新发生时的时间戳.

- cversion :子节点的版本号。当znode的子节点有变化时,cversion 的值就会增加1。

- dataVersion:数据版本号,每次对节点进行set操作,dataVersion的值都会增加1(即使设置的是相同的数据),可有效避免了数据更新时出现的先后顺序问题。

- ephemeralOwner:如果该节点为临时节点, ephemeralOwner值表示与该节点绑定的session id。如果不是, ephemeralOwner值为0(持久节点)。

在client和server通信之前,首先需要建立连接,该连接称为session。连接建立后,如果发生连接超时、授权失败,或者显式关闭连接,连接便处于closed状态, 此时session结束。

- dataLength : 数据的长度

- numChildren :子节点的数量(只统计直接子节点的数量)

监听通知(watcher)机制

- 一个Watch事件是一个一次性的触发器,当被设置了Watch的数据发生了改变的时候,则服务器将这个改变发送给设置了Watch的客户端,以便通知它们。

- Zookeeper采用了 Watcher机制实现数据的发布订阅功能,多个订阅者可同时监听某一特定主题对象,当该主题对象的自身状态发生变化时例如节点内容改变、节点下的子节点列表改变等,会实时、主动通知所有订阅者。

- watcher机制事件上与观察者模式类似,也可看作是一种观察者模式在分布式场景下的实现方式。

watcher的过程:

- 客户端向服务端注册watcher

- 服务端事件发生触发watcher

- 客户端回调watcher得到触发事件情况

注意:Zookeeper中的watch机制,必须客户端先去服务端注册监听,这样事件发送才会触发监听,通知给客户端。

支持的事件类型:

- None: 连接建立事件

- NodeCreated: 节点创建

- NodeDeleted: 节点删除

- NodeDataChanged:节点数据变化

- NodeChildrenChanged:子节点列表变化

- DataWatchRemoved:节点监听被移除

- ChildWatchRemoved:子节点监听被移除

| 特性 |

说明 |

| 一次性触发 |

watcher是一次性的,一旦被触发就会移除,再次使用时需要重新注册 |

| 客户端顺序回调 |

watcher回调是顺序串行执行的,只有回调后客户端才能看到最新的数据状态。一个watcher回调逻辑不应该太多,以免影响别的watcher执行 |

| 轻量级 |

WatchEvent是最小的通信单位,结构上只包含通知状态、事件类型和节点路径,并不会告诉数据节点变化前后的具体内容 |

| 时效性 |

watcher只有在当前session彻底失效时才会无效,若在session有效期内快速重连成功,则watcher依然存在,仍可接收到通知; |

#监听节点数据的变化

get -w path

stat -w path

#监听子节点增减的变化

ls -w path 使用案例——协同服务

设计一个master-worker的组成员管理系统,要求系统中只能有一个master , master能实时获取系统中worker的情况。

保证组里面只有一个master的设计思路

#master1

create -e /master "m1:2223"

#master2

create -e /master "m2:2223" # /master已经存在,创建失败

Node already exists: /master

#监听/master节点

stat -w /master

#当master2收到/master节点删除通知后可以再次发起创建节点操作

create -e /master "m2:2223" master-slave选举也可以用这种方式

master监控worker状态的设计思路

#master服务

create /workers

#让master服务监控/workers下的子节点

ls -w /workers

#worker1

create -e /workers/w1 "w1:2224" #创建子节点,master服务会收到子节点变化通知

#master服务

ls -w /workers

#worker2

create -e /workers/w2 "w2:2224" #创建子节点,master服务会收到子节点变化通知

#master服务

ls -w /workers

#worker2

quit #worker2退出,master服务会收到子节点变化通知使用场景——条件更新

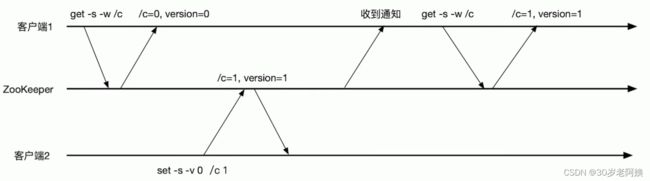

设想用2 /c实现一个counter,使用set命令来实现自增1操作。条件更新场景∶

1. 客户端1把/c更新到版本1,实现/c的自增1。

2. 客户端2把/c更新到版本2,实现/c的自增1。

3. 客户端1不知道/c已经被客户端⒉更新过了,还用过时的版本1是去更新/c,更新失败。如果客户端1使用的是无条件更新,/c就会更新为2,没有实现自增1。

使用条件更新可以避免出现客户端基于过期的数据进行数据更新的操作。