写在前面:

可分离卷积提出的原因

卷积神经网络在图像处理中的地位已然毋庸置疑。卷积运算具备强大的特征提取能力、相比全连接又消耗更少的参数,应用在图像这样的二维结构数据中有着先天优势。然而受限于目前移动端设备硬件条件,显著降低神经网络的运算量依旧是网络结构优化的目标之一。本文所述的Separable Convolution就是降低卷积运算参数量的一种典型方法。

Separable Convolution将传统卷积分解为Depthwise Convolution与Pointwise Convolution两部分,有效的减小了参数数量。Separable Convolution由Depthwise(DW)卷积与Pointwise(PW)卷积组成。Depthwise(DW)卷积与Pointwise(PW)卷积,合起来被称作Depthwise Separable Convolution(参见Google的Xception),该结构和常规卷积操作类似,可用来提取特征,但相比于常规卷积操作,其参数量和运算成本较低。所以在一些轻量级网络中会碰到这种结构如MobileNet。

常规卷积运算

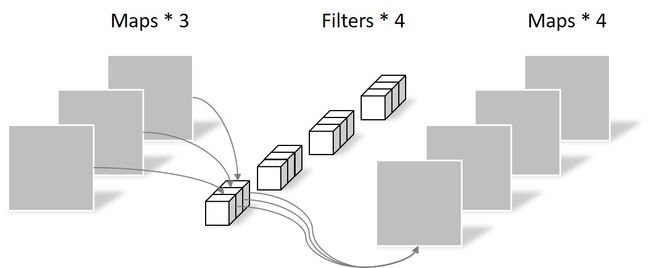

对于一张5×5像素、三通道彩色输入图片(shape为5×5×3)。经过3×3卷积核的卷积层(假设输出通道数为4,则卷积核shape为3×3×3×4),最终输出4个Feature Map,如果有same padding则尺寸与输入层相同(5×5),如果没有则为尺寸变为3×3。

此时,卷积层共4个Filter,每个Filter包含了3个Kernel,每个Kernel的大小为3×3。因此卷积层的参数数量可以用如下公式来计算:

N_std = 4 × 3 × 3 × 3 = 108Separable Convolution

Separable Convolution在Google的Xception[3]以及MobileNet[4]论文中均有描述。它的核心思想是将一个完整的卷积运算分解为两步进行,分别为Depthwise Convolution与Pointwise Convolution。

Depthwise Convolution

不同于常规卷积操作,Depthwise Convolution的一个卷积核负责一个通道,一个通道只被一个卷积核卷积。上面所提到的常规卷积每个卷积核是同时操作输入图片的每个通道。

同样是对于一张5×5像素、三通道彩色输入图片(shape为5×5×3),Depthwise Convolution首先经过第一次卷积运算,不同于上面的常规卷积,DW完全是在二维平面内进行。卷积核的数量与上一层的通道数相同(通道和卷积核一一对应)。所以一个三通道的图像经过运算后生成了3个Feature map(如果有same padding则尺寸与输入层相同为5×5),如下图所示。

其中一个Filter只包含一个大小为3×3的Kernel,卷积部分的参数个数计算如下:

N_depthwise = 3 × 3 × 3 = 27Depthwise Convolution完成后的Feature map数量与输入层的通道数相同,无法扩展Feature map。而且这种运算对输入层的每个通道独立进行卷积运算,没有有效的利用不同通道在相同空间位置上的feature信息。因此需要Pointwise Convolution来将这些Feature map进行组合生成新的Feature map。

Pointwise Convolution

Pointwise Convolution的运算与常规卷积运算非常相似,它的卷积核的尺寸为 1×1×M,M为上一层的通道数。所以这里的卷积运算会将上一步的map在深度方向上进行加权组合,生成新的Feature map。有几个卷积核就有几个输出Feature map。如下图所示。

由于采用的是1×1卷积的方式,此步中卷积涉及到的参数个数可以计算为:

N_pointwise = 1 × 1 × 3 × 4 = 12经过Pointwise Convolution之后,同样输出了4张Feature map,与常规卷积的输出维度相同。

参数对比

回顾一下,常规卷积的参数个数为:

N_std = 4 × 3 × 3 × 3 = 108Separable Convolution的参数由两部分相加得到:

N_depthwise = 3 × 3 × 3 = 27

N_pointwise = 1 × 1 × 3 × 4 = 12

N_separable = N_depthwise + N_pointwise = 39相同的输入,同样是得到4张Feature map,Separable Convolution的参数个数是常规卷积的约1/3。因此,在参数量相同的前提下,采用Separable Convolution的神经网络层数可以做的更深。

问题引入

# -*- coding: utf-8 -*-

import torch

import torch.nn as nn

import numpy as np

# 设置随机种子以便复现结果

torch.manual_seed(42)

np.random.seed(42)

# 定义一个模拟的输入图像

row = 1000

col = 1000

input_image = torch.rand(1, 3, row, col)

# 定义原始的网络结构

class OriginalNetwork(nn.Module):

def __init__(self, in_channels, out_channels,kernel_sizes, strides, paddings):

super(OriginalNetwork, self).__init__()

self.conv1 = nn.Conv2d(in_channels, in_channels, kernel_sizes, strides, paddings, groups=in_channels, bias=False)

self.conv2 = nn.Conv2d(in_channels, out_channels, kernel_size=1, stride=1,padding=0,bias=True)

self.relu = nn.ReLU()

def forward(self, x):

x = self.conv1(x)

x = self.conv2(x)

x = self.relu(x)

return x

# 创建等效的单一3x3滤波器网络

class EquivalentNetwork(nn.Module):

def __init__(self, in_channels, out_channels,kernel_sizes, strides, paddings):

super(EquivalentNetwork, self).__init__()

self.conv = nn.Conv2d(in_channels, out_channels, kernel_sizes, strides, paddings, bias=True)

self.relu = nn.ReLU()

def forward(self, x):

x = self.conv(x)

x = self.relu(x)

return x

if __name__ == "__main__":

in_channels = 3

out_channels = 4

kernel_sizes = 3

strides = 1

paddings = 0

# 创建原始网络

original_net = OriginalNetwork(in_channels=in_channels, out_channels=out_channels,kernel_sizes=kernel_sizes, strides=strides, paddings=paddings)

# 创建等效网络

equivalent_net = EquivalentNetwork(in_channels=in_channels, out_channels=out_channels,kernel_sizes=kernel_sizes, strides=strides, paddings=paddings)

print('原始网络 3*3卷积层权重Size:',original_net.conv1.weight.data.shape)

print('原始网络 1*1卷积层权重Size:',original_net.conv2.weight.data.shape)

print('原始网络 1*1卷积层偏置Size:',original_net.conv2.bias.data.shape)

print('\n')

print('等效网络 3*3卷积层权重Size:',equivalent_net.conv.weight.data.shape)

print('等效网络 3*3卷积层偏置Size:',equivalent_net.conv.bias.data.shape)

for i in range(out_channels):

for j in range(in_channels):

equivalent_net.conv.weight.data[i,j,:,:] = original_net.conv1.weight.data[j,0,:,:]

equivalent_net.conv.weight.data[i, j, :, :] = equivalent_net.conv.weight.data[i, j, :, :] * original_net.conv2.weight.data[i,j,:,:]

equivalent_net.conv.bias.data[i] = original_net.conv2.bias.data[i]

# 将输入图像通过原始网络和等效的网络进行前向传播

output_original = original_net(input_image)

output_equivalent = equivalent_net(input_image)

# 验证输出是否一致

print("原始网络输出与等效网络输出是否一致:", torch.allclose(output_original, output_equivalent,rtol=1e-5,atol=1e-5))参考文献:

- https://blog.csdn.net/weixin_43937316/article/details/99545506

- https://yinguobing.com/separable-convolution/#fn2

- Xception: Deep Learning with Depthwise Separable Convolutions, François Chollet

- MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications