在一台虚拟机上做kafka集群,使用Java代码发,接消息,kafka tool的使用

1.Kafka

kafka是一个开源的分布式消息系统,由linkedin使用scala编写,用作LinkedIn的活动流(Activity Stream)和运营数据处理管道(Pipeline)的基础。具有高水平扩展和高吞吐量。

1.1 kafka的设计目标

1.高吞吐量。

2.数据磁盘持久化:消息不在内存中cache,直接写入到磁盘,充分利用磁盘的顺序读写性能。

3.zero-copy:减少IO操作步骤。

4.支持数据批量发送和拉取。

5.支持数据压缩。

6.Topic划分为多个partition,提高并行处理能力。

1.2 相关概念

1.Producer :消息生产者,就是向kafka broker发消息的客户端。

2.Consumer :消息消费者,向kafka broker取消息的客户端

3.Topic :主题,存放信息的地方,可以理解为一个队列。

4.Consumer Group (CG):消费组.这是kafka用来实现一个topic消息的广播(发给所有的consumer)和单播(发给任意一个consumer)的手段。一个topic可以有多个CG。topic的消息会复制(不是真的复制,是概念上的)到所有的CG,但每个CG只会把消息发给该CG中的一个consumer。如果需要实现广播,只要每个consumer有一个独立的CG就可以了。要实现单播只要所有的consumer在同一个CG。用CG还可以将consumer进行自由的分组而不需要多次发送消息到不同的topic。

5.Broker :一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic。

6.Partition:分区. 一个Topic中的消息数据按照多个分区组织,分区是kafka消息队列组织的最小单位,一个分区可以看作是一个FIFO( First Input First Output的缩写,先入先出队列)的队列。为了实现扩展性,一个非常大的topic可以分布到多个broker(即服务器)上,一个topic可以分为多个partition,每个partition是一个有序的队列。partition中的每条消息都会被分配一个有序的id(offset)。kafka只保证按一个partition中的顺序将消息发给consumer,不保证一个topic的整体(多个partition间)的顺序。

7.Offset:消息偏移量.kafka的存储文件都是按照offset.kafka来命名,用offset做名字的好处是方便查找。例如你想找位于2049的位置,只要找到2048.kafka的文件即可。当然the first offset就是00000000000.kafka

1.3 kafka架构

![]()

1.4 Topic与分区架构

![]()

1.5 kafka集群(一台虚拟机上)

前提:

kafka集群依赖zookeeper集群,所以必须要先有zookeeper集群.可参看我的上一篇文章:<<在一台虚拟机上做zookeeper集群>>

软件环境: cenos7虚拟机一台, kafka_2.12-2.1.0.tar.gz

Kafka下载地址: http://kafka.apache.org/downloads

步骤:

创建kafka文件夹,上传安装包

cd /usr/dev-soft && mkdir kafka && cd kafka

rz,选择安装包上传

解压

tar –zxvf kafka_2.12-2.1.0.tar.gz

创建3个保存消息的文件夹

mkdir kafka-logs-1 kafka-logs-2 kafka-logs-3

修改配置文件server.properties

vi kafka_2.12-2.1.0/config/server.properties

命令模式下输入 :set nu显示行号

修改:

第21行: broker.id=1

第31行: listeners=PLAINTEXT://192.168.81.128:9091

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9091

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-1

第123行: zookeeper.connect=192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

至此一个kafka应用配置完成.本次集群使用3个kafka应用,复制2份,修改即可.

步骤:

修改名字,复制2份

mv kafka_2.12-2.1.0 kafka_2.12-2.1.0-1

cp –r kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-2

cp –r kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-3

第二台修改server.properties

vi kafka_2.12-2.1.0-2/config/server.properties

修改:

第21行: broker.id=2

第31行: listeners=PLAINTEXT://192.168.81.128:9092

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9092

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-2

第三台修改server.properties

vi kafka_2.12-2.1.0-3/config/server.properties

修改:

第21行: broker.id=3

第31行: listeners=PLAINTEXT://192.168.81.128:9093

第36行: advertised.listeners=PLAINTEXT://192.168.81.128:9093

第60行: log.dirs=/usr/dev-soft/kafka/kafka-logs-3

Kafka集群配置完成.

2.5.1启动&关闭集群

编写启动脚本(其实就是依次启动3个kafka)

cd /usr/dev-soft/kafka

vim kafka-start.sh

内容如下:

cd kafka_2.12-2.1.0-1

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-2

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-3

bin/kafka-server-start.sh -daemon config/server.properties

cd ../

同理关闭脚本如下:

vim kafka-stop.sh

写入以下内容:

kafka_2.12-2.1.0-1/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-2/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-3/bin/kafka-server-stop.sh

依次赋予执行权限

chmod u+x kafka-start.sh

chmod u+x kafka-stop.sh

启动kafka集群:(注意要先启动zookeeper集群)

./ kafka-start.sh

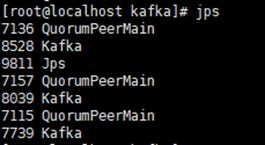

启动会有点慢,稍等后,输入jps命令查看结果:

这样说明启动成功了,但是需要发送信息证明集群的可用行,在此之前,需要先把9091,9092,9093这三个端口对外开放,消息的发送和拉取就是通过这些端口的.

执行如下命令:

开放端口:

firewall-cmd --zone=public --add-port=9091/tcp –permanent

firewall-cmd --zone=public --add-port=9092/tcp –permanent

firewall-cmd --zone=public --add-port=9093/tcp --permanent

重启防火墙:

firewall-cmd --reload

查看端口号是否开启:

firewall-cmd --query-port=9091/tcp

firewall-cmd --query-port=9092/tcp

firewall-cmd --query-port=9093/tcp

2.5.2 发送消息&消费消息

在一个kafka应用上操作即可

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

创建topic:kafkatest

bin/kafka-topics.sh --create --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --replication-factor 2 --partitions 2 --topic kafkatest

查看topic:

某个topic

bin/kafka-topics.sh --describe --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --topic kafkatest

全部topic

bin/kafka-topics.sh --list --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

发送信息:

bin/kafka-console-producer.sh --broker-list 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --topic kafkatest

消费信息:

打开另一个窗口:

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

bin/kafka-console-consumer.sh --bootstrap-server 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --from-beginning --topic kafkatest

3.使用Java代码发送,接收消息

使用Springboot项目开发,Springboot已经集成了kafka,开发起来非常简单.

3.1 pom.xml

xml version="1.0" encoding="UTF-8"?>

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

3.2 application.properties

#修改端口

server.port=8899

#springMVC的配置

#视图前缀

spring.mvc.view.prefix=/html/

#视图后缀

spring.mvc.view.suffix=.html

#kafka相关配置

spring.kafka.bootstrap-servers=192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093

#设置一个默认组

spring.kafka.consumer.group-id=0

#key-value序列化反序列化

spring.kafka.consumer.key-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.consumer.value-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.producer.key-serializer=org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer=org.apache.kafka.common.serialization.StringSerializer

#每次批量发送消息的数量

spring.kafka.producer.batch-size=12800

spring.kafka.producer.buffer-memory=1024003.3 KafkaProduct.Class

@RestController

@Slf4j

public class KafkaProduct {

@Autowired

private KafkaTemplate kafkaTemplate;

@GetMapping("/index")

public String kafka(){

return "kafka";

}

/**

* 发送消息到kafka对应的topic

* @param topic

* @param message

*/

@RequestMapping("/kafka/sendMessage")

public String sendMessage(@RequestParam("topic")String topic, @RequestParam("message")String message) {

try {

ListenableFuture> send = kafkaTemplate.send(topic, 0,System.currentTimeMillis(),"test",message);

send.addCallback(new SuccessCallback() {

@Override

public void onSuccess(@Nullable Object obj) {

SendResult sendResult = (SendResult) obj;

//...

log.info("消息发送成功:{}", sendResult);

}

}, new FailureCallback() {

@Override

public void onFailure(Throwable throwable) {

log.info("消息发送失败,case:{}", throwable);

//失败处理

}

});

return "消息发送成功";

}catch (Exception e){

return "消息发送失败";

}

} 3.4 KafkaConsumer.Class

/**

* 消费信息,监听一系列topic的信息

* @param record

*/

@KafkaListener(topics = {"test","kafkatest"})

private void consumerMessage(ConsumerRecord record) {

Optional kafkaMessage = Optional.ofNullable(record.value());

if (kafkaMessage.isPresent()) {

Object message = kafkaMessage.get();

log.info("----------------- 返回的信息对象:{}",record);

log.info("------------------收到的message:{}",message);

}

}3.5 kafka.html

kafka页面

3.6 启动类KafkaApplication

package com.mlsama.kafka;

import org.springframework.boot.Banner;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class KafkaApplication {

public static void main(String[] args) {

/** 创建SpringApplication应用对象 */

SpringApplication springApplication =

new SpringApplication(KafkaApplication.class);

/** 设置横幅模式(设置关闭) */

springApplication.setBannerMode(Banner.Mode.OFF);

/** 运行 */

springApplication.run(args);

}

}直接运行启动类,访问: http://127.0.0.1:8899/index

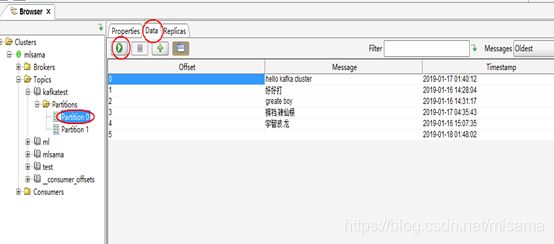

4 kafka tool

Kafka tool提供一个界面,可以直观的看到kafka集群的信息,包括topic,partition,发送的消息等.

下载地址:http://www.kafkatool.com/download.html 现在只有2个版本,因为安装的kafka版本是2.1.0,所以下载Windows版的2.0.3.安装是傻瓜式的的.第一次打开kafka tool会提示设置连接kafka 集群.点击确认后,界面如下:

设置完,点击test,提示连接成功后,点击add

设置消息以String显示:

Tool---setting,点击topics,把右边的key和message设置为String即可.

![]()

查看kafka的数据: