狂神说 redis 笔记

Nosql概述

为什么要学Nosql

我们先在处于大数据时代,大数据一般的数据库无法进行分析处理了!2006 Hadoop

压力一定会越来越大,适者生存!一定要逼着自己学习,这是在这个社会生存的唯一法则!

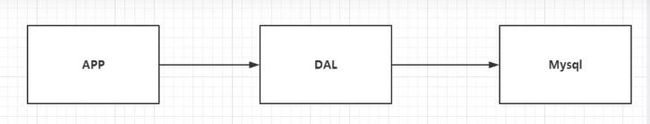

1、单机MySQL的时代

90年代,一个基本的网站访问量一般不会太大,单个数据库完全足够!

那个时候,更多的去使用HTML~服务器根本没有太大的压力!

思考一个,这种情况:整个网站的瓶颈是什么?

- 数据量如果太大,一个机器都放不下!

- 数据的索引(B+Tree),一个机器内存也放不下

- 访问量(读写混合),一个服务器承受不了!

只要你开始出现以上的三种情况之一,那么你就必须要晋级!

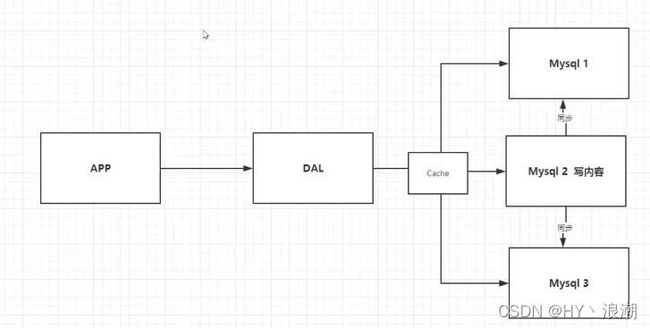

2、Memcached(缓存) + MySQL + 垂直拆分(读写分离)

网站80%的情况都是在读,每次都要去查询数据库的话十分麻烦!所以说我们希望减轻数据的压力,我们可以使用缓存来保证效率。

发展过程:优化数据结构和索引–>文件缓存(IO)–> Memcached(当时最热门的技术!)

3、分库分表 + 水平拆分 + MySQL集群

技术和业务在发展的同时,对人的要求也越来越高!

本质:数据库(读,写)

早些年MyISAM:表锁,十分影响效率!

转战Innodb:行锁

慢慢的就开始使用分库分表来解决写的压力!MySQL在哪个年代推出了表分区!这个并没有多少公司使用!

MySQL的集群,很好满足那个年代的所有需求!

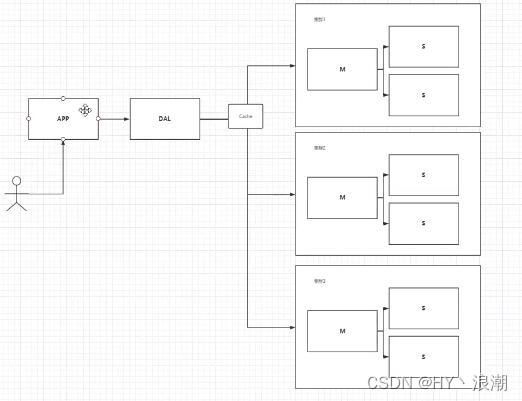

4、如今最近的年代

2012~2022 十年之间,世界已经发生了翻天覆地的变化;(定位,也是一种数据,音乐,热榜!)

MySQL 等关系型数据库就不够用了!数据量很多,变化很快!

MySQL 有的使用它来储存一些比较大的文件,博客,图片!数据库表很大,效率就低了!如果有一种数据来专门处理这种数据,MySQL压力就变得十分小(研究如何处理这些问题!)大数据的 IO 压力下,表几乎没法更大!

目前一个基本的互联网项目!

为什么要用NoSQL!

用户的个人信息,社交网络,地理位置。用户自己产生的数据,用户日志等等爆发式增长!

这个时候我们就需要使用NoSQL数据库了,NoSQL可以很好的处理以上的情况!

什么是NoSQL

NoSQL

NoSQL = Not only SQL (不仅仅是SQL)

泛指非关系型数据库的,随着web 2.0互联网的诞生!传统的关系型数据库很难对付web 2.0时代!尤其是超大规模的高并发的社区!暴露出来很多难以克服的问题,NoSQL在当今大数据环境下发展的十分迅速,Redis是发展最快的,而且是我们当下必须掌握的一个技术!

很多数据数据类型的用户的个人信息,社交网络,地理位置。这些数据类型的存储不需要一个固定的格式!不需要多余的操作就可以横行扩展! Map

NoSQL特点

解耦!

- 方便扩展(数据之间没有关系,很好扩展!)

- 大数据量高性能(Redis 一秒写8万次,读11万,NoSQLf的缓存记录级,是一种细粒度的缓存,性能会比较高!)

- 数据类型是多样型的(不需要实现设计数据库!随取随用!如果数据量十分大的表,很多人就无法设计了!)

- 传统 RDBMS 和 NoSQL

传统的 RDBMS

- 结构化组织

- SQL

- 数据和关系都存在单独的表中 row col

- 操作操作,数据定义语言

- 严格的一致性

- 基础的事务

- ......

NoSQL

- 不仅仅是数据

- 没有固定的查询语言

- 键值对存储,列存储,文档存储,图形数据库(社交关系)

- 最终一致性

- CAP 定理和 BASE (异地多活)

- 高性能,高可用,高可扩

- .....

了解:3V和3高

大数据时代的3V:主要是描述问题

- 海量Volume

- 多样Variety

- 实时Velocity

大数据时代的3高:主要是对程序的要求

- 高并发

- 高可拓

- 高性能

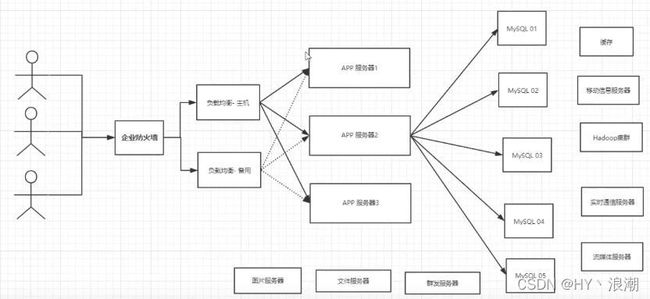

真正在公司中的实践:NoSQL + RDBMS 一起使用才是最强的,阿里巴巴的架构演进!

技术没有高低之分,就看你如何去使用!(提升内功,思维的提高!)

阿里巴巴演进分析

技术急不得,越是慢慢学,才能越扎实!

开源才是技术的王道!

任何一家互联网的公司,都不可能只是简简单单让用户能用就好了!

大量公司做的都是相同的业务;(竞品协议)

随着这样的竞争,业务是越来越完善,然后对开发者要求也是越来越高!

如果你未来想当一个架构师:没有什么是加一层解决不了的!

# 1、商品的信息

名称、价格、商家信息

关系型数据库就可以解决了!MySQL/ Oracle (淘宝早些年就去IOE了!)

淘宝内部的 MySQL 不是大家用的 MySQL(底层组件不一样)

# 2、商品的描述、评论(文字比较多)

文档数据库中,MongoDB

# 3、图片

- 分布式文件系统 FastDFS

- 淘宝自己的 TFS

- Gooale的 GFS

- Hadoop HDFS

- 阿里云 OSS

# 4、商品的关键字(搜索)

- 搜索引擎 solr elasticsearch

- ISerach:多隆(多去了解这些技术大佬!)

# 5、商品热门的波段信息

- 内存数据库

- Redis Tair、Memache ...

# 6、商品的交易,外部的支付接口

- 三方应用

要知道,一个简单的网页背后的技术一定不是大家所想的那么简单的!

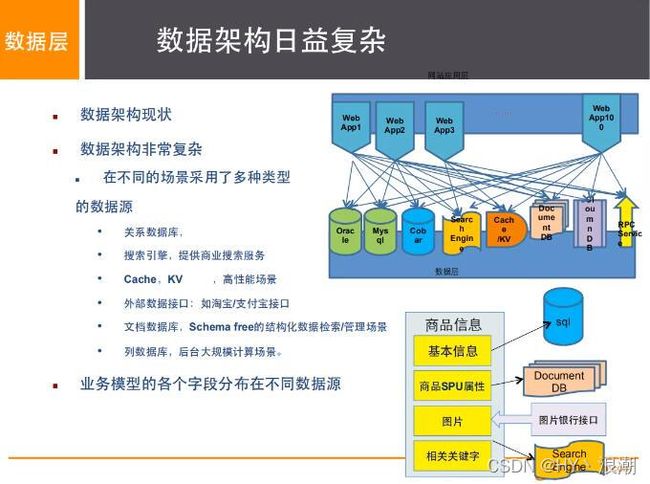

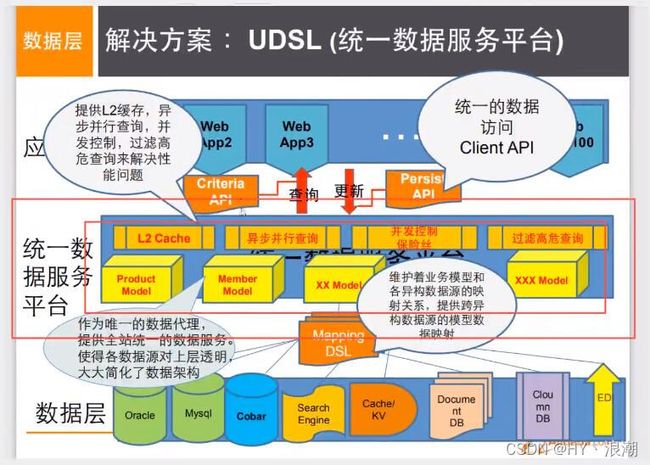

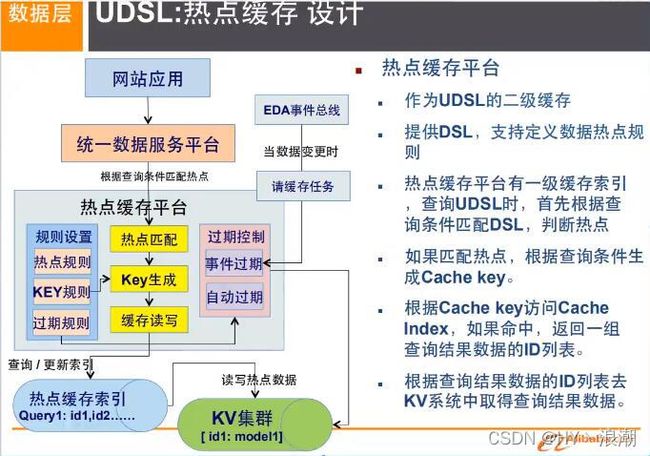

大型互联网应用问题:

- 数据类型太多了

- 数据源繁多,经常重构!

- 数据要改造,大面积改造?

解决问题:

这里以上都是NoSQL入门概述,不仅能够提高大家的知识,还可以帮助大家了解大厂的工作内容!

NoSQL的四大分类

KV键值对:

- 新浪:Redis

- 美团:Redis + Tair

- 阿里、百度:Redis + memecache

文档型数据库(bson格式和json一样):

- MongoDB(一般必须掌握)

- MongoDB是一个基于分布式文件存储的数据库,C++编写,主要用来处理大量的文档!

- MongoDB是一个介于关系型数据库和非关系型数据库中中间的产品!是非关系型数据库中最功能最丰富的,最像关系型数据库的!

- ConthDB

列存储数据库

- HBase

- 分布式文件系统

图关系数据库

- 它不是存图形,放的是关系,比如朋友圈社交网络,广告推荐!

- Neo4j ,InfoGrid

Redis入门

概述

Redis(Remote Dictionary Server ),即远程字典服务!

是一个开源的使用ANSI C语言编写、支持网络、可基于内存亦可持久化的日志型、Key-Value数据库,并提供多种语言的API。

redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录,并且在此基础上实现了master-slave(主从)同步!

免费和开源,是当下NoSQL最热门的技术之一!也被人称为结构化数据库。

Redis能干什么?

1、内存储存、持久化,内存中是断电即失,所以说持久化很重要(rdb aof)

2、效率高,可以用于高速缓存

3、发布订阅系统

4、地图信息分析

5、计时器、计数器(浏览量)

6、…

特性

1、多样的数据类型

2、持久化

3、集群

…

学习中需要的东西

官网(下载地址):https://redis.io/

中文网:http://www.redis.cn/

注意:Windows这github上下载(停更很久了)!

Redis推荐都是在Linux服务器上搭建的,我们是基于Linux学习!

Windows安装

1、下载安装包:https://github.com/MicrosoftArchive/redis/releases

2、下载完毕得到压缩包:Redis-x64-3.0.504.zip

3、解压到自己的环境目录下就ok了!redis 十分的小,就只有5M。

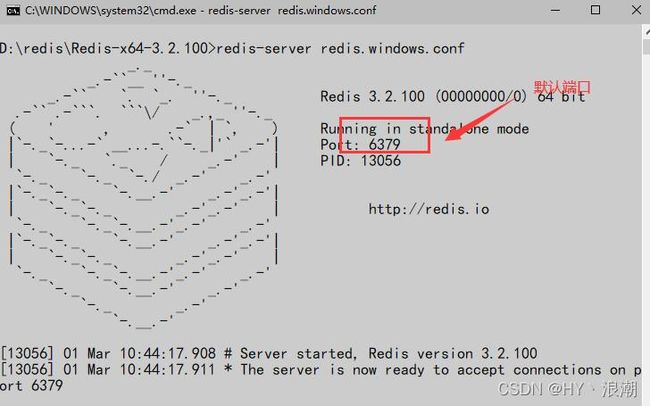

4、打开cmd窗口,跳转到redis绝对路径,然后输入:

redis-server redis.windows.conf 命令

这样就是安装完成了。

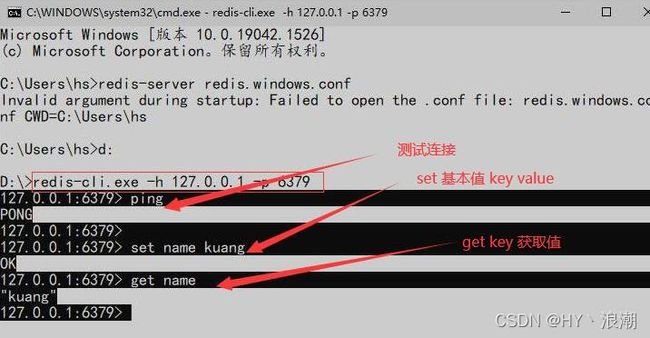

5、使用Redis客户端来连接redis

注意:redis那边小黑窗不用关闭!

记住一句话,Windows下使用确实简单,但是redis推荐我们去Linux下去开发使用!

Linux安装

注意:狂神下了Xshell和Xftp两个软件,还用了云服务器。这俩软件你们自己下。

云服务器可以用我的,就不需自己买了,公网IP和密码是:

120.76.239.157

¥¥¥¥¥¥¥¥自己的服务器密码

一般情况下是开着的,2023年3月之前都可以用!

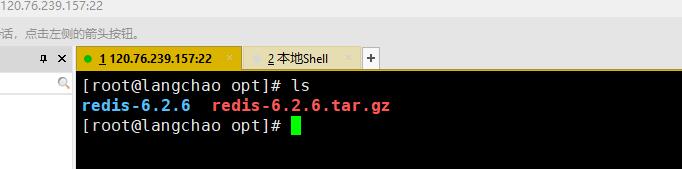

1、下载安装包!redis-6.2.6.tar.gz

2、解压redis的安装包!程序 /pot

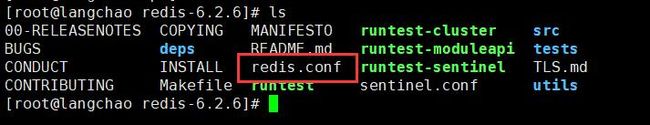

3、进入解压文件,可以看到我们redis配置文件

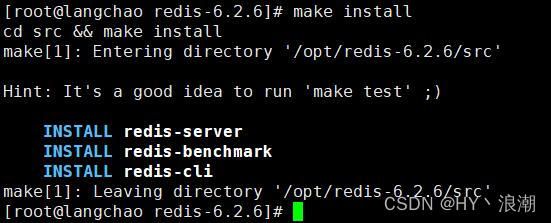

4、基本的环境安装

yum install gcc-c++ 如果你的redis版本跟我一致就不要输这个,输gcc -v就行

make

make install

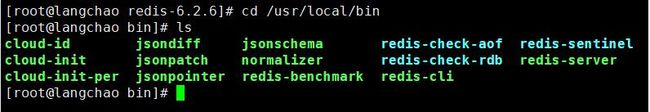

5、redis默认安装路径 /usr/local/bin

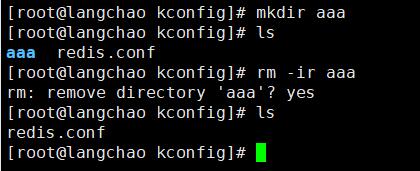

6、将redis配置文件。复制到我们当前目录下

mkdir 文件名(创建文件)

cp /opt/redis-6.2.6/redis.conf kconfig

rm -ir 文件名(删除,前提是位置处于在它的上一次目录)

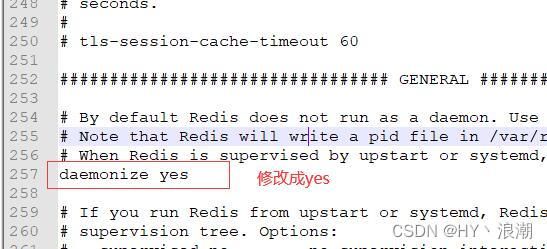

7、redis默认不是后台启动的,修改配置文件!

我的这个版本跟狂神有些许不同,所以直接xftp打开该文件直接修改的

8、启动redis服务!redis-server kconfig/redis.conf我的版本启动后是什么也不会出来,之后直接连接就行了(如果redis跟我的不低于我的版本可以省略这一步,他连接的时候自动启动redis服务!)

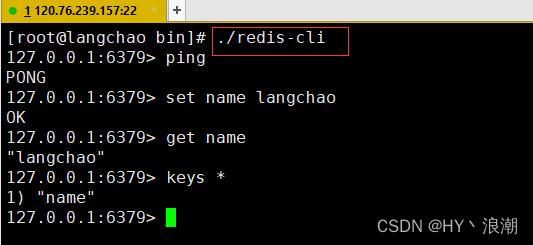

9、使用redis-cli进行连接测试!输入./redis-cli进行连接,默认端口是6379,不需要像狂神一样指定端口号。

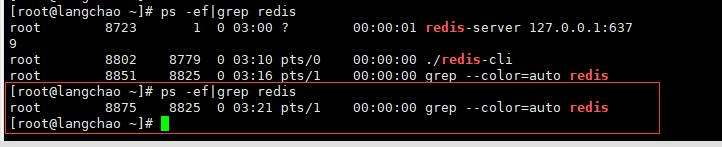

10、查看redis的进程是否开启 !ps -ef|grep redis

12、再次查看进程是否存在

13、后面我们会使用单机多redis启动集群测试

测试性能

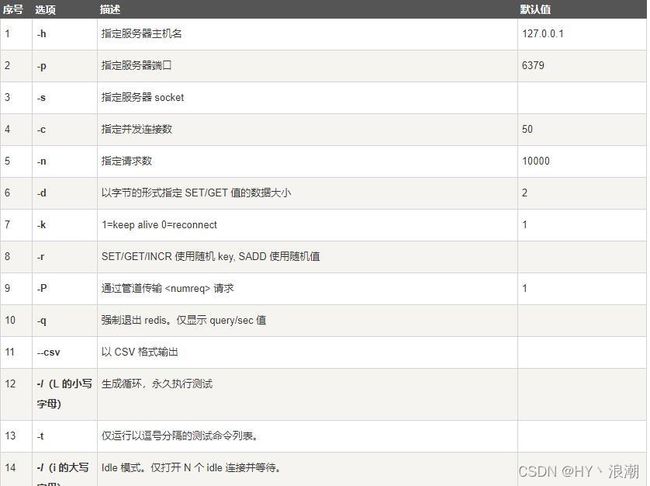

redis-benchmark 是一个压力测试工具!

官方自带的性能测试工具!

redis-benchmark命令参数!

图片来自教程菜鸟教程:

我们来测试下:

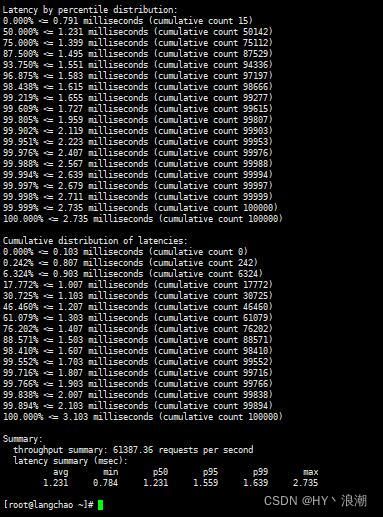

# 测试:100个并发连接 100000请求

redis-benchmark -h localhost -p 6379 -c 100 -n 100000

如何查看这些分析呢?这里想深入了解的可以找找资料,这里不多做解释

基础的知识

127.0.0.1:6379> select 3 #切换数据库

OK

127.0.0.1:6379[3]> dbsize #查看DB大小

(integer) 0

127.0.0.1:6379[3]> set name kuang

OK

127.0.0.1:6379[3]> dbsize

(integer) 1

127.0.0.1:6379[3]> select 6

OK

127.0.0.1:6379[6]> dbsize

(integer) 0

127.0.0.1:6379[6]> get name

(nil)

127.0.0.1:6379[6]> select 3

OK

127.0.0.1:6379[3]> get name

"kuang"

127.0.0.1:6379> keys * #查看数据库所有的key

1) "counter:__rand_int__"

2) "myhash"

3) "mylist"

4) "name"

5) "key:__rand_int__"

127.0.0.1:6379[3]> flushdb #清空当前数据库

OK

127.0.0.1:6379[3]> flushall #清空所有数据库

OK

思考:为什么redis是6379!粉丝效应!(了解一下即可!)

Redis是单线程的!

明白redis是很快的,官方表示,Redis是基于内存操作,CPU不是Redis的瓶颈,Redis的瓶颈是根据机器的内存和网络带宽,既然可以使用使用单线程来实现,所以就使用单线程了!

Redis是C语言写的,官方提供的数据为 100000+ 的QPS,完全不比同样是使用key-vale的Memecache差!

Redis为什么单线程还这么快?

误区1、高性能的服务器一定是多线程的?

误区2、多线程(CPU上下文会切换!)一定比单线程效率高!

先去CPU > 内存 > 硬盘的速度要有所了解!

核心:redis是将所有的数据全部放在内存中的,所有说使用单线程去操作效率就是最高的,多线程(CPU上下会切换:就是耗时的操作!!!),对于内存系统来说,如果没有上下文切换效率就是最高的!多次读写都是在一个CPU上的,在内存情况下,这个就是最佳的方案!

五大数据类型

Redis 是一个开源(BSD许可)的,内存中的数据结构存储系统,它可以用作数据库、缓存和消息中间件MQ。 它支持多种类型的数据结构,如 字符串(strings), 散列(hashes), 列表(lists), 集合(sets), 有序集合(sorted sets) 与范围查询, bitmaps, hyperloglogs 和 地理空间(geospatial) 索引半径查询。 Redis 内置了 复制(replication),LUA脚本(Lua scripting), LRU驱动事件(LRU eviction),事务(transactions) 和不同级别的 磁盘持久化(persistence), 并通过 Redis哨兵(Sentinel)和自动 分区(Cluster)提供高可用性(high availability)。

我们现在讲解的所有命令大家一定要记住,后面我们使用springboot、jedis。所有的方法就是这些命令!

Redis-key

127.0.0.1:6379> keys * # 查看所有的key

(empty array)

127.0.0.1:6379> set name kuangshen # set key

OK

127.0.0.1:6379> keys *

1) "name"

127.0.0.1:6379> set age 1

OK

127.0.0.1:6379> keys *

1) "age"

2) "name"

127.0.0.1:6379> exists name # 判断当前key是否存在

(integer) 1

127.0.0.1:6379> exists name1

(integer) 0

127.0.0.1:6379> move name 1 # 移除当前的key

(integer) 1

127.0.0.1:6379> keys *

1) "age"

127.0.0.1:6379> set name qingjiang

OK

127.0.0.1:6379> keys *

1) "name"

2) "age"

127.0.0.1:6379> get name

"qingjiang"

127.0.0.1:6379> expire name 10 # 设置key的过期时间,单位是秒

(integer) 1

127.0.0.1:6379> ttl name # 查看当前key的过期时间

(integer) 1

127.0.0.1:6379> ttl name

(integer) -2 # 已过期

127.0.0.1:6379> type name # 查看的当期key的类型

string

127.0.0.1:6379> type age

string

后面有不会的命令可以去官网查!

String(字符串)

127.0.0.1:6379> set key1 v1 # 设置值

OK

127.0.0.1:6379> get key1 # 获得之

"v1"

127.0.0.1:6379> keys * # 获得所有key

1) "key1"

127.0.0.1:6379> exists key1 # 判断某一个key是否存在

(integer) 1

127.0.0.1:6379> append key1 "hello" # 追加字符串,如果当前key不存在,就相当于setkey

(integer) 7

127.0.0.1:6379> get key1

"v1hello"

127.0.0.1:6379> strlen key1 # 获得字符串长度

(integer) 7

127.0.0.1:6379> append key1 ",kuangshen"

(integer) 17

127.0.0.1:6379> strlen key1

(integer) 17

127.0.0.1:6379> get key1

"v1hello,kuangshen"

#####################################################################

# i++

# 步长 i+=

127.0.0.1:6379> set views 0 # 初始浏览量为0

OK

127.0.0.1:6379> get views

"0"

127.0.0.1:6379> incr views # 自增1 浏览量变为1

(integer) 1

127.0.0.1:6379> incr views

(integer) 2

127.0.0.1:6379> get views

"2"

127.0.0.1:6379> decr views # 自减1 浏览量-1

(integer) 1

127.0.0.1:6379> decr views

(integer) 0

127.0.0.1:6379> decr views

(integer) -1

127.0.0.1:6379> get views

"-1"

127.0.0.1:6379> incrby views 10 # 可以设置步长,指定增量!

(integer) 9

127.0.0.1:6379> incrby views 10

(integer) 19

127.0.0.1:6379> decrby views 5

(integer) 14

127.0.0.1:6379> decrby views 5

(integer) 9

#####################################################################

# 字符串范围 range

127.0.0.1:6379> set key1 "hello,kuangshen" # 设置 key1 的值

OK

127.0.0.1:6379> get key1

"hello,kuangshen"

127.0.0.1:6379> getrange key1 0 3 # 截取字符串[0,3]

"hell"

127.0.0.1:6379> getrange key1 0 -1 # 获得全部字符串,和 get key 是一样的

"hello,kuangshen"

# 替换!

127.0.0.1:6379> set key2 abcdefg

OK

127.0.0.1:6379> get key2

"abcdefg"

127.0.0.1:6379> setrange key2 1 xx # 替换指定位置开始的字符串!

(integer) 7

127.0.0.1:6379> get key2

"axxdefg"

#####################################################################

# setex (set with expire) # 设置过期时间

# setnx (set if not exist) # 不存在再设置(在分布式中会长长使用!)

127.0.0.1:6379> setex key3 30 "hello" # 设置key3 的值为 hello,30秒后过期

OK

127.0.0.1:6379> ttl key3

(integer) 23

127.0.0.1:6379> get key3

(nil)

127.0.0.1:6379> setnx mykey "redis" # 如果mykey 不存在,创建mykey

(integer) 1

127.0.0.1:6379> keys *

1) "mykey"

127.0.0.1:6379> ttl key3

(integer) -2

127.0.0.1:6379> setnx mykey "MongDB" # 如果mykey存在,创建失败!

(integer) 0

127.0.0.1:6379> get mykey

"redis"

#####################################################################

mset

mget

127.0.0.1:6379> clear

127.0.0.1:6379> mset k1 v1 k2 v2 k3 v3 # 同时设置多个值

OK

127.0.0.1:6379> keys *

1) "k2"

2) "k3"

3) "k1"

127.0.0.1:6379> mget k1 k2 k3 # 同时获取多个值

1) "v1"

2) "v2"

3) "v3"

127.0.0.1:6379> msetnx k1 v1 k4 v4 # msetnx 是个原子性的操作,要么一起成功,要么一起失败!

(integer) 0

127.0.0.1:6379> get k4

(nil)

# 对象

set user:1 {name:zhangsan,age:3} # 设置一个 user:1 对象 值为 json字符来保存一个对象!

# 这里的key是一个巧妙的:user:{id}:{filed},如此设计在Redis中是完全OK的!

127.0.0.1:6379> mset user:1:name zhangsan user:1:age 2

OK

127.0.0.1:6379> mget user:1:name user:1:age

1) "zhangsan"

2) "2"

#####################################################################

getset # 先get然后再set

127.0.0.1:6379> getset db redis # 如果不存在值,则返回nil

(nil)

127.0.0.1:6379> get db

"redis"

127.0.0.1:6379> getset db mongodb # 如果存在值,获取原来的值,并设置新的值

"redis"

127.0.0.1:6379> get db

"mongodb"

数据结构是相同的!

String类似的使用场景:value除了是我们的字符串还是我们的数字!

- 计数器

- 统计多单位的数量

- 粉丝数

- 对象缓存存储!

List(列表)

基本的数据类型,列表

在redis里面,我们可以把list完成,栈、队列、阻塞队列!

所有的 list 命令都是 L 开头的!reids不区分大小写!

127.0.0.1:6379> lpush list one # 将一个值或者多个值,插入到列表头部(左)

(integer) 1

127.0.0.1:6379> lpush list two

(integer) 2

127.0.0.1:6379> lpush list three

(integer) 3

127.0.0.1:6379> lrange list 0 -1 # 获取list中的值

1) "three"

2) "two"

3) "one"

127.0.0.1:6379> lrange list 0 1 # 通过区间获取具体的值!

1) "three"

2) "two"

127.0.0.1:6379> rpush list hello # 将一个值或者多个值,插入到列表头部(左)

(integer) 4

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

4) "hello"

#####################################################################

lpop

rpop

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

4) "hello"

127.0.0.1:6379> lpop list # 移除list的第一个元素

"three"

127.0.0.1:6379> rpop list # 移除list的最后一个元素

"hello"

127.0.0.1:6379> lrange list 0 -1

1) "two"

2) "one"

#####################################################################

lindex

127.0.0.1:6379> lrange list 0 -1

1) "two"

2) "one"

127.0.0.1:6379> lindex list 0 # 通过下标获得list中的某一个值!

"two"

127.0.0.1:6379> lindex list 1

"one"

#####################################################################

llen

127.0.0.1:6379> lpush list one

(integer) 1

127.0.0.1:6379> lpush list two

(integer) 2

127.0.0.1:6379> lpush list three

(integer) 3

127.0.0.1:6379> llen list # 返回列表的长度

(integer) 3

#####################################################################

移除指定的值!

取关 uid

lrem

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "three"

3) "two"

4) "one"

127.0.0.1:6379> lrem list 1 one # 移除list集合中指定个数的value,精确匹配

(integer) 1

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "three"

3) "two"

127.0.0.1:6379> lrem list 2 three

(integer) 2

127.0.0.1:6379> lrange list 0 -1

1) "two"

#####################################################################

trim 修剪。:list 截断!

127.0.0.1:6379> rpush mylist hello

(integer) 1

127.0.0.1:6379> rpush mylist hello1

(integer) 2

127.0.0.1:6379> rpush mylist hello2

(integer) 3

127.0.0.1:6379> rpush mylist hello3

(integer) 4

127.0.0.1:6379> ltrim mylist 1 2

OK

127.0.0.1:6379> lrange mylist 0 -1

1) "hello1"

2) "hello2"

#####################################################################

rpoplpush

127.0.0.1:6379> lrange list 0 -1

1) "h1"

2) "h2"

3) "h3"

127.0.0.1:6379> rpoplpush list otherlist # 移除列表的最后一个元素将他移动到新的列表中!

"h3"

127.0.0.1:6379> lrange list 0 -1 # 查看原来的列表

1) "h1"

2) "h2"

127.0.0.1:6379> lrange otherlist 0 -1 # 查看目标列表中,确实存在值!

1) "h3"

#####################################################################

lset 将列表中指定下标的值替换为另一个值,更新操作

127.0.0.1:6379> lset list 0 item # 判断这个列表是否存在

(error) ERR no such key

127.0.0.1:6379> lpush list value1 # 如果不存在列表我们去更新就会报错

(integer) 1

127.0.0.1:6379> lrange list 0 0

1) "value1"

127.0.0.1:6379> lset list 0 item # 如果存在,更新当前下标的值

OK

127.0.0.1:6379> lrange list 0 0

1) "item"

127.0.0.1:6379> lset list 1 other # 如果不存在,则会报错!

(error) ERR index out of range

#####################################################################

linsert #将某个具体的value值插入到列中的某个元素的前面后者后面!

127.0.0.1:6379> rpush mylist "hello"

(integer) 1

127.0.0.1:6379> rpush mylist "world"

(integer) 2

127.0.0.1:6379> linsert mylist before "world" "other" # 插入到元素前面

(integer) 3

127.0.0.1:6379> lrange mylist 0 -1

1) "hello"

2) "other"

3) "world"

127.0.0.1:6379> linsert mylist after world new # 插入到元素后面

(integer) 4

127.0.0.1:6379> lrange mylist 0 -1

1) "hello"

2) "other"

3) "world"

4) "new"

小结:

- 他实际上是一个链表,before Node after , left ,right 都可以插入值

- 如果可以不存在,创建新的列表

- 如果key存在,新增内容

- 如果移除所有值,空链表,也代表不存在

- 在两边插入或者改动值,效率最高!中间元素,相对俩说效率会低一点~

消息排队!消息队列(Lpush lpop),栈(Lpush lpop)!

Set(集合)

set当中的值是不能重复的!

127.0.0.1:6379> sadd myset "hello" # set集合中添加值

(integer) 1

127.0.0.1:6379> sadd myset "kuangshen"

(integer) 1

127.0.0.1:6379> sadd myset "lovekuangshen"

(integer) 1

127.0.0.1:6379> smembers myset # set查看所有值

1) "hello"

2) "kuangshen"

3) "lovekuangshen"

127.0.0.1:6379> sismember myset hello # 判断某一个值是不是在set集合中!

(integer) 1

127.0.0.1:6379> sismember myset world

(integer) 0

#####################################################################

127.0.0.1:6379> scard myset # 获取set集合中的个数

(integer) 3

#####################################################################

rem

127.0.0.1:6379> srem myset hello # 移除set集合中的指定元素

(integer) 1

127.0.0.1:6379> scard myset

(integer) 3

127.0.0.1:6379> smembers myset

1) "lovekuangshen2"

2) "kuangshen"

3) "lovekuangshen"

#####################################################################

set # 无序不重复集合。抽随机!

127.0.0.1:6379> smembers myset

1) "lovekuangshen2"

2) "kuangshen"

3) "lovekuangshen"

127.0.0.1:6379> srandmember myset # 随机抽选出一个元素

"kuangshen"

127.0.0.1:6379> srandmember myset

"kuangshen"

127.0.0.1:6379> srandmember myset # 随机抽选出一个元素

"lovekuangshen"

127.0.0.1:6379> srandmember myset 2 # 随机抽选出指定个数元素

1) "lovekuangshen2"

2) "lovekuangshen"

127.0.0.1:6379> srandmember myset 2

1) "lovekuangshen2"

2) "kuangshen"

#####################################################################

随机的删除key

127.0.0.1:6379> smembers myset # 随机删除set中的某个元素

1) "lovekuangshen2"

2) "kuangshen"

3) "lovekuangshen"

127.0.0.1:6379> spop myset

"lovekuangshen"

127.0.0.1:6379> spop myset

"lovekuangshen2"

#####################################################################

127.0.0.1:6379> sadd myset "hello"

(integer) 1

127.0.0.1:6379> sadd myset "world"

(integer) 1

127.0.0.1:6379> sadd myset "kuangshen"

(integer) 1

127.0.0.1:6379> sadd myset2 "set2"

(integer) 1

127.0.0.1:6379> smove myset myset2 "kuangshen" #将一个指定的值,移动到另一个set集合中!

(integer) 1

127.0.0.1:6379> smembers myset

1) "hello"

2) "world"

127.0.0.1:6379> smembers myset2

1) "set2"

2) "kuangshen"

#####################################################################

微博!B站!共同关注!(并集)

数字结合类:

- 差集 sdiff

- 交集 sinter

- 并集 sunion

127.0.0.1:6379> sdiff key1 key2 # 差集

1) "a"

2) "b"

127.0.0.1:6379> sinter key1 key2 # 交集 共同好友就可以这样实现

1) "c"

127.0.0.1:6379> sunion key1 key2 # 并集

1) "a"

2) "b"

3) "c"

4) "e"

5) "d"

微博,A用户将所有关注的人放在一个set集合中!将他的粉丝也放在一个集合中!

共同关注,共同爱好,二度好友,推荐好友!(六度分割理论)

Hash(哈希)

Map集合,key-map!这个时候值是一个map集合!本质和String类型没有太大的区别,还是一个简单的 key-value!

set myhash field1 kuangshen

127.0.0.1:6379> hset myhash field1 kuangshen # set一个具体的 key-value

(integer) 1

127.0.0.1:6379> hget myhash field1 # 获取一个字段值

"kuangshen"

127.0.0.1:6379> hmset myhash field1 hello field2 kuangshen # set多个 key-value

OK

127.0.0.1:6379> hmget myhash field1 field2 # 获取多个字段值

1) "hello"

2) "kuangshen"

127.0.0.1:6379> hgetall myhash # 获取全部的数据

1) "field1"

2) "hello"

3) "field2"

4) "kuangshen"

127.0.0.1:6379> hdel myhash field1 # 删除hash指定的key字段!对应的value值也就消失了!

(integer) 1

127.0.0.1:6379> hgetall myhash

1) "field2"

2) "kuangshen"

#####################################################################

hlen

127.0.0.1:6379> hmset myhash field1 hello field2 wrold

OK

127.0.0.1:6379> hgetall myhash

1) "field1"

2) "hello"

3) "field2"

4) "wrold"

127.0.0.1:6379> hlen myhash # 获取hash表的字段数量!

(integer) 2

#####################################################################

127.0.0.1:6379> hexists myhash field1 # 判断hash中指定字段是否存在!

(integer) 1

127.0.0.1:6379> hexists myhash field3

(integer) 0

#####################################################################

127.0.0.1:6379> hkeys myhash # 只获得所有的field

1) "field1"

2) "field2"

127.0.0.1:6379> hvals myhash # 只获得所有的value

1) "hello"

2) "wrold"

#####################################################################

incr decr

127.0.0.1:6379> hset myhash field3 5 # 指定增量

(integer) 1

127.0.0.1:6379> hincrby myhash field3 1

(integer) 6

127.0.0.1:6379> hincrby myhash field3 -1

(integer) 5

127.0.0.1:6379> hsetnx myhash fiels4 hello # 如果不存在则可以设置

(integer) 1

127.0.0.1:6379> hsetnx myhash fiels4 world # 如果存在则不能设置

(integer) 0

#####################################################################

127.0.0.1:6379> hset user:1 name qingjiang

(integer) 1

127.0.0.1:6379> hget user:1 name

"qingjiang"

hash变更的数据user name age 尤其是用户信息之类的,经常变动的信息!hash 更适合于对象的储存,String更加适合字符串存储!

Zset(有序集合)

在set的基础上,增加了一个值,set k1 v1 , zset k1 score1 v1

127.0.0.1:6379> zadd myset 1 one # 添加一个值

(integer) 1

127.0.0.1:6379> zadd myset 2 two 3 three #添加多个值

(integer) 2

127.0.0.1:6379> zrange myset 0 -1

1) "one"

2) "two"

3) "three"

#####################################################################

排序如何实现

# zrangebyscore key min max

127.0.0.1:6379> zadd salary 2500 xiaohong # 添加三个用户

(integer) 1

127.0.0.1:6379> zadd salary 5000 zhangsan

(integer) 1

127.0.0.1:6379> zadd salary 500 kuangshen

(integer) 1

127.0.0.1:6379> zrangebyscore salary -inf +inf # 显示全部的用户!按从小到大排序

1) "kuangshen"

2) "xiaohong"

3) "zhangsan"

127.0.0.1:6379> zrevrange salary 0 -1 # 显示全部的用户!按从大到小排序

1) "zhangsan"

2) "xiaohong"

3) "kuangshen"

127.0.0.1:6379> zrangebyscore salary -inf +inf withscores # 显示全部的用户并且附带成绩

1) "kuangshen"

2) "500"

3) "xiaohong"

4) "2500"

5) "zhangsan"

6) "5000"

127.0.0.1:6379> zrangebyscore salary -inf 3000 withscores #显示工资小于三千的升序排列

1) "kuangshen"

2) "500"

3) "xiaohong"

4) "2500"

#####################################################################

移除rem中的元素

127.0.0.1:6379> zrange salary 0 -1

1) "kuangshen"

2) "xiaohong"

3) "zhangsan"

127.0.0.1:6379> zrem salary xiaohong # 移除有序集合中的指定元素

(integer) 1

127.0.0.1:6379> zrange salary 0 -1

1) "kuangshen"

2) "zhangsan"

127.0.0.1:6379> zcard salary # 获取有序集合的个数

(integer) 2

#####################################################################

127.0.0.1:6379> zadd myser 1 hello 2 wrold 3 kuangshen

(integer) 3

127.0.0.1:6379> zcount myser 1 3 # 获取指定区间的数量

(integer) 3

127.0.0.1:6379> zcount myser 1 2

(integer) 2

其余的一些API,通过我们的学习,你们剩下的如果工作中有需要,这个时候你可以去查看官方文档!

案例思路:set 排序 存储班级成绩表,工资表排序!

普通消息,1,重要消息,2,带权重进行判断!

排行榜应用实现,去Top N 测试!

三种特殊数据类型

geospatial

朋友的定位,附近的人,打车的举例计算?

Redis的 Geo在Redis 3.2版本就退出了!这个功能可以推算地理位置的信息,两地之间的距离,方圆几里的人!

可以查询一些数据:https://jingweidu.bmcx.com/

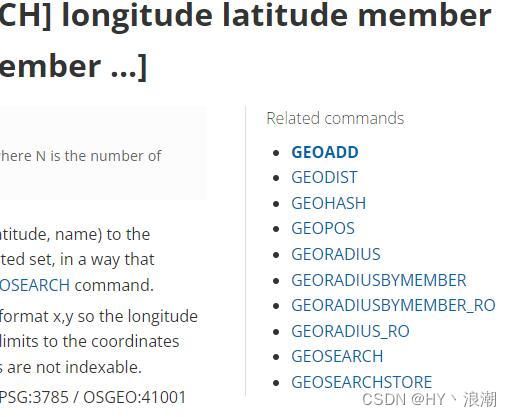

只有十个命令

官方文档:https://redis.io/commands/geoadd

getadd

# getadd 添加地理位置

# 规则:两级无法直接添加,我们一般会下载城市数据,直接通过java程序一次性导入!

# 有效经度为 -180 到 180 度。

# 有效纬度为 -85.05112878 到 85.05112878 度。

# 当用户尝试索引指定范围之外的坐标时,该命令将报告错误。

127.0.0.1:6379> geoadd china:city 39.90 116.40 beijing

(error) ERR invalid longitude,latitude pair 39.900000,116.400000

# 参数 key 值()

127.0.0.1:6379> geoadd china:city 116.40 39.90 beijing

(integer) 1

127.0.0.1:6379> geoadd china:city 121.47 31.23 shanghai

(integer) 1

127.0.0.1:6379> geoadd china:city 106.50 29.53 chongqin 114.05 22.52 shenzhen

(integer) 2

127.0.0.1:6379> geoadd china:city 120.16 30.24 hangzhou 108.96 34.26 xian

(integer) 2

getpos

获得当前定位:一定是一个坐标值!

127.0.0.1:6379> geopos china:city beijing # 获取指定的城市的经度和纬度!

1) 1) "116.39999896287918091"

2) "39.90000009167092543"

127.0.0.1:6379> geopos china:city beijing chongqin

1) 1) "116.39999896287918091"

2) "39.90000009167092543"

2) 1) "106.49999767541885376"

2) "29.52999957900659211"

geodist

两人之间的距离!

单位必须是以下之一,默认为米:

- m为米。

- 公里换公里。

- 英里数英里。

- 英尺换英尺。

127.0.0.1:6379> geodist china:city beijing shanghai km # 查看北京到上海的直线距离

"1067.3788"

127.0.0.1:6379> geodist china:city beijing chongqin km # 查看北京到重庆的直线距离

"1464.0708"

georadius 以给定的经纬度为中心,找出某一半径内的元素

我附近的人?(获得所有附近的人的地址,定位!)通过半径来查询!

获得指定数量的人,200

所有数据应该都录入:china:city,才会让结果更加准确!

127.0.0.1:6379> georadius china:city 110 30 1000 km # 以100,30 这个经纬度为中心,寻找方圆为1000km内的城市

1) "chongqin"

2) "xian"

3) "shenzhen"

4) "hangzhou"

127.0.0.1:6379> georadius china:city 110 30 500 km

1) "chongqin"

2) "xian"

127.0.0.1:6379> georadius china:city 110 30 500 km withdist # 显示到中心距离的位置

1) 1) "chongqin"

2) "341.9374"

2) 1) "xian"

2) "483.8340"

127.0.0.1:6379> georadius china:city 110 30 500 km withcoord # 显示他人的定位信息

1) 1) "chongqin"

2) 1) "106.49999767541885376"

2) "29.52999957900659211"

2) 1) "xian"

2) 1) "108.96000176668167114"

2) "34.25999964418929977"

127.0.0.1:6379> georadius china:city 110 30 500 km withdist withcoord count 1 #筛选出指定的结果!

1) 1) "chongqin"

2) "341.9374"

3) 1) "106.49999767541885376"

2) "29.52999957900659211"

127.0.0.1:6379> georadius china:city 110 30 500 km withdist withcoord count 2

1) 1) "chongqin"

2) "341.9374"

3) 1) "106.49999767541885376"

2) "29.52999957900659211"

2) 1) "xian"

2) "483.8340"

3) 1) "108.96000176668167114"

2) "34.25999964418929977"

georadiusbymember

# 找出位于指定元素周围的其他元素!

127.0.0.1:6379> georadiusbymember china:city beijing 1000 km

1) "beijing"

2) "xian"

127.0.0.1:6379> georadiusbymember china:city shanghai 400 km

1) "hangzhou"

2) "shanghai"

GEOHASH 命令-返回一个或多个位置元素的Geohash表示

该命令返回11个字符Geohash字符串!

# 将二维的经纬度转换成一维的字符串,如果两个字符串越接近,那么距离越近!

127.0.0.1:6379> geohash china:city beijing chongqin

1) "wx4fbxxfke0"

2) "wm5xzrybty0"

GEO 底层的实现原理其实就是 Zset !我们可以使用Zset命令来操作geo!

127.0.0.1:6379> zrange china:city 0 -1 # 查看地图中全部元素

1) "chongqin"

2) "xian"

3) "shenzhen"

4) "hangzhou"

5) "shanghai"

6) "beijing"

127.0.0.1:6379> zrem china:city beijing # 移除指定元素

(integer) 1

127.0.0.1:6379> zrange china:city 0 -1

1) "chongqin"

2) "xian"

3) "shenzhen"

4) "hangzhou"

5) "shanghai"

Hyperloglog

什么是基数?

A {1,3,5,7,8,7}

B {1,3,5,7,8}

基数(不重复的元素) = 5,可以接受误差!

简介

Redis 2.8.9 版本就更新了Hyperloglog数据结构!

Redis Hyperloglog 基数统计的算法!

优点:占用的内存是固定的,2^64不同的元素的技术,只需要费12KB的内存!

网页的 UV(一个人访问一个网站多次,但是还是算作一个人!)

传统的方式,set保存用户的id,然后可以统计 set 中的元素数量作为标准判断!

这个方式如果保存大量的用户id,就会比较麻烦!我们的目的是为了计数,而不是为了保存用户id!

0.81%错误率!统计UV任务,可以忽略不计的!

测试使用

127.0.0.1:6379> pfadd mykey a b c d e f g h i j # 创建第一组元素 mykey

(integer) 1

127.0.0.1:6379> pfcount mykey # 统计 key 元素的基数数量

(integer) 10

127.0.0.1:6379> pfadd mykey2 i j z x c v b n m # 创建第二组元素 mykey2

(integer) 1

127.0.0.1:6379> pfcount mykey2

(integer) 9

127.0.0.1:6379> pfmerge mykey3 mykey mykey2 # 合并两组mykey + mykey2 => mykey3 (并集)

OK

127.0.0.1:6379> pfcount mykey3 # 看并集的数量!

(integer) 15

如果允许容错,那一定以使用Hyperloglog !

如果不允许容错,就使用 set 或者自己的数据类型即可 !

Bitmap

位存储

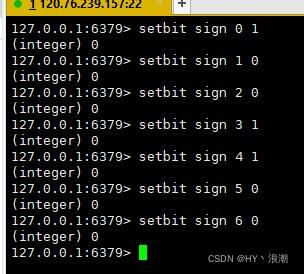

统计用户信息,活跃,不活跃!登录,未登录!打卡,365打卡!两个状态的,都可以使用Bitmaps!

Bitmaps 位图,数据结构!都是操作二进制来进行记录,就只有0和1两个状态!

365天 = 365 bit 1字节 = 8bit 46个字节左右!

测试

使用Bitmaps来记录 周一到周日的打卡!

周一:1 周二:0 周三:0 周四:1 …

查看某一天是否打卡!

127.0.0.1:6379> getbit sign 3

(integer) 1

127.0.0.1:6379> getbit sign 6

(integer) 0

统计操作,统计打卡的天数!

127.0.0.1:6379> bitcount sign # 统计这种的打卡记录,就可以看到是否全勤!

(integer) 3

事务

Redis 事务本质:一组命令的集合!一个事务中的所有命令都会被序列化,在事务执行的过程中,会按照顺序执行!一次性、顺序新、排他性!执行一些列的命令!

----------- 队列 set set set 执行 ----------

Redis事务没有隔离级别的概念!

所有的命令在事务中,并没有直接被执行!只有发起执行命令的时候才会执行!exec

Redis单条命令式保存原子性的,但是事务不保证原子性!

redis的事务:

- 开启事务(multi)

- 命令入队(…)

- 执行事务(exec)

正常执行事务!

127.0.0.1:6379> multi # 开启事务

OK

# 命令入队

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> get k2

QUEUED

127.0.0.1:6379(TX)> set k3 v3

QUEUED

127.0.0.1:6379(TX)> exec # 执行事务

1) OK

2) OK

3) "v2"

4) OK

放弃事务!

127.0.0.1:6379> multi # 开启事务

OK

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> set k4 v4

QUEUED

127.0.0.1:6379(TX)> discard # 取消事务

OK

127.0.0.1:6379> get k4 # 事务队列中命令都不会被执行!

(nil)

编译型异常(代码有问题!命令有错!),事务中所有的命令都不会被执行!

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> set k3 v3

QUEUED

127.0.0.1:6379(TX)> setget k3 # 错误的命令

(error) ERR unknown command `setget`, with args beginning with: `k3`,

127.0.0.1:6379(TX)> set k4 v4

QUEUED

127.0.0.1:6379(TX)> exec # 执行事务报错!

(error) EXECABORT Transaction discarded because of previous errors.

127.0.0.1:6379> get k4 # 所有的命令都不会被执行!

(nil)

运行时异常(1/0),如果事务队列中存在语法性,那么执行命令的时候,其他命令是可以政策执行的,错误命令抛出!

127.0.0.1:6379> set k1 "v1"

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> incr k1 # 会执行的时候失败!

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> set k3 v3

QUEUED

127.0.0.1:6379(TX)> get k3

QUEUED

127.0.0.1:6379(TX)> exec

1) (error) ERR value is not an integer or out of range # 虽然第一条执行失败了,但是依旧正常执行成功了!

2) OK

3) OK

4) "v3"

127.0.0.1:6379> get k2

"v2"

127.0.0.1:6379> get k3

"v3"

监控!Watch(面试常问!)

悲观锁:

- 很悲观,任务什么时候都会出问题,无论做什么都会加锁!

乐观锁:

- 很乐观,认为什么时候都不会出问题,所以不会上锁!更新数据的时候去判断一下,在此期间是否有人修改过这个数据

- 获取version

- 跟新的时候比较version

Redis测监事测试

正常执行成功!

127.0.0.1:6379> set money 100

OK

127.0.0.1:6379> set out 0

OK

127.0.0.1:6379> watch money # 监事 money 对象

OK

127.0.0.1:6379> multi #事务正常结束,数据期间没有发生变动,这个时候就正常执行成功!

OK

127.0.0.1:6379(TX)> decrby money 20

QUEUED

127.0.0.1:6379(TX)> incrby out 20

QUEUED

127.0.0.1:6379(TX)> exec

1) (integer) 80

2) (integer) 20

测试多线程修改值,使用watch可以当做redis的乐观锁操作!

127.0.0.1:6379> watch money # 监视

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> decrby money 10

QUEUED

127.0.0.1:6379(TX)> incrby out 10

QUEUED

127.0.0.1:6379(TX)> exec # 执行之前,另一个线程修改了我们的值,这个时候就会导致事务执行失败!

(nil)

如果修改失败,回去最新的值就好

127.0.0.1:6379> unwatch # 1、如果发现事务执行失败,就先解锁

OK

127.0.0.1:6379> watch money # 2、获取最新的值,在此监视,select version

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> decrby money 10

QUEUED

127.0.0.1:6379(TX)> incrby out 10

QUEUED

127.0.0.1:6379(TX)> exec # 3、比对监视的值是否发生了变化,如果没有变化,那么可以执行成功,如果变量就

1) (integer) 90 # 执行失败

2) (integer) 10

Jedis

我们要使用java来操作Redis。

什么是jedis 是 Redis 官方推荐的java连接开发工具!使用 java操作redis中间件!如果你要使用java操作redis,那么一定要对jedis十分的熟悉!

测试

1、当如对应的依赖

<dependencies>

<dependency>

<groupId>redis.clientsgroupId>

<artifactId>jedisartifactId>

<version>4.2.0-m1version>

dependency>

<dependency>

<groupId>com.alibabagroupId>

<artifactId>fastjsonartifactId>

<version>1.2.79version>

dependency>

dependencies>

2、编码测试:

- 连接数据库

- 操作命令

- 断开连接

package com.kuang;

import redis.clients.jedis.Jedis;

public class TestPing {

public static void main(String[] args) {

// 1、 new jedis 对象即可

Jedis jedis = new Jedis("127.0.0.1", 6379);

// jedis 所有的命令就是我们之前学习的所有命令!所有之前的学习很重要!

System.out.println(jedis.ping());

}

}

控制台输出:PONG

**注意:**如果你输出报这个错误就在pom.xml中添加下面两个依赖包

SLF4J: Failed to load class “org.slf4j.impl.StaticLoggerBinder”.

SLF4J: Defaulting to no-operation (NOP) logger implementation

SLF4J: See http://www.slf4j.org/codes.html#StaticLoggerBinder for further details.

<dependency>

<groupId>log4jgroupId>

<artifactId>log4jartifactId>

<version>1.2.12version>

dependency>

<dependency>

<groupId>org.slf4jgroupId>

<artifactId>slf4j-log4j12artifactId>

<version>1.6.6version>

dependency>

常用的API

String List Set Hash Zset

所有的api命令,就是我们对应的上面学习的指令,一个都没有变化!

事务

package com.kuang;

import com.alibaba.fastjson.JSONObject;

import redis.clients.jedis.Jedis;

import redis.clients.jedis.Transaction;

public class TestTX {

public static void main(String[] args) {

Jedis jedis = new Jedis("127.0.0.1", 6379);

jedis.flushDB(); //清空当前数据库

JSONObject jsonObject = new JSONObject();

jsonObject.put("hello","world");

jsonObject.put("name","kaungshen");

//开启事务

Transaction multi = jedis.multi();

String result = jsonObject.toJSONString();

//jedis.watch(result);

try {

multi.set("user1",result);

multi.set("user2",result);

int i = 1/0;//代码抛出异常事务,执行失败!

multi.exec();//执行事务!

} catch (Exception e) {

multi.discard();//放弃事务!

e.printStackTrace();

}finally {

System.out.println(jedis.get("user1"));

System.out.println(jedis.get("user2"));

jedis.close();//关闭事务

}

}

}

SpringBoot整合

SpringBoot 操作数据:spring-data jpa jdbc monhodb redis!

SpringData 也是和SpringBoot 齐名的项目 !

说明:在SpringBoot2.x之后,原来使用的jedis被替换为lettuce?

jedis:采用的智联,多个线程操作的话,是不安全的,如果想要避免不安全的,使用dedis pool 连接池!更像 BIO 模式

lettuce:采用netty,实例可以在多个线程照片那个进行共享,不存在线程不安全的情况!可以减少线程数据了,更像 Nio 模式

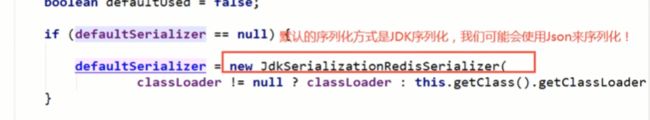

源码分析:

@Bean

@ConditionalOnMissingBean(name = "redisTemplate") //我们可以自己定义一个redisTemplate来替换这个默认的

public RedisTemplate<Object, Object> redisTemplate(RedisConnectionFactory redisConnectionFactory)

throws UnknownHostException {

// 默认的RedisTemplate直接使用此类内部默认设置操作数据,但是Redis对象需要序列化

// 泛型都是Object,后面使用的话,大都是RedisTemplate整合测试一下

1、导入依赖

2、配置连接

# 配置redis

spring.redis.host=127.0.0.1

spring.redis.port=6379

3、测试!

package com.kuang;

import org.junit.jupiter.api.Test;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.boot.test.context.SpringBootTest;

import org.springframework.data.redis.core.RedisTemplate;

@SpringBootTest

class Redis02SpringbootApplicationTests {

@Autowired

private RedisTemplate redisTemplate;

@Test

void contextLoads() {

//redisTemplate 操作不同的数据类型,api和我们的指令是一样的

//opsForValue 操作字符串 类似String

//opsForList 操作List 类似List

//opsForSet

//opsForHash

//opsForZSet

//opsForGeo

//opsForHyperLogLog

//除了进本的操作,我们常用的方法都可以直接通过redisTemplate操作,比如事务,和基本的CRUD

// 获得redis的连接对象

//RedisConnection connection = redisTemplate.getConnectionFactory().getConnection();

//connection.flushDb();

//connection.flushAll();

redisTemplate.opsForValue().set("mykey","小火子");

System.out.println(redisTemplate.opsForValue().get("mykey"));

}

}

Linux中的客户端取到的却是乱码

127.0.0.1:6379> keys *

1) "\xac\xed\x00\x05t\x00\x05mykey"

关于对象的保存:所有的对象,都需要序列化

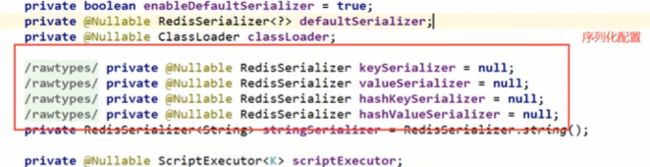

编写我们自己的 RedisTemplate

@Bean

public RedisTemplate<String, Object> redisTemplate(RedisConnectionFactory factory) {

RedisTemplate<String, Object> template = new RedisTemplate<>();

// 配置连接工厂

template.setConnectionFactory(factory);

//使用Jackson2JsonRedisSerializer来序列化和反序列化redis的value值(默认使用JDK的序列化方式)

Jackson2JsonRedisSerializer jacksonSeial = new Jackson2JsonRedisSerializer(Object.class);

ObjectMapper om = new ObjectMapper();

// 指定要序列化的域,field,get和set,以及修饰符范围,ANY是都有包括private和public

om.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY);

// 指定序列化输入的类型,类必须是非final修饰的,final修饰的类,比如String,Integer等会跑出异常

// om.enableDefaultTyping(ObjectMapper.DefaultTyping.NON_FINAL); // 保留这行会报错:Unexpected token (VALUE_STRING)

jacksonSeial.setObjectMapper(om);

// 值采用json序列化

template.setValueSerializer(jacksonSeial);

//使用StringRedisSerializer来序列化和反序列化redis的key值

template.setKeySerializer(new StringRedisSerializer());

// 设置hash key 和value序列化模式

template.setHashKeySerializer(new StringRedisSerializer());

template.setHashValueSerializer(jacksonSeial);

template.afterPropertiesSet();

//redisTemplate = template; // 注入失败,故直接用属性来获取

return template;

}

所有的redis操作,其实对于java开发人员来说,十分的简单,更重要的是要去理解redis的思想和每一种数据结构的用处和作用场景!

Redis.conf详解

启动的时候,就通过配置文件来启动!

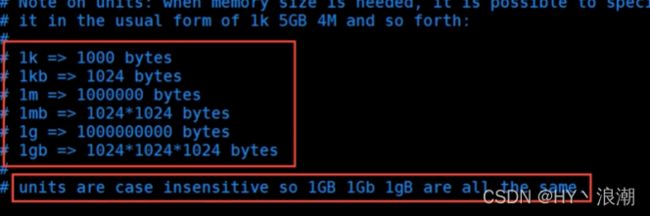

1、Units

单位!配置文件 untis 单位 对大小写不敏感!

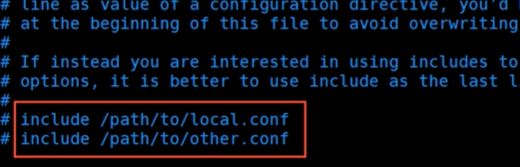

2、includes

包含,可以在Redis启动的时候再加载一些除了Redis.conf之外的其他的配置文件,和Spring的import,jsp的include类似

3、NETWORK

网络,表示Redis启动时开放的端口默认与本机绑定

bind 127.0.0.1 # 绑定的ip

protected-mode yes # 保护模式

port 6379 # 端口设置

4、GENERAL

daemonize yes # 以守护进程的方式运行,默认为no,需要手动改为yes

pidfile /var/run/redis_6379.pid #如果以守护进程的方式运行,就需要指定一个pid文件!

# 日志

# Specify the server verbosity level.

# This can be one of:

# debug (a lot of information, useful for development/testing)

# verbose (many rarely useful info, but not a mess like the debug level)

# notice (moderately verbose, what you want in production probably)

# warning (only very important / critical messages are logged)

loglevel notice

logfile "" # 日志的文件位置名

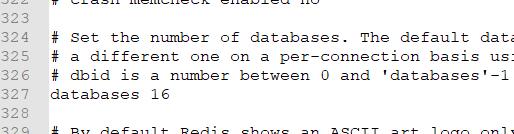

database 16 # 数据库的数量,默认是16个

always-show-logo yes # 是否总是显示LOGO

5、SNAPSHOTTING

中文翻译为快照!持久化,如果在规定的时间内,执行了多少次操作,。则会持久化到文件 .rdb.aof

Redis是一个内存数据库,如果没有持久化,那么就会出现断电即失!

# 在900秒内,至少有一个key被修改(添加),就会进行持久化操作

save 900 1

# 在300秒内,至少有10个key被修改,就会进行持久化操作

save 300 10

# 在60秒内,至少有1万个key被修改,就会进行持久化操作

save 60 10000

# 我们之后学习持久化,会自己定义这个测试!

rdbcompression yes # 持久化如果出错,是否还需要继续工作

rdbchecksum yes # 是否压缩 rdb 文件,需要消耗一些CPU资源!

rdbchecksum yes # 保存rdb文件的时候,进行错误的检查效验!

dir ./ # rdb 文件的保存目录!

6、REPLICATION

复制主机上的数据,当前配置所指定的IP和端口号即为主机

# Redis在配置文件中将此配置注释,默认不使用,下同

# replicaof

如果配置的主机有密码,需要配置此密码以通过master的验证

# masterauth 7、SECRULITY

安全,可以在配置文件中设置Redis的登录密码,默认是没有密码的

127.0.0.1:6379> ping

PONG

127.0.0.1:6379> config get requirepass # 获取redis的密码

1) "requirepass"

2) ""

127.0.0.1:6379> config set requirepass "123456" # 设置redis的密码

OK

127.0.0.1:6379> config get requirepass # 发现所有的命令都没有权限了

(error) NOAUTH Authentication required.

127.0.0.1:6379> ping

(error) NOAUTH Authentication required.

127.0.0.1:6379> auth 123456 # 使用密码进行登录!

OK

127.0.0.1:6379> config get requirepass

1) "requirepass"

2) "123456"

8、CLIENT

maxclients 10000 # 设置Redis允许存在的客户端的最大的数量

maxmemory <bytes> # 配置Redis最大的内存容量

maxmemory-policy noeviction # 内存达到上限之后的处理策略

处理策略有以下几种:

- noeviction:默认策略,不淘汰,如果内存已满,添加数据是报错。

- allkeys-lru:在所有键中,选取最近最少使用的数据抛弃。

- volatile-lru:在设置了过期时间的所有键中,选取最近最少使用的数据抛弃。

- allkeys-random: 在所有键中,随机抛弃。

- volatile-random: 在设置了过期时间的所有键,随机抛弃。

- volatile-ttl:在设置了过期时间的所有键,抛弃存活时间最短的数据

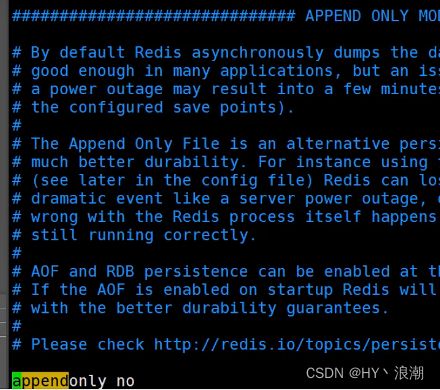

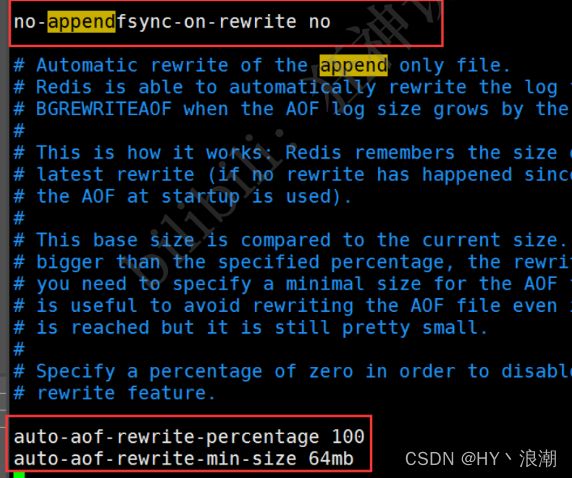

9、APPEND ONLY MODE

appendonly no # 默认不开启AOF模式,Redis默认开启的是持久化模式是RDB,在大部分情况下,RDB的模式完全够用

appendfilename "appendonly.aof"

# appendfsync always # 表示每次修改都会进行数据同步,速度较慢,消耗性能

appendfsync everysec # 数据不同步,每秒记录一次

# appendfsync no # 不执行同步,不消耗性能,速度最快!

具体的配置,我们在redis持久化中去给大家详细讲解!

Redis持久化

面试和工作,持久化都是重点!

Redis 是内存数据库,如果不将内存中的数据库状态保存到磁盘,那么一旦服务器进程退出,服务器中的数据库状态也会消失。所以Redis 提供了持久化功能!

RDB(Redis DadaBase)

什么是RDB

在指定的时间间隔内将数据集快照写入到磁盘中,也就是行话讲的的Snapshot快照,它恢复数据的时候将这些快照文件读取到内存中。

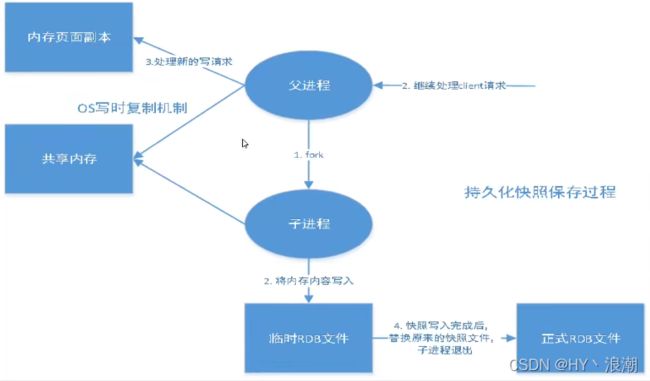

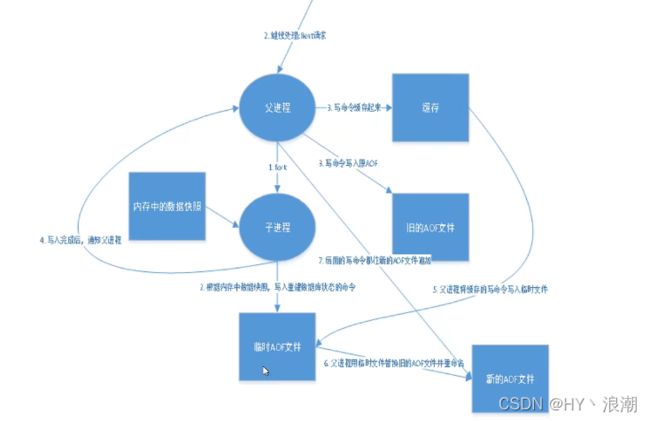

Redis会单独创建出一个子进程(fork)来进行持久化,会将数据写入到一个临时文件中,待持久化操作结束之后,临时文件会将已经持久化完成的文件替换掉。整个过程中,主进程不进行任何IO操作,这也就确保RDB极高的性能,相比于RDB和AOF,RDB的模式会比AOF更加的高效。RDB的缺点就是最后一次持久化后的数据可能会丢失!

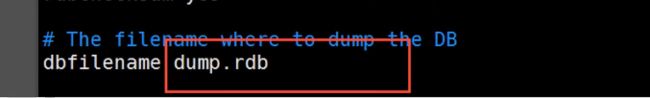

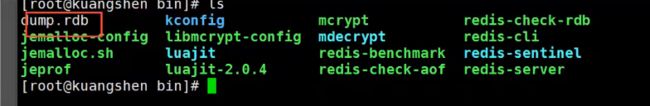

rdb保存的文件是dump.rdb 都是在我们配置文件中快照中进行配置的!

触发机制

1、sava的规则满足的情况下,会自动触发rdb规则

2、执行flushall 命令,也会触发我们的 rdb规则!

3、退出redis,也会产生 rdb 文件!

备份就自动生成一个 dump.rdb

如何恢复 rdb 文件!

1、只需要将 rdb 文件放在我们redis启动目录就可以,redis启动的时候会自动检查dump.rdb 恢复其中的数据!

2、查看需要存在的位置

127.0.0.1:6379> config get dir

1) "dir"

2) "/usr/local/bin"

几乎就他自己默认的配置就够用了,但是我们还是需要去学习!

优点:

1、适合大规模的数据恢复!

2、对数据的完整性要求不高!

缺点:

1、需要一定的时间间隔进程操作!如果redis以外宕机了,这个最好一次修改数据就没有的了!

2、fork进程的时候,会占用一定的内存空间!

AOF(Append Only File)

将我们的所有命令都记录下来,history,恢复的时候就把这个文件全部再执行一遍!

是什么

它用日志的形式来记录每一个写操作,将Redis执行过的命令进行记录(读操作不记录),只追加文件,不改写文件。Redis在启动时会自动加载AOF持久化的文件重新构建数据,也就是Redis重启会把AOF持久化文件中的信息从前到后执行一次以完成数据的恢复

Aof保存的是 appendonly.aof 文件

append

重启,rendis就可以生效了

如果这个 aof 文件有错误,这时候 redis 是启动不起来的。我们需要修复这个aof 文件

redis 给我们提供了一个工具 redis-check-aof --fix

[root@langchao bin] redis-check-aof --fix appendonly.aof

0x 167: Expected \r\n, got: 6769

AOF analyzed: size=383, ok_up_to=351, diff=32

This will shrink the AOF from 383 bytes, with 32 bytes, to 351 bytes

Continue? [y/N]: y

Successfully truncated AOF

如果文件正常,重启就可以直接恢复了!

重写规则说明(了解即可)

aof 默认就是文件的无限追加,文件会越来越大!

如果aof 文件大于 64m,太大了,fork一个新的进程来将我们的文件进行重写!

优点和缺点!

优点:

1、每一次修改都同步,文件的完整会更加好!

2、每秒同步一次,可能会丢失一秒的数据

3、从不同步,效率最高的!

缺点:

1、相对于数据文件来说,aof 远远大于 rdb,修复的速度也比 rdb 慢!

2、Aof 运行效率也要比 rdb 慢,所以我们redis默认的配置就是 rdb 持久化!

扩展:

- RDB 持久化方式能够在指定的时间间隔内对你的数据进行快照存储

- AOF 持久化方式记录每次对服务器写的操作,当服务器重启的时候会重新执行这些命令来恢复原始

的数据,AOF命令以Redis 协议追加保存每次写的操作到文件末尾,Redis还能对AOF文件进行后台重

写,使得AOF文件的体积不至于过大。 - 只做缓存,如果你只希望你的数据在服务器运行的时候存在,你也可以不使用任何持久化

- 同时开启两种持久化方式

- 在这种情况下,当redis重启的时候会优先载入AOF文件来恢复原始的数据,因为在通常情况下AOF

文件保存的数据集要比RDB文件保存的数据集要完整。 - RDB 的数据不实时,同时使用两者时服务器重启也只会找AOF文件,那要不要只使用AOF呢?作者

建议不要,因为RDB更适合用于备份数据库(AOF在不断变化不好备份),快速重启,而且不会有

AOF可能潜在的Bug,留着作为一个万一的手段。

- 性能建议

- 因为RDB文件只用作后备用途,建议只在Slave上持久化RDB文件,而且只要15分钟备份一次就够

了,只保留 save 900 1 这条规则。 - 如果Enable AOF ,好处是在最恶劣情况下也只会丢失不超过两秒数据,启动脚本较简单只load自

己的AOF文件就可以了,代价一是带来了持续的IO,二是AOF rewrite 的最后将 rewrite 过程中产

生的新数据写到新文件造成的阻塞几乎是不可避免的。只要硬盘许可,应该尽量减少AOF rewrite

的频率,AOF重写的基础大小默认值64M太小了,可以设到5G以上,默认超过原大小100%大小重

写可以改到适当的数值。 - 如果不Enable AOF ,仅靠 Master-Slave Repllcation 实现高可用性也可以,能省掉一大笔IO,也

减少了rewrite时带来的系统波动。代价是如果Master/Slave 同时倒掉(断电!),会丢失十几分钟的数据,

启动脚本也要比较两个 Master/Slave 中的 RDB文件,载入较新的那个,微博就是这种架构。

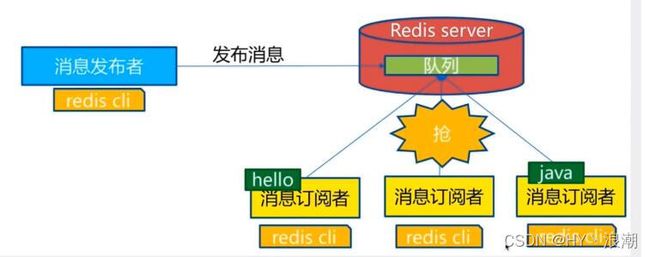

Redis发布订阅

Redis 发布订阅(pub/sub)是一种消息通信模式:发送者(pub)发送消息,订阅者(sub)接收消息。微信、微博、关注系统!

Redis 客户端可以订阅任意数量的频道。

订阅/发布消息图:

第一个:消息发送者——第二个:频道——第三个:消息订阅者

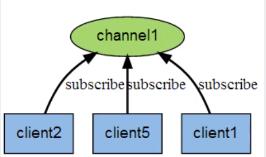

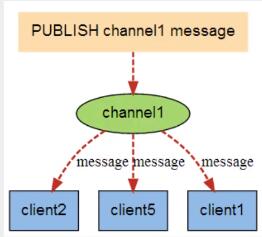

下图展示了频道channel1,以及订阅这个频道的三个客户端——client2、client5和client1之间的关系:

当有消息通过PUBLISH 命令发送给频道 channel1时,这个消息就会被发送给订阅它的三个客户端:

命令

这些命令被广泛用于构建即时通信应用,比如网络聊天室,广播等

订阅端:

127.0.0.1:6379> SUBSCRIBE smallyellow # 订阅一个频道叫smallyellow

Reading messages... (press Ctrl-C to quit)

1) "subscribe"

2) "smallyellow"

3) (integer) 1

# 一旦开始订阅,会立即占用当前进程去监听自己所订阅的那个Channel

1) "message"

2) "smallyellow"

3) "Hello!I love Java!!"

1) "message"

2) "smallyellow"

3) "Hello!I love Redis!!"

发送端:

127.0.0.1:6379> PUBLISH smallyellow "Hello!I love Java!!" # 往频道smallyellow中发布一条消息

(integer) 1

127.0.0.1:6379> PUBLISH smallyellow "Hello!I love Redis!!"

(integer) 1

127.0.0.1:6379>

原理:

Redis是使用C实现的,通过分析 Redis 源码里的 pubsub.c 文件,了解发布和订阅机制的底层实现,籍 此加深对 Redis 的理解。

Redis 通过 PUBLISH 、SUBSCRIBE 和 PSUBSCRIBE 等命令实现发布和订阅功能。

微信:

通过 SUBSCRIBE 命令订阅某频道后,redis-server里维护了一个字典,字典的键是一个个 频道!, 而字典的值则是一个链表,链表中保存了所有订阅这个channel客户端。SUBSCRIBE 命令的关键, 就是将客户端添加到给定 channel的订阅链表中。

通过 PUBLISH 命令向订阅者发送消息,redis-server会使用给定的频道作为键,它所维护的 channel 字典中查找记录了订阅这个频道的所有客户端的链表,遍历这表,将消息发布给所有订阅者。

Pub/Sub 从字面上理解就是发布(Publish)与订阅(Subscribe),在Redis中,可以设定对某一个 key值进行消息发布及消息订阅,当一个key值上进行了消息发后,所有订阅它的客户端都会收到相应的消息。这一功能明显的用法就是用作实时消系统,比如普通的即时聊天,群聊等功能。

使用场景:

- 实时消息系统!

- 事实聊天!(频道当做聊天室,将信息回显给所有人即可!)

- 订阅,关注系统都是可以的! 稍微复杂的场景我们就会使用 消息中间件MQ()

Redis主从复制

概念

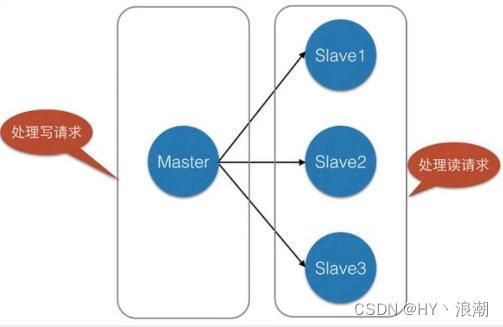

主从复制,是指将一台Redis服务器的数据,复制到其他的Redis服务器。前者称为主节点(Master/Leader),后者称为从节点(Slave/Follower), 数据的复制是单向的!只能由主节点复制到从节点(主节点以写为主、从节点以读为主)。

默认情况下,每台Redis服务器都是主节点;

一个主节点可以有0个或者多个从节点,但每个从节点只能由一个主节点。

主从复制的作用主要包括:

- 数据冗余:主从复制实现了数据的热备份,是持久化之外的一种数据冗余的方式。

- 故障恢复:当主节点故障时,从节点可以暂时替代主节点提供服务,是一种服务冗余的方式

- 负载均衡:在主从复制的基础上,配合读写分离,由主节点进行写操作,从节点进行读操作,分担服务器的负载;尤其是在多读少写的场景下,通过多个从节点分担负载,提高并发量。

- 高可用(集群)基石:主从复制还是哨兵和集群能够实施的基础。

一般来说,要将Redis运用于工程项目中,只使用一台Redis是万万不能的(宕机),原因如下:

- 从结构上,单个Redis服务器会发生单点故障,并且一台服务器需要处理所有的请求负载,压力较 大;

- 从容量上,单个Redis服务器内存容量有限,就算一台Redis服务器内存容量为256G,也不能将所有 内存用作Redis存储内存,一般来说,单台Redis大使用内存不应该超过20G。

- 电商网站上的商品,一般都是一次上传,无数次浏览的,说专业点也就是"多读少写"。

对于这种场景,我们可以使如下这种架构:

主从复制,读写分离!80%的情况下都是在进行读操作!减缓服务器的压力!架构中经常使用! 一主 二从!

只要在公司中,主从复制就是必须要使用的,因为在真实的项目中不可能单机使用Redis!

环境配置

只配置从库,不配置主库

127.0.0.1:6379> info replication # 查看当前库的信息 # Replication

role:master # 角色

master connected_slaves:0 # 没有从机

master_replid:b63c90e6c501143759cb0e7f450bd1eb0c70882a

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:0

second_repl_offset:-1

repl_backlog_active:0

repl_backlog_size:1048576

repl_backlog_first_byte_offset:0

repl_backlog_histlen:0

复制3个配置文件,然后修改对应的信息

- 端口

- pid 名字

- log文件名字

- dump.rdb 名字

修改完毕之后,启动我们的3个redis服务器,可以通过进程信息查看!

一主二从

默认情况下,每台Redis服务器都是主节点;我们一般情况下只用配置从就好了!

认老大! 一主 (79)二从(80,81)

127.0.0.1:6380> SLAVEOF 127.0.0.1 6379 # SLAVEOF host 6379 找谁当自己的老大!

OK

127.0.0.1:6380> info replication

# Replication

role:slave # 当前角色是从机

master_host:127.0.0.1 # 可以的看到主机的信息

master_port:6379

master_link_status:up

master_last_io_seconds_ago:3

master_sync_in_progress:0

slave_repl_offset:14

slave_priority:100

slave_read_only:1

connected_slaves:0 master_replid:a81be8dd257636b2d3e7a9f595e69d73ff03774e

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:14

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:14

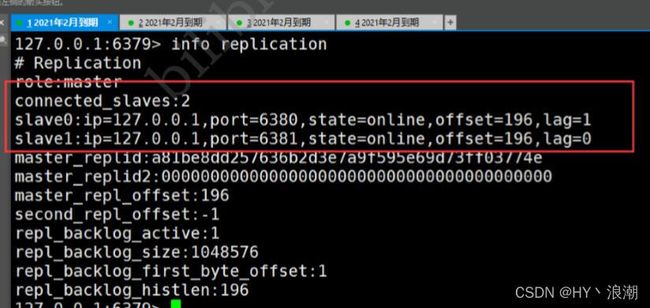

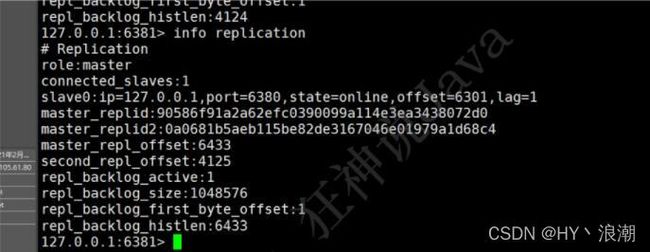

# 在主机中查看!

127.0.0.1:6379> info replication

# Replication

role:master connected_slaves:1 # 多了从机的配置

slave0:ip=127.0.0.1,port=6380,state=online,offset=42,lag=1 # 多了从机的配置

master_replid:a81be8dd257636b2d3e7a9f595e69d73ff03774e

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:42

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:42

如果两个都配置完了,就是有两个从机

真实的从主配置应该在配置文件中配置,这样的话是永久的,我们这里用的是命令,暂时的!

细节

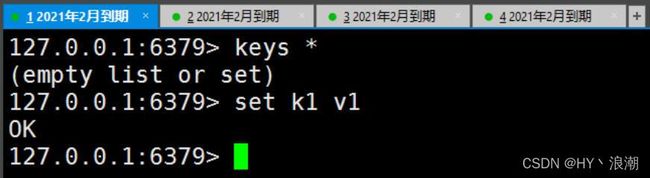

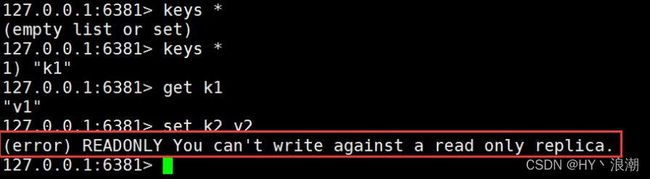

主机可以写,从机不能写只能读!主机中的所有信息和数据,都会自动从机保存!

主机写:

从机只能读取内容!

测试:主机断开连接,从机依旧连接到主机的,但是没有写操作,这个候,主机如果回来了,从机依旧可以直接获取到主机写的信息!

如果是使用命令行,来配置的主从,这个时候如果重启了,就会变回主机!只要变为从机,立马就会从

主机中获取值!

复制原理

Slave 启动成功连接到 master 后会发送一个sync同步命令

Master 接到命令,启动后台的存盘进程,同时收集所有接收到的用于修改数据集命令,在后台进程执行

完毕之后,master将传送整个数据文件到slave,并完成一次完全同步。

全量复制:而slave服务在接收到数据库文件数据后,将其存盘并加载到内存中。

增量复制:Master 继续将新的所有收集到的修改命令依次传给slave,完成同步

但是只要是重新连接master,一次完全同步(全量复制)将被自动执行! 我们的数据一定可以在从机中

看到!

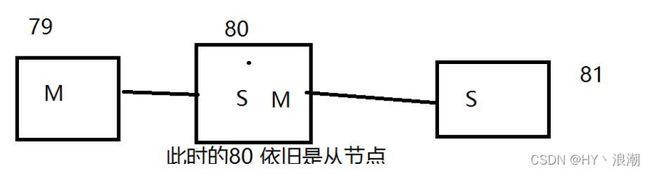

层层链路

上一个M链接下一个 S!

这时候也可以完成我们的主从复制!

如果没有老大了,这个时候能不能选择一个老大出来呢? 手动!

谋朝篡位

如果主机断开了连接,我们可以使用 SLAVEOF no one 让自己变成主机!其他的节点就可以手动连

接到最新的这个主节点(手动)!如果这个时候老大修复了,那就重新连接!

哨兵模式

(自动选举老大的模式)

概述

主从切换技术的方法是:当主服务器宕机后,需要手动把一台从服务器切为主服务器,这就需要人工干预,费事费力,还会造成一段时间内服务不可荐的方式,更多时候,我们优先考虑哨兵模式。Redis从2.8开始正式提供了Sentinel(哨兵) 架构来解决这个问题。

谋朝篡位的自动版,能够后台监控主机是否故障,如果故障了根据投票数自动将从库转换为主库。

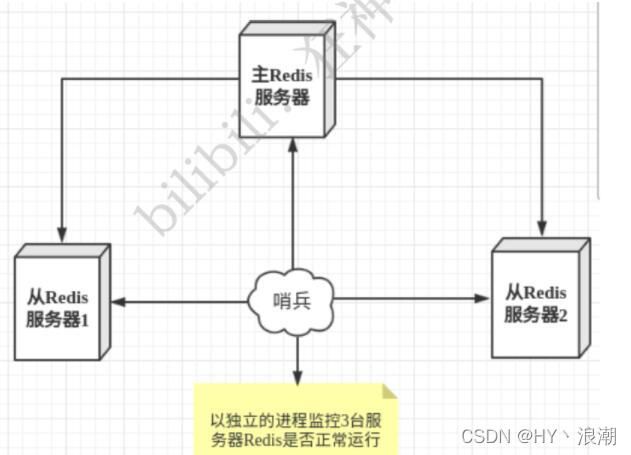

哨兵模式是一种特殊的模式,首先Redis提供了哨兵的命令,哨兵是一个独立的进程,作为进程,它会独

立运行。其原理是哨兵通过发送命令,等待Redis服务器响应,从而监控运行的多个Redis实例。

这里的哨兵有两个作用

- 通过发送命令,让Redis服务器返回监控其运行状态,包括主服务器和从服务器。

- 当哨兵监测到master宕机,会自动将slave切换成master,然后通过发布订阅模式通知其他的从服

务器,修改配置文件,让它们切换主机。

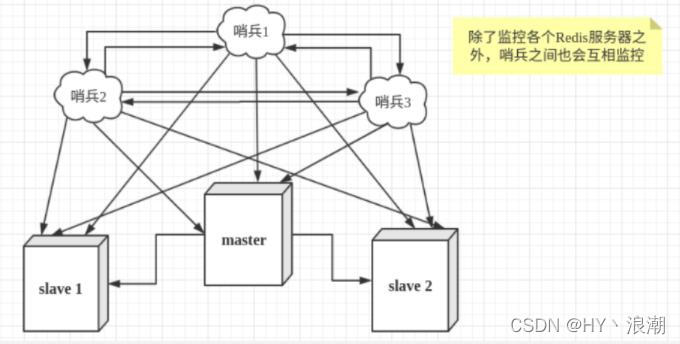

然而一个哨兵进程对Redis服务器进行监控,可能会出现问题,为此,我们可以使用多个哨兵进行监控。

各个哨兵之间还会进行监控,这样就形成了多哨兵模式。

设主服务器宕机,哨兵1先检测到这个结果,系统并不会马上进行failover过程,仅仅是哨兵1主观的认

为主服务器不可用,这个现象成为 主观下线 。当后面的哨兵也检测到主服务器不可用,并且数量达到一

定值时,那么哨兵之间就会进行一次投票,投票的结果由一个哨兵发起,进行failover[故障转移]操作。

切换成功后,就会通过发布订阅模式,让各个哨兵把自己监控的从服务器实现切换主机,这个过程称为

客观下线。

测试!

我们目前的状态是 一主二从!

1.配置哨兵配置文件 sentinel.conf

# sentinel monitor 被监控的名称 host port 1

sentinel montitor myredis 127.0.0.1 6379 1

后面的这个数字1,代表主机挂了,slave投票看让谁接替成为主机,票数最多的,就会成为主机!

2.启动哨兵!

[root@kuangshen bin]# redis-sentinel kconfig/sentinel.conf

26607:X 31 Mar 2020 21:13:10.027 # oO0OoO0OoO0Oo Redis is starting oO0OoO0OoO0Oo

26607:X 31 Mar 2020 21:13:10.027 # Redis version=5.0.8, bits=64,

commit=00000000, modified=0, pid=26607, just started

26607:X 31 Mar 2020 21:13:10.027 # Configuration loaded

_._

_.-``__ ''-._

_.-`` `. `_. ''-._ Redis 5.0.8 (00000000/0) 64 bit

.-`` .-```. ```\/ _.,_ ''-._

( ' , .-` | `, )` _.-'| Running in sentinel mode

|`-._`-...-` __...-.``-._|' Port: 26379

| `-._ `._ / _.-' | PID: 26607

`-._ `-._ `-./ _.-' _.-'

|`-._`-._ `-.__.-' _.-'_.-'|

| `-._`-._ _.-'_.-' | http://redis.io

`-._ `-._`-.__.-'_.-' _.-'

|`-._`-._ `-.__.-' _.-'_.-'|

| `-._`-._ _.-'_.-' |

`-._ `-._`-.__.-'_.-' _.-'

26607:X 31 Mar 2020 21:13:10.029 # WARNING: The TCP backlog setting of 511

cannot be enforced because /proc/sys/net/core/somaxconn is set to the lower value

of 128.

26607:X 31 Mar 2020 21:13:10.031 # Sentinel ID is

4c780da7e22d2aebe3bc20c333746f202ce72996

26607:X 31 Mar 2020 21:13:10.031 # +monitor master myredis 127.0.0.1 6379 quorum

1

26607:X 31 Mar 2020 21:13:10.031 * +slave slave 127.0.0.1:6380 127.0.0.1 6380 @

myredis 127.0.0.1 6379

26607:X 31 Mar 2020 21:13:10.033 * +slave slave 127.0.0.1:6381 127.0.0.1 6381 @

myredis 127.0.0.1 6379

如果Master 节点断开了,这个时候就会从从机中随机选择一个服务器! (这里面有一个投票算法!)

哨兵日志!

如果主机此时回来了,只能归并到新的主机下,当做从机,这就是哨兵模式的规则!

哨兵模式

优点:

- 哨兵集群,基于主从复制模式,所有的主从配置优点,它全有

- 主从可以切换,故障可以转移,系统的可用性就会更好

- 哨兵模式就是主从模式的升级,手动到自动,更加健壮!

缺点:

- Redis 不好啊在线扩容的,集群容量一旦到达上限,在线扩容就十分麻烦!

- 实现哨兵模式的配置其实是很麻烦的,里面有很多选择!

哨兵模式的全部配置!

# Example sentinel.conf

# 哨兵sentinel实例运行的端口 默认26379

port 26379

# 哨兵sentinel的工作目录

dir /tmp

# 哨兵sentinel监控的redis主节点的 ip port

# master-name 可以自己命名的主节点名字 只能由字母A-z、数字0-9 、这三个字符".-_"组成。

# quorum 配置多少个sentinel哨兵统一认为master主节点失联 那么这时客观上认为主节点失联了

# sentinel monitor

sentinel monitor mymaster 127.0.0.1 6379 2

# 当在Redis实例中开启了requirepass foobared 授权密码 这样所有连接Redis实例的客户端都要提供

密码

# 设置哨兵sentinel 连接主从的密码 注意必须为主从设置一样的验证密码

# sentinel auth-pass

sentinel auth-pass mymaster MySUPER--secret-0123passw0rd

# 指定多少毫秒之后 主节点没有应答哨兵sentinel 此时 哨兵主观上认为主节点下线 默认30秒

# sentinel down-after-milliseconds

sentinel down-after-milliseconds mymaster 30000

# 这个配置项指定了在发生failover主备切换时最多可以有多少个slave同时对新的master进行 同步,

这个数字越小,完成failover所需的时间就越长,

但是如果这个数字越大,就意味着越 多的slave因为replication而不可用。

可以通过将这个值设为 1 来保证每次只有一个slave 处于不能处理命令请求的状态。

# sentinel parallel-syncs

sentinel parallel-syncs mymaster 1

# 故障转移的超时时间 failover-timeout 可以用在以下这些方面:

#1. 同一个sentinel对同一个master两次failover之间的间隔时间。

#2. 当一个slave从一个错误的master那里同步数据开始计算时间。直到slave被纠正为向正确的master那

里同步数据时。

#3.当想要取消一个正在进行的failover所需要的时间。

#4.当进行failover时,配置所有slaves指向新的master所需的最大时间。不过,即使过了这个超时,

slaves依然会被正确配置为指向master,但是就不按parallel-syncs所配置的规则来了

# 默认三分钟

# sentinel failover-timeout

sentinel failover-timeout mymaster 180000

# SCRIPTS EXECUTION

#配置当某一事件发生时所需要执行的脚本,可以通过脚本来通知管理员,例如当系统运行不正常时发邮件通知

相关人员。

#对于脚本的运行结果有以下规则:

#若脚本执行后返回1,那么该脚本稍后将会被再次执行,重复次数目前默认为10

#若脚本执行后返回2,或者比2更高的一个返回值,脚本将不会重复执行。

#如果脚本在执行过程中由于收到系统中断信号被终止了,则同返回值为1时的行为相同。

#一个脚本的最大执行时间为60s,如果超过这个时间,脚本将会被一个SIGKILL信号终止,之后重新执行。

#通知型脚本:当sentinel有任何警告级别的事件发生时(比如说redis实例的主观失效和客观失效等等),

将会去调用这个脚本,这时这个脚本应该通过邮件,SMS等方式去通知系统管理员关于系统不正常运行的信

息。调用该脚本时,将传给脚本两个参数,一个是事件的类型,一个是事件的描述。如果sentinel.conf配

置文件中配置了这个脚本路径,那么必须保证这个脚本存在于这个路径,并且是可执行的,否则sentinel无

法正常启动成功。

#通知脚本

# shell编程

# sentinel notification-script

sentinel notification-script mymaster /var/redis/notify.sh

# 客户端重新配置主节点参数脚本

# 当一个master由于failover而发生改变时,这个脚本将会被调用,通知相关的客户端关于master地址已

经发生改变的信息。

# 以下参数将会在调用脚本时传给脚本:

#

# 目前总是“failover”,

# 是“leader”或者“observer”中的一个。

# 参数 from-ip, from-port, to-ip, to-port是用来和旧的master和新的master(即旧的slave)通

信的

# 这个脚本应该是通用的,能被多次调用,不是针对性的。

# sentinel client-reconfig-script

sentinel client-reconfig-script mymaster /var/redis/reconfig.sh # 一般都是由运维来配

置!

社会目前程序员饱和(初级和中级)、高级程序员重金难求!(提升自己!)

缓存穿透和雪崩

服务的高可用问题!

在这里我们不会详细的区分析解决方案的底层!

Redis缓存的使用,极大的提升了应用程序的性能和效率,特别是数据查询方面。但同时,它也带来了一

些问题。其中,最要害的问题,就是数据的一致性问题,从严格意义上讲,这个问题无解。如果对数据

的一致性要求很高,那么就不能使用缓存。

另外的一些典型问题就是,缓存穿透、缓存雪崩和缓存击穿。目前,业界也都有比较流行的解决方案。

缓存穿透(查不到)

概念

缓存穿透的概念很简单,用户想要查询一个数据,发现redis内存数据库没有,也就是缓存没有命中,于

是向持久层数据库查询。发现也没有,于是本次查询失败。当用户很多的时候,缓存都没有命中(秒

杀!),于是都去请求了持久层数据库。这会给持久层数据库造成很大的压力,这时候就相当于出现了

缓存穿透。

解决方案

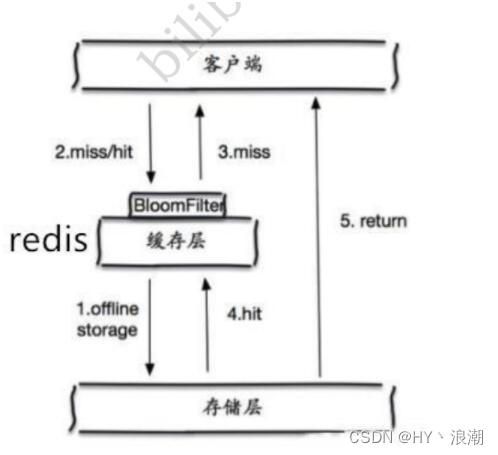

布隆过滤器

布隆过滤器是一种数据结构,对所有可能查询的参数以hash形式存储,在控制层先进行校验,不符合则

丢弃,从而避免了对底层存储系统的查询压力;

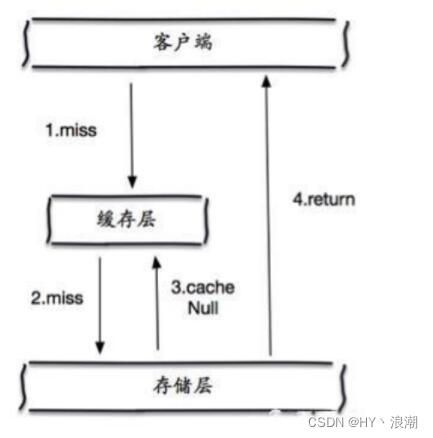

缓存空对象

当存储层不命中后,即使返回的空对象也将其缓存起来,同时会设置一个过期时间,之后再访问这个数

据将会从缓存中获取,保护了后端数据源;

但是这种方法会存在两个问题:

- 如果空值能够被缓存起来,这就意味着缓存需要更多的空间存储更多的键,因为这当中可能会有很多

的空值的键; - 即使对空值设置了过期时间,还是会存在缓存层和存储层的数据会有一段时间窗口的不一致,这对于

需要保持一致性的业务会有影响。

缓存击穿(量太大,缓存过期!)

概述

这里需要注意和缓存击穿的区别,缓存击穿,是指一个key非常热点,在不停的扛着大并发,大并发集中

对这一个点进行访问,当这个key在失效的瞬间,持续的大并发就穿破缓存,直接请求数据库,就像在一

个屏障上凿开了一个洞。

当某个key在过期的瞬间,有大量的请求并发访问,这类数据一般是热点数据,由于缓存过期,会同时访

问数据库来查询最新数据,并且回写缓存,会导使数据库瞬间压力过大。

解决方案

设置热点数据永不过期

从缓存层面来看,没有设置过期时间,所以不会出现热点 key 过期后产生的问题。

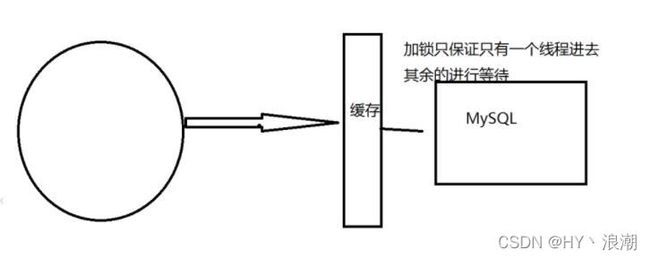

加互斥锁

分布式锁:使用分布式锁,保证对于每个key同时只有一个线程去查询后端服务,其他线程没有获得分布

式锁的权限,因此只需要等待即可。这种方式将高并发的压力转移到了分布式锁,因此对分布式锁的考

验很大。

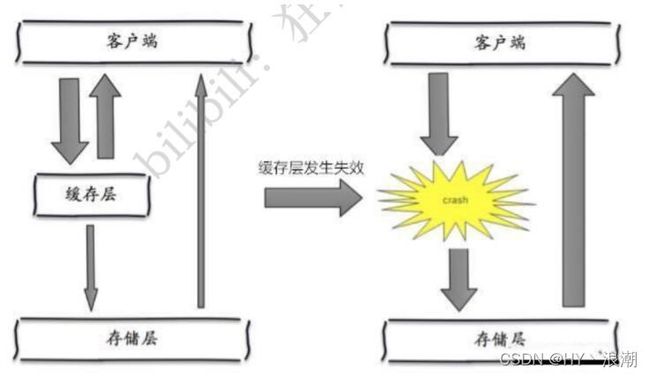

缓存雪崩

概念

缓存雪崩,是指在某一个时间段,缓存集中过期失效。Redis 宕机!

产生雪崩的原因之一,比如在写本文的时候,马上就要到双十二零点,很快就会迎来一波抢购,这波商

品时间比较集中的放入了缓存,假设缓存一个小时。那么到了凌晨一点钟的时候,这批商品的缓存就都

过期了。而对这批商品的访问查询,都落到了数据库上,对于数据库而言,就会产生周期性的压力波

峰。于是所有的请求都会达到存储层,存储层的调用量会暴增,造成存储层也会挂掉的情况。

其实集中过期,倒不是非常致命,比较致命的缓存雪崩,是缓存服务器某个节点宕机或断网。因为自然

形成的缓存雪崩,一定是在某个时间段集中创建缓存,这个时候,数据库也是可以顶住压力的。无非就

是对数据库产生周期性的压力而已。而缓存服务节点的宕机,对数据库服务器造成的压力是不可预知

的,很有可能瞬间就把数据库压垮。

解决方案

redis高可用

这个思想的含义是,既然redis有可能挂掉,那我多增设几台redis,这样一台挂掉之后其他的还可以继续

工作,其实就是搭建的集群。(异地多活!)

限流降级(在SpringCloud讲解过!)

这个解决方案的思想是,在缓存失效后,通过加锁或者队列来控制读数据库写缓存的线程数量。比如对

某个key只允许一个线程查询数据和写缓存,其他线程等待。

数据预热

数据加热的含义就是在正式部署之前,我先把可能的数据先预先访问一遍,这样部分可能大量访问的数

据就会加载到缓存中。在即将发生大并发访问前手动触发加载缓存不同的key,设置不同的过期时间,让

缓存失效的时间点尽量均匀。