大数据上课笔记之使用Java API操作HDFS

目录

一、HDFS Java API的了解

1、HDFS常见类与接口

二、编写Java程序访问HDFS

1、在IEDA上创建Maven项目

2、添加相关依赖

3、创建日志属性文件

4、启动集群HDFS服务

5、在HDFS上创建文件

6、写入HDFS文件

7、读取HDFS文件

8、重命名目录或文件

9、显示文件列表

9.1、显示指定目录下文件全部信息

9.2、显示指定目录下文件路径和长度信息

10、获取文件块信息

11、创建目录

12、判断目录或文件是否存在

13、判断Path指向目录还是文件

14、删除目录或文件

14.1、删除文件

14.2、删除目录

14.3、删除目录或文件

三、课后复习

一、HDFS Java API的了解

- HDFS Java API 位于“org.apache.hadoop.fs"包中,这些API能够支持的操作包含打开文件、读写文件、删除文件等。Hadoop类库中最终面向用户提供接口类是FileSystem,该类是个抽象类,只能通过类的get方法得到具体类,该类封装了大部分的文件操作,如mkdir、delete等。更多的API接口说明请访问Hadoop官方网站:Overview (Apache Hadoop Main 3.2.1 API)

1、HDFS常见类与接口

- Hadoop整合了众多文件系统,HDFS只是这个文件系统的一个实例。

| 类或接口 | 功能描述 |

| org.apache.hadoop.fs.FileSystem | 一个通用文件系统的抽象基类,可被分布式文件系统继承。 |

| org.apache.hadoop.fs.FileStatus | 文件状态接口,用于向客户端展示系统中文件和目录的元数据。具体包括文件大小、块大小、副本信息、所有者、修改时间等,可通过FileSystem.listStatus()方法获得具体的实例对象。 |

| org.apache.hadoop.fs.FileDataInputStream | 文件输入流,用于读取Hadoop文件。 |

| org.apache.hadoop.fs.FileDataOutputStream | 文件输出流,用于写Hadoop文件。 |

| org.apache.hadoop.fs.Configuration | 访问配置项,所有配置项的值,如果在core-site.xml中有对应的配置,则以core-site.xml为准。 |

| org.apache.hadoop.fs.Path | 路径,用于表示Hadoop文件系统中的一个文件或一个目录的路径。 |

| org.apache.hadoop.fs.PathFilter | 路径过滤器接口,通过实现方法PathFilter.accept(Path path)来判断是否接收路径path表示的文件或目录。 |

-

FileSystem对象的一些方法可以对文件进行操作

| 方法名 | 功能描述 |

| copyFromLocalFile(Path src, Path dst) | 从本地磁盘复制文件到HDFS |

| copyToLocalFile(Path src, Path dst) | 从HDFS复制文件到本地磁盘 |

| mkdirs(Path f) | 建立子目录 |

| rename(Path src, Path dst) | 重命名文件或文件夹 |

| delete(Path f) | 删除指定文件 |

二、编写Java程序访问HDFS

1、在IEDA上创建Maven项目

- 创建Maven项目,选中Maven,然后选择jdk版本,然后点next

- 选择存放位置,点击Finish完成创建。

2、添加相关依赖

- 在

pom.xml文件里添加hadoop和junit依赖

org.apache.hadoop

hadoop-client

3.3.4

junit

junit

4.13.2

- 点击刷新,会自动下载依赖文件

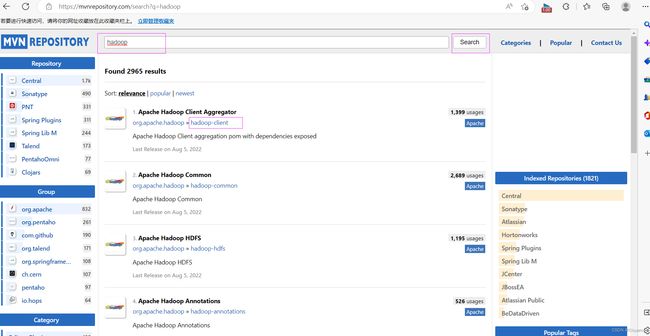

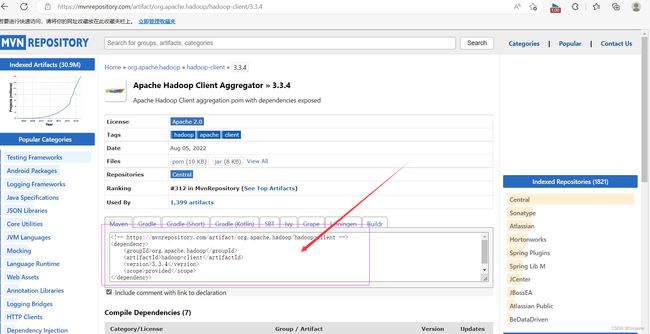

- Maven Repository(Maven仓库)- https://mvnrepository.com/

- 搜索

hadoop

- 单击

hadoop-client超链接

- 单击

3.3.4超链接

3、创建日志属性文件

- 在

resources目录里创建log4j.properties文件

log4j.rootLogger=stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/hdfs.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

4、启动集群HDFS服务

- 在主节点上执行命令:

start-dfs.sh

- 在Hadoop WebUI界面查看

5、在HDFS上创建文件

- 在HDFS Shell里利用

hdfs dfs -touchz命令可以创建时间戳文件 - 实例:在

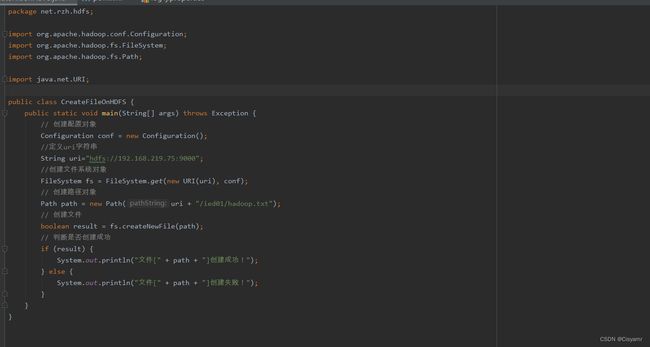

/ied01目录创建hadoop.txt文件 - 创建

net.hw.hdfs包,在包里创建CreateFileOnHDFS类

- 编写

create1()方法

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test;

import java.net.URI;

public class CreateFileOnHDFS {

@Test

public void create1() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://master:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 创建路径对象(指向文件)

Path path = new Path(uri + "/ied01/hadoop.txt");

// 基于路径对象创建文件

boolean result = fs.createNewFile(path);

// 根据返回值判断文件是否创建成功

if (result) {

System.out.println("文件[" + path + "]创建成功!");

} else {

System.out.println("文件[" + path + "]创建失败!");

}

}

}

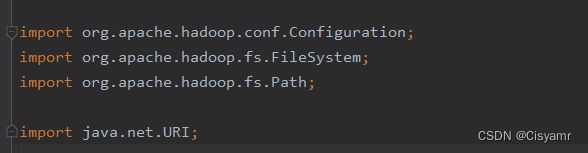

- 注意:导包不能错,不然不能运行

- 运行程序,查看结果

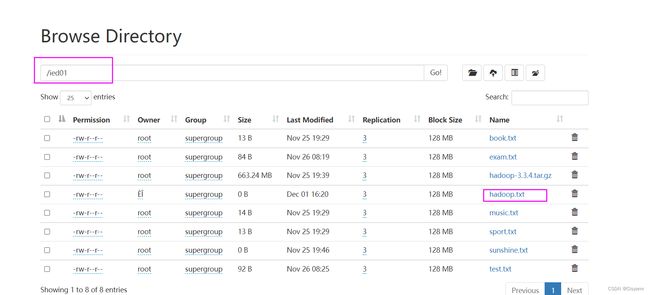

- 利用Hadoop WebUI查看

- 在/ied01目录里确实创建了一个0字节的hadoop.txt文件,有点类似于Hadoop Shell里执行hdfs dfs -touchz /ied01/hadoop.txt命令的效果,但是有一点不同,hdfs dfs -touchz命令重复执行,不会失败,只是不断改变该文件的时间戳。

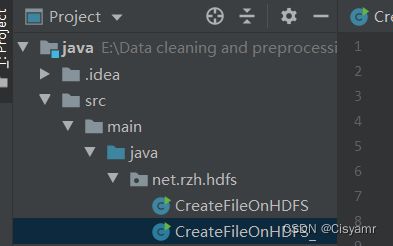

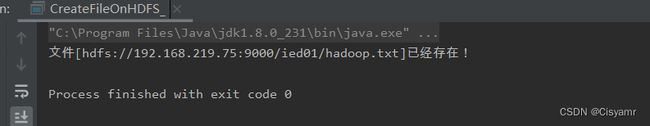

- 新建一个文件CreateFileOnHDFS_,事先判断文件是否存在

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.IOException;

import java.net.URI;

public class CreateFileOnHDFS_ {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

//定义uri字符串

String uri="hdfs://192.168.219.75:9000";

//创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 创建路径对象

Path path = new Path(uri + "/ied01/hadoop.txt");

//判断路径对象指向的文件是否存在

if(fs.exists(path)){

//提示用户文件已经存在

System.out.println("文件["+path+"]已经存在!");

}else {

try {

//基于路径对象创建文件

boolean result =fs.createNewFile(path);

//根据返回值判断文件是否创建成功

if (result) {

System.out.println("文件[" + path + "]创建成功!");

} else {

System.out.println("文件[" + path + "]创建失败!");

}

} catch (IOException e) {

System.out.println("异常信息:"+e.getMessage());

}

}

}

}- 运行程序,查看结果

6、写入HDFS文件

- 类似于HDFS Shell里的

hdfs dfs -put命令 - 在

net.hw.hdfs包里创建WriteFileOnHDFS类 - 实例:在

/ied01目录里创建hello.txt文件

public class WriteFileOnHDFS {

@Test

public void write1() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 创建路径对象(文件或目录)

Path path = new Path(uri + "/ied01/hello.txt");

// 创建文件输出流

FSDataOutputStream out = fs.create(path);

// 写数据

out.write("hello hadoop world".getBytes());

// 提示用户写文件成功

System.out.println("文件[" + path + "]写入成功!");

// 关闭输出流

out.flush();

// 关闭文件

fs.close();

}- 运行,查看结果

- 利用Hadoop WebUI查看

hello.txt文件

- 将本地文件写入HDFS文件

- 在项目根目录创建一个文本文件

test.txt

- 创建

write2()方法

@Test

public void write2() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象(指向目录或文件)

Path path = new Path(uri + "/ied01/exam.txt");

// 创建文件系统数据字节输出流对象

FSDataOutputStream out = fs.create(path);

// 创建文件字符输入流对象

FileReader fr = new FileReader("test.txt");

// 创建缓冲字符输入流对象

BufferedReader br = new BufferedReader(fr);

// 定义行字符串

String nextLine = "";

// 通过循环读取缓冲字符输入流

while ((nextLine = br.readLine()) != null) {

// 在控制台输出读取的行

System.out.println(nextLine);

// 通过文件系统数据字节输出流对象写入指定文件

out.write(nextLine.getBytes());

}

// 关闭文件系统字节输出流

out.close();

// 关闭缓冲字符输入流

br.close();

// 关闭文件字符输入流

fr.close();

// 提示用户写入文件成功

System.out.println("本地文件[test.txt]成功写入[" + path + "]!");

}- 这是

WriteFileOnHDFS里面的所有包,注意不要导错了

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test;

import org.apache.hadoop.io.IOUtils;

import java.io.BufferedReader;

import java.io.FileReader;

import java.net.URI;

import java.io.FileInputStream;- 运行

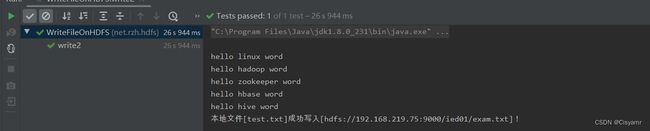

write2()测试方法,查看结果

- 编写

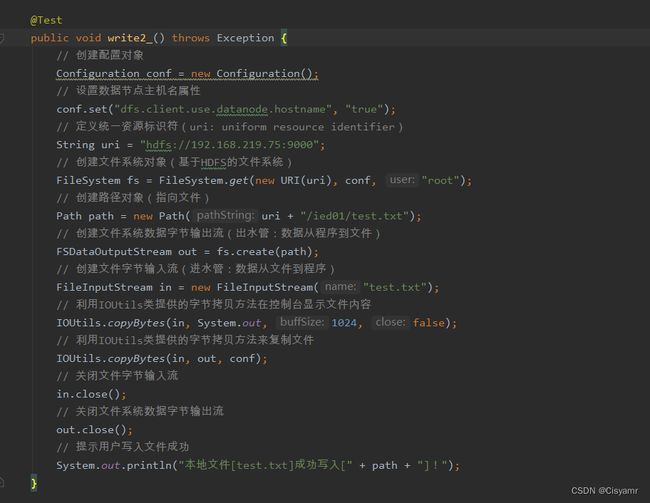

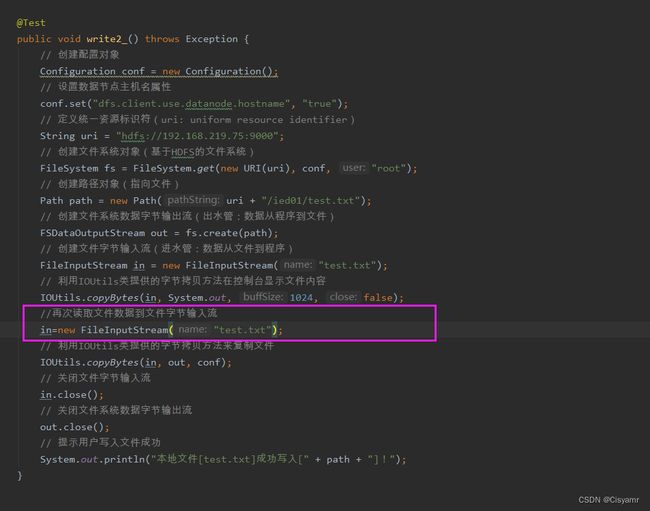

write2_()方法

@Test

public void write2_() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象(指向文件)

Path path = new Path(uri + "/ied01/test.txt");

// 创建文件系统数据字节输出流(出水管:数据从程序到文件)

FSDataOutputStream out = fs.create(path);

// 创建文件字节输入流(进水管:数据从文件到程序)

FileInputStream in = new FileInputStream("test.txt");

// 利用IOUtils类提供的字节拷贝方法在控制台显示文件内容

IOUtils.copyBytes(in, System.out, 1024, false);

//再次读取文件数据到文件字节输入流

in=new FileInputStream("test.txt");

// 利用IOUtils类提供的字节拷贝方法来复制文件

IOUtils.copyBytes(in, out, conf);

// 关闭文件字节输入流

in.close();

// 关闭文件系统数据字节输出流

out.close();

// 提示用户写入文件成功

System.out.println("本地文件[test.txt]成功写入[" + path + "]!");

}- 运行

write2_()测试方法,查看结果

- 查看

/ied01/test.txt内容,文件是存在的,但是没有内容

- 是因为字节输入流的数据已经输出到到控制台,此时字节输入流里已经没有数据,此时执行

IOUtils.copyBytes(in, out, conf);,因此输出流肯定也没有数据可以写入文件,那该怎么办呢?再次读取文件,让字节输入流有数据。

- 运行

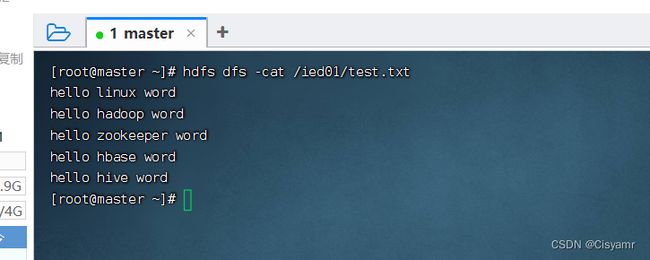

write2_()方法,查看结果

- 查看

/ied01/test.txt文件

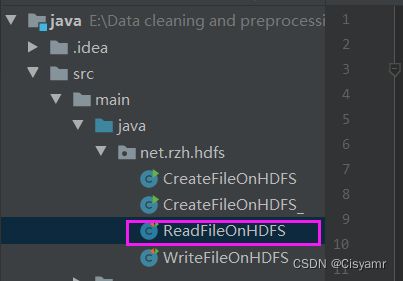

7、读取HDFS文件

- 相当于Shell里的两个命令:

hdfs dfs -cat和hdfs dfs -get - 在

net.hw.hdfs包里创建ReadFileOnHDFS类

- 准备读取

hdfs://master:9000/ied01/test.txt文件

- 编写

read1()方法

- 运行

read1()测试方法,查看结果

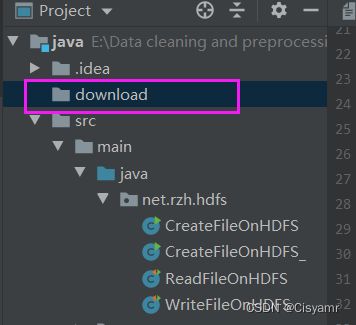

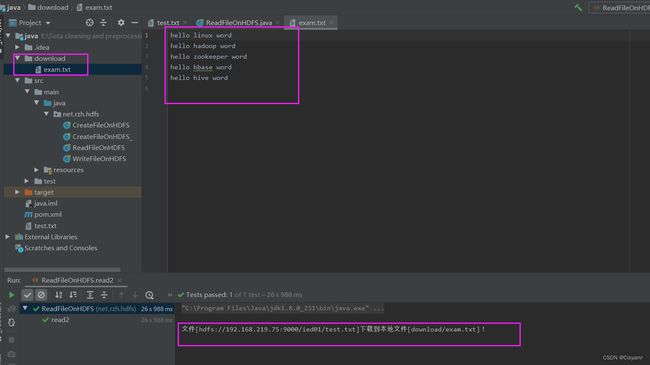

- 读取HDFS文件,保存为本地文件

- 实例:将

/ied01/test.txt下载到项目的download目录里 - 创建

download目录

- 创建

read2()方法

@Test

public void read2() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象(指向文件)

Path path = new Path(uri + "/ied01/test.txt");

// 创建文件系统数据字节输入流(进水管:数据从文件到程序)

FSDataInputStream in = fs.open(path);

// 创建文件字节输出流(出水管:数据从程序到文件)

FileOutputStream out = new FileOutputStream("download/exam.txt");

// 利用IOUtils工具类读取HDFS文件(靠输入流),写入本地文件(靠输出流)

IOUtils.copyBytes(in, out, conf);

// 关闭文件字节输出流

out.close();

// 关闭文件系统数据字节流输入流

in.close();

// 关闭文件系统

fs.close();

// 提示用户文件下载成功

System.out.println("文件[" + path + "]下载到本地文件[download/exam.txt]!");

}- 运行

read2()测试方法,查看结果

8、重命名目录或文件

- 相当于Shell里的

hdfs dfs -mv命令 - 在

net.hw.hdfs包里创建RenameDirOrFile类 - 实例:将

/ied01目录更名为/lzy01

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test;

import java.net.URI;

@Test

public void renameDir() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建源路径对象(指向目录)

Path sourcePath = new Path(uri + "/ied01");

// 创建目标路径对象(指向目录)

Path destinationPath = new Path(uri + "/lzy01");

// 利用文件系统对象重命名目录

fs.rename(sourcePath, destinationPath);

// 关闭文件系统

fs.close();

// 提示用户目录更名成功

System.out.println("目录[" + sourcePath.getName() + "]更名为目录[" + destinationPath.getName() + "]!");

}- 运行

renameDir()方法,查看结果

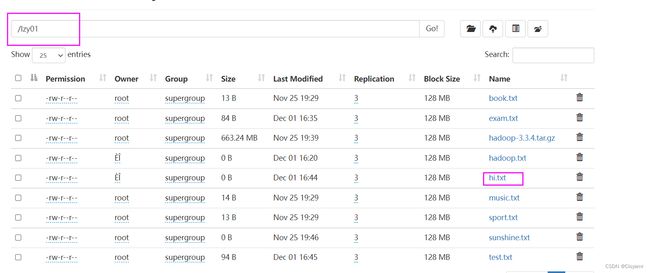

- 利用Hadoop WebUI界面查看

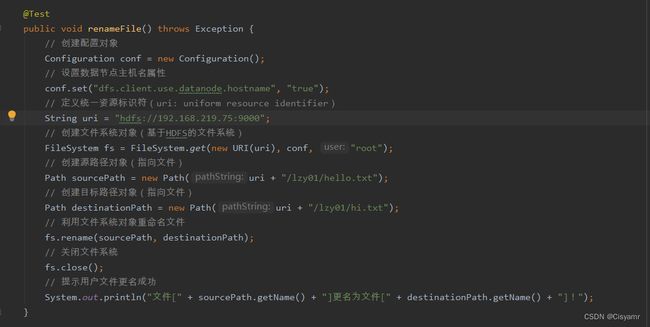

- 实例:将

lzy01目录下的hello.txt重命名为hi.txt

- 编写

renameFile()方法

@Test

public void renameFile() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建源路径对象(指向文件)

Path sourcePath = new Path(uri + "/lzy01/hello.txt");

// 创建目标路径对象(指向文件)

Path destinationPath = new Path(uri + "/lzy01/hi.txt");

// 利用文件系统对象重命名文件

fs.rename(sourcePath, destinationPath);

// 关闭文件系统

fs.close();

// 提示用户文件更名成功

System.out.println("文件[" + sourcePath.getName() + "]更名为文件[" + destinationPath.getName() + "]!");

}- 运行

renameFile()测试方法,查看结果

- 利用Hadoop WebUI界面查看

9、显示文件列表

- 在

net.hw.hdfs包里创建ListHDFSFiles类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.LocatedFileStatus;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.fs.RemoteIterator;

import org.junit.Test;

import java.net.URI;

9.1、显示指定目录下文件全部信息

- 实例:显示

/lzy01目录下的文件列表

- 编写

list1()方法

@Test

public void list1() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建远程迭代器对象,泛型是位置文件状态类(相当于`hdfs dfs -ls -R /lzy01`)

RemoteIterator ri = fs.listFiles(new Path("/lzy01"), true);

// 遍历远程迭代器

while (ri.hasNext()) {

System.out.println(ri.next());

}

} - 运行

list1()测试方法,查看结果

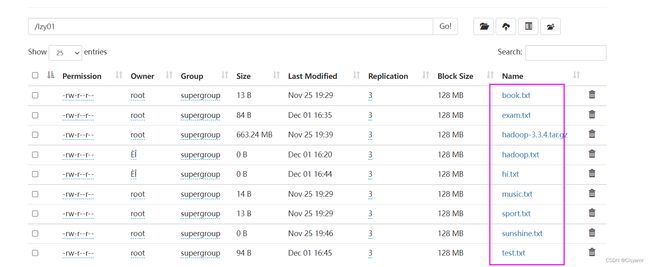

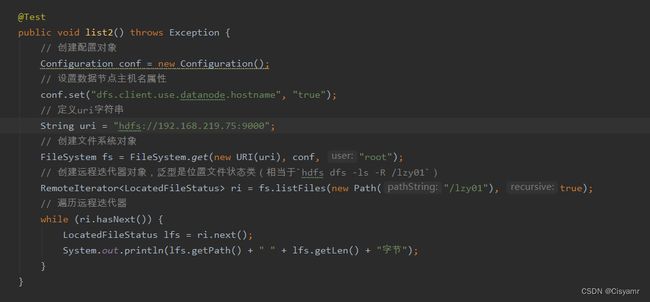

9.2、显示指定目录下文件路径和长度信息

- 编写

list2()方法

- 运行

list2()测试方法,查看结果

- 对照Hadoop WebUI上给出的文件长度信息

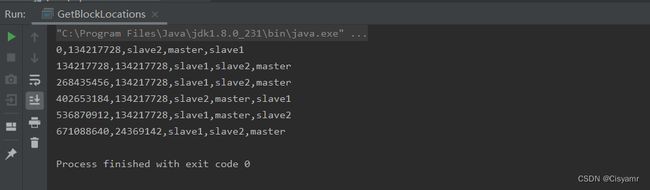

10、获取文件块信息

- 实例:获取

/lzy01/hadoop-3.3.4.tar.gz文件块信息 - 在

net.hw.hdfs包里创建GetBlockLocations类

- 运行程序,查看结果(切点位置,块大小,块存在位置)

- 可以看出来,

hadoop-3.3.4.tar.gz被hadoop物理切分成6块,前5块长度均为134217728字节(128MB),第6块长度为24369142字节(23.24MB)

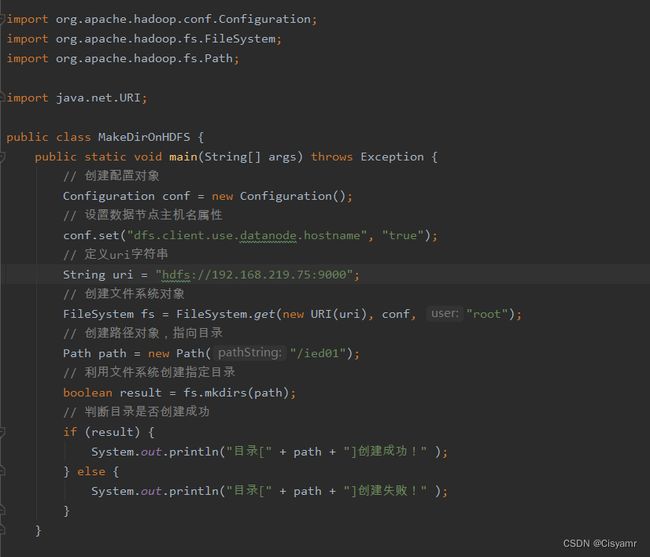

11、创建目录

- 实例:在HDFS上创建

/ied01目录 - 在

net.hw.hdfs包里创建MakeDirOnHDFS类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.net.URI;

public class MakeDirOnHDFS {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象,指向目录

Path path = new Path("/ied01");

// 利用文件系统创建指定目录

boolean result = fs.mkdirs(path);

// 判断目录是否创建成功

if (result) {

System.out.println("目录[" + path + "]创建成功!" );

} else {

System.out.println("目录[" + path + "]创建失败!" );

}

}

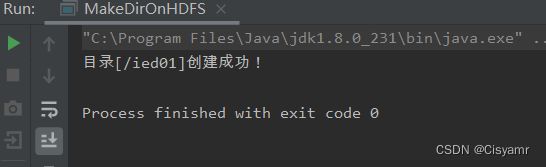

}- 运行程序,查看结果

- 利用Hadoop WebUI界面查看

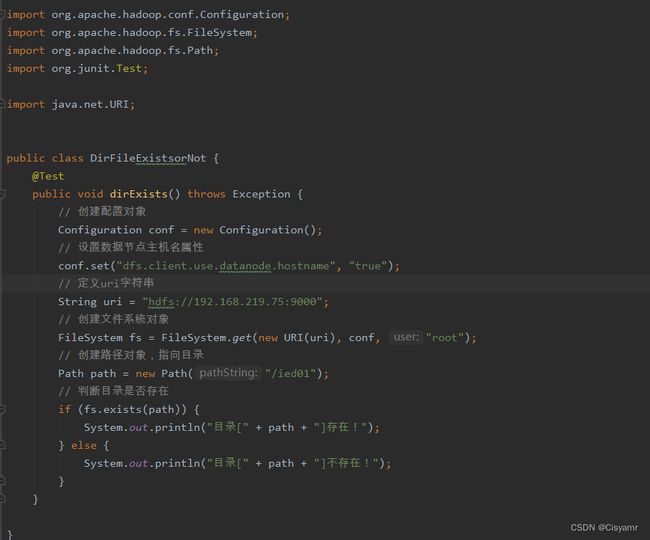

12、判断目录或文件是否存在

- 实例:判断HDFS上

/ied01目录是否存在,判断/ied01/hadoop.txt文件是否存在 - 在

net.hw.hdfs包里创建DirFileExistsOrNot类 -

编写

dirExists()方法

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test;

import java.net.URI;

public class DirFileExistsorNot {

@Test

public void dirExists() throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象,指向目录

Path path = new Path("/ied01");

// 判断目录是否存在

if (fs.exists(path)) {

System.out.println("目录[" + path + "]存在!");

} else {

System.out.println("目录[" + path + "]不存在!");

}

}

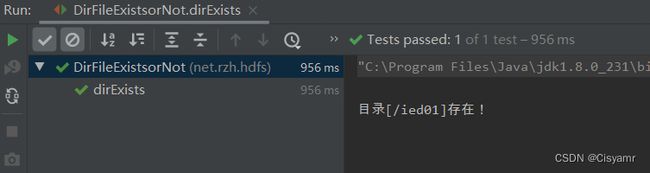

}- 运行程序,查看结果

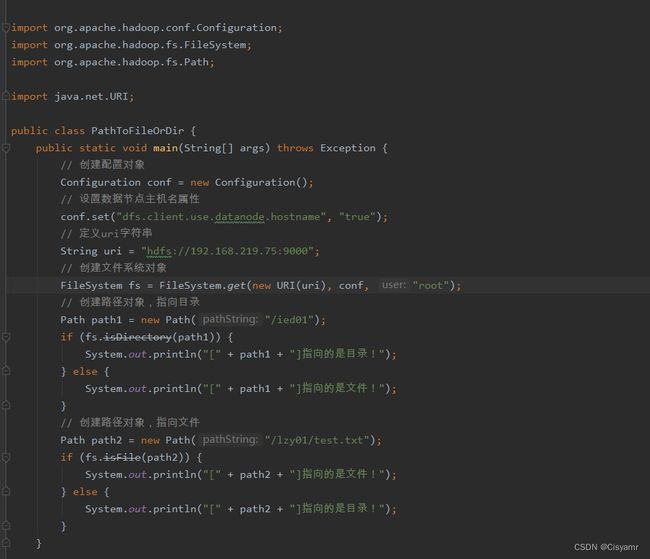

13、判断Path指向目录还是文件

- 在

net.hw.hdfs包里创建PathToFileOrDir类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.net.URI;

public class PathToFileOrDir {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义uri字符串

String uri = "hdfs://192.168.219.75:9000";

// 创建文件系统对象

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象,指向目录

Path path1 = new Path("/ied01");

if (fs.isDirectory(path1)) {

System.out.println("[" + path1 + "]指向的是目录!");

} else {

System.out.println("[" + path1 + "]指向的是文件!");

}

// 创建路径对象,指向文件

Path path2 = new Path("/lzy01/test.txt");

if (fs.isFile(path2)) {

System.out.println("[" + path2 + "]指向的是文件!");

} else {

System.out.println("[" + path2 + "]指向的是目录!");

}

}

}- 运行程序,查看结果

![]()

14、删除目录或文件

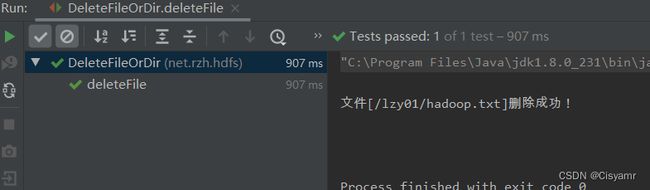

14.1、删除文件

- 实例:删除

/lzy01/test2.txt文件

- 在

net.hw.hdfs包里创建DeleteFileOrDir类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test;

import java.net.URI;- 编写

deleteFile()方法

@Test

public void deleteFile1() throws Exception {

Configuration conf = new Configuration();

String uri = "hdfs://192.168.219.75:9000";

FileSystem fs = FileSystem.get(new URI(uri), conf);

Path path = new Path("/lzy01/hadoop.txt");

boolean result = fs.delete(path, true);

if (result) {

System.out.println("文件[" + path + "]删除成功!");

} else {

System.out.println("文件[" + path + "]删除失败!");

}

}- 运行

deleteFile()测试方法,查看结果

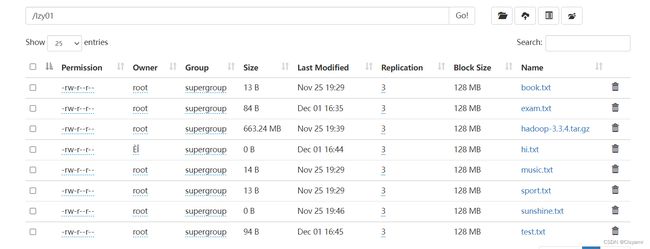

- 利用HDFS集群WebUI界面查看

- 可以在删除文件之前,判断文件是否存在

- 编写

deleteFile2()方法

//判断文件是否存在,在进行删除

@Test

public void deleteFile2() throws Exception {

Configuration conf = new Configuration();

String uri = "hdfs://192.168.219.75:9000";

FileSystem fs = FileSystem.get(new URI(uri), conf);

Path path = new Path("/lzy01/hadoop.txt");

if (fs.exists(path)) {

boolean result = fs.delete(path, true);

if (result) {

System.out.println("文件[" + path + "]删除成功!");

} else {

System.out.println("文件[" + path + "]删除失败!");

}

} else {

System.out.println("文件[" + path + "]不存在!");

}

}- 此时运行

deleteFile()测试方法,查看结果

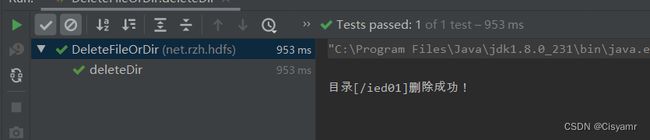

14.2、删除目录

- 实例:删除

/ied01目录 - 删除

/ied01目录

- 运行

deleteDir()方法,查看结果

再运行deleteDir()方法,查看结果

14.3、删除目录或文件

- 进行三个层面的判断:判断类型(目录或文件)、判断是否存在、判断删除是否成功。

- 任务:删除

/lzy01目录下的test.txt

- 编写

delete()方法

//删除/lzy01目录下的test1.txt 判断类型(目录或文件)、判断是否存在、判断删除是否成功。

@Test

public void delete() throws Exception {

Configuration conf = new Configuration();

String uri = "hdfs://192.168.219.75:9000";

FileSystem fs = FileSystem.get(new URI(uri), conf);

Path path1 = new Path("/lzy01/test.txt");

String type = "";

if (fs.isFile(path1)) {

type = "文件";

} else {

type = "目录";

}

if (fs.exists(path1)) {

boolean result = fs.delete(path1, true);

if (result) {

System.out.println(type + "[" + path1 + "]删除成功!");

} else {

System.out.println(type + "[" + path1 + "]删除失败!");

}

} else {

System.out.println(type + "[" + path1 + "]不存在!");

}

Path path2 = new Path("/lzy01");

if (fs.isFile(path1)) {

type = "文件";

} else {

type = "目录";

}

if (fs.exists(path2)) {

boolean result = fs.delete(path1, true);

if (result) {

System.out.println(type + "[" + path2 + "]删除成功!");

} else {

System.out.println(type + "[" + path2 + "]删除失败!");

}

} else {

System.out.println(type + "[" + path2 + "]不存在!");

}

}- 运行

delete()测试方法,查看结果

三、课后复习

- 课后多去看一下代码,运行代码,了解代码的作用,并单独进行一些文件操作。