SAM终结者:稳定分割一切

还没开源

0. 笔者个人体会

分割一切模型(SAM)这几年在CV领域应用很多,很多文章都在努力提高SAM的分割精度,但SAM分割的前提是高质量的提示(点、框)。但是实践中的SAM经常遇到不准确的提示,尤其是众包标注平台,这种不准确的提示会导致分割错误。

这也就是Stable Segment Anything Model这篇文章想要解决的问题,提出了一种新的分割模型Stable-SAM,希望遇到错误提示时也能实现稳定分割!

下面一起来阅读一下这项工作,文末附论文和代码链接~

1. 效果展示

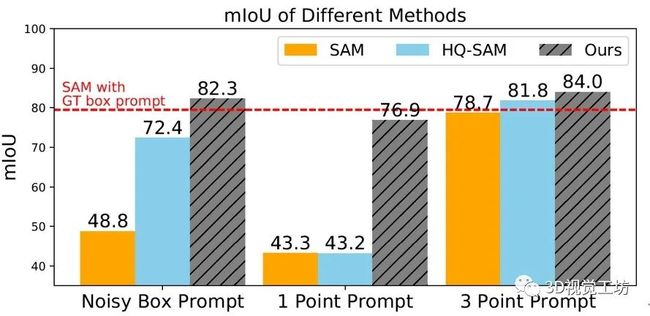

SAM、HQ-SAM、Stable-SAM在提供次优提示时的性能比较,Stable-SAM明显优于其他算法。这里也推荐工坊推出的新课程《如何将深度学习模型部署到实际工程中?(分类+检测+分割)》。

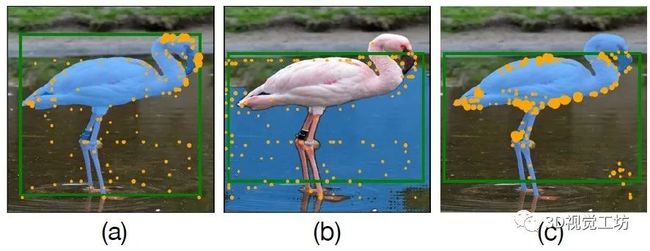

SAM和Stable-SAM的预测Mask和图像特征的权重对比,橙色圆圈表示注意力权重,半径越大表示得分越高。(a) 当提供高质量提示时,SAM分割结果很好。(b) 微小的提示修改会导致不稳定的分割输出,SAM错误分割了背景。(c) Stable-SAM通过将更多的特征采样注意力转移到目标对象上来准确地分割目标对象。

2. 具体原理是什么?

Stable-SAM的具体pipeline由三部分组成:

(a)是SAM的Mask解码器中的可变形采样插件(DSP)和可变形路由插件(DRP)。DSP采用小偏移网络(b)来预测特征采样偏移。随后DSP在更新的采样位置对可变形图像特征进行重新采样,并将它们馈送到SAM的标记到图像注意力。DRP采用一个小型MLP网络(c)来根据输入提示质量调节DSP激活的程度。注意,DSP自适应地单独调整图像特征采样位置,不会改变原始SAM模型。

3. 和其他SOTA方法对比如何?

在不同质量的提示下,SAM、DT-SAM(微调SAM的Mask解码器)、PT-SAM(微调SAM的提示token及其对应的输出MLP层)、HQ-SAM和Stable-SAM在HQ数据集上的对比。这里也推荐工坊推出的新课程《如何将深度学习模型部署到实际工程中?(分类+检测+分割)》。

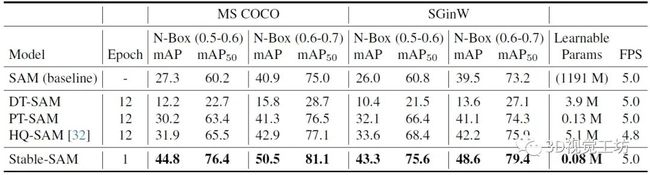

MS COCO和SGinW数据集上的对比,Stable-SAM最优。

对更多实验结果和文章细节感兴趣的读者,可以阅读一下论文原文~

4. 论文信息

标题:Stable Segment Anything Model

作者:Qi Fan, Xin Tao, Lei Ke, Mingqiao Ye, Yuan Zhang, Pengfei Wan, Zhongyuan Wang, Yu-Wing Tai, Chi-Keung Tang

机构:香港科技大学、快手科技、苏黎世联邦理工学院、达特茅斯学院

原文链接:https://arxiv.org/abs/2311.15776

代码链接:https://github.com/fanq15/Stable-SAM

我是泡椒味的口香糖,专注于CV和SLAM领域。这里有最新的前沿理论,有大佬答疑解惑,还有全网最全的免费视频课程!如果你也是一个人在孤独地摸索学习,那就欢迎扫码加入我们,一起交流学习~