- 系统学习Python——并发模型和异步编程:进程、线程和GIL

分类目录:《系统学习Python》总目录在文章《并发模型和异步编程:基础知识》我们简单介绍了Python中的进程、线程和协程。本文就着重介绍Python中的进程、线程和GIL的关系。Python解释器的每个实例都是一个进程。使用multiprocessing或concurrent.futures库可以启动额外的Python进程。Python的subprocess库用于启动运行外部程序(不管使用何种

- C++11堆操作深度解析:std::is_heap与std::is_heap_until原理解析与实践

文章目录堆结构基础与函数接口堆的核心性质函数签名与核心接口std::is_heapstd::is_heap_until实现原理深度剖析std::is_heap的验证逻辑std::is_heap_until的定位策略算法优化细节代码实践与案例分析基础用法演示自定义比较器实现最小堆检查边缘情况处理性能分析与实际应用时间复杂度对比典型应用场景与手动实现的对比注意事项与最佳实践迭代器要求比较器设计C++标

- Flask框架入门:快速搭建轻量级Python网页应用

「已注销」

python-AIpython基础网站网络pythonflask后端

转载:Flask框架入门:快速搭建轻量级Python网页应用1.Flask基础Flask是一个使用Python编写的轻量级Web应用框架。它的设计目标是让Web开发变得快速简单,同时保持应用的灵活性。Flask依赖于两个外部库:Werkzeug和Jinja2,Werkzeug作为WSGI工具包处理Web服务的底层细节,Jinja2作为模板引擎渲染模板。安装Flask非常简单,可以使用pip安装命令

- Python Flask 框架入门:快速搭建 Web 应用的秘诀

Python编程之道

Python人工智能与大数据Python编程之道pythonflask前端ai

PythonFlask框架入门:快速搭建Web应用的秘诀关键词Flask、微框架、路由系统、Jinja2模板、请求处理、WSGI、Web开发摘要想快速用Python搭建一个灵活的Web应用?Flask作为“微框架”代表,凭借轻量、可扩展的特性,成为初学者和小型项目的首选。本文将从Flask的核心概念出发,结合生活化比喻、代码示例和实战案例,带你一步步掌握:如何用Flask搭建第一个Web应用?路由

- 冒泡、选择、插入排序:三大基础排序算法深度解析(C语言实现)

xienda

算法排序算法数据结构

在算法学习道路上,排序算法是每位程序员必须掌握的基石。本文将深入解析冒泡排序、选择排序和插入排序这三种基础排序算法,通过C语言代码实现和对比分析,帮助读者彻底理解它们的差异与应用场景。算法原理与代码实现1.冒泡排序(BubbleSort)工作原理:通过重复比较相邻元素,将较大元素逐步"冒泡"到数组末尾。voidbubbleSort(intarr[],intn){ for(inti=0;iarr[

- Leetcode 148. 排序链表

文章目录前引题目代码(首刷看题解)代码(8.9二刷部分看解析)代码(9.15三刷部分看解析)前引综合性比较强的一道题,要求时间复杂度必须O(logn)才能通过,最适合链表的排序算法就是归并。这里采用自顶向下的方法步骤:找到链表中点(双指针)对两个子链表排序(递归,直到只有一个结点,记得将子链表最后指向nullptr)归并(引入dummy结点)题目Leetcode148.排序链表代码(首刷看题解)c

- python_虚拟环境

阿_焦

python

第一、配置虚拟环境:virtualenv(1)pipvirtualenv>安装虚拟环境包(2)pipinstallvirtualenvwrapper-win>安装虚拟环境依赖包(3)c盘创建虚拟目录>C:\virtualenv>配置环境变量【了解一下】:(1)如何使用virtualenv创建虚拟环境a、cd到C:\virtualenv目录下:b、mkvirtualenvname>创建虚拟环境nam

- 全面触摸屏输入法设计与实现

长野君

本文还有配套的精品资源,点击获取简介:触摸屏输入法是针对触摸设备优化的文字输入方案,包括虚拟键盘、手写、语音识别和手势等多种输入方式。本方案通过提供主程序文件、用户手册、界面截图、示例图、说明文本和音效文件,旨在为用户提供一个完整的、多样的文字输入体验。开发者通过持续优化算法和用户界面,使用户在无物理键盘环境下也能高效准确地进行文字输入。1.触摸屏输入法概述简介在现代信息技术飞速发展的今天,触摸屏

- FPGA小白到项目实战:Verilog+Vivado全流程通关指南(附光学类岗位技能映射)

阿牛的药铺

算法移植部署fpga开发verilog

FPGA小白到项目实战:Verilog+Vivado全流程通关指南(附光学类岗位技能映射)引言:为什么这个FPGA入门路线能帮你快速上岗?本文设计了一条**"Verilog语法→工具链操作→光学项目实战→岗位技能对标"的阶梯式学习路径。不同于泛泛而谈的FPGA教程,我们聚焦光学类产品开发**核心能力(时序接口设计、图像处理算法移植、高速接口应用),通过3个递进式项目(从LED闪烁到图像边缘检测),

- PyTorch & TensorFlow速成复习:从基础语法到模型部署实战(附FPGA移植衔接)

阿牛的药铺

算法移植部署pytorchtensorflowfpga开发

PyTorch&TensorFlow速成复习:从基础语法到模型部署实战(附FPGA移植衔接)引言:为什么算法移植工程师必须掌握框架基础?针对光学类产品算法FPGA移植岗位需求(如可见光/红外图像处理),深度学习框架是算法落地的"桥梁"——既要用PyTorch/TensorFlow验证算法可行性,又要将训练好的模型(如CNN、目标检测)转换为FPGA可部署的格式(ONNX、TFLite)。本文采用"

- Python爱心光波

系列文章序号直达链接Tkinter1Python李峋同款可写字版跳动的爱心2Python跳动的双爱心3Python蓝色跳动的爱心4Python动漫烟花5Python粒子烟花Turtle1Python满屏飘字2Python蓝色流星雨3Python金色流星雨4Python漂浮爱心5Python爱心光波①6Python爱心光波②7Python满天繁星8Python五彩气球9Python白色飘雪10Pyt

- Python流星雨

Want595

python开发语言

文章目录系列文章写在前面技术需求完整代码代码分析1.模块导入2.画布设置3.画笔设置4.颜色列表5.流星类(Star)6.流星对象创建7.主循环8.流星运动逻辑9.视觉效果10.总结写在后面系列文章序号直达链接表白系列1Python制作一个无法拒绝的表白界面2Python满屏飘字表白代码3Python无限弹窗满屏表白代码4Python李峋同款可写字版跳动的爱心5Python流星雨代码6Python

- 算法学习笔记:17.蒙特卡洛算法 ——从原理到实战,涵盖 LeetCode 与考研 408 例题

在计算机科学和数学领域,蒙特卡洛算法(MonteCarloAlgorithm)以其独特的随机抽样思想,成为解决复杂问题的有力工具。从圆周率的计算到金融风险评估,从物理模拟到人工智能,蒙特卡洛算法都发挥着不可替代的作用。本文将深入剖析蒙特卡洛算法的思想、解题思路,结合实际应用场景与Java代码实现,并融入考研408的相关考点,穿插图片辅助理解,帮助你全面掌握这一重要算法。蒙特卡洛算法的基本概念蒙特卡

- Python之七彩花朵代码实现

PlutoZuo

Pythonpython开发语言

Python之七彩花朵代码实现文章目录Python之七彩花朵代码实现下面是一个简单的使用Python的七彩花朵。这个示例只是一个简单的版本,没有很多高级功能,但它可以作为一个起点,你可以在此基础上添加更多功能。importturtleastuimportrandomasraimportmathtu.setup(1.0,1.0)t=tu.Pen()t.ht()colors=['red','skybl

- 算法学习笔记:15.二分查找 ——从原理到实战,涵盖 LeetCode 与考研 408 例题

呆呆企鹅仔

算法学习算法学习笔记考研二分查找

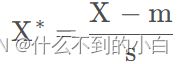

在计算机科学的查找算法中,二分查找以其高效性占据着重要地位。它利用数据的有序性,通过不断缩小查找范围,将原本需要线性时间的查找过程优化为对数时间,成为处理大规模有序数据查找问题的首选算法。二分查找的基本概念二分查找(BinarySearch),又称折半查找,是一种在有序数据集合中查找特定元素的高效算法。其核心原理是:通过不断将查找范围减半,快速定位目标元素。与线性查找逐个遍历元素不同,二分查找依赖

- Python 脚本最佳实践2025版

前文可以直接把这篇文章喂给AI,可以放到AI角色设定里,也可以直接作为提示词.这样,你只管提需求,写脚本就让AI来.概述追求简洁和清晰:脚本应简单明了。使用函数(functions)、常量(constants)和适当的导入(import)实践来有逻辑地组织你的Python脚本。使用枚举(enumerations)和数据类(dataclasses)等数据结构高效管理脚本状态。通过命令行参数增强交互性

- (Python基础篇)了解和使用分支结构

EternityArt

基础篇python

目录一、引言二、Python分支结构的类型与语法(一)if语句(单分支)(二)if-else语句(双分支)(三)if-elif-else语句(多分支)三、分支结构的应用场景(一)提示用户输入用户名,然后再提示输入密码,如果用户名是“admin”并且密码是“88888”则提示正确,否则,如果用户名不是admin还提示用户用户名不存在,(二)提示用户输入用户名,然后再提示输入密码,如果用户名是“adm

- (Python基础篇)循环结构

EternityArt

基础篇python

一、什么是Python循环结构?循环结构是编程中重复执行代码块的机制。在Python中,循环允许你:1.迭代处理数据:遍历列表、字典、文件内容等。2.自动化重复任务:如批量处理数据、生成序列等。3.控制执行流程:根据条件决定是否继续或终止循环。二、为什么需要循环结构?假设你需要打印1到100的所有偶数:没有循环:需手动编写100行print()语句。print(0)print(2)print(4)

- (Python基础篇)字典的操作

EternityArt

基础篇python开发语言

一、引言在Python编程中,字典(Dictionary)是一种极具灵活性的数据结构,它通过“键-值对”(key-valuepair)的形式存储数据,如同现实生活中的字典——通过“词语(键)”快速查找“释义(值)”。相较于列表和元组的有序索引访问,字典的优势在于基于键的快速查找,这使得它在处理需要频繁通过唯一标识获取数据的场景中极为高效。掌握字典的操作,能让我们更高效地组织和管理复杂数据,是Pyt

- LeetCode算法题:电话号码的字母组合

吱屋猪_

算法leetcodejava

题目描述:给定一个仅包含数字2-9的字符串,返回所有它能表示的字母组合。答案可以按任意顺序返回。给出数字到字母的映射如下(与电话按键相同)。注意1不对应任何字母。2->"abc"3->"def"4->"ghi"5->"jkl"6->"mno"7->"pqrs"8->"tuv"9->"wxyz"例如,给定digits="23",返回["ad","ae","af","bd","be","bf","cd

- Python七彩花朵

Want595

python开发语言

系列文章序号直达链接Tkinter1Python李峋同款可写字版跳动的爱心2Python跳动的双爱心3Python蓝色跳动的爱心4Python动漫烟花5Python粒子烟花Turtle1Python满屏飘字2Python蓝色流星雨3Python金色流星雨4Python漂浮爱心5Python爱心光波①6Python爱心光波②7Python满天繁星8Python五彩气球9Python白色飘雪10Pyt

- 霍夫变换(Hough Transform)算法原来详解和纯C++代码实现以及OpenCV中的使用示例

点云SLAM

算法图形图像处理算法opencv图像处理与计算机视觉算法直线提取检测目标检测霍夫变换算法

霍夫变换(HoughTransform)是一种经典的图像处理与计算机视觉算法,广泛用于检测图像中的几何形状,例如直线、圆、椭圆等。其核心思想是将图像空间中的“点”映射到参数空间中的“曲线”,从而将形状检测问题转化为参数空间中的峰值检测问题。一、霍夫变换基本思想输入:边缘图像(如经过Canny边缘检测)输出:一组满足几何模型的形状(如直线、圆)关键思想:图像空间中的一个点→参数空间中的一个曲线参数空

- 用OpenCV标定相机内参应用示例(C++和Python)

下面是一个完整的使用OpenCV进行相机内参标定(CameraCalibration)的示例,包括C++和Python两个版本,基于棋盘格图案标定。一、目标:相机标定通过拍摄多张带有棋盘格图案的图像,估计相机的内参:相机矩阵(内参)K畸变系数distCoeffs可选外参(R,T)标定精度指标(如重投影误差)二、棋盘格参数设置(根据自己的棋盘格设置):棋盘格角点数:9x6(内角点,9列×6行);每个

- Anaconda 详细下载与安装教程

Anaconda详细下载与安装教程1.简介Anaconda是一个用于科学计算的开源发行版,包含了Python和R的众多常用库。它还包括了conda包管理器,可以方便地安装、更新和管理各种软件包。2.下载Anaconda2.1访问官方网站首先,打开浏览器,访问Anaconda官方网站。2.2选择适合的版本在页面中,你会看到两个主要的下载选项:AnacondaIndividualEdition:适用于

- python中 @注解 及内置注解 的使用方法总结以及完整示例

慧一居士

Pythonpython

在Python中,装饰器(Decorator)使用@符号实现,是一种修改函数/类行为的语法糖。它本质上是一个高阶函数,接受目标函数作为参数并返回包装后的函数。Python也提供了多个内置装饰器,如@property、@staticmethod、@classmethod等。一、核心概念装饰器本质:@decorator等价于func=decorator(func)执行时机:在函数/类定义时立即执行装饰

- Python中的静态方法和类方法详解

在Python中,`@staticmethod`和`@classmethod`是两种装饰器,它们用于定义类中的方法,但是它们的行为和用途有所不同。###@staticmethod`@staticmethod`装饰器用于定义一个静态方法。静态方法不接收类或实例的引用作为第一个参数,因此它不能访问类的状态或实例的状态。静态方法可以看作是与类关联的普通函数,但它们可以通过类名直接调用。classMath

- Python中类静态方法:@classmethod/@staticmethod详解和实战示例

在Python中,类方法(@classmethod)和静态方法(@staticmethod)是类作用域下的两种特殊方法。它们使用装饰器定义,并且与实例方法(deffunc(self))的行为有所不同。1.三种方法的对比概览方法类型是否访问实例(self)是否访问类(cls)典型用途实例方法✅是❌否访问对象属性类方法@classmethod❌否✅是创建类的替代构造器,访问类变量等静态方法@stati

- Python多版本管理与pip升级全攻略:解决冲突与高效实践

码界奇点

Pythonpythonpip开发语言python3.11源代码管理虚拟现实依赖倒置原则

引言Python作为最流行的编程语言之一,其版本迭代速度与生态碎片化给开发者带来了巨大挑战。据统计,超过60%的Python开发者需要同时维护基于Python3.6+和Python2.7的项目。本文将系统解决以下核心痛点:如何安全地在同一台机器上管理多个Python版本pip依赖冲突的根治方案符合PEP标准的生产环境最佳实践第一部分:Python多版本管理核心方案1.1系统级多版本共存方案Wind

- 基于Python的健身数据分析工具的搭建流程day1

weixin_45677320

python开发语言数据挖掘爬虫

基于Python的健身数据分析工具的搭建流程分数据挖掘、数据存储和数据分析三个步骤。本文主要介绍利用Python实现健身数据分析工具的数据挖掘部分。第一步:加载库加载本文需要的库,如下代码所示。若库未安装,请按照python如何安装各种库(保姆级教程)_python安装库-CSDN博客https://blog.csdn.net/aobulaien001/article/details/133298

- Java三年经验程序员技术栈全景指南:从前端到架构,对标阿里美团全栈要求

可曾去过倒悬山

java前端架构

Java三年经验程序员技术栈全景指南:从前端到架构,对标阿里美团全栈要求三年经验是Java程序员的分水岭,技术栈深度决定你成为“业务码农”还是“架构师候选人”。本文整合阿里、美团、滴滴等大厂招聘要求,为你绘制可落地的进阶路线。一、Java核心:从语法糖到JVM底层三年经验与初级的核心差异在于系统级理解,大厂面试常考以下能力:JVM与性能调优内存模型(堆外内存、元空间)、GC算法(G1/ZGC适用场

- 二分查找排序算法

周凡杨

java二分查找排序算法折半

一:概念 二分查找又称

折半查找(

折半搜索/

二分搜索),优点是比较次数少,查找速度快,平均性能好;其缺点是要求待查表为有序表,且插入删除困难。因此,折半查找方法适用于不经常变动而 查找频繁的有序列表。首先,假设表中元素是按升序排列,将表中间位置记录的关键字与查找关键字比较,如果两者相等,则查找成功;否则利用中间位置记录将表 分成前、后两个子表,如果中间位置记录的关键字大于查找关键字,则进一步

- java中的BigDecimal

bijian1013

javaBigDecimal

在项目开发过程中出现精度丢失问题,查资料用BigDecimal解决,并发现如下这篇BigDecimal的解决问题的思路和方法很值得学习,特转载。

原文地址:http://blog.csdn.net/ugg/article/de

- Shell echo命令详解

daizj

echoshell

Shell echo命令

Shell 的 echo 指令与 PHP 的 echo 指令类似,都是用于字符串的输出。命令格式:

echo string

您可以使用echo实现更复杂的输出格式控制。 1.显示普通字符串:

echo "It is a test"

这里的双引号完全可以省略,以下命令与上面实例效果一致:

echo Itis a test 2.显示转义

- Oracle DBA 简单操作

周凡杨

oracle dba sql

--执行次数多的SQL

select sql_text,executions from (

select sql_text,executions from v$sqlarea order by executions desc

) where rownum<81;

&nb

- 画图重绘

朱辉辉33

游戏

我第一次接触重绘是编写五子棋小游戏的时候,因为游戏里的棋盘是用线绘制的,而这些东西并不在系统自带的重绘里,所以在移动窗体时,棋盘并不会重绘出来。所以我们要重写系统的重绘方法。

在重写系统重绘方法时,我们要注意一定要调用父类的重绘方法,即加上super.paint(g),因为如果不调用父类的重绘方式,重写后会把父类的重绘覆盖掉,而父类的重绘方法是绘制画布,这样就导致我们

- 线程之初体验

西蜀石兰

线程

一直觉得多线程是学Java的一个分水岭,懂多线程才算入门。

之前看《编程思想》的多线程章节,看的云里雾里,知道线程类有哪几个方法,却依旧不知道线程到底是什么?书上都写线程是进程的模块,共享线程的资源,可是这跟多线程编程有毛线的关系,呜呜。。。

线程其实也是用户自定义的任务,不要过多的强调线程的属性,而忽略了线程最基本的属性。

你可以在线程类的run()方法中定义自己的任务,就跟正常的Ja

- linux集群互相免登陆配置

林鹤霄

linux

配置ssh免登陆

1、生成秘钥和公钥 ssh-keygen -t rsa

2、提示让你输入,什么都不输,三次回车之后会在~下面的.ssh文件夹中多出两个文件id_rsa 和 id_rsa.pub

其中id_rsa为秘钥,id_rsa.pub为公钥,使用公钥加密的数据只有私钥才能对这些数据解密 c

- mysql : Lock wait timeout exceeded; try restarting transaction

aigo

mysql

原文:http://www.cnblogs.com/freeliver54/archive/2010/09/30/1839042.html

原因是你使用的InnoDB 表类型的时候,

默认参数:innodb_lock_wait_timeout设置锁等待的时间是50s,

因为有的锁等待超过了这个时间,所以抱错.

你可以把这个时间加长,或者优化存储

- Socket编程 基本的聊天实现。

alleni123

socket

public class Server

{

//用来存储所有连接上来的客户

private List<ServerThread> clients;

public static void main(String[] args)

{

Server s = new Server();

s.startServer(9988);

}

publi

- 多线程监听器事件模式(一个简单的例子)

百合不是茶

线程监听模式

多线程的事件监听器模式

监听器时间模式经常与多线程使用,在多线程中如何知道我的线程正在执行那什么内容,可以通过时间监听器模式得到

创建多线程的事件监听器模式 思路:

1, 创建线程并启动,在创建线程的位置设置一个标记

2,创建队

- spring InitializingBean接口

bijian1013

javaspring

spring的事务的TransactionTemplate,其源码如下:

public class TransactionTemplate extends DefaultTransactionDefinition implements TransactionOperations, InitializingBean{

...

}

TransactionTemplate继承了DefaultT

- Oracle中询表的权限被授予给了哪些用户

bijian1013

oracle数据库权限

Oracle查询表将权限赋给了哪些用户的SQL,以备查用。

select t.table_name as "表名",

t.grantee as "被授权的属组",

t.owner as "对象所在的属组"

- 【Struts2五】Struts2 参数传值

bit1129

struts2

Struts2中参数传值的3种情况

1.请求参数绑定到Action的实例字段上

2.Action将值传递到转发的视图上

3.Action将值传递到重定向的视图上

一、请求参数绑定到Action的实例字段上以及Action将值传递到转发的视图上

Struts可以自动将请求URL中的请求参数或者表单提交的参数绑定到Action定义的实例字段上,绑定的规则使用ognl表达式语言

- 【Kafka十四】关于auto.offset.reset[Q/A]

bit1129

kafka

I got serveral questions about auto.offset.reset. This configuration parameter governs how consumer read the message from Kafka when there is no initial offset in ZooKeeper or

- nginx gzip压缩配置

ronin47

nginx gzip 压缩范例

nginx gzip压缩配置 更多

0

nginx

gzip

配置

随着nginx的发展,越来越多的网站使用nginx,因此nginx的优化变得越来越重要,今天我们来看看nginx的gzip压缩到底是怎么压缩的呢?

gzip(GNU-ZIP)是一种压缩技术。经过gzip压缩后页面大小可以变为原来的30%甚至更小,这样,用

- java-13.输入一个单向链表,输出该链表中倒数第 k 个节点

bylijinnan

java

two cursors.

Make the first cursor go K steps first.

/*

* 第 13 题:题目:输入一个单向链表,输出该链表中倒数第 k 个节点

*/

public void displayKthItemsBackWard(ListNode head,int k){

ListNode p1=head,p2=head;

- Spring源码学习-JdbcTemplate queryForObject

bylijinnan

javaspring

JdbcTemplate中有两个可能会混淆的queryForObject方法:

1.

Object queryForObject(String sql, Object[] args, Class requiredType)

2.

Object queryForObject(String sql, Object[] args, RowMapper rowMapper)

第1个方法是只查

- [冰川时代]在冰川时代,我们需要什么样的技术?

comsci

技术

看美国那边的气候情况....我有个感觉...是不是要进入小冰期了?

那么在小冰期里面...我们的户外活动肯定会出现很多问题...在室内呆着的情况会非常多...怎么在室内呆着而不发闷...怎么用最低的电力保证室内的温度.....这都需要技术手段...

&nb

- js 获取浏览器型号

cuityang

js浏览器

根据浏览器获取iphone和apk的下载地址

<!DOCTYPE html>

<html>

<head>

<meta charset="utf-8" content="text/html"/>

<meta name=

- C# socks5详解 转

dalan_123

socketC#

http://www.cnblogs.com/zhujiechang/archive/2008/10/21/1316308.html 这里主要讲的是用.NET实现基于Socket5下面的代理协议进行客户端的通讯,Socket4的实现是类似的,注意的事,这里不是讲用C#实现一个代理服务器,因为实现一个代理服务器需要实现很多协议,头大,而且现在市面上有很多现成的代理服务器用,性能又好,

- 运维 Centos问题汇总

dcj3sjt126com

云主机

一、sh 脚本不执行的原因

sh脚本不执行的原因 只有2个

1.权限不够

2.sh脚本里路径没写完整。

二、解决You have new mail in /var/spool/mail/root

修改/usr/share/logwatch/default.conf/logwatch.conf配置文件

MailTo =

MailFrom

三、查询连接数

- Yii防注入攻击笔记

dcj3sjt126com

sqlWEB安全yii

网站表单有注入漏洞须对所有用户输入的内容进行个过滤和检查,可以使用正则表达式或者直接输入字符判断,大部分是只允许输入字母和数字的,其它字符度不允许;对于内容复杂表单的内容,应该对html和script的符号进行转义替换:尤其是<,>,',"",&这几个符号 这里有个转义对照表:

http://blog.csdn.net/xinzhu1990/articl

- MongoDB简介[一]

eksliang

mongodbMongoDB简介

MongoDB简介

转载请出自出处:http://eksliang.iteye.com/blog/2173288 1.1易于使用

MongoDB是一个面向文档的数据库,而不是关系型数据库。与关系型数据库相比,面向文档的数据库不再有行的概念,取而代之的是更为灵活的“文档”模型。

另外,不

- zookeeper windows 入门安装和测试

greemranqq

zookeeper安装分布式

一、序言

以下是我对zookeeper 的一些理解: zookeeper 作为一个服务注册信息存储的管理工具,好吧,这样说得很抽象,我们举个“栗子”。

栗子1号:

假设我是一家KTV的老板,我同时拥有5家KTV,我肯定得时刻监视

- Spring之使用事务缘由(2-注解实现)

ihuning

spring

Spring事务注解实现

1. 依赖包:

1.1 spring包:

spring-beans-4.0.0.RELEASE.jar

spring-context-4.0.0.

- iOS App Launch Option

啸笑天

option

iOS 程序启动时总会调用application:didFinishLaunchingWithOptions:,其中第二个参数launchOptions为NSDictionary类型的对象,里面存储有此程序启动的原因。

launchOptions中的可能键值见UIApplication Class Reference的Launch Options Keys节 。

1、若用户直接

- jdk与jre的区别(_)

macroli

javajvmjdk

简单的说JDK是面向开发人员使用的SDK,它提供了Java的开发环境和运行环境。SDK是Software Development Kit 一般指软件开发包,可以包括函数库、编译程序等。

JDK就是Java Development Kit JRE是Java Runtime Enviroment是指Java的运行环境,是面向Java程序的使用者,而不是开发者。 如果安装了JDK,会发同你

- Updates were rejected because the tip of your current branch is behind

qiaolevip

学习永无止境每天进步一点点众观千象git

$ git push joe prod-2295-1

To

[email protected]:joe.le/dr-frontend.git

! [rejected] prod-2295-1 -> prod-2295-1 (non-fast-forward)

error: failed to push some refs to '

[email protected]

- [一起学Hive]之十四-Hive的元数据表结构详解

superlxw1234

hivehive元数据结构

关键字:Hive元数据、Hive元数据表结构

之前在 “[一起学Hive]之一–Hive概述,Hive是什么”中介绍过,Hive自己维护了一套元数据,用户通过HQL查询时候,Hive首先需要结合元数据,将HQL翻译成MapReduce去执行。

本文介绍一下Hive元数据中重要的一些表结构及用途,以Hive0.13为例。

文章最后面,会以一个示例来全面了解一下,

- Spring 3.2.14,4.1.7,4.2.RC2发布

wiselyman

Spring 3

Spring 3.2.14、4.1.7及4.2.RC2于6月30日发布。

其中Spring 3.2.1是一个维护版本(维护周期到2016-12-31截止),后续会继续根据需求和bug发布维护版本。此时,Spring官方强烈建议升级Spring框架至4.1.7 或者将要发布的4.2 。

其中Spring 4.1.7主要包含这些更新内容。

![]()