机器学习模型的超参数优化用于分子性质预测

在《预测化学分子的nlogP——基于sklearn, deepchem, DGL, Rdkit的图卷积网络模型》中简单介绍了sklearn模型的使用方法。

现在来介绍一下,如何对sklearn模型进行超参数优化。要想获得更好的模型,离不开超参数优化。

这里的目的是:示例使用交叉验证结合网格搜索,对机器学习模型进行超参数优化。

一、导入相关模块

主要是pandas和sklearn的模型及模型评价指标。

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

from sklearn.ensemble import GradientBoostingRegressor

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

from sklearn.metrics import r2_score

from sklearn.metrics import mean_absolute_error

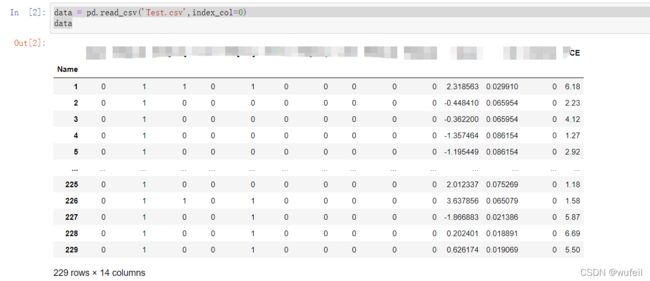

二、导入数据做数据集划分

Test.csv中保存了13个分子描述符,要预测的是分子的CE值,也就是最后一列。该任务是一个回归任务。

data = pd.read_csv('Test.csv',index_col=0)

data

X = data.iloc[:,:-1] #特征

y = data.loc[:,'MXX'] #预测值

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.35, random_state=62

)

三、超参数空间及模型训练

这里使用的是GradientBoostingRegressor模型:

reg = GradientBoostingRegressor(random_state=0)

设置需要搜索的超参数空间为:

param_grid = {

"n_estimators": [300, 500, 800, 1000, 1200],

"max_depth": [2, 3, 4, 5, 6, 7, 8],

"min_samples_split": [2, 4, 5, 6, 7, 8],

"learning_rate": [0.001, 0.003, 0.005, 0.075, 0.01, 0.015, 0.02,],

}

训练模型,采用5重交叉验证,同时使用R2作为评分标准,选择最优的模型;n_jobs=-1使用所有的cpu进行训练。

search = GridSearchCV(reg, param_grid, cv=5,

n_jobs=-1,verbose=1,

scoring='r2')

search.fit(X_train,y_train)

四、训练结果

训练结果,即最优模型为:

best_model = search.best_estimator_

best_model

best_model.score(X_train, y_train)

best_model.score(X_test, y_test)

grid_search.best_score_

输出:0.96622

五、拟合曲线作图

(1)测试集

y_test_pred = best_model.predict(X_test)

sns.regplot(y_test, y_test_pred)

plt.xlim(-0.5,10.5)

plt.ylim(-0.5,10.5)

plt.title('Test Set')

计算R2,RMSE,MAE,测试集

#计算R2,RMSE,MAE,测试集

rmse = np.sqrt(mean_squared_error(y_test, y_test_pred))

r2 = r2_score(y_test, y_test_pred)

mae = mean_absolute_error(y_test, y_test_pred)

print('测试集 MAE:{:.3f}, RMSE:{:.3}, R2:{:.3}'.format(mae, rmse, r2))

输出:测试集 MAE:0.969, RMSE:1.2, R2:0.601

(2)训练集

y_train_pred = best_model.predict(X_train)

sns.regplot(y_train, y_train_pred)

plt.xlim(-0.5,10.5)

plt.ylim(-0.5,10.5)

plt.title('Train Set')

plt.xlabel('PCE_train')

plt.ylabel('PCE_train_predict')

计算R2,RMSE,MAE,训练集

#计算R2,RMSE,MAE,训练集

rmse = np.sqrt(mean_squared_error(y_train, y_train_pred))

r2 = r2_score(y_train, y_train_pred)

mae = mean_absolute_error(y_train, y_train_pred)

print('训练集 MAE:{:.3f}, RMSE:{:.3}, R2:{:.3}'.format(mae, rmse, r2))

输出:训练集 MAE:0.847, RMSE:1.05, R2:0.78

六、SVR模型的超参数优化

仅仅是将模型部分替换为:

reg = SVR()

超参数同步进行替换成SVR的超参数空间:

#网格搜索耗时15分钟

param_grid = {

"kernel": ["rbf", "linear", "poly"],

"C": [1e0, 1e1, 1e2, 1e3],

# "gamma": [1], #0.1, 0.5, 1, 5 超级耗时间,可能是在某些参属下不收敛

"epsilon": [0.05, 0.1, 0.15, 0.2, 0.3, 0.4],

"degree": [1, 2, 3, 4]

}

剩下部分不变,重新运行即可。

注:对于其他模型也是类似的。