第十一周周报

文章目录

- 摘要

- 分布式计算

- 数据增广

- 微调

- 总结

摘要

本周学习了分布式计算、使用多GPU训练情况及它与单GPU训练之间的比较,数据增广概念及应用的情况实例,和迁移学习中微调的技巧使用。

This week, I learned about distributed computing, the use of multiple GPUs in training, and compared it with single GPU training. I also explored the concepts and practical applications of data augmentation, along with examples. Additionally, I delved into the techniques used in fine-tuning during transfer learning.

分布式计算

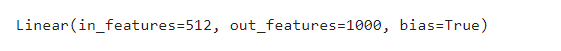

尽量本地多通信,少在机器与机器之间联系,因为从GPU到PCIE,再到CPU,最后到交换机的数据传输过程的速率是一直在下降的。因此我们需要充分在本地进行计算和传输。

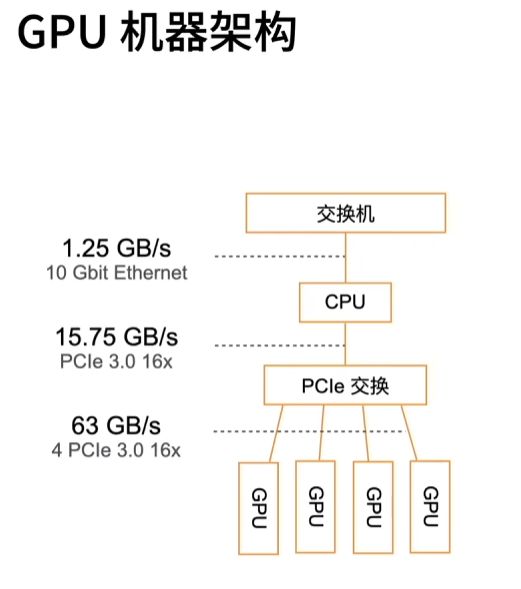

层次的参数服务器

在本地GPU里面还做了一层架构,由其他不同的GPUs传到一个GPU里进行汇总,然后再发送给不同cpu。

样本先分给不同机器,然后机器再将样本分给各自显卡,显卡与复制过去的参数进行运算后,得到梯度,首先在与同一机器的其他计算出的显卡进行求和,然后在不同机器的计算出的梯度进行求和再发送给不同服务器。参数服务器再更新参数。

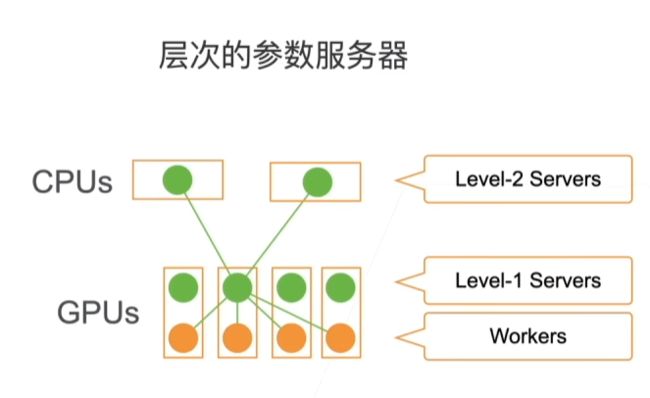

这里每个计算单位都是同步计算一个批量,称为同步SGD

假设有N个GPU,每个GPU每次处理b个样本,那么同步SGD等价于在单GPU运行批量大小为nb的SGD,在理想情况下,n个GPU可以得到相对单GPU的n倍加速。

实践时的建议

(1)使用一个大数据集

(2)需要好的GPU-GPU之间的带宽,和机器-机器之间的带宽

(3)高效的数据读取和预处理

(4)模型需要好的计算与通讯比:FLOP:model size

Inception>ResNet>AlexNet

(5)使用足够大的批量大小来得到好的系统性能

(6)使用高效的优化算法对应大批量大小

总结:分布式同步数据并行是多GPU数据并行在多机器上的拓展,网络通讯通常是瓶颈,需要注意使用特别大的批量大小时收敛效率。更复杂的分布式有异步、模型并行。

数据增广

数据增强:增加一个已有数据集,使得有更多的多样性,例如在语言里面加入各种不同的背景噪音,改变图片颜色和形状。

图像增广

在对训练图像进行一系列的随机变化之后,生成相似但不同的训练样本,从而扩大了训练集的规模。

应用图像增广的原因是,随机改变训练样本可以减少模型对某些属性的依赖,从而提高模型的泛化能力。

我们可以以不同的方式裁剪图像,使感兴趣的对象出现在不同的位置,减少模型对于对象出现位置的依赖。

我们还可以调整亮度、颜色等因素来降低模型对颜色的敏感度。

一般来说,还是从原始的数据集读取图片,但是是随机的对图片进行增强处理。

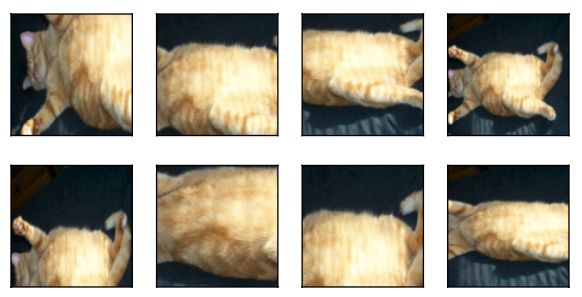

翻转

def apply(img, aug, num_rows=2, num_cols=4, scale=1.5):

Y = [aug(img) for _ in range(num_rows * num_cols)]

d2l.show_images(Y, num_rows, num_cols, scale=scale)

apply(img, torchvision.transforms.RandomHorizontalFlip())

#使用torchvision实现,使得图像各有50%机率向上或向下翻转

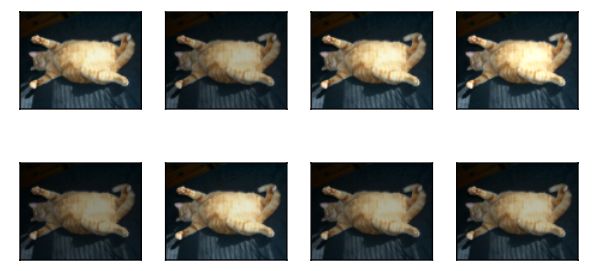

裁剪

下面的代码将[随机裁剪]一个面积为原始面积10%到100%的区域,该区域的宽高比从0.5~2之间随机取值。

然后,区域的宽度和高度都被缩放到200像素。

shape_aug = torchvision.transforms.RandomResizedCrop(

(200, 200), scale=(0.1, 1), ratio=(0.5, 2))

apply(img, shape_aug)

(1)亮度

apply(img, torchvision.transforms.ColorJitter(

brightness=0.5, contrast=0, saturation=0, hue=0))

apply(img, torchvision.transforms.ColorJitter(

brightness=0, contrast=0, saturation=0, hue=0.5))

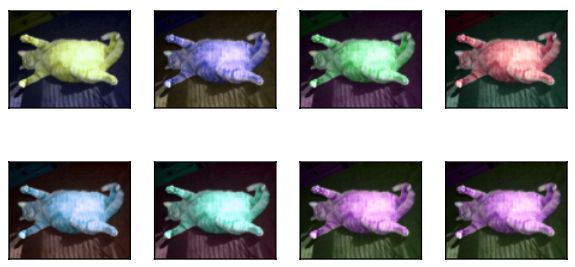

(3)同时改变亮度、对比度、饱和度、色调

color_aug = torchvision.transforms.ColorJitter(

brightness=0.5, contrast=0.5, saturation=0.5, hue=0.5)

apply(img, color_aug)

结合多种图像增广方法

使用Compose实例

augs = torchvision.transforms.Compose([

torchvision.transforms.RandomHorizontalFlip(), color_aug, shape_aug])

apply(img, augs)

使用图像增广来进行训练

使用CIFAR-10数据集,ResNet-18模型,对训练两本进行图像增广,使用随机左右翻转。

使用ToTensor实例将一批图像转换为深度学习框架所要求的格式,即形状为(批量大小,通道数,高度,宽度)的32位浮点数,取值范围为0~1。

train_augs = torchvision.transforms.Compose([

torchvision.transforms.RandomHorizontalFlip(),

torchvision.transforms.ToTensor()])

test_augs = torchvision.transforms.Compose([

torchvision.transforms.ToTensor()])

定义辅助函数,以便读取图像和应用图像增广。

def load_cifar10(is_train, augs, batch_size):

dataset = torchvision.datasets.CIFAR10(root="../data", train=is_train,

transform=augs, download=True)

dataloader = torch.utils.data.DataLoader(dataset, batch_size=batch_size,

shuffle=is_train, num_workers=4)

#直接把刚刚定义augs带过去

return dataloader

使用多GPU对模型进行训练和评估

def train_batch_ch13(net, X, y, loss, trainer, devices):

"""用多GPU进行小批量训练"""

if isinstance(X, list):

# 微调BERT中所需

X = [x.to(devices[0]) for x in X]

else:

X = X.to(devices[0])

y = y.to(devices[0])

net.train()

trainer.zero_grad()

pred = net(X)

l = loss(pred, y)

l.sum().backward()

trainer.step()

train_loss_sum = l.sum()

train_acc_sum = d2l.accuracy(pred, y)

return train_loss_sum, train_acc_sum

#@save

def train_ch13(net, train_iter, test_iter, loss, trainer, num_epochs,

devices=d2l.try_all_gpus()):

"""用多GPU进行模型训练"""

timer, num_batches = d2l.Timer(), len(train_iter)

animator = d2l.Animator(xlabel='epoch', xlim=[1, num_epochs], ylim=[0, 1],

legend=['train loss', 'train acc', 'test acc'])

net = nn.DataParallel(net, device_ids=devices).to(devices[0])

for epoch in range(num_epochs):

# 4个维度:储存训练损失,训练准确度,实例数,特点数

metric = d2l.Accumulator(4)

for i, (features, labels) in enumerate(train_iter):

timer.start()

l, acc = train_batch_ch13(

net, features, labels, loss, trainer, devices)

metric.add(l, acc, labels.shape[0], labels.numel())

timer.stop()

if (i + 1) % (num_batches // 5) == 0 or i == num_batches - 1:

animator.add(epoch + (i + 1) / num_batches,

(metric[0] / metric[2], metric[1] / metric[3],

None))

test_acc = d2l.evaluate_accuracy_gpu(net, test_iter)

animator.add(epoch + 1, (None, None, test_acc))

print(f'loss {metric[0] / metric[2]:.3f}, train acc '

f'{metric[1] / metric[3]:.3f}, test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec on '

f'{str(devices)}')

batch_size, devices, net = 256, d2l.try_all_gpus(), d2l.resnet18(10, 3)

def init_weights(m):

if type(m) in [nn.Linear, nn.Conv2d]:

nn.init.xavier_uniform_(m.weight)

net.apply(init_weights)

def train_with_data_aug(train_augs, test_augs, net, lr=0.001):

train_iter = load_cifar10(True, train_augs, batch_size)

test_iter = load_cifar10(False, test_augs, batch_size)

loss = nn.CrossEntropyLoss(reduction="none")

trainer = torch.optim.Adam(net.parameters(), lr=lr)

train_ch13(net, train_iter, test_iter, loss, trainer, 10, devices)

train_with_data_aug(train_augs, test_augs, net)

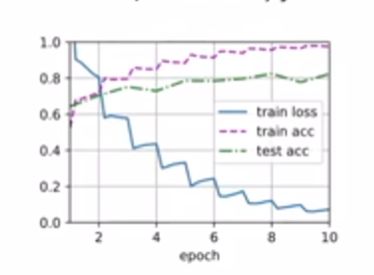

没加数据增广

加了数据增广,训练效果图

从结果可以看出,只是将图片翻转了一下,,就能降低过拟合的程度。

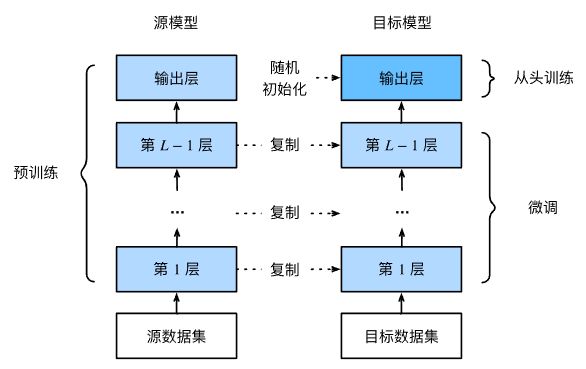

微调

迁移学习中的常见技巧:

1.在源数据集(例如ImageNet数据集)上预训练神经网络模型,即源模型。

2.创建一个新的神经网络模型,即目标模型。这将复制源模型上的所有模型设计及其参数(输出层除外)。我们假定这些模型参数包含从源数据集中学到的知识,这些知识也将适用于目标数据集。

3.向目标模型添加输出层,其输出数是目标数据集中的类别数。然后随机初始化该层的模型参数。

4.在目标数据集(如椅子数据集)上训练目标模型。输出层将从头开始进行训练,而所有其他层的参数将根据源模型的参数进行微调。

用一个数据集包含1400张热狗的“正类”图像,以及包含尽可能多的其他食物的“负类”图像。 含着两个类别的1000张图片用于训练,其余的则用于测试。

import os

import torch

import torchvision

from torch import nn

from d2l import torch as d2l

d2l.DATA_HUB['hotdog'] = (d2l.DATA_URL + 'hotdog.zip',

'fba480ffa8aa7e0febbb511d181409f899b9baa5')

data_dir = d2l.download_extract('hotdog')

train_imgs = torchvision.datasets.ImageFolder(os.path.join(data_dir, 'train'))

test_imgs = torchvision.datasets.ImageFolder(os.path.join(data_dir, 'test'))

#创建两个实例来分别读取训练和测试数据集中的所有图像文件。

# 使用RGB通道的均值和标准差,以标准化每个通道

normalize = torchvision.transforms.Normalize(

[0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

train_augs = torchvision.transforms.Compose([

torchvision.transforms.RandomResizedCrop(224),

torchvision.transforms.RandomHorizontalFlip(),

torchvision.transforms.ToTensor(),

normalize])

test_augs = torchvision.transforms.Compose([

torchvision.transforms.Resize([256, 256]),

torchvision.transforms.CenterCrop(224),

torchvision.transforms.ToTensor(),

normalize])

#定义和初始化模型

#使用resnet-18作为源模型

pretrained_net = torchvision.models.resnet18(pretrained=True)

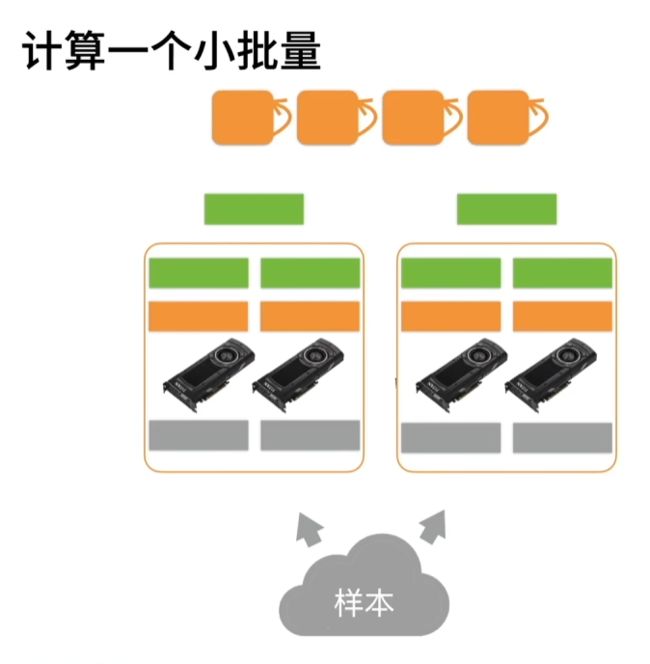

#目标模型的输出层

#它的定义方式与预训练源模型的定义方式相同,只是最终层中的输出数量被设置为目标数据集中的类数(而不是1000个)。

finetune_net = torchvision.models.resnet18(pretrained=True)

finetune_net.fc = nn.Linear(finetune_net.fc.in_features, 2)

nn.init.xavier_uniform_(finetune_net.fc.weight);

微调模型

# 如果param_group=True,输出层中的模型参数将使用十倍的学习率

def train_fine_tuning(net, learning_rate, batch_size=128, num_epochs=5,

param_group=True):

train_iter = torch.utils.data.DataLoader(torchvision.datasets.ImageFolder(

os.path.join(data_dir, 'train'), transform=train_augs),

batch_size=batch_size, shuffle=True)

test_iter = torch.utils.data.DataLoader(torchvision.datasets.ImageFolder(

os.path.join(data_dir, 'test'), transform=test_augs),

batch_size=batch_size)

devices = d2l.try_all_gpus()

loss = nn.CrossEntropyLoss(reduction="none")

if param_group:

params_1x = [param for name, param in net.named_parameters()

if name not in ["fc.weight", "fc.bias"]]

trainer = torch.optim.SGD([{'params': params_1x},

{'params': net.fc.parameters(),

'lr': learning_rate * 10}],

lr=learning_rate, weight_decay=0.001)

else:

trainer = torch.optim.SGD(net.parameters(), lr=learning_rate,

weight_decay=0.001)

d2l.train_ch13(net, train_iter, test_iter, loss, trainer, num_epochs,

devices)

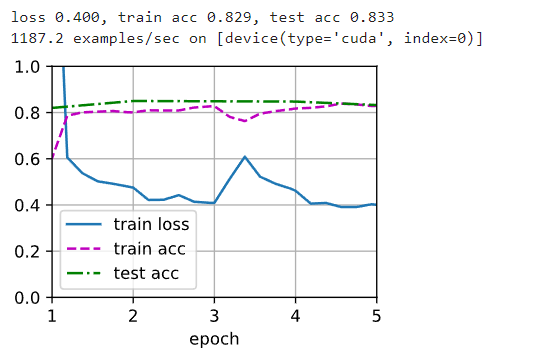

训练

train_fine_tuning(finetune_net, 5e-5)

与随机参数的相同模型相比较:

loss值更低,准确度更高,表现更好。

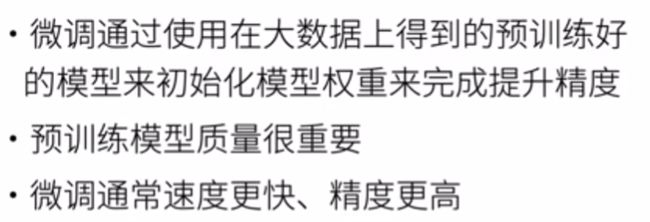

总结

本周没有学习新的模型,学习提高训练速度、精度的技巧,以及在数据集不够大的情况或者提高模型泛化能力的方法———数据增广。其余时间在复习周六考试的科目上。