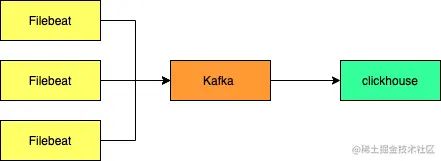

替代ELK:ClickHouse+Kafka+FlieBeat,才是最佳选择?

背景

SaaS 服务未来会面临数据安全、合规等问题。公司的业务需要沉淀一套私有化部署能力,帮助业务提升行业竞争力。为了完善平台系统能力、我们需要沉淀一套数据体系帮助运营分析活动效果、提升运营能力。

然而在实际的开发过程中,如果直接部署一套大数据体系,对于使用者来说将是一笔比较大的服务器开销。为此我们选用折中方案完善数据分析能力。

Easticsearch vs Clickhouse

ClickHouse是一款高性能列式分布式数据库管理系统,我们对ClickHouse进行了测试,发现有下列优势:

ClickHouse写入吞吐量大,单服务器日志写入量在50MB到200MB/s,每秒写入超过60w记录数,是ES的5倍以上。在ES中比较常见的写Rejected导致数据丢失、写入延迟等问题,在ClickHouse中不容易发生。

查询速度快,官方宣称数据在pagecache中,单服务器查询速率大约在2-30GB/s;没在pagecache的情况下,查询速度取决于磁盘的读取速率和数据的压缩率。经测试ClickHouse的查询速度比ES快5-30倍以上。

ClickHouse比ES服务器成本更低。一方面ClickHouse的数据压缩比比ES高,相同数据占用的磁盘空间只有ES的1/3到1/30,节省了磁盘空间的同时,也能有效的减少磁盘IO,这也是ClickHouse查询效率更高的原因之一;另一方面ClickHouse比ES占用更少的内存,消耗更少的CPU资源。我们预估用ClickHouse处理日志可以将服务器成本降低一半。

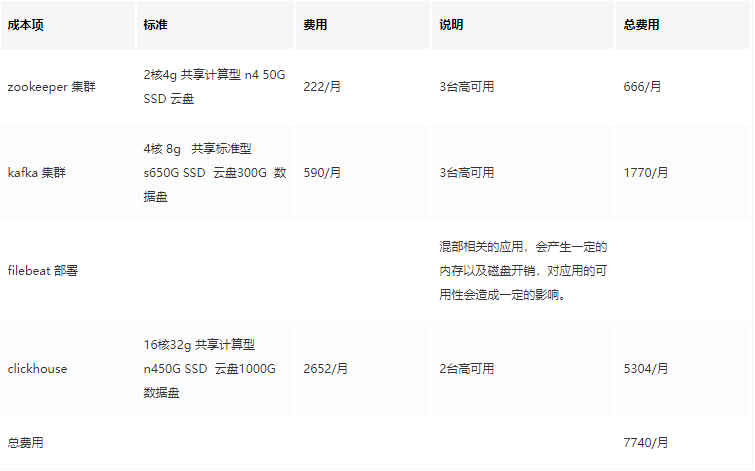

成本分析

备注:在没有任何折扣的情况下,基于aliyun分析

环境部署

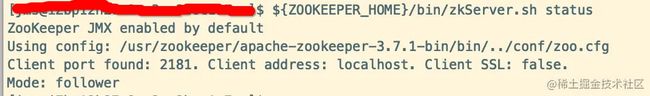

zookeeper 集群部署

yum install java-1.8.0-openjdk-devel.x86_64/etc/profile 配置环境变量更新系统时间yum install ntpdatentpdate asia.pool.ntp.orgmkdir zookeepermkdir ./zookeeper/datamkdir ./zookeeper/logswget --no-check-certificate https://mirrors.tuna.tsinghua.edu.cn/apache/zookeeper/zookeeper-3.7.1/apache-zookeeper-3.7.1-bin.tar.gztar -zvxf apache-zookeeper-3.7.1-bin.tar.gz -C /usr/zookeeperexport ZOOKEEPER_HOME=/usr/zookeeper/apache-zookeeper-3.7.1-binexport PATH=$ZOOKEEPER_HOME/bin:$PATH进入ZooKeeper配置目录cd $ZOOKEEPER_HOME/conf新建配置文件vi zoo.cfgtickTime=2000initLimit=10syncLimit=5dataDir=/usr/zookeeper/datadataLogDir=/usr/zookeeper/logsclientPort=2181server.1=zk1:2888:3888server.2=zk2:2888:3888server.3=zk3:2888:3888在每台服务器上执行,给zookeeper创建myidecho "1" > /usr/zookeeper/data/myidecho "2" > /usr/zookeeper/data/myidecho "3" > /usr/zookeeper/data/myid进入ZooKeeper bin目录cd $ZOOKEEPER_HOME/binsh zkServer.sh start

Kafka 集群部署

mkdir -p /usr/kafkachmod 777 -R /usr/kafkawget --no-check-certificate https://mirrors.tuna.tsinghua.edu.cn/apache/kafka/3.2.0/kafka_2.12-3.2.0.tgztar -zvxf kafka_2.12-3.2.0.tgz -C /usr/kafka不同的broker Id 设置不一样,比如 1,2,3broker.id=1listeners=PLAINTEXT://ip:9092socket.send.buffer.bytes=102400socket.receive.buffer.bytes=102400socket.request.max.bytes=104857600log.dir=/usr/kafka/logsnum.partitions=5num.recovery.threads.per.data.dir=3offsets.topic.replication.factor=2transaction.state.log.replication.factor=3transaction.state.log.min.isr=3log.retention.hours=168log.segment.bytes=1073741824log.retention.check.interval.ms=300000zookeeper.connect=zk1:2181,zk2:2181,zk3:2181zookeeper.connection.timeout.ms=30000group.initial.rebalance.delay.ms=0后台常驻进程启动kafkanohup /usr/kafka/kafka_2.12-3.2.0/bin/kafka-server-start.sh /usr/kafka/kafka_2.12-3.2.0/config/server.properties >/usr/kafka/logs/kafka.log >&1 &/usr/kafka/kafka_2.12-3.2.0/bin/kafka-server-stop.sh$KAFKA_HOME/bin/kafka-topics.sh --list --bootstrap-server ip:9092$KAFKA_HOME/bin/kafka-console-consumer.sh --bootstrap-server ip:9092 --topic test --from-beginning$KAFKA_HOME/bin/kafka-topics.sh --create --bootstrap-server ip:9092 --replication-factor 2 --partitions 3 --topic xxx_data

FileBeat 部署

sudo rpm --import https://packages.elastic.co/GPG-KEY-elasticsearchCreate a file with a .repo extension (for example, elastic.repo) in your /etc/yum.repos.d/ directory and add the following lines:在/etc/yum.repos.d/ 目录下创建elastic.repo[elastic-8.x]name=Elastic repository for 8.x packagesbaseurl=https://artifacts.elastic.co/packages/8.x/yumgpgcheck=1gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearchenabled=1autorefresh=1type=rpm-mdyum install filebeatsystemctl enable filebeatchkconfig --add filebeat

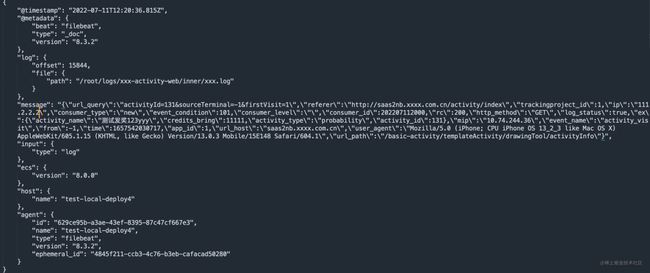

FileBeat 配置文件说明,坑点1(需设置keys_under_root: true)。如果不设置kafka的消息字段如下:

文件目录:/etc/filebeat/filebeat.yml

filebeat.inputs:- type: logenabled: truepaths:- /root/logs/xxx/inner/*.logjson:如果不设置该索性,所有的数据都存储在message里面,这样设置以后数据会平铺。keys_under_root: trueoutput.kafka:hosts: ["kafka1:9092", "kafka2:9092", "kafka3:9092"]topic: 'xxx_data_clickhouse'partition.round_robin:reachable_only: falserequired_acks: 1compression: gzipprocessors:剔除filebeat 无效的字段数据- drop_fields:fields: ["input", "agent", "ecs", "log", "metadata", "timestamp"]ignore_missing: falsenohup ./filebeat -e -c /etc/filebeat/filebeat.yml > /user/filebeat/filebeat.log &输出到filebeat.log文件中,方便排查

Clickhouse 部署

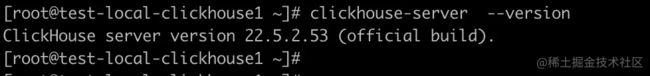

检查当前CPU是否支持SSE 4.2,如果不支持,需要通过源代码编译构建grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"返回 "SSE 4.2 supported" 表示支持,返回 "SSE 4.2 not supported" 表示不支持创建数据保存目录,将它创建到大容量磁盘挂载的路径mkdir -p /data/clickhouse修改/etc/hosts文件,添加clickhouse节点举例:10.190.85.92 bigdata-clickhouse-0110.190.85.93 bigdata-clickhouse-02服务器性能参数设置:cpu频率调节,将CPU频率固定工作在其支持的最高运行频率上,而不动态调节,性能最好echo 'performance' | tee /sys/devices/system/cpu/cpu*/cpufreq/scaling_governor内存调节,不要禁用 overcommitecho 0 | tee /proc/sys/vm/overcommit_memory始终禁用透明大页(transparent huge pages)。它会干扰内存分配器,从而导致显着的性能下降echo 'never' | tee /sys/kernel/mm/transparent_hugepage/enabled首先,需要添加官方存储库:yum install yum-utilsrpm --importyum-config-manager --add-repo查看clickhouse可安装的版本:yum list | grep clickhouse运行安装命令:yum -y install clickhouse-server clickhouse-client修改/etc/clickhouse-server/config.xml配置文件,修改日志级别为information,默认是traceinformation 执行日志所在目录:正常日志/var/log/clickhouse-server/clickhouse-server.log异常错误日志/var/log/clickhouse-server/clickhouse-server.err.log查看安装的clickhouse版本:clickhouse-server --versionclickhouse-client --passwordsudo clickhouse stopsudo clickhouse tartsudo clickhouse start

总结

整个部署的过程踩了不少坑,尤其是filebeat yml的参数设置。clickhouse 的配置说明我会再更新一篇跟大家同步一下过程中踩的坑。很久没有更新博客了,经常看到博客35岁以后怎么办的问题。

说实话我自己也没想好以后怎么办,核心还是持续的学习&输出。不断的构建自己的护城河,不管是技术专家、业务专家、架构、管理等。个人建议如果能持续写代码就奋战在一线,管理彻底与公司绑定。除非你是有名的大厂,这另外看。

如果所在的公司缺乏较大的行业影响力,个人感觉可以奋战在一线,未来选择新的工作。考量更多的还是行业影响、商业sense、技术架构能力。现在的我已35,从容的面对每一天。

来源:juejin.cn/post/7120880190003085320