零基础爬虫:通过模仿进行学习

文章目录

- 前言

- 1.别人的爬虫

- 2.我的爬虫

-

-

- 关于Python技术储备

-

- 一、Python所有方向的学习路线

- 二、Python基础学习视频

- 三、精品Python学习书籍

- 四、Python工具包+项目源码合集

- ①Python工具包

- ②Python实战案例

- ③Python小游戏源码

- 五、面试资料

- 六、Python兼职渠道

-

前言

好家伙,爬虫来了

爬虫,这玩意,不会怎么办,

诶,先抄一份作业回来

1.别人的爬虫

**# -\*- codeing = utf-8 -\*-

from bs4 import BeautifulSoup # 网页解析,获取数据

import re # 正则表达式,进行文字匹配\`

import urllib.request, urllib.error # 制定URL,获取网页数据

import xlwt # 进行excel操作

#import sqlite3 # 进行SQLite数据库操作

findLink = re.compile(r'') # 创建正则表达式对象,标售规则 影片详情链接的规则

findImgSrc = re.compile(r'(.\*)')

findRating \= re.compile(r'')

findJudge \= re.compile(r'(\\d\*)人评价')

findInq \= re.compile(r'(.\*)')

findBd \= re.compile(r'(.\*?)

', re.S)

def main():

baseurl \= "https://movie.douban.com/top250?start=" #要爬取的网页链接

# 1.爬取网页

datalist = getData(baseurl)

savepath \= "豆瓣电影Top250.xls" #当前目录新建XLS,存储进去

# dbpath = "movie.db" #当前目录新建数据库,存储进去

# 3.保存数据

saveData(datalist,savepath) #2种存储方式可以只选择一种

# saveData2DB(datalist,dbpath)

# 爬取网页

def getData(baseurl):

datalist \= \[\] #用来存储爬取的网页信息

for i in range(0, 10): # 调用获取页面信息的函数,10次

url = baseurl + str(i \* 25)

html \= askURL(url) # 保存获取到的网页源码

# 2.逐一解析数据

soup = BeautifulSoup(html, "html.parser")

for item in soup.find\_all('div', class\_="item"): # 查找符合要求的字符串

data = \[\] # 保存一部电影所有信息

item = str(item)

link \= re.findall(findLink, item)\[0\] # 通过正则表达式查找

data.append(link)

imgSrc \= re.findall(findImgSrc, item)\[0\]

data.append(imgSrc)

titles \= re.findall(findTitle, item)

if (len(titles) == 2):

ctitle \= titles\[0\]

data.append(ctitle)

otitle \= titles\[1\].replace("/", "") #消除转义字符

data.append(otitle)

else:

data.append(titles\[0\])

data.append(' ')

rating \= re.findall(findRating, item)\[0\]

data.append(rating)

judgeNum \= re.findall(findJudge, item)\[0\]

data.append(judgeNum)

inq \= re.findall(findInq, item)

if len(inq) != 0:

inq \= inq\[0\].replace("。", "")

data.append(inq)

else:

data.append(" ")

bd \= re.findall(findBd, item)\[0\]

bd \= re.sub(' 卧槽,有点东西

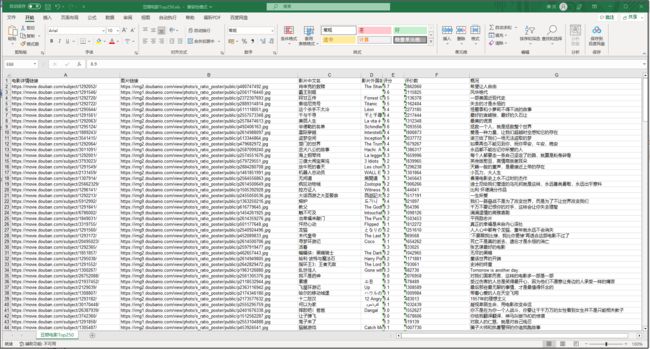

这东西看上去挺nb啊,

也很方便,把我想要的一些数据直接总结到一个excel表格中了

我们来看看这些字段是如何匹配的

.xls

代码:

**findLink = re.compile(r'') # 创建正则表达式对象,标售规则 影片详情链接的规则

findImgSrc = re.compile(r'(.\*)')

findRating \= re.compile(r'')

findJudge \= re.compile(r'(\\d\*)人评价')

findInq \= re.compile(r'(.\*)')

findBd \= re.compile(r'(.\*?)

', re.S)**

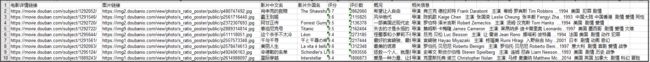

?? 这不就专业对口了吗

网站的html:

将三个"表"都打开,再来看看对比

(诶都对上了)

此处,使用正则表达式去匹配对应标签

于是看了这个案例之后,我们就可以大概去分析以下爬虫到底干了什么:

1.发请求,随后拿到服务器发过来的.html文件

2.用正则表达式去套对应的,我们需要的数据

3.处理数据,最后把他们以某种方式呈现

具体来说,爬虫通常会执行以下步骤:

-

发送HTTP请求:爬虫通过发送HTTP请求来获取目标网页的内容。

-

解析HTML页面:网页内容一般是HTML格式的,爬虫需要使用HTML解析器来将页面内容解析成Python对象。

-

提取数据:通过Python编程语言对解析出来的对象进行遍历和操作,找到需要的数据并保存下来。

-

存储数据:将提取的数据保存到文件中、数据库中或者内存中,以备后续的处理和分析。

-

处理异常:爬虫需要处理异常,例如:请求超时、解析错误等,以确保爬虫的稳定性和可靠性。

开干

2.我的爬虫

好了,我们自己写一个爬虫试试

**import requests

from bs4 import BeautifulSoup

import xlwt

import re

# 创建Excel文件

workbook = xlwt.Workbook(encoding='utf-8')

worksheet \= workbook.add\_sheet('kugou\_rank')

# pattern = re.compile(r'(?<=- ).\*')

# 构造请求头

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36'

}

# 定义排行榜页面的URL

url = 'https://www.kugou.com/yy/rank/home/1-6666.html?from=rank'

# 发送请求并获取响应

r = requests.get(url, headers=headers)

# 解析HTML

soup = BeautifulSoup(r.text, 'html.parser')

# 定位歌曲排行榜列表

song\_list = soup.find('div', {'class': 'pc\_temp\_songlist'}).find\_all('li')

# 将数据写入Excel文件

worksheet.write(0, 0, '排名') #写入对应的字段

worksheet.write(0, 1, '歌名')

worksheet.write(0, 2, '歌手')

worksheet.write(0, 3, '专辑')

worksheet.write(0, 4, '播放时长')

worksheet.write(0, 5, '链接地址')

row \= 1

for song in song\_list:

song\_name \= song.find('a', {'class': 'pc\_temp\_songname'}).text.strip() #筛选出歌名

song\_title = song.get('title')

singer\_pattern \= re.compile(r'.\*(?= - )')

song\_singer \= singer\_pattern.findall(song\_title)

song\_title \= song.get('title')

print(song\_title)

album\_pattern \= re.compile(r'(?<=- ).\*')

song\_album \= album\_pattern.findall(song\_title)

# song\_album = pattern.findall(song)

song\_time = song.find('span', {'class': 'pc\_temp\_time'}).text.strip()

link\_pattern \= re.compile(r'href="(.\*?)"')

worksheet.write(row, 0, song\['data-index'\]) #将排行写入excel表格

worksheet.write(row, 1, song\_name) #将歌名写入excel表格

worksheet.write(row, 2, song\_singer) #将歌手写入excel表格

worksheet.write(row, 3, song\_album) #将歌曲专辑写入excel表格

worksheet.write(row, 4, song\_time) #将歌曲时长写入excel表格

song =str(song)

song \= song.split("javascript:")\[0\]

song\_link \= link\_pattern.findall(song)

worksheet.write(row, 5, song\_link) #将歌曲时长写入excel表格

row += 1

# 保存Excel文件

workbook.save('C:/Users/10722/Desktop/python答辩/kugou\_rank.xls')**

说明:

**# 构造请求头

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36'

}**

带着请求头去请求,一个简单的"反爬"机制,模仿浏览器去发请求,非常实用

(其实没什么乱用,你能想到的,网站的开发者大概也能想到,所以你要是乱来还是会封你IP的)

没什么难度

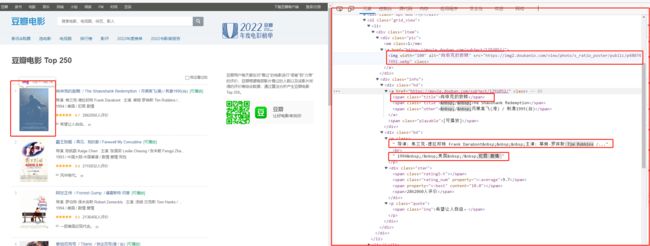

这爬了酷狗的一个音乐榜单

然后记录了一些音乐数据,还有歌曲的地址。

算是给大家提供了一些基础思路。

关于Python技术储备

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后给大家分享一份全套的 Python 学习资料,希望提供给想学习 Python 的小伙伴们一点帮助!

保存图片微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

![]()

二、Python基础学习视频

② 路线对应学习视频

还有很多适合0基础入门的学习视频,有了这些视频,轻轻松松上手Python~在这里插入图片描述

![]()

③练习题

每节视频课后,都有对应的练习题哦,可以检验学习成果哈哈!

![]()

因篇幅有限,仅展示部分资料

三、精品Python学习书籍

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

![]()

四、Python工具包+项目源码合集

①Python工具包

学习Python常用的开发软件都在这里了!每个都有详细的安装教程,保证你可以安装成功哦!

![]()

②Python实战案例

光学理论是没用的,要学会跟着一起敲代码,动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。100+实战案例源码等你来拿!

![]()

③Python小游戏源码

如果觉得上面的实战案例有点枯燥,可以试试自己用Python编写小游戏,让你的学习过程中增添一点趣味!

![]()

五、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

![]()

![]()

六、Python兼职渠道

而且学会Python以后,还可以在各大兼职平台接单赚钱,各种兼职渠道+兼职注意事项+如何和客户沟通,我都整理成文档了。

![]()

这份完整版的Python全套学习资料已经上传CSDN,朋友们如果需要可以保存图片微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】