相机图像质量概述

前言:

对很多刚入行做camera tuning的小伙伴来说,可能对图像质量还不是很了解,包括我自己刚开始接触这一行的时候也是一样,不清楚ISP是什么,为什么要调它,影响画质的因素又有哪些,哪些是ISP能调的,哪些又不能调的,所以本文主要是从概念上简单介绍下图像质量,从图像质量介绍、成像系统介绍、影响图像质量的典型因素举例,三块内容来概述的,希望对刚入行的小伙伴有所帮助,可以加深一下对图像质量的理解;

目录

1、图像质量介绍

1-1、成像产品的分类

1-2、图像质量分类

1-3、成像产品的图像质量要求

2、成像系统介绍

2-1、成像系统组成

2-2、成像系统的两条基本主线

2-3、成像系统的实时控制

3、影响图像质量的典型因素举例

3-1、光学及镜头、IR相关的图像质量问题

3-2、CMOS Sensor 相关的图像质量问题

3-3、ISP 相关的图像质量问题

3-4、Encoder 相关的图像质量问题

3-5、显示相关的图像质量问题

1、图像质量介绍

1-1、成像产品的分类

1-2、图像质量分类

-

审美型 ( 人眼评判 )

no artefacts ! color,noise,detail,focus speed、etc

-

信息型( 机器识别、检测 )

fast,no information lost,visibility,certain level tolerace to artefacts、etc

-

根据图像质量需求的成像产品分类

1-3、成像产品的图像质量要求

审美类成像产品的图像质量要求

-

单反相机 -- 真实的还原现实世界,需要遵循一定的客观成像标准CIPA,ISO,如有艺术创作的需要可以用PS等软件对照片进行后处理;

-

手机相机 -- 偏向于人眼视觉,对人/人脸的拍摄有一定要求;

-

无人机/ 运动相机 -- 视频的稳定性(防抖、不允许画面突变),对人/人脸的拍摄有一定要求;

-

监控相机 -- 低照度噪声(时域,空域)、HDR、高锐度、对人/人脸的拍摄有一定要求;

信息类成像产品的图像质量要求

-

机器视觉相机 -- 人/人脸、 高感光度;

-

Home Camera -- 家用相机,和监控相机类似,对人脸识别有一定要求;

-

车载相机 -- 高动态范围、高感光度、高帧率、motion artefacts、stitching artifacts、满足一定的人眼视觉(有前视/后视的摄像头是人眼来看的);

2、成像系统介绍

2-1、成像系统组成

-

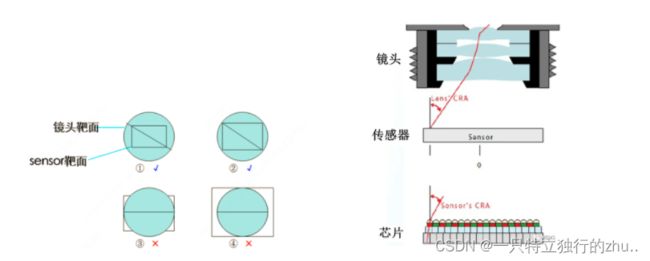

要理解图像质量,就必须要了解整个成像系统的组成,搞清楚整个成像系统中有哪些模块会影响图像质量,如上以成像过程来描述,光源(包含人造光、自然光、闪光灯)照到物体上,光线反射进入成像系统,经过镜头(对于变焦镜头有驱动马达调整镜片位置,实现变焦)、光圈、滤光片、快门到达Sensor上成像,接着出来数字信号传到ISP进行图像处理,ISP输出YUV格式的数据,用于显示或者经过编码后进行存储,又或者用于机器视觉;所以影响图像质量的因素有很多,包括光源、镜头、滤光片、Sensor、ISP、显示器的显示、编码 ........

-

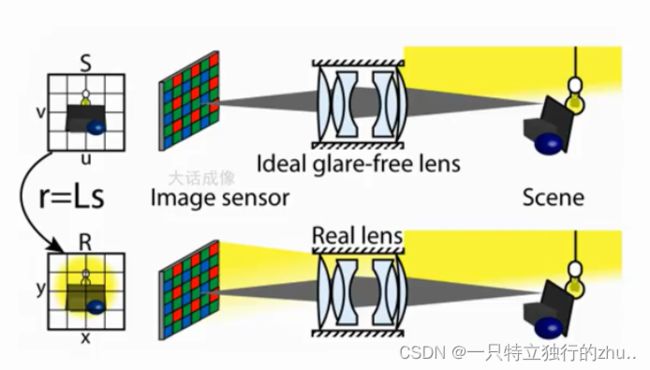

理解一下就是光源、镜头、光圈、滤光片、快门、Sensor构成了一个完整的光学成像系统,但由于光学和半导体的缺陷与局限会导致成像的一系列问题,就需要经过ISP,用数字信号处理的方法去克服光学,半导体的缺陷导致的成像问题,处理完并得到较好的图像后,就用来进行图像的显示、存储、或者机器视觉的检测识别等应用;

-

总结:整个成像系统是一个软硬结合、光机电结合的复杂系统,做有些系统架构和硬件架构的人,有必要了解整个系统,才能够设计出正确的架构,包括做图像质量的也是从系统角度去处理问题,同样要了解整个系统,才能更好的完成工作;

2-2、成像系统的两条基本主线

图像重建 --- 清晰勾画出正确的景物( 图像重建的过程,就是用数字信号处理的方法去克服光学、半导体的缺陷,清晰勾画出正确的景物 )

-

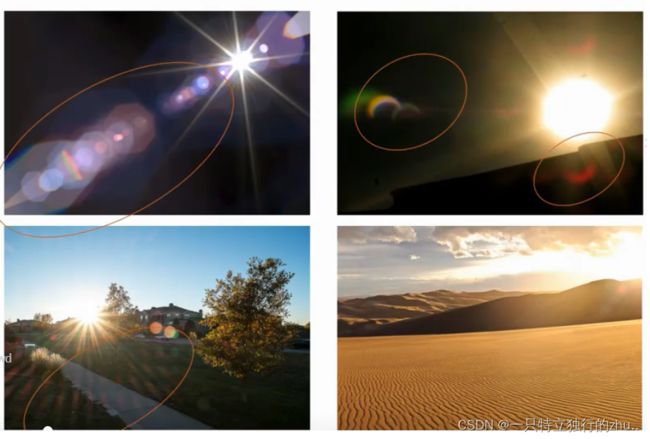

光学缺陷与局限: MTF、像差、场曲、vignetting(光晕,暗角)/luma shading(亮度阴影)、glare(眩光)、Geometry Distortion(几何失真)

-

半导体缺陷与局限:defect pixel、sensitivity、dynamic range、noise:temperal noise、fix pattern noise、color noise、spatial noise

色彩重建 --- 还原出准确丰富的色彩 ( 有时还要符合人们主观倾向的色彩 )

-

光学缺陷与局限:Color shading、chromatic aberration、purple fringe

-

半导体缺陷与局限:Cross talk、balck level

2-3、成像系统的实时控制

一般从硬件厂商那边拿到的相同产品,成像效果都是差不多的,所以要有更好的用户体验就必须在软件上面增加自己的优化,如3A算法、后处理算法;

-

系统的静态参数:black level、shading、noise profile、white balance、chromatic aberration correction

-

AE\AWB\AF(自动曝光、自动白平衡、自动对焦):达到曝光/白平衡/对焦的“快”、“准”、“稳”

-

系统的动态参数:shading,CCM, black level,noise reduction,sharpening

3、影响图像质量的典型因素举例

3-1、光学及镜头、IR相关的图像质量问题

-

畸变

-

luma shading

-

color shading

-

眩光、鬼影

-

紫边

3-2、CMOS Sensor 相关的图像质量问题

-

坏点

-

噪声(Fix pattern noise 、热噪)

-

sensor filp/mirror

3-3、ISP 相关的图像质量问题

-

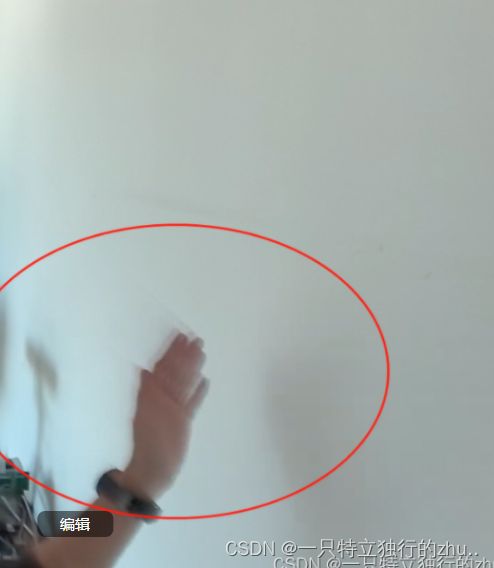

运动拖影

3-4、Encoder 相关的图像质量问题

-

mosaic

-

ringing (震铃)

-

contouring

-

blurry(模糊)

-

mosquito (蚊子噪声)

3-5、显示相关的图像质量问题

-

电视的PQ( Picture-Quality)会导致Camera 显示效果不一致(亮度、色彩、噪声等方面);

-

显示器色域、色准差异会导致Camera 显示效果不一致;