C++卷积神经网络实例:tiny_cnn代码详解(4)——convolutional_layer类结构信息之成员变量与构造函数

在之前的博文中我们已经对tiny_cnn框架的整体类结构做了大致分析,阐明了各个类之间的继承依赖关系,在接下来的几篇博文中我们将分别对各个类进行更为详细的分析,明确其内部具体功能实现。在这篇博文中着重分析convolutional_layer类。convolutional_layer封装的是卷积神经网络中的卷积层网路结构,其在主程序中对应的初始化部分代码如下:

可见在测试程序中我们构建了一个具有五层网络结构(不包括全连接层)的神经网络结构,这也正是LeNet-5的结构,在其中一共有三层为卷积层,因此可见卷积层在CNN中所起的重要中用,接下来就从“convolutional_layer<tan_h>(32, 32, 5, 1, 6)”这个代码入手对convolutional_layer类进行分析。首先给出convolutional_layer类的整体结构:

一、成员变量

convolutional_layer类一共有五个私有的成员变量,in_保存了输入数据矩阵的基本属性:行数、列数、维数;out_保存了输出特征矩阵的基本形式:函数、列数、维数;weight_保存了权重矩阵的基本形式。connection_保存了当前卷积层与上一层(下采样层)之间的连接关系,window_size_保存了当前层卷积核尺寸。

这里有一点需要强调,in_、out_、weight_三个变量均是index3d<layer_size_t>形式,这里的index3d实际上指的是一个三元vector类型,其声明位于util.h文件中:

所以index3d类型的变量能够保存三个数值信息,并能够在其内部做一些简要运算。

二、构造函数

在研究完类的成员变量之后,接下来需要分析其内部的函数实现形式,以求对这个类的功能以及相关结构有更好的理解。convolutional_layer类的成员函数大体上可以分为三部分:构造函数、层间连接构造函数、返回函数。其中构造函数承担了成员变量的初始化任务。

2.1 构造函数的两种形式

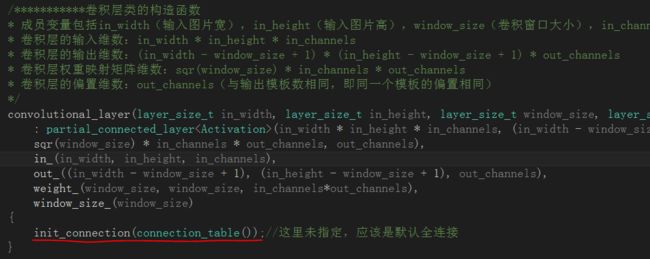

convolutional_layer类提供了两种构造函数的形式,一种是采用默认的连接方式,也就是和前一层的卷积输出进行全连接,定义如下:

这里的connection_table()会返回一个默认的全零矩阵,然后init_connection()函数会将默认成员变量connection_初始化为全零矩阵,全零矩阵也就默认是全连接模式,这点稍后会给出详细分析。

convolutional_layer的第二种构造函数需要人为指定与前一层的连接形式,具体如下:

这里connection_table是由外部传入的、用户指定的连接矩阵,通过init_connection函数将其赋值给connection_。

2.2 构造函数输入参数

接来下对构造函数的参数以及与基类构造函数的继承关系进行分析。首先,convolutional_layer类在执行构造时一共需要以下几个参数:

in_width:输入图片宽度(矩阵行数);

in_height:输入图片高度(矩阵列数);

window_size:卷积窗口大小;

in_channels:输入的模板数;

out_channels:输出的模板数

connection_table:矩阵的连接形式,可以默认生成也可以用户指定。

由于convolutional_layer类是继承自partial_connected_layer类,因此在执行convolutional_layer构造函数的过程中,首先需要执行其基类partial_connected_layer类的构造函数:

partial_connected_layer<Activation>(in_width * in_height * in_channels, (in_width - window_size + 1) * (in_height - window_size + 1) * out_channels, sqr(window_size) * in_channels * out_channels, out_channels),

有关partial_connected_layer类的构造函数我会在介绍partial_connected_layer类的博文中专门进行分析,这里就先不做过多的表述,接下来需要分析的是在convolutional_layer的构造函数中是如何实现对其成员变量的初始化的,具体代码如下:

(1)in_作为卷积层的输入参数,直接保存输入数据矩阵的尺寸以及通道数即可(单通道或者三通道);

(2)out_作为卷积层的特征输出,由于存在滑动窗口卷积的缘故,导致其输出的特征矩阵的尺寸与输入的数据矩阵的尺寸不一致,具体值为“in_width - window_size + 1”和“in_height - window_size + 1”,并且输出的特征模板数量与指定的out_channels相当。

(3)weight_作为卷积层的权重矩阵,其尺寸自然应当和卷积核的尺寸相当,至于个数,则为输入数据矩阵数量*输出特征模板数量,即每个映射核完成一个输入矩阵到一个输出矩阵之间的映射任务,这就是所谓的权值共享和感受野的概念。

(4)connection_为卷积网络与前一层(下采样层)的连接形式矩阵,保存了表示连接与否标志位的矩阵,在LeNet-5网络中,第一个卷积层与输入层是全连接的,第二个卷积层和下采样层的连接情况如下所示:

对应的,在MyTinyCnn的测试程序中给出了对应的定义:

(5)window_size_保存了当前卷积层卷积核的尺寸,直接由用户指定即可。

OK,这篇博客着重分析了convolutional_layer类中相关的成员变量和构造函数等信息,在下一篇博客中我们将着重对其中的成员函数进行分析,具体说明各个成员变量之间的初始化方式方法。

三、注意事项

1、类型别名问题

在tiny_cnn中,作者通过typedef关键字定义了若干类型别名,位于util.h文件中:

因此在分析代码的过程中若是遇到这些类型别名,只需知道其真实的类型即可。

2、代码截图问题

在这系列的博客中,我所分析的很多代码都是通过截图的方式来获得,这样做的原因有两个,一是这份tiny_cnn的工程文件大家都可以从网上下载得到,无需再粘贴源码;二是通过截图的方式能够方便对我想要强调的部分进行标记突出,便于大家理解,希望大家习惯这种代码截图的方式。不过这种方式也有一个缺点,就是会导致博文的图片过多,内容过长,大家勉强接受吧。