CVPR 2015 Oral概览 - 第一天上午

第一天上午的两大主题:迅猛发展的深度学习和枝繁叶茂的3D摄像头。

D1-AM-A. CNN Architectures

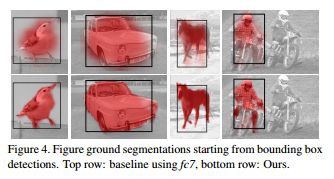

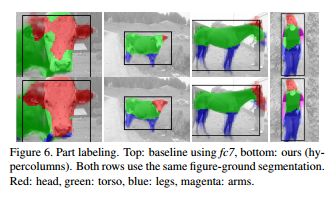

【Hypercolumns for Object Segmentation and Fine-Grained Localizatio】

利用Hypercolumn进行目标分割和精细定位

(Ross Girshick, Jitendra Malik)

一个像素定义一个hypercolumn,表示vector of activations of all CNN units above that pixel.

分割结果既有高层语义,又精细。

给定BBOX,做目标分割。

给定BBOX,检测左手腕。

给定BBOX,分割头、躯干、腿、胳膊。

【Modeling Local and Global Deformations in Deep Learning: Epitomic Convolution, Multiple Instance Learning, and Sliding Window Detection】

深度学习中局部和全局形变的建模

(Google, INRIA)

传统DCNN用max-pooling对抗目标的平移和形变。

本文使用另一种方法:用epitomic(表率) convolution来模拟形变,用Multiple Instance Learning来学习不同位置和尺度。

【Going Deeper With Convolutions】

更深的卷积网络

(Google)

对DCNN本身进行提高,集中在优化利用计算资源。在ImageNet 2014(ILSVRC)比赛中第一名。

给出了GooLeNet的具体架构图。

【Understanding Image Representations by Measuring Their Equivariance and Equivalence】

通过Equivariance和Equivalence理解图像表达

从数学角度探讨HOG特征和CNN“为什么好使”。

Equivariance: 输入图像时如何被特征表达的

Invariance: 对输入做何种变化时,特征保持不变

Equivalence: 两种不同的特征表达,是否能表达同一种输入。

【Deep Neural Networks Are Easily Fooled: High Confidence Predictions for Unrecognizable Images】

欺骗深度神经网络

(Google)

以DNN的输出作为评分,用遗传算法合成一系列“似是而非”的图像。在DNN中获得高分,但根本不是此类图片。

D1-AM-B. Depth and 3D Surface