Yolo V2训练自己数据集

在参照了很多其他的博客,成功训练了自己的数据集,这里记录一下防止忘记便于以后总结学习。

VOC数据集准备

准备数据

首先准备好自己的数据集,最好固定格式,此处以VOC为例,采用jpg格式的图像,在名字上最好使用像VOC一样类似I000001.jpg、I000002.jpg这样。可参照下面示例代码,在Opencv中使用。

// Getfile.cpp : 重命名文件夹内的所有图像并写入txt,同时也可通过重写图像修改格式

//配用Opencv2.4.10

#include "stdafx.h"

#include

#include

#include

#include

#define IMGNUM 20000 //图片所在文件夹中图片的最大数量

char img_files[IMGNUM][1000];

using namespace cv;

int getFiles(char *path)

{

int num_of_img = 0;

long hFile = 0;

struct _finddata_t fileinfo;

char p[700] = { 0 };

strcpy(p, path);

strcat(p, "\\*");

if ((hFile = _findfirst(p, &fileinfo)) != -1)

{

do

{

if ((fileinfo.attrib & _A_SUBDIR))

{

if (strcmp(fileinfo.name, ".") != 0 && strcmp(fileinfo.name, "..") != 0)

continue;

}

else

{

strcpy(img_files[num_of_img], path);

strcat(img_files[num_of_img], "\\");

strcat(img_files[num_of_img++], fileinfo.name);

}

} while (_findnext(hFile, &fileinfo) == 0);

_findclose(hFile);

}

return num_of_img;

}

int main()

{

char path[] = "SrcImage"; //source image

char dstpath[] = "DstImage"; //destination image

int num = getFiles(path);

int i;

char order[1000];

FILE *fp = fopen("train.txt", "w");

for (i = 0; i 读取某一个文件下所有的图片(该文件下的图片命名是不统一的),输出该文件夹图片到一个目标文件下,且对目标文件下所有的图片统一命名,并修改所有图片的格式,将名字写入到txt中。

准备好了自己的图像后,需要VOC数据集的结构放置图像文件,VOC的结构如下:

--VOCdevkit

--Annotations

--ImageSets

--Main

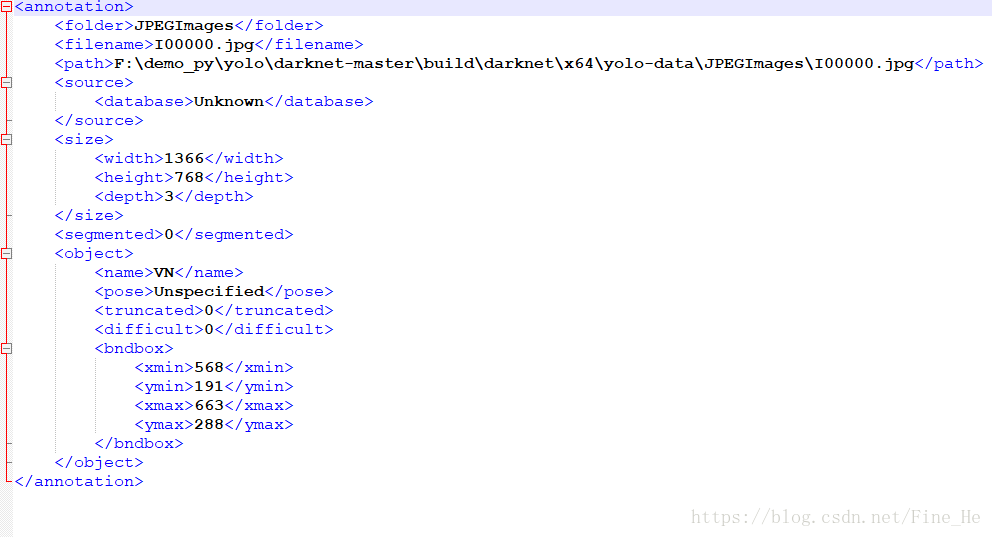

--JPEGImages 这里面用到的文件夹是Annotation、ImageSets和JPEGImages。其中文件夹Annotation中主要存放xml文件,每一个xml对应一张图像,并且每个xml中存放的是标记的各个目标的位置和类别信息,命名通常与对应的原始图像一样;在ImageSets文件夹下的Main文件夹,这里面存放文本文件,通常为train.txt、test.txt等,该文本文件里面的内容是需要用来训练或测试的图像的名字(无后缀无路径);JPEGImages文件夹中放我们已按统一规则命名好的原始图像。

因此,构建上述文件夹结构。

1.新建文件夹VOCdevkit(可以用其他命名,我用的是yolo-data)

2.在VOCdevkit文件夹(yolo-data)下新建三个文件夹Annotation、ImageSets和JPEGImages,并把准备好的自己的原始图片放在JPEGImages文件夹下

3.在ImageSets文件夹中,新建空文件夹Main,然后把写了训练或测试的图像的名字的文本拷到Main文件夹下,这里只做demo之用,为了方便,把所有图像用来训练,在Main文件夹下只有train.txt文件。上面的代码运行后会生成该文件,copy进去即可。

标记图像目标区域

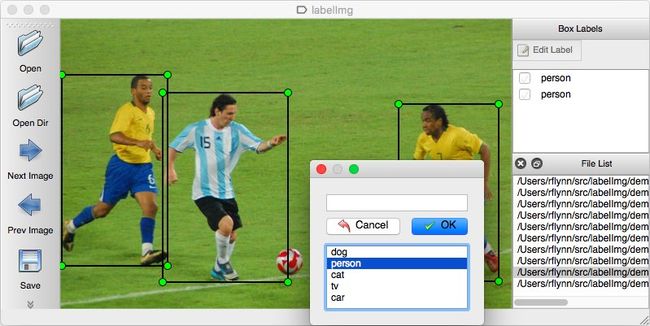

因为做的是目标检测,所以接下来需要标记原始图片中目标区域(待检测区域)。用的是Python版本的labeling工具,GitHub上搜labeling就能找到。基本就是框住目标区域然后双击类别,标记完整张图像后点击保存即可,有Markdown说明。操作界面如下:

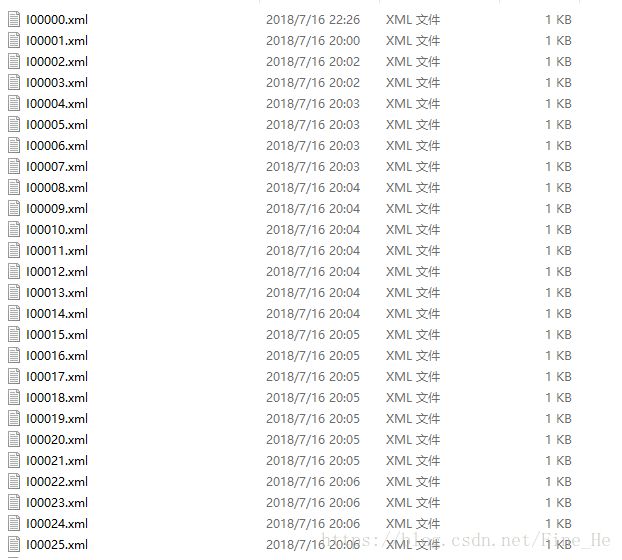

通常save之后会将标记的信息保存在xml文件,其名字通常与对应的原始图像一样(每个xml里面的内容为下图,xml生成过程中,master版本的好像要出错,生成的xml文件,第10行和第11行会为0,安装py2-qt4版本后,在标记过程中,还是查看下xml文件看下第10和11行是否非0)。

用Yolov2训练

生成相关文件

首先需要修改voc_label.py中的代码,这里主要修改数据集名,以及类别信息,我所有样本用来训练,没有val或test,只检测一类目标,因此按如下设置:

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import join

#sets=[('2012', 'train'), ('2012', 'val'), ('2007', 'train'), ('2007', 'val'), ('2007', 'test')]

#classes = ["aeroplane", "bicycle", "bird", "boat", "bottle", "bus", "car", "cat", "chair", "cow", "diningtable", "dog", "horse", "motorbike", "person", "pottedplant", "sheep", "sofa", "train", "tvmonitor"]

sets=[('2018','train')]

classes=["VN"]

def convert(size, box):

dw = 1./size[0]

dh = 1./size[1]

x = (box[0] + box[1])/2.0

y = (box[2] + box[3])/2.0

w = box[1] - box[0]

h = box[3] - box[2]

x = x*dw

w = w*dw

y = y*dh

h = h*dh

return (x,y,w,h)

def convert_annotation(year, image_id):

in_file = open('Annotations/%s.xml'%( image_id))

out_file = open('labels/%s.txt'%( image_id), 'w')

tree=ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text))

bb = convert((w,h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for year, image_set in sets:

if not os.path.exists('labels/'):

os.makedirs('labels/')

image_ids = open('ImageSets/Main/%s.txt'%(image_set)).read().strip().split()

list_file = open('%s_%s.txt'%(year,image_set),'w')

for image_id in image_ids:

list_file.write('%s/JPEGImages/%s.jpg\n'%(wd, image_id))

convert_annotation(year, image_id)

list_file.close()修改后再改目录下运行命令:python voc_label.py,之后就在yolo-data下生成labels文件夹,里面包含的是类别和坐标位置。同时在该文件夹下还生成了2018_train.txt文件,里面包含了 所有训练样本的绝对路径。

配置文件修改

做好了上述准备,就可以根据不同的网络设置(cfg文件)来训练了。在文件夹cfg中有很多cfg文件,根据自己的需要选择修改cfg。这里以yolov2-tiny-voc.cfg为例。主要修改参数如下:

[convolutional]

size=1

stride=1

pad=1

filters=30 //修改最后一层卷积层核参数个数,计算公式是依旧自己数据的类别数filter=num×(classes + coords + 1)=5×(1+4+1)=30

activation=linear

[region]

anchors = 1.08,1.19, 3.42,4.41, 6.63,11.38, 9.42,5.11, 16.62,10.52

bias_match=1

classes=1 //类别数,本例为1类

coords=4

num=5

softmax=1

jitter=.2

rescore=1

object_scale=5

noobject_scale=1

class_scale=1

coord_scale=1

absolute=1

thresh = .6

random=1 另外也可根据需要修改learning_rate、max_batches等参数。修改好了cfg文件之后,就需要修改两个文件,首先是yolo-data文件下的voc.names。打开voc.names文件可以看到有20类的名称,本例中只有一类目标,因此将原来所有内容清空,仅写上labeling时的类别名称并保存。如果喜欢用其他名字则请按一开始制作自己数据集的时候的名字来修改。 接着需要修改voc.data文件,根据自己的实际目录来改:

classes= 1

train = F:/demo_py/yolo/darknet-master/build/darknet/x64/yolo-data/2018_train.txt //训练样本的绝对路径,上面py生成的

valid = F:/demo_py/yolo/darknet-master/build/darknet/x64/yolo-data/2018_test.txt

names = F:/demo_py/yolo/darknet-master/build/darknet/x64/yolo-data/hero.names //voc.names文件

backup = F:/demo_py/yolo/darknet-master/build/darknet/x64/yolo-data/backup/ //训练生成的权重开始训练

相关设置完成后,就可以训练了。可以选择预训练模型作为参数初始值,去GitHub上 可以找到预训练的模型。训练指令为:

darknet.exe detector train yolo-data/hero.data yolo-data/yolov2-tiny.cfg yolo-data/yolov2-tiny.weights也可以直接训练

darknet.exe detector train yolo-data/hero.data yolo-data/yolov2-tiny.cfg 训练完成后就可以拿输出的训练模型测试了,将图片放在yolo-data文件夹下

darknet.exe detector test yolo-data/hero.data yolo-data/yolov2-tiny.cfg yolo-data/backup/yolov2-tiny_419000.weights yolo-data/test.jpg