【TensorFlow】知识点PICK,顺便作为毕设的小点汇总

-

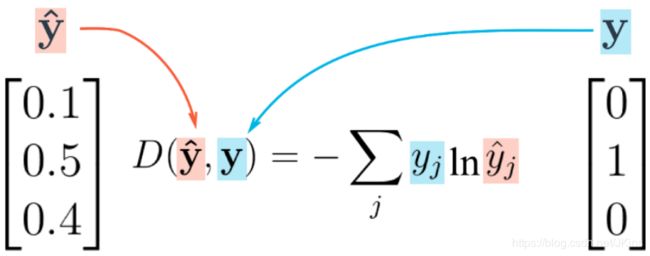

多分类使用 softmax 分类器

e k ∑ j = 0 n e ( k j ) \frac{e^k}{\sum_{j=0}^n{e^(k_j)}} ∑j=0ne(kj)ek

某个元素除以每个元素求e指数的和

x = tf.nn.softmax([对应元素])

import tensorflow as tf

softmax_data = [0.7, 0.2, 0.1]

one_hot_data = [1.0, 0.0, 0.0]

softmax = tf.placeholder(tf.float32)

one_hot = tf.placeholder(tf.float32)

# TODO: Print cross entropy from session

cross_entroy = -tf.reduce_sum(tf.multiply(one_hot, tf.log(softmax)))

with tf.Session() as sess:

output = sess.run(cross_entroy, feed_dict={one_hot:one_hot_data, softmax:softmax_data})

print(output)

注:原稿来自“徐小妹”,https://blog.csdn.net/weixin_41770169

因为文章主要是自用加整理,也就不太关注这个啦