深度强化学习-Actor-Critic算法原理和实现

在之前的几篇文章中,我们介绍了基于价值Value的强化学习算法Deep Q Network。有关DQN算法以及各种改进算法的原理和实现,可以参考之前的文章:

实战深度强化学习DQN-理论和实践:https://www.jianshu.com/p/10930c371cac

DQN三大改进(一)-Double DQN:https://www.jianshu.com/p/fae51b5fe000

DQN三大改进(二)-Prioritised replay:https://www.jianshu.com/p/db14fdc67d2c

DQN三大改进(三)-Dueling Network:https://www.jianshu.com/p/b421c85796a2

基于值的强化学习算法的基本思想是根据当前的状态,计算采取每个动作的价值,然后根据价值贪心的选择动作。如果我们省略中间的步骤,即直接根据当前的状态来选择动作。

在强化学习中,还有另一种很重要的算法,即策略梯度(Policy Gradient)。之前我们已经介绍过策略梯度的基本思想和实现了,大家可以有选择的进行预习和复习:

深度强化学习-Policy Gradient基本实现:https://www.jianshu.com/p/2ccbab48414b

本文介绍的Actor-Critic算法呢,就是结合了上面两种算法的基本思想而产生的,什么是Actor?什么是Critic?二者是如何结合的,通过这篇文章,我们来一探究竟。

本篇文章的大部分内容均学习自莫烦老师的强化学习课程,大家可以在b站上找到相关的视频:https://www.bilibili.com/video/av16921335/#page=22

1、Actor-Critic算法原理

我们为什么要有Actor-Critic呢,下面的话摘自莫烦老师的文章:

我们有了像 Q-learning这么伟大的算法, 为什么还要瞎折腾出一个 Actor-Critic? 原来 Actor-Critic 的 Actor 的前生是 Policy Gradients, 这能让它毫不费力地在连续动作中选取合适的动作, 而 Q-learning 做这件事会瘫痪. 那为什么不直接用 Policy Gradients 呢? 原来 Actor Critic 中的 Critic 的前生是 Q-learning 或者其他的 以值为基础的学习法 , 能进行单步更新, 而传统的 Policy Gradients 则是回合更新, 这降低了学习效率.

上面的一段话不仅解释了为什么会有Actor-Critic这么一个算法,同时也告诉了我们,这个算法具体是怎么做的。如果大家已经心中有数并且想马上看代码的话,这一段是可以直接跳过的。既然Actor其实是一个Policy Network ,那么他就需要奖惩信息来进行调节不同状态下采取各种动作的概率,在传统的Policy Gradient算法中,这种奖惩信息是通过走完一个完整的episode来计算得到的。这不免导致了学习速率很慢,需要很长时间才可以学到东西。既然Critic是一个以值为基础的学习法,那么他可以进行单步更新,计算每一步的奖惩值。那么二者相结合,Actor来选择动作,Critic来告诉Actor它选择的动作是否合适。在这一过程中,Actor不断迭代,得到每一个状态下选择每一动作的合理概率,Critic也不断迭代,不断完善每个状态下选择每一个动作的奖惩值。

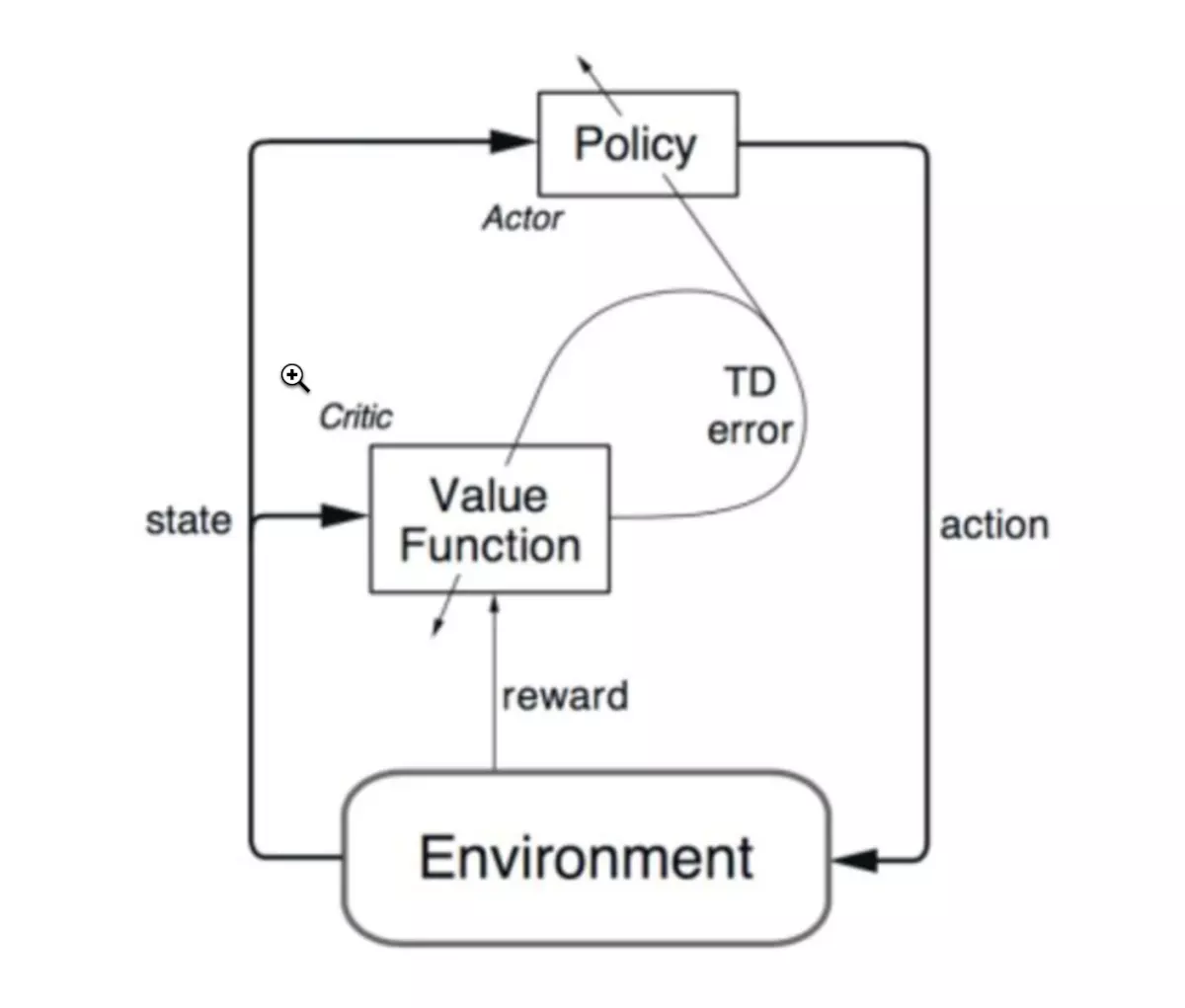

下图就简单的介绍了Actor-Critic算法的流程:

但Actor-Critic并不是一个完善的算法, 后面还会提到进一步的改进:

Actor-Critic 涉及到了两个神经网络, 而且每次都是在连续状态中更新参数, 每次参数更新前后都存在相关性, 导致神经网络只能片面的看待问题, 甚至导致神经网络学不到东西。

2、代码解析

本文的github地址为:https://github.com/princewen/tensorflow_practice/tree/master/Basic-Actor-Critic

2.1 Actor

定义Actor输入

在这里,由于我们的Actor可以进行单次训练,所以我们的输入只需要是一个状态,一个动作和一个奖励:

self.s = tf.placeholder(tf.float32,[1,n_features],name='state')

self.a = tf.placeholder(tf.int32,None,name='act')

self.td_error = tf.placeholder(tf.float32,None,"td_error")

Actor的网络定义

Actor的神经网络结构和我们的Policy Gradient定义的是一样的,是一个双层的全链接神经网络:

with tf.variable_scope('Actor'):

l1 = tf.layers.dense(

inputs = self.s,

units = 20,

activation = tf.nn.relu,

kernel_initializer = tf.random_normal_initializer(mean=0,stddev=0.1),

bias_initializer = tf.constant_initializer(0.1),

name = 'l1'

)

self.acts_prob = tf.layers.dense(

inputs = l1,

units = n_actions,

activation = tf.nn.softmax,

kernel_initializer = tf.random_normal_initializer(mean=0,stddev=0.1),

bias_initializer = tf.constant_initializer(0.1),

name = 'acts_prob'

)

损失函数

损失函数还是使用的Policy Gradient中提到过的loss= -log(prob)*vt,只不过这里的vt换成了由Critic计算出的时间差分误差td_error

with tf.variable_scope('exp_v'):

log_prob = tf.log(self.acts_prob[0,self.a])

self.exp_v = tf.reduce_mean(log_prob * self.td_error)

with tf.variable_scope('train'):

self.train_op = tf.train.AdamOptimizer(lr).minimize(-self.exp_v)

Actor训练

Actor的训练只需要将状态,动作以及时间差分值喂给网络就可以。

def learn(self,s,a,td):

s = s[np.newaxis,:]

feed_dict = {self.s:s,self.a:a,self.td_error:td}

_,exp_v = self.sess.run([self.train_op,self.exp_v],feed_dict=feed_dict)

return exp_v

选择动作

选择动作和Policy Gradient一样,根据计算出的softmax值来选择动作

def choose_action(self,s):

s = s[np.newaxis,:]

probs = self.sess.run(self.acts_prob,feed_dict={self.s:s})

return np.random.choice(np.arange(probs.shape[1]),p=probs.ravel())

2.2 Critic

定义Critic输入

Critic要反馈给Actor一个时间差分值,来决定Actor选择动作的好坏,如果时间差分值大的话,说明当前Actor选择的这个动作的惊喜度较高,需要更多的出现来使得时间差分值减小。

考虑时间差分的计算:

TD = r + gamma * f(s') - f(s),这里f(s)代表将s状态输入到Critic神经网络中得到的Q值。

所以Critic的输入也分三个,首先是当前状态,当前的奖励,以及下一个时刻的奖励折现值。为什么没有动作A呢?动作A是确定的呀,是Actor选的呀,对不对!还有为什么不是下一时刻的Q值而不是下一个时刻的状态,因为我们已经在计算TD时已经把状态带入到神经网络中得到Q值了。相信你看代码就明白了。

self.s = tf.placeholder(tf.float32,[1,n_features],name='state')

self.v_ = tf.placeholder(tf.float32,[1,1],name='v_next')

self.r = tf.placeholder(tf.float32,None,name='r')

定义网络结构

同Actor一样,我们的Critic也是一个双层的神经网络结构。

with tf.variable_scope('Critic'):

l1 = tf.layers.dense(

inputs = self.s,

units = 20,

activation = tf.nn.relu,

kernel_initializer = tf.random_normal_initializer(0,0.1),

bias_initializer = tf.constant_initializer(0.1),

name = 'l1'

)

self.v = tf.layers.dense(

inputs = l1,

units = 1,

activation = None,

kernel_initializer=tf.random_normal_initializer(0,0.1),

bias_initializer = tf.constant_initializer(0.1),

name = 'V'

)

定义损失

Critic的损失定义为时间差分值的平方值

with tf.variable_scope('squared_TD_error'):

self.td_error = self.r + gamma * self.v_ - self.v

self.loss = tf.square(self.td_error)

with tf.variable_scope('train'):

self.train_op = tf.train.AdamOptimizer(lr).minimize(self.loss)

训练Critic

Critic的任务就是告诉Actor当前选择的动作好不好,所以我们只要训练得到TD并返回给Actor就好:

def learn(self,s,r,s_):

s,s_ = s[np.newaxis,:],s_[np.newaxis,:]

v_ = self.sess.run(self.v,feed_dict = {self.s:s_})

td_error,_ = self.sess.run([self.td_error,self.train_op],

feed_dict={self.s:s,self.v_:v_,self.r:r})

return td_error

2.3 整体模型训练

有了Critic之后,Actor就可以进行单步训练和更新了,所以训练中的关键的代码如下:

while True:

a = actor.choose_action(s)

s_,r,done,info = env.step(a)

td_error = critic.learn(s,r,s_)

actor.learn(s,a,td_error)

s = s_

3.参考资料

- https://morvanzhou.github.io/tutorials/machine-learning/reinforcement-learning/6-1-actor-critic/