HBase应用(一):数据批量导入说明

版本说明:

通过 HDP 3.0.1 安装的 HBase 2.0.0

一、概述

HBase 本身提供了很多种数据导入的方式,目前常用的有三种常用方式:

- 使用 HBase 原生 Client API

- 使用 HBase 提供的 TableOutputFormat,原理是通过一个 Mapreduce 作业将数据导入 HBase

- 使用 Bulk Load 方式:原理是使用 MapReduce 作业以 HBase 的内部数据格式输出表数据,然后直接将生成的 HFile 加载到正在运行的 HBase 中。

二、方式对比

**前两种方式:**需要频繁的与数据所存储的 RegionServer 通信,一次性导入大量数据时,可能占用大量 Regionserver 资源,影响存储在该 Regionserver 上其他表的查询。

**第三种方式:**了解过 HBase 底层原理的应该都知道,HBase 在 HDFS 中是以 HFile 文件结构存储的,一个比较高效便捷的方法就是先生成 HFile,再将生成的 HFile 加载到正在运行的 HBase 中。即使用 HBase 提供的 HFileOutputFormat2 类或者 importtsv 工具来完成上述操作。

经过对比得知:如果数据量很大的情况下,使用第三种方式(Bulk Load)更好。占用更少的 CPU 和网络资源就实现了大数据量的导入。本篇文章也将主要介绍 Bulk Load 方式。

三、Bulk Load 说明

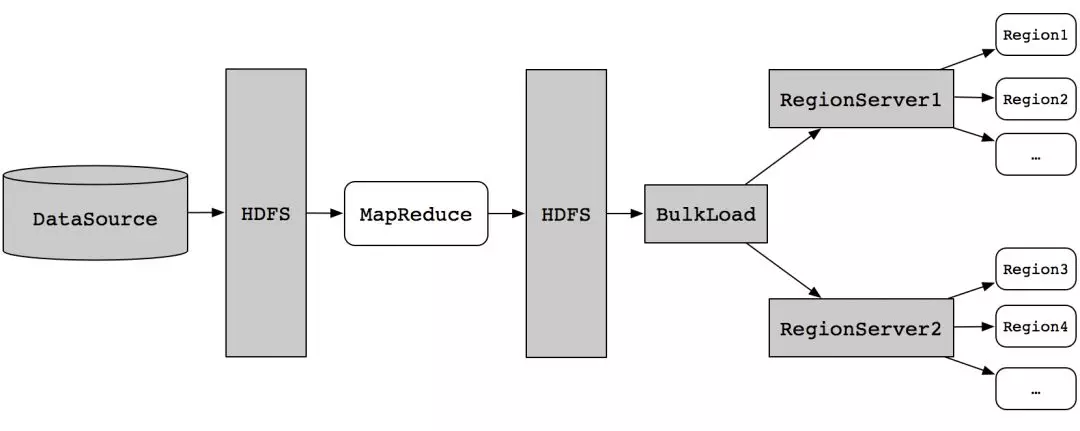

Bulk Load 方式之所以高效,是因为绕过了正常写数据的路径(WAL、MemStore、flush)。总的来说,Bulk Load 方式使用 MapReduce 作业以 HBase 的内部数据格式输出表数据,然后直接将生成的 HFiles 加载到正在运行的 HBase 中。与仅使用 HBase API 相比,使用 Bulk Load 方式不占用 Region 资源,不会产生巨量的写入 I/O,将使用更少的 CPU 和网络资源。

HBase Bulk Load 过程包括两个主要步骤:

- 将 准备的数据 生成 HFile :使用 importtsv 工具将数据转化为 HFile ,或者通过 HBase 提供的 HFileOutputFormat2 类编写 MapReduce 程序。

- 将 HFile 导入到 HBase 中:使用 LoadIncrementalHFiles 或者 completebulkload 将 HFile 导入到 HBase中。

流程如下图所示:

3.1 将准备的数据生成HFile

将数据生成 HFile,有两种方式,分别是:

- 通过 HBase 提供的 HFileOutputFormat2 类编写 MapReduce 程序来生成 HFile 。(本篇文章不扩展)

- 使用 importtsv 工具将 TSV 格式数据转换为 HFile ,自动生成 MapReduce 任务。

本篇文章主要还是讲解下 importtsv 工具的使用,编写 MapReduce 程序在本篇不扩展,后续文章会有补充。

importtsv 是一个实用工具,它将 TSV 格式的数据加载到 HBase 中。它有两种用法,分别为:

- importtsv 工具默认使用 HBase put API 导入数据,将数据从 HDFS 中的 TSV 格式直接加载到 HBase 的 MemStore 中。非 Bulk Load 方式,比较占用集群资源,不建议在处理大数据量时使用。

hbase org.apache.hadoop.hbase.mapreduce.ImportTsv -Dimporttsv.columns=a,b,c <tablename> <hdfs-inputdir>

- Bulk Load 方式,当使用选项 -Dimporttsv.bulk.output 时,将会先生成 HFile 文件的内部格式的文件,这时并不会写数据到 HBase 中。建议使用 √

hbase org.apache.hadoop.hbase.mapreduce.ImportTsv -Dimporttsv.columns=a,b,c -Dimporttsv.bulk.output=hdfs://storefile-outputdir <tablename> <hdfs-data-inputdir>

注意:使用 importtsv -Dimporttsv.bulk.output 选项时,如果目标表尚不存在,则将使用默认列族描述符创建目标表。如果准备了大量数据要进行Bulk Load,请确保对目标 HBase 表进行适当的预分区,也就是预先创建多个 Region ,避免热点与数据倾斜问题。

importtsv 可以使用 -D 指定的其他选项,以下列举了11条:

- -Dimporttsv.skip.bad.lines=true / false :在导入过程中,如果有不符合分割标准的行,被称之为 badlines ,设置是否跳过,如果不跳过,则 MapReduce 任务停止。

- -Dimporttsv.separator=’|’ :例如使用 管道符 来代替 tab 键(\t),importtsv 默认是以 tab 键分隔。

- -Dimporttsv.timestamp=currentTimeAsLong :使用特殊的时间戳导入。

- -Dimporttsv.mapper.class=my.Mapper :用户定义的Mapper代替org.apache.hadoop.hbase.mapreduce.TsvImporterMapper。

- -Dmapreduce.job.name=jobName :用户指定 MapReduce 任务名称

- -Dmapreduce.job.queuename=queue:指定作业提交到的队列名

- -Dmapreduce.job.priority=VERY_HIGH / HIGH / NORMAL / LOW / VERY_LOW :指定作业的优先级

- -Dcreate.table=yes / no :如果 HBase 中没有创建表,是否使用 importtsv 工具创建该表,如果设置为 no,则在 HBase 中表必须存在。

- -Dno.strict=true / false :忽略 HBase 表中的列族检查,默认为 false 。

- -Dmapreduce.map/reduce.memory.mb=5120 :map / reduce 端分配的内存大小,一般来说是 1024 的倍数,这里配置了 5G。

- -Dmapreduce.map/reduce.java.opts=-Xmx4096m :指定 map / reduce 端的 JVM 参数,这个的大小一般是上一个参数的 0.75 倍,要剩一些内存给非 JVM 进程。

尽管 importtsv 工具在许多情况下很有用,但高级用户可能希望以编程方式生成数据,或使用其他格式导入数据。如果有这样的需求,请深入了解 ImportTsv.java 和 HFileOutputFormat 的 JavaDoc ,修改源码进行实现。

3.2 完成数据加载,将HFile加载到HBase中

completebulkload 工具用于将数据导入正在运行的 HBase 中。此命令行工具遍历准备好的数据文件(HFile),确定每个 HFile 所属的 Region,然后联系相应的 RegionServer 将 HFile 移入其存储目录并将数据供客户端使用。

如果在 Bulk Load 准备过程中或在准备和完成步骤之间 Region 边界已更改,则 completebulkload 工具会自动将 HFile 拆分为与新边界对应的部分。此过程效率不高,因此用户应尽量减少 准备 HFile 与 将 HFile 加载到 HBase 中 这两步骤之间的时间延迟,尤其是在其他客户端通过其他方式同时加载数据时也要注意。

将 HFile 加载到 HBase 中有两种方式:

- LoadIncrementalHFiles

hbase org.apache.hadoop.hbase.tool.LoadIncrementalHFiles <hdfs://storefileoutput> <tablename>

- completebulkload

export HBASE_HOME=/usr/hdp/{hdp-version}/hbase

HADOOP_CLASSPATH=`${HBASE_HOME}/bin/hbase classpath` ${HADOOP_HOME}/bin/hadoop jar ${HBASE_HOME}/lib/hbase-mapreduce-{version}.jar completebulkload <hdfs://storefileoutput> <tablename>

四、示例

说一下我的运行环境:CentOS-7,1个 HBase Master,3个 RegionServer,三台机器均是 8G 内存。

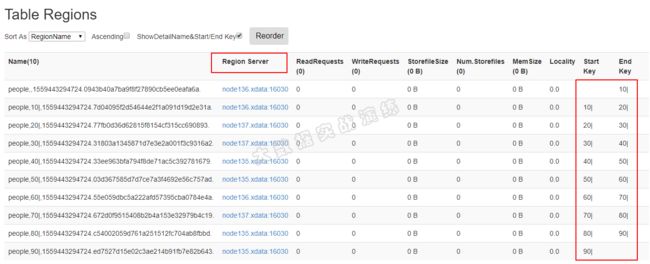

4.1 创建表的同时创建10个分区

create 'default:people', {NAME=>'basic_info'}, {NAME=>'other_info'}, SPLITS=>['10|','20|','30|','40|','50|','60|','70|','80|','90|']

创建的 people 表如下所示:

4.2 准备数据源并上传到HDFS

用 Python 生成了10万条测试数据并存到了 hbase_data.txt 中,一共7.32M,现在将该文件上传到 HDFS 中:

sudo -u hdfs hdfs dfs -put /tmp/hbase_data.txt /tmp

测试数据是我用python写的,有详细的说明和源码,详情点击:Python生成HBase测试数据说明 。

4.3 通过importtsv工具生成HFile文件

使用 importtsv 工具生成 HFile 文件,执行如下命令:

sudo -u hdfs hbase org.apache.hadoop.hbase.mapreduce.ImportTsv -Dimporttsv.separator=',' -Dimporttsv.columns='HBASE_ROW_KEY,basic_info:name,basic_info:age,basic_info:sex,basic_info:edu,other_info:telPhone,other_info:email,other_info:country' -Dimporttsv.bulk.output=/tmp/people/output people /tmp/hbase_data.txt

请确保执行该命令的用户有相应的权限。后台会触发一个 MapReduce 任务,由于表中创建了 10 个 Region,所以触发的任务内有 1 个 map,10 个 reduce,该任务一共执行了2分45秒。

4.4 将HFile数据加载到HBase中

两种方式:

- LoadIncrementalHFiles

sudo -u hdfs hbase org.apache.hadoop.hbase.mapreduce.LoadIncrementalHFiles /tmp/people/output people

执行上述语句总时长大约26秒。

- completebulkload

export HBASE_HOME=/usr/hdp/3.0.1.0-187/hbase

sudo -u hdfs HADOOP_CLASSPATH=`${HBASE_HOME}/bin/hbase classpath` ${HADOOP_HOME}/bin/hadoop jar ${HBASE_HOME}/lib/hbase-mapreduce-2.0.0.3.0.1.0-187.jar completebulkload /tmp/people/output people

小结:上述两种方式均可以实现将 HFile 数据导入到 HBase 中,其原理就是将 HFile 移动到 HBase 表的对应目录下存储。

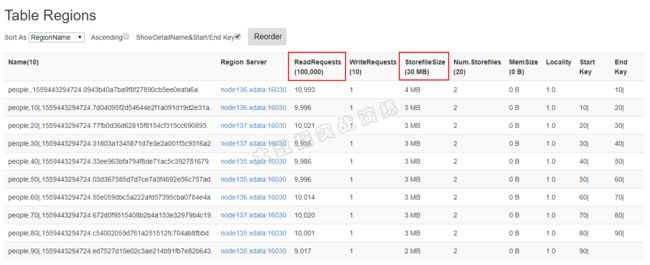

在 hbase shell 里执行 scan ‘people’ ,将所有数据读取一遍,我们再通过 HBase Web UI ,查看 people 表的各 region 的详细情况。如下图所示:

由表分析可知,10万条 数据 较均匀地 分配到了 10 个 Region 中。自此,数据批量导入到 HBase 中完毕!

五、总结

参考的 HBase 官网:

- http://hbase.apache.org/book.html#arch.bulk.load

- http://hbase.apache.org/book.html#importtsv

- http://hbase.apache.org/book.html#completebulkload

在使用 importtsv 工具时,一定要注意参数 -Dimporttsv.bulk.output 的配置。通常来说使用 Bulk Load Data 的方式对 RegionServer 来说更加友好一些,这种方式加载数据几乎不占用 RegionServer 的计算资源,因为只是在 HDFS上 移动了 HFile 文件,然后通知 HMaster 将该 RegionServer 的一个或多个 Region 上线。

另外在进行 Bulk Load 时,也需要确保执行用户在HDFS上有相应的权限。

我将 HBase 数据导入常用的三种方式进行了总结,其中着重说明了一下 Bulk Load 方式,如下图所示: