20189224 2018-2019-2 《密码与安全新技术专题》第三次作业

课程:《密码与安全新技术专题》

班级:1892班

姓名:史馨怡

学号:20189224

上课教师:金鑫

上课日期:2019年3月26日

必修/选修:选修

1.本次讲座的学习总结

主题:基于深度学习的密码分析与设计初探

技术背景

- 对抗学习及相关话题:

对抗攻击:通过设计一种有针对性的数值型向量从而让机器学习模型做出误判被称为对抗性攻击,对抗攻击根据攻击者掌握机器学习模型信息的多少可分为百盒攻击和黑盒攻击

1)针对机器学习模型和算法的对抗攻击

2)检测针对机器学习模型和算法的对抗攻击

3)增强针对对抗攻击的机器学习模型和算法的鲁棒性

4)深度学习系统的安全

5)在线学习

6)自适应侧信道攻击

7)方法和基础真值获取

- 基于人工智能和机器学习的安全应用(AI使安全更智能)

1)计算机取证

2)垃圾邮件检测

3)用户认证

4)网络钓鱼检测和预防僵尸网络检测

5)入侵检测和响应

6)异常行为检测

7)恶意软件识别

8)数据匿名化/去匿名化社交网络中的安全性

9)安全性的大数据分析

- 人工智能相关的安全问题(安全使AI更安全)

1)分布式推理和安全决策

2)安全多方计算和加密方法

3)保护隐私的数据挖掘

4)差异隐私

5)通过智能探测进行漏洞测试(例如模糊测试)

6)用于生成训练和测试集的技术和方法

主要内容

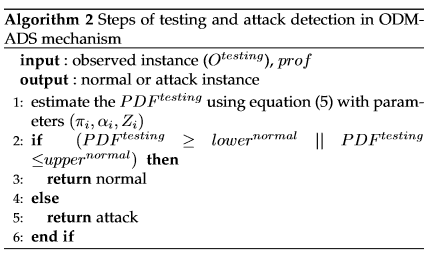

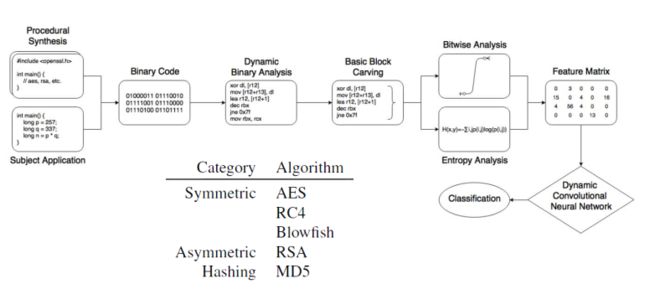

一.密码分析与机器学习

机器学习模型:

样本x--------------模型(函数fx)---------------标注y

密码分析模型:

明文x--------------密钥(函数fx)---------------密文y

密码分析与机器学习之间相似,在密码分析中,攻击者试图通过推算出密钥来破解密码系统,而在机器学习中研究人员试图从多个样本与标签配对来进行机器学习模型的求解(训练)。

- 密码学领域的三大顶级学术会议 :

美 密 会 ( CRYPTO ) 、 欧 密 会 ( EUROCRYPTO ) 、 亚 密 会( ASIACRYPTO) - 机器学习领域的几大重要国际会议:

COLT、NIPS、 IEEE FOCS、 ACM STOC

- 研究趋势发展:越来越多的密码分析方法开始使用机器学习技术

1)用于破解DES的遗传算法

2)用于侧信道分析的支撑向量机算法

虽然主要的密码系统的算法仍然难以破解,然而机器学习算法通过分析网络流已经取得了很大的进步。

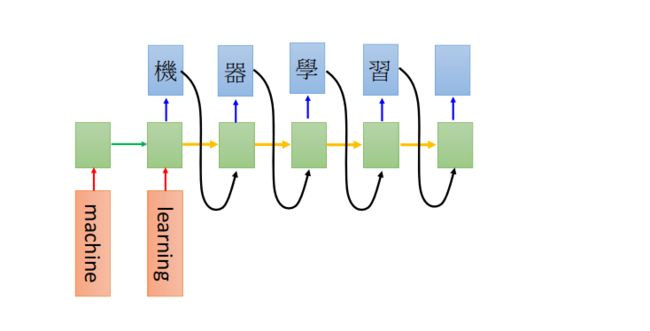

二.深度学习简介与现状

深度学习:深度学习的概念源于人工神经网络的研究。含多隐层的多层感知器就是一种深度学习结构。深度学习通过组合低层特征形成更加抽象的高层表示属性类别或特征,以发现数据的分布式特征表示

- 深度学习四大天王

深度神经网络:

1)卷积神经网络( CNN: Convolutional NeuralNetworks)

2)循环神经网络( RNN: Recurrent Neural Networks)

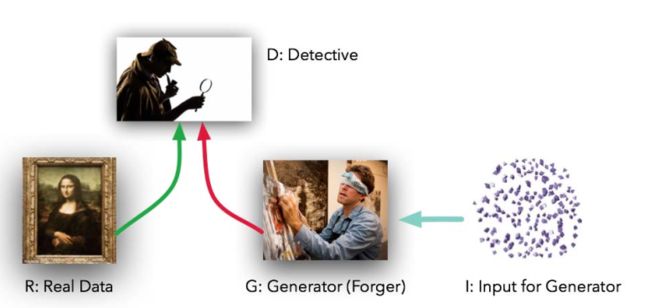

3)生成对抗网络( GAN: Generative Adversarial Networks)深度学习发展情况

1)2012年前深度学习发展历史简介

2)借用一种前所未有,深度高达152层的神经网络系统,2015年挑战赛上微软亚洲研究院研究团队的的错误率已经低至3.57%。2015年神经网络系统应用深度学习应用实例

1)人体分割

2)姿势识别

3)人脸分割与自动上妆

4)视觉问答

5)阿法狗

6)攻陷Dota2

7)验证码破解

8)考试监控作弊行为发现

9)图像美感自动发现三.深度学习与密码分析

(1)基于卷积神经网络的侧信道攻击

(2)基于循环神经网络的明文破译

(3)基于生成对抗网络的口令破解

(4)基于深度神经网络的密码基元识别

四.深度学习与密码设计

"量子计算技术快速发展对密码技术产生极大的威胁和挑战,一旦实用化量子计算出现,将导致基于离散对数、整数分解的公钥密码体制直接被快速攻破,意味着当前所使用的网络信息系统不再安全。为应对此颠覆式威胁,美国和欧洲已经启动了抗量子计算攻击的密码算法标准化工作。”

通信安全

计算安全 建立安全的开放融合网络环境 物联网环境下协作通信处理安全需求

存储安全-------------------------------------->云计算环境下协作通信处理安全需求

密钥建立和认证 量子计算技术发展对密码的安全

密码资源保护

| |

| |

| |

机器自动设计算法?

| |

| |

| |

2.学习中遇到的问题及解决

- 问题1:对抗攻击是什么?

- 问题1解决方案:

通过查阅资料得知,由于机器学习算法的输入形式是一种数值型向量(numeric vectors),所以攻击者就会通过设计一种有针对性的数值型向量从而让机器学习模型做出误判,这便被称为对抗性攻击。和其他攻击不同,对抗性攻击主要发生在构造对抗性数据的时候,之后该对抗性数据就如正常数据一样输入机器学习模型并得到欺骗的识别结果。在构造对抗性数据的过程中,无论是图像识别系统还是语音识别系统,根据攻击者掌握机器学习模型信息的多少,可以分为如下两种情况:(1)白盒攻击:攻击者能够获知机器学习所使用的算法,以及算法所使用的参数。攻击者在产生对抗性攻击数据的过程中能够与机器学习的系统有所交互。(2)黑盒攻击:攻击者并不知道机器学习所使用的算法和参数,但攻击者仍能与机器学习的系统有所交互,比如可以通过传入任意输入观察输出,判断输出 。

目前大部分主流对抗攻击直接针对于分类任务——欺骗基于CNN的分类器。但是由于对抗性威胁的严重性,目前针对对抗攻击的研究已经超越了分类/识别场景。在Threat of Adversarial Attacks on Deep Learning in Computer Vision: A Survey文中概述了以下分类应用领域之外的攻击深度神经网络的方法:(1)在自编码器和生成模型上的攻击(2)在循环神经网络上的攻击(3)深度强化学习上的攻击(4)在语义切割和物体检测上的攻击。

目前对抗攻击防御的方向主要有三个:(1)在学习过程中修改训练过程或者修改的输入样本。(2)修改网络,比如:添加更多层/子网络、改变损失/激活函数等。(3)当分类未见过的样本时,用外部模型作为附加网络。 - 问题2:目前将生成对抗网络应用于密码算法生成过程中面临的问题主要是什么?

- 问题2解决方案:

通过查阅资料【参考博客链接】得知,对抗网络的一个主要缺点是训练过程不稳定,从而影响其在密码算法生成上的应用。

(1)为了提高训练的稳定性,文献[Mirza M, Osindero S. Conditional generative adversarial nets[J]. arXiv preprint arXiv:1411.1784, 2014.]中提出了 Conditional Generative Adversarial Nets (CGAN),通过把无监督的GAN变成半监督或者有监督的模型来对训练过程稳定性进行改进。CGAN在生成模型和判别模型的建模中均引入了条件变量y,这里y可以是label或者其他数据形态,将y和GAN原有的输入合并成一个向量作为CGAN的输入。这个简单直接的改进被证明很有效,并广泛用于后续的相关工作中。CGAN的模型示意图如下:

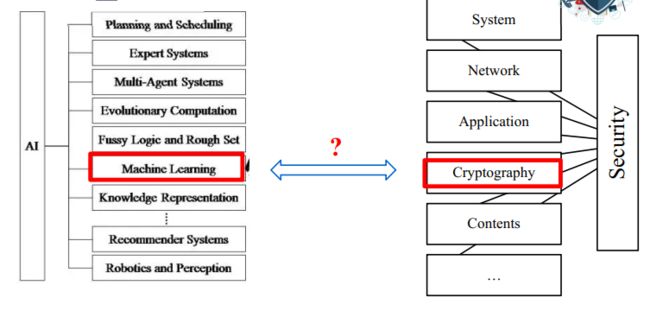

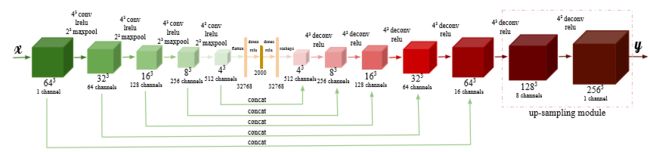

(2)文献[Radford A, Metz L, Chintala S. Unsupervised representation learning with deep convolutional generative adversarial networks[J]. arXiv preprint arXiv:1511.06434, 2015.]提出了一种Deep Convolutional Generative Adversarial Networks(DCGAN),将对抗网络与卷积神经网络相结合进行图片生成,DCGAN模型的结构如下:

3.本次讲座的学习感悟、思考

机器学习技术目前虽处于起步阶段,但已证明在许多行业中人工智能执行日常任务的效率是很高的,例如零售,制造,医疗保健,教育和网络安全。由于机器学习技术模型和加密技术模型有很大的相似之处,并且维护安全可靠的网络需要收集、组织和交叉检查每个网络连接设备的数据,而人工智能具有极高的处理速度和分析数百万个数据点的能力。因此,在未来人工智能将极大地帮助检测和响应最新的网络威胁。然而人工智能虽可以向我们提供安全技术,但我们也应该考虑网络犯罪分子同样也可以利用机器学习来发现潜在的漏洞并自动选择潜在的受害者,相同的技术可以帮助黑客有效地分析那些基于人工智能的网络防御系统,并帮助他们开发可以规避相应防御系统的新型恶意软件,我想未来的网络对抗可能就是AI技术的对抗。

在本次课前我对深度学习的理解就是建立在高性能处理器之上的类人类学习的方法,金老师的讲解中让我印象最深刻的就是深度学习算法在模型上和密码技术模型是很相似的,从系统的角度为我们进行了讲解,这使我认识到将所学知识抽象化模型化的重要性。

4.对抗学习最新研究现状

- Outlier Dirichlet Mixture Mechanism:Adversarial Statistical Learning for Anomaly Detection in the Fog[J].【文章链接】

IEEE Transactions on Information Forensics and Security, 2019, PP(99):1-1.

Moustafa N , Choo K K R , Radwan I , et al

研究进展:

目前大部分异常检测系统(ADS)应用统计和机器学习算法来对零日攻击进行检测,但这种算法容易受到高级持续威胁(APT)参与者的攻击。在文章提出了异常检测的对抗性统计学习机制,基于异常值Dirichlet混合的ADS(ODM-ADS),它具有三种新功能:(1)可以自我适应数据中毒攻击,这些攻击会在训练阶段注入恶意实例,从而破坏学习过程。(2)建立了统计合法的概况,并使用建议的异常值函数将概要的基线变异视为异常。(3)为了处理动态和大规模网络,如物联网(IoT),云计算和雾计算,提出建议在雾节点中部署机制作为软件即服务(SaaS)。使得所提出的机制能够在网络边缘同时处理流数据。通过使用NSL-KDD和UNSW-NB15数据集对ODM-ADS机制进行,结果表明ODM-ADS在准确性,检测率(DR),误报率(FPR)和计算时间方面优于其他七种对等算法。

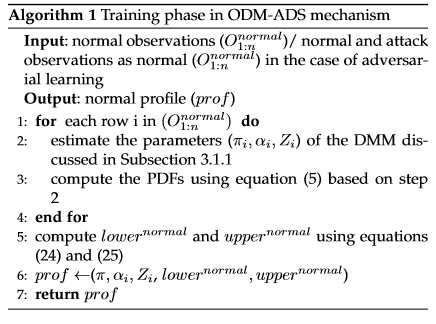

ODM-ADS机制训练及抵御算法如下:

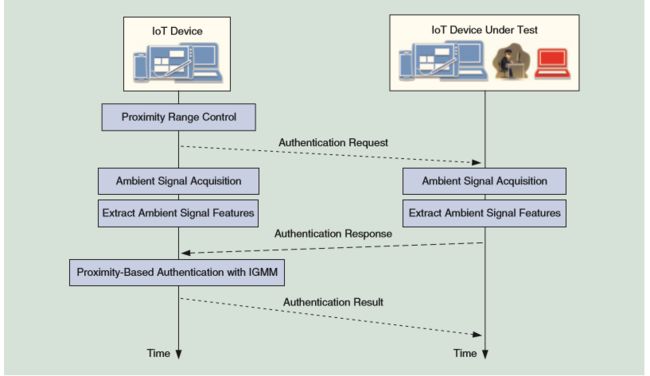

- IoT Security Techniques Based on Machine Learning: How Do IoT Devices Use AI to Enhance Security?[J]. 【文章链接】

IEEE Signal Processing Magazine, 2018, 35(5):41-49.

Liang X , Xiaoyue W , Xiaozhen L , et al.

研究进展:

物联网(IoT)将各种设备集成到网络中以提供先进的智能服务,必须保护用户隐私并解决诸如欺骗攻击,拒绝服务(DoS)攻击,干扰和窃听等攻击。该文章对物联网系统的攻击模型进行研究,并提出基于机器学习(ML)技术(包括监督学习,无监督学习和强化学习(RL))审查物联网安全的解决方案。

物联网系统中基于ML的身份验证的说明如下:

Dense 3D Object Reconstruction from a Single Depth View[J]. 【文章链接】

IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018:1-1.

Bo Y , Stefano R , Andrew M , et al.

研究进展:

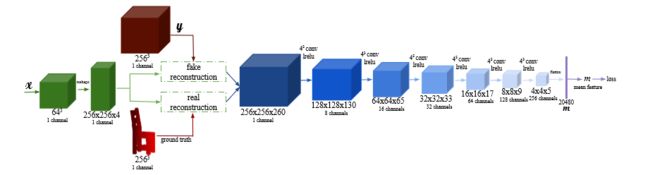

在文章中,提出了一种新颖的方法3D-RecGAN++,它使用生成对抗网络从单个任意深度视图重建给定对象的完整3D结构。通过利用3D编码器解码器和生成对抗网络的泛化能力,3D-RecGAN++可以预测具有细节的密集和精确的3D结构,优于单个视图的完整状态,适用于个体对象类别。与通常需要相同对象或类标签的多个视图以恢复完整3D几何的现有工作不同,所提出的3D-RecGAN++仅将对象的深度视图的体素网格表示作为输入,并且能够生成完整的通过恢复被遮挡/缺失区域,具有256^3的高分辨率的3D占用网格。关键思想是结合自动编码器的生成功能和条件生成对抗网络(GAN)框架,以推断高维体素空间中对象的精确和细粒度3D结构。对大型合成数据集和真实世界Kinect数据集的大量实验表明,所提出的3D-RecGAN++在单视图3D对象重建中明显优于现有技术,并且能够重建看不见的对象类型。尽管该模型纯粹是在合成数据上训练的,但该模型对于真实世界的噪声数据是稳健的,并且可以推断出精确的3D形状。这使得网络能够学习对象的一般3D潜在特征,而不是简单地为训练数据集设置函数,并且3D-RecGAN++的对抗性学习可以为估计的3D形状添加几何细节。

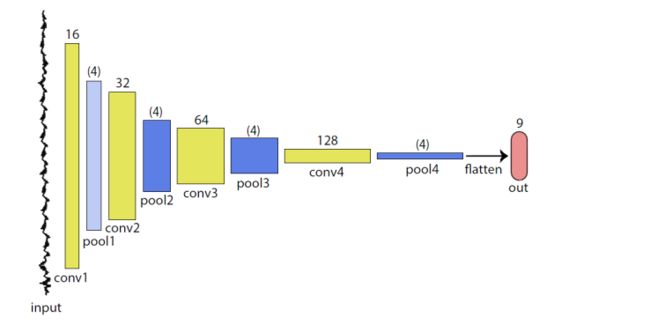

用于从单个深度视图估计3D形状的生成器模型如下:

用于3D形状修正的鉴别器模型如下:

- Quantum Generative Adversarial Learning[J]. 【文章链接】

Physical Review Letters, 2018, 121(4):040502-.

Seth L , Christian W .

研究进展:

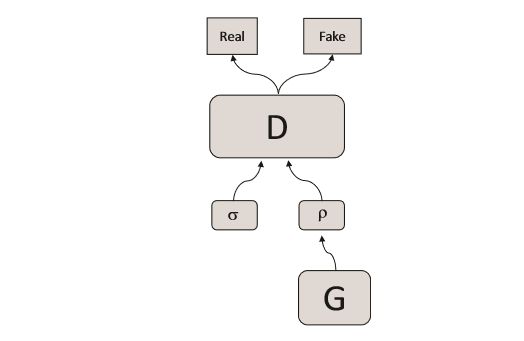

生成对抗网络(GAN)代表了经典机器学习的强大工具:生成器尝试为模拟真实数据集的数据创建统计数据,而鉴别器尝试区分真假数据。生成器和鉴别器的学习过程可以被认为是对抗性游戏,并且在合理的假设下,游戏收敛到生成器生成与真实数据相同的统计数据的点,并且鉴别器无法区分真实数据和生成的数据。文章表明,当生成器产生与数据相同的统计数据时,量子对抗性游戏的唯一固定点也会发生,其中数据由量子态或经典数据组成,并且生成器和鉴别器配备有量子信息处理器。由于量子系统本质上是概率性的,因此量子情况的证明与经典情况不同并且更简单。文章表明,当数据由在高维空间上进行的测量样本组成时,量子对抗网络可能比经典的对抗网络具有指数优势。

一般量子生成对抗网络(QuGAN)协议的示意图如下:

Quantum generative adversarial networks[J].【文章链接】

Physical Review A, 2018, 98(1):012324-.

Pierre-Luc D D , Nathan K .

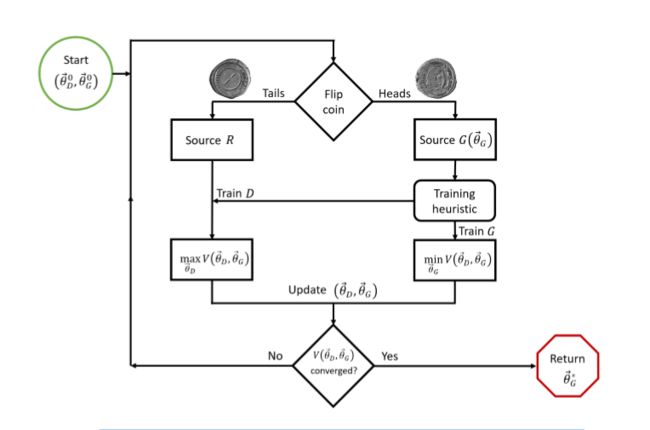

研究进展:

量子机器学习有望成为近期量子器件的首批潜在通用应用之一。最近在经典机器学习方面的一个重大突破是生成性对抗训练的概念,其中鉴别器模型的梯度用于训练单独的生成模型。这篇文章将对抗性训练扩展到量子域,并展示如何使用量子电路构建生成对抗性网络。 此外还展示了如何使用另一个量子电路计算梯度-生成对抗性网络训练的实例,证实了QuGAN将具有比其经典对应物更多样化的表现能力。例如,可以推测足够大的QuGAN可以学习生成由RSA公共加密密钥标记的加密数据,因为量子计算机具有执行Shor因子并因此执行解密的能力。在这种情况下,最佳生成器将学习每个密钥的未加密数据的统计模型,并用标签加密。其他经典密码系统(如椭圆曲线)也可能容易受到此类攻击。

QuGAN训练的算法流程如下:

参考资料

- 深度学习的发展历史及应用现状

- Threat of Adversarial Attacks on Deep Learning in Computer Vision: A Survey

Naveed Akhtar, Ajmal Mian (Submitted on 2 Jan 2018 (v1), last revised 26 Feb 2018 (this version, v3)) - 生成式对抗网络

- Moustafa N, Choo K K R, Radwan I, et al. Outlier Dirichlet Mixture Mechanism: Adversarial Statistical Learning for Anomaly Detection in the Fog[J]. IEEE Transactions on Information Forensics and Security, 2019, PP(99):1-1.

- Liang X , Xiaoyue W , Xiaozhen L , et al. IoT Security Techniques Based on Machine Learning: How Do IoT Devices Use AI to Enhance Security?[J]. IEEE Signal Processing Magazine, 2018, 35(5):41-49.

- Bo Y , Stefano R , Andrew M , et al. Dense 3D Object Reconstruction from a Single Depth View[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018:1-1.

- Seth L , Christian W . Quantum Generative Adversarial Learning[J]. Physical Review Letters, 2018, 121(4):040502-.

- Pierre-Luc D D , Nathan K . Quantum generative adversarial networks[J]. Physical Review A, 2018, 98(1):012324-....

posted on 2019-04-08 12:21 20189224史馨怡 阅读(...) 评论(...) 编辑 收藏