- 消息中间件有哪些常见类型

xmh-sxh-1314

java

消息中间件根据其设计理念和用途,可以大致分为以下几种常见类型:点对点消息队列(Point-to-PointMessagingQueues):在这种模型中,消息被发送到特定的队列中,消费者从队列中取出并处理消息。队列中的消息只能被一个消费者消费,消费后即被删除。常见的实现包括IBM的MQSeries、RabbitMQ的部分使用场景等。适用于任务分发、负载均衡等场景。发布/订阅消息模型(Pub/Sub

- Kafka 消息丢失如何处理?

架构文摘JGWZ

学习

今天给大家分享一个在面试中经常遇到的问题:Kafka消息丢失该如何处理?这个问题啊,看似简单,其实里面藏着很多“套路”。来,咱们先讲一个面试的“真实”案例。面试官问:“Kafka消息丢失如何处理?”小明一听,反问:“你是怎么发现消息丢失了?”面试官顿时一愣,沉默了片刻后,可能有点不耐烦,说道:“这个你不用管,反正现在发现消息丢失了,你就说如何处理。”小明一头雾水:“问题是都不知道怎么丢的,处理起来

- 【六】阿伟开始搭建Kafka学习环境

能源恒观

中间件学习kafkaspring

阿伟开始搭建Kafka学习环境概述上一篇文章阿伟学习了Kafka的核心概念,并且把市面上流行的消息中间件特性进行了梳理和对比,方便大家在学习过程中进行对比学习,最后梳理了一些Kafka使用中经常遇到的Kafka难题以及解决思路,经过上一篇的学习我相信大家对Kafka有了初步的认识,本篇将继续学习Kafka。一、安装和配置学习一项技术首先要搭建一套服务,而Kafka的运行主要需要部署jdk、zook

- Java面试题精选:消息队列(二)

芒果不是芒

Java面试题精选javakafka

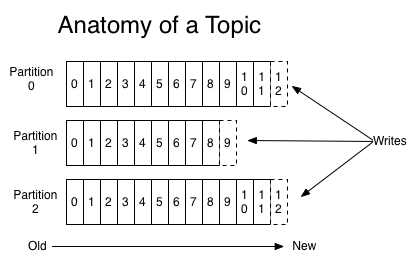

一、Kafka的特性1.消息持久化:消息存储在磁盘,所以消息不会丢失2.高吞吐量:可以轻松实现单机百万级别的并发3.扩展性:扩展性强,还是动态扩展4.多客户端支持:支持多种语言(Java、C、C++、GO、)5.KafkaStreams(一个天生的流处理):在双十一或者销售大屏就会用到这种流处理。使用KafkaStreams可以快速的把销售额统计出来6.安全机制:Kafka进行生产或者消费的时候会

- Kafka是如何保证数据的安全性、可靠性和分区的

喜欢猪猪

kafka分布式

Kafka作为一个高性能、可扩展的分布式流处理平台,通过多种机制来确保数据的安全性、可靠性和分区的有效管理。以下是关于Kafka如何保证数据安全性、可靠性和分区的详细解析:一、数据安全性SSL/TLS加密:Kafka支持SSL/TLS协议,通过配置SSL证书和密钥来加密数据传输,确保数据在传输过程中不会被窃取或篡改。这一机制有效防止了中间人攻击,保护了数据的安全性。SASL认证:Kafka支持多种

- esp32开发快速入门 8 : MQTT 的快速入门,基于esp32实现MQTT通信

z755924843

ESP32开发快速入门服务器网络运维

MQTT介绍简介MQTT(MessageQueuingTelemetryTransport,消息队列遥测传输协议),是一种基于发布/订阅(publish/subscribe)模式的"轻量级"通讯协议,该协议构建于TCP/IP协议上,由IBM在1999年发布。MQTT最大优点在于,可以以极少的代码和有限的带宽,为连接远程设备提供实时可靠的消息服务。作为一种低开销、低带宽占用的即时通讯协议,使其在物联

- 06选课支付模块之基于消息队列发送支付通知消息

echo 云清

学成在线javarabbitmq消息队列支付通知学成在线

消息队列发送支付通知消息需求分析订单服务作为通用服务,在订单支付成功后需要将支付结果异步通知给其他对接的微服务,微服务收到支付结果根据订单的类型去更新自己的业务数据技术方案使用消息队列进行异步通知需要保证消息的可靠性即生产端将消息成功通知到服务端:消息发送到交换机-->由交换机发送到队列-->消费者监听队列,收到消息进行处理,参考文章02-使用Docker安装RabbitMQ-CSDN博客生产者确

- 【Death Note】网吧战神之7天爆肝渗透测试死亡笔记_sqlmap在默认情况下除了使用 char() 函数防止出现单引号

2401_84561374

程序员笔记

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。需要这份系统化的资料的朋友,可以戳这里获取一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!特殊服务端口2181zookeeper服务未授权访问

- Kafka详细解析与应用分析

芊言芊语

kafka分布式

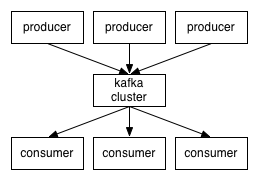

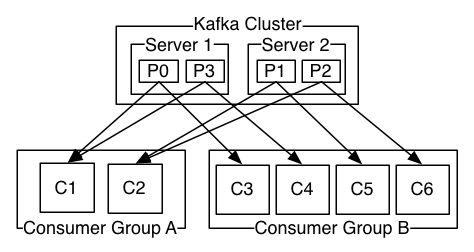

Kafka是一个开源的分布式事件流平台(EventStreamingPlatform),由LinkedIn公司最初采用Scala语言开发,并基于ZooKeeper协调管理。如今,Kafka已经被Apache基金会纳入其项目体系,广泛应用于大数据实时处理领域。Kafka凭借其高吞吐量、持久化、分布式和可靠性的特点,成为构建实时流数据管道和流处理应用程序的重要工具。Kafka架构Kafka的架构主要由

- Kafka 基础与架构理解

StaticKing

KAFKAkafka

目录前言Kafka基础概念消息队列简介:Kafka与传统消息队列(如RabbitMQ、ActiveMQ)的对比Kafka的组件Kafka的工作原理:消息的生产、分发、消费流程Kafka系统架构Kafka的分布式架构设计Leader-Follower机制与数据复制Log-basedStorage和持久化Broker间通信协议Zookeeper在Kafka中的角色总结前言Kafka是一个分布式的消息系

- 【仿RabbitMQ消息队列项目day2】使用muduo库中基于protobuf的应用层协议进行通信

月夜星辉雪

rabbitmq网络分布式c++后端服务器linux

一.什么是muduo?muduo库是⼀个基于非阻塞IO和事件驱动的C++高并发TCP网络编程库。简单来理解,它就是对原生的TCP套接字的封装,是一个比socket编程接口更好用的编程库。二.使用muduo库完成一个英译汉翻译服务TranslateServer.hpp:#pragmaonce#include#include#include#include#include"muduo/net/TcpC

- 使用 RabbitMQ 实现秒杀订单系统的异步消息处理

c137范特西

rabbitmq分布式

使用RabbitMQ实现秒杀订单系统的异步消息处理在秒杀系统中,如何确保高并发环境下的订单处理稳定高效是个很大的挑战。为了解决这个问题,我们通常会引入消息队列,通过异步处理来削峰填谷。这篇文章将详细讲解如何使用RabbitMQ来设计一个秒杀订单系统的异步消息处理流程,重点是如何使用交换机(Exchange)、队列(Queue)、路由键(RoutingKey)以及死信队列(DeadLetterQue

- hbase介绍

CrazyL-

云计算+大数据hbase

hbase是一个分布式的、多版本的、面向列的开源数据库hbase利用hadoophdfs作为其文件存储系统,提供高可靠性、高性能、列存储、可伸缩、实时读写、适用于非结构化数据存储的数据库系统hbase利用hadoopmapreduce来处理hbase、中的海量数据hbase利用zookeeper作为分布式系统服务特点:数据量大:一个表可以有上亿行,上百万列(列多时,插入变慢)面向列:面向列(族)的

- 全面指南:用户行为从前端数据采集到实时处理的最佳实践

数字沉思

营销流量运营系统架构前端内容运营大数据

引言在当今的数据驱动世界,实时数据采集和处理已经成为企业做出及时决策的重要手段。本文将详细介绍如何通过前端JavaScript代码采集用户行为数据、利用API和Kafka进行数据传输、通过Flink实时处理数据的完整流程。无论你是想提升产品体验还是做用户行为分析,这篇文章都将为你提供全面的解决方案。设计一个通用的ClickHouse表来存储用户事件时,需要考虑多种因素,包括事件类型、时间戳、用户信

- Docker安装Kafka和Kafka-Manager

阿靖哦

本文介绍如何通过Docker安装kafka与kafka界面管理界面一、拉取zookeeper由于kafka需要依赖于zookeeper,因此这里先运行zookeeper1、拉取镜像dockerpullwurstmeister/zookeeper2、启动dockerrun-d--namezookeeper-p2181:2181-eTZ="Asia/Shanghai"--restartalwayswu

- 主流行架构

rainbowcheng

架构架构

nexus,gitlab,svn,jenkins,sonar,docker,apollo,catteambition,axure,蓝湖,禅道,WCP;redis,kafka,es,zookeeper,dubbo,shardingjdbc,mysql,InfluxDB,Telegraf,Grafana,Nginx,xxl-job,Neo4j,NebulaGraph是一个高性能的,NOSQL图形数据库

- 微服务治理:Nacos, Zookeeper, consul, etcd, Eureka等 5 个常用微服务注册工具对比

surfirst

架构微服务zookeeperconsul

当然!下面是Nacos、Zookeeper、Consul、etcd和Eureka这五个常用的注册中心的详细对比:Nacos:Nacos是由HashiCorp开发的高度可扩展和可靠的服务发现、配置管理和服务网格解决方案。它的架构基于一组服务器代理形成的共识组和与服务器交互的许多客户端代理。主要特点包括:服务发现:服务在Nacos中注册,客户端可以通过DNS或HTTPAPI发现服务及其位置。健康检查:

- 月度总结 | 2022年03月 | 考研与就业的抉择 | 确定未来走大数据开发路线

「已注销」

个人总结hadoop

一、时间线梳理3月3日,寻找到同专业的就业伙伴3月5日,着手准备Java八股文,决定先走Java后端路线3月8月,申请到了校图书馆的考研专座,决定暂时放弃就业,先准备考研,买了数学和408的资料书3月9日-3月13日,因疫情原因,宿舍区暂封,这段时间在准备考研,发现内容特别多3月13日-3月19日,大部分时间在刷Hadoop、Zookeeper、Kafka的视频,同时在准备实习的项目3月20日,退

- 微服务之服务注册与发现:Etcd、Zookeeper、Consul 与 Nacos 比较

陌北v1

微服务etcdzookeeperConsulNacos

在微服务架构中,服务注册与发现是实现服务动态管理和负载均衡的关键。本文将对四款主流的服务注册与发现工具——Etcd、Zookeeper、Consul、Nacos进行深入对比,从功能、性能、一致性、生态集成、应用场景等多个维度展开分析,帮助您选择最适合的工具。核心概念服务注册:服务实例启动时将自身信息(IP地址、端口、健康状态等)注册到注册中心。服务发现:服务消费者通过注册中心查询所需服务的地址列表

- Redisson分布式锁实现原理和使用

牧竹子

springboot#redisRedissonredis

常见的锁内存锁lock,synchronize分布式锁redis,zookeeper实现Redisson基于redis实现了Lock接口的分布式集群锁,是可重入锁,功能强大,源码复杂,比redis单机模式分布式锁可靠,稳定性更高,支持集群模式,支持锁根据业务时长自动延迟释放redis普通分布式锁存在一定的缺陷——它加锁只作用在一个Redis节点上,如果通过sentinel和cluster保证高可用

- 分布式消息队列Kafka

叶域

大数据分布式kafkascalaspark

分布式消息队列Kafka简介:Kafka是一个分布式消息队列系统,用于处理实时数据流。消息按照主题(Topic)进行分类存储,发送消息的实体称为Producer,接收消息的实体称为Consumer。Kafka集群由多个Kafka实例(Server)组成,每个实例称为Broker。主要用途:广泛应用于构建实时数据管道和流应用程序,适用于需要高吞吐量和低延迟的数据处理场景依赖:Kafka集群和消费者依

- HBase介绍

mingyu1016

数据库

概述HBase是一个分布式的、面向列的开源数据库,源于google的一篇论文《bigtable:一个结构化数据的分布式存储系统》。HBase是GoogleBigtable的开源实现,它利用HadoopHDFS作为其文件存储系统,利用HadoopMapReduce来处理HBase中的海量数据,利用Zookeeper作为协同服务。HBase的表结构HBase以表的形式存储数据。表有行和列组成。列划分为

- K8S学习之PV&&PVC

david161

部署mysql之前我们需要先了解一个概念有状态服务。这是一种特殊的服务,简单的归纳下就是会产生需要持久化的数据,并且有很强的I/O需求,且重启需要依赖上次存储到磁盘的数据。如典型的mysql,kafka,zookeeper等等。在我们有比较优秀的商业存储的前提下,非常推荐使用有状态服务进行部署,计算和存储分离那是相当的爽的。在实际生产中如果没有这种存储,localPV也是不错的选择,当然local

- 微服务架构下的服务治理实现方案详解

星辰@Sea

系统架构架构微服务云原生

在微服务架构中,服务治理是确保系统稳定运行、提高服务间通信效率和灵活性的关键环节。它涉及服务的发现、负载均衡、容错、监控等多个方面。本文将深入探讨几种常见的服务治理实现方案:Zookeeper、Nacos、Consul、以及Eureka,分析它们的特点、工作原理及应用场景,帮助开发者根据实际需求选择合适的工具。一、服务治理概述服务治理,简而言之,就是对微服务架构中的服务进行有效管理的过程,包括服务

- Kafka系列之:kafka命令详细总结

快乐骑行^_^

日常分享专栏KafkaKafka系列kafka命令详细总结

Kafka系列之:kafka命令详细总结一、添加和删除topic二、修改topic三、平衡领导者四、检查消费者位置五、管理消费者群体一、添加和删除topicbin/kafka-topics.sh--bootstrap-serverbroker_host:port--create--topicmy_topic_name\--partitions20--replication-factor3--con

- Dubbo 与 Zookeeper 在项目中的应用:原理与实现详解

CopyLower

学习Javadubbozookeeper分布式

引言在微服务架构日益普及的今天,如何实现服务的高效调用和管理成为了关键问题。Dubbo作为阿里巴巴开源的高性能RPC框架,在分布式服务治理方面具有显著的优势。Zookeeper作为一款分布式协调服务,能够高效地管理和协调服务节点信息。因此,Dubbo与Zookeeper的结合不仅能够提供服务注册与发现机制,还能实现更高效的服务治理。在本文中,我们将深入探讨Dubbo和Zookeeper的原理、如何

- 搭建Kafka+zookeeper集群调度

krb___

kafka分布式

前言硬件环境172.18.0.5kafkazk1Kafka+zookeeperKafkaBroker集群172.18.0.6kafkazk2Kafka+zookeeperKafkaBroker集群172.18.0.7kafkazk3Kafka+zookeeperKafkaBroker集群软件环境zookeeper3.5.9资源调度、写作Kafka2.8.0消息通信中间件安装JDK1.8安装搭建zo

- Java 使用 Redis

lly202406

开发语言

Java使用Redis1.引言Redis是一个开源的高性能键值对数据库。它支持多种类型的数据结构,如字符串、列表、集合、散列表等,适用于多种场景,如缓存、消息队列等。Java是一种广泛使用的编程语言,它在企业级应用中有着广泛的应用。在Java应用中,使用Redis可以提高数据访问速度,减轻数据库的压力。本文将介绍如何在Java应用中使用Redis。2.准备工作在开始使用Redis之前,需要确保已经

- Kafka和Pulsar深入解析

jasen91

大数据开发kafka分布式

Kafka多租户:单租户系统数据迁移:依赖MirrorMaker,需要额外维护。市场上也有ConfluentReplicator等供应商工具。分层存储:由供应商提供商业使用。组件依赖:KafkaRaft(KRaft)从Kafka2.8开始处于早期访问模式,允许Kafka在没有ZooKeeper的情况下工作。这对Kafka来说是一个显著的优势,因为它简化了Kafka的体系结构并降低了学习成本。云原生

- Dubbo服务自动Web化之路

搜狐技术产品小编2023

dubbo前端

本文字数:6047字预计阅读时间:40分钟01故障出现事情起源于一次故障,2023年12月14日14点26分,大量Dubbo服务报出异常,无法链接zookeeper集群:Session0x0 for serverdubboZk.xxx.com/10.x.x.x:2181, Closingsocketconnection. AttemptingreconnectexceptitisaSessionE

- java责任链模式

3213213333332132

java责任链模式村民告县长

责任链模式,通常就是一个请求从最低级开始往上层层的请求,当在某一层满足条件时,请求将被处理,当请求到最高层仍未满足时,则请求不会被处理。

就是一个请求在这个链条的责任范围内,会被相应的处理,如果超出链条的责任范围外,请求不会被相应的处理。

下面代码模拟这样的效果:

创建一个政府抽象类,方便所有的具体政府部门继承它。

package 责任链模式;

/**

*

- linux、mysql、nginx、tomcat 性能参数优化

ronin47

一、linux 系统内核参数

/etc/sysctl.conf文件常用参数 net.core.netdev_max_backlog = 32768 #允许送到队列的数据包的最大数目

net.core.rmem_max = 8388608 #SOCKET读缓存区大小

net.core.wmem_max = 8388608 #SOCKET写缓存区大

- php命令行界面

dcj3sjt126com

PHPcli

常用选项

php -v

php -i PHP安装的有关信息

php -h 访问帮助文件

php -m 列出编译到当前PHP安装的所有模块

执行一段代码

php -r 'echo "hello, world!";'

php -r 'echo "Hello, World!\n";'

php -r '$ts = filemtime("

- Filter&Session

171815164

session

Filter

HttpServletRequest requ = (HttpServletRequest) req;

HttpSession session = requ.getSession();

if (session.getAttribute("admin") == null) {

PrintWriter out = res.ge

- 连接池与Spring,Hibernate结合

g21121

Hibernate

前几篇关于Java连接池的介绍都是基于Java应用的,而我们常用的场景是与Spring和ORM框架结合,下面就利用实例学习一下这方面的配置。

1.下载相关内容: &nb

- [简单]mybatis判断数字类型

53873039oycg

mybatis

昨天同事反馈mybatis保存不了int类型的属性,一直报错,错误信息如下:

Caused by: java.lang.NumberFormatException: For input string: "null"

at sun.mis

- 项目启动时或者启动后ava.lang.OutOfMemoryError: PermGen space

程序员是怎么炼成的

eclipsejvmtomcatcatalina.sheclipse.ini

在启动比较大的项目时,因为存在大量的jsp页面,所以在编译的时候会生成很多的.class文件,.class文件是都会被加载到jvm的方法区中,如果要加载的class文件很多,就会出现方法区溢出异常 java.lang.OutOfMemoryError: PermGen space.

解决办法是点击eclipse里的tomcat,在

- 我的crm小结

aijuans

crm

各种原因吧,crm今天才完了。主要是接触了几个新技术:

Struts2、poi、ibatis这几个都是以前的项目中用过的。

Jsf、tapestry是这次新接触的,都是界面层的框架,用起来也不难。思路和struts不太一样,传说比较简单方便。不过个人感觉还是struts用着顺手啊,当然springmvc也很顺手,不知道是因为习惯还是什么。jsf和tapestry应用的时候需要知道他们的标签、主

- spring里配置使用hibernate的二级缓存几步

antonyup_2006

javaspringHibernatexmlcache

.在spring的配置文件中 applicationContent.xml,hibernate部分加入

xml 代码

<prop key="hibernate.cache.provider_class">org.hibernate.cache.EhCacheProvider</prop>

<prop key="hi

- JAVA基础面试题

百合不是茶

抽象实现接口String类接口继承抽象类继承实体类自定义异常

/* * 栈(stack):主要保存基本类型(或者叫内置类型)(char、byte、short、 *int、long、 float、double、boolean)和对象的引用,数据可以共享,速度仅次于 * 寄存器(register),快于堆。堆(heap):用于存储对象。 */ &

- 让sqlmap文件 "继承" 起来

bijian1013

javaibatissqlmap

多个项目中使用ibatis , 和数据库表对应的 sqlmap文件(增删改查等基本语句),dao, pojo 都是由工具自动生成的, 现在将这些自动生成的文件放在一个单独的工程中,其它项目工程中通过jar包来引用 ,并通过"继承"为基础的sqlmap文件,dao,pojo 添加新的方法来满足项

- 精通Oracle10编程SQL(13)开发触发器

bijian1013

oracle数据库plsql

/*

*开发触发器

*/

--得到日期是周几

select to_char(sysdate+4,'DY','nls_date_language=AMERICAN') from dual;

select to_char(sysdate,'DY','nls_date_language=AMERICAN') from dual;

--建立BEFORE语句触发器

CREATE O

- 【EhCache三】EhCache查询

bit1129

ehcache

本文介绍EhCache查询缓存中数据,EhCache提供了类似Hibernate的查询API,可以按照给定的条件进行查询。

要对EhCache进行查询,需要在ehcache.xml中设定要查询的属性

数据准备

@Before

public void setUp() {

//加载EhCache配置文件

Inpu

- CXF框架入门实例

白糖_

springWeb框架webserviceservlet

CXF是apache旗下的开源框架,由Celtix + XFire这两门经典的框架合成,是一套非常流行的web service框架。

它提供了JAX-WS的全面支持,并且可以根据实际项目的需要,采用代码优先(Code First)或者 WSDL 优先(WSDL First)来轻松地实现 Web Services 的发布和使用,同时它能与spring进行完美结合。

在apache cxf官网提供

- angular.equals

boyitech

AngularJSAngularJS APIAnguarJS 中文APIangular.equals

angular.equals

描述:

比较两个值或者两个对象是不是 相等。还支持值的类型,正则表达式和数组的比较。 两个值或对象被认为是 相等的前提条件是以下的情况至少能满足一项:

两个值或者对象能通过=== (恒等) 的比较

两个值或者对象是同样类型,并且他们的属性都能通过angular

- java-腾讯暑期实习生-输入一个数组A[1,2,...n],求输入B,使得数组B中的第i个数字B[i]=A[0]*A[1]*...*A[i-1]*A[i+1]

bylijinnan

java

这道题的具体思路请参看 何海涛的微博:http://weibo.com/zhedahht

import java.math.BigInteger;

import java.util.Arrays;

public class CreateBFromATencent {

/**

* 题目:输入一个数组A[1,2,...n],求输入B,使得数组B中的第i个数字B[i]=A

- FastDFS 的安装和配置 修订版

Chen.H

linuxfastDFS分布式文件系统

FastDFS Home:http://code.google.com/p/fastdfs/

1. 安装

http://code.google.com/p/fastdfs/wiki/Setup http://hi.baidu.com/leolance/blog/item/3c273327978ae55f93580703.html

安装libevent (对libevent的版本要求为1.4.

- [强人工智能]拓扑扫描与自适应构造器

comsci

人工智能

当我们面对一个有限拓扑网络的时候,在对已知的拓扑结构进行分析之后,发现在连通点之后,还存在若干个子网络,且这些网络的结构是未知的,数据库中并未存在这些网络的拓扑结构数据....这个时候,我们该怎么办呢?

那么,现在我们必须设计新的模块和代码包来处理上面的问题

- oracle merge into的用法

daizj

oraclesqlmerget into

Oracle中merge into的使用

http://blog.csdn.net/yuzhic/article/details/1896878

http://blog.csdn.net/macle2010/article/details/5980965

该命令使用一条语句从一个或者多个数据源中完成对表的更新和插入数据. ORACLE 9i 中,使用此命令必须同时指定UPDATE 和INSE

- 不适合使用Hadoop的场景

datamachine

hadoop

转自:http://dev.yesky.com/296/35381296.shtml。

Hadoop通常被认定是能够帮助你解决所有问题的唯一方案。 当人们提到“大数据”或是“数据分析”等相关问题的时候,会听到脱口而出的回答:Hadoop! 实际上Hadoop被设计和建造出来,是用来解决一系列特定问题的。对某些问题来说,Hadoop至多算是一个不好的选择,对另一些问题来说,选择Ha

- YII findAll的用法

dcj3sjt126com

yii

看文档比较糊涂,其实挺简单的:

$predictions=Prediction::model()->findAll("uid=:uid",array(":uid"=>10));

第一个参数是选择条件:”uid=10″。其中:uid是一个占位符,在后面的array(“:uid”=>10)对齐进行了赋值;

更完善的查询需要

- vim 常用 NERDTree 快捷键

dcj3sjt126com

vim

下面给大家整理了一些vim NERDTree的常用快捷键了,这里几乎包括了所有的快捷键了,希望文章对各位会带来帮助。

切换工作台和目录

ctrl + w + h 光标 focus 左侧树形目录ctrl + w + l 光标 focus 右侧文件显示窗口ctrl + w + w 光标自动在左右侧窗口切换ctrl + w + r 移动当前窗口的布局位置

o 在已有窗口中打开文件、目录或书签,并跳

- Java把目录下的文件打印出来

蕃薯耀

列出目录下的文件文件夹下面的文件目录下的文件

Java把目录下的文件打印出来

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2015年7月11日 11:02:

- linux远程桌面----VNCServer与rdesktop

hanqunfeng

Desktop

windows远程桌面到linux,需要在linux上安装vncserver,并开启vnc服务,同时需要在windows下使用vnc-viewer访问Linux。vncserver同时支持linux远程桌面到linux。

linux远程桌面到windows,需要在linux上安装rdesktop,同时开启windows的远程桌面访问。

下面分别介绍,以windo

- guava中的join和split功能

jackyrong

java

guava库中,包含了很好的join和split的功能,例子如下:

1) 将LIST转换为使用字符串连接的字符串

List<String> names = Lists.newArrayList("John", "Jane", "Adam", "Tom");

- Web开发技术十年发展历程

lampcy

androidWeb浏览器html5

回顾web开发技术这十年发展历程:

Ajax

03年的时候我上六年级,那时候网吧刚在小县城的角落萌生。传奇,大话西游第一代网游一时风靡。我抱着试一试的心态给了网吧老板两块钱想申请个号玩玩,然后接下来的一个小时我一直在,注,册,账,号。

彼时网吧用的512k的带宽,注册的时候,填了一堆信息,提交,页面跳转,嘣,”您填写的信息有误,请重填”。然后跳转回注册页面,以此循环。我现在时常想,如果当时a

- 架构师之mima-----------------mina的非NIO控制IOBuffer(说得比较好)

nannan408

buffer

1.前言。

如题。

2.代码。

IoService

IoService是一个接口,有两种实现:IoAcceptor和IoConnector;其中IoAcceptor是针对Server端的实现,IoConnector是针对Client端的实现;IoService的职责包括:

1、监听器管理

2、IoHandler

3、IoSession

- ORA-00054:resource busy and acquire with NOWAIT specified

Everyday都不同

oraclesessionLock

[Oracle]

今天对一个数据量很大的表进行操作时,出现如题所示的异常。此时表明数据库的事务处于“忙”的状态,而且被lock了,所以必须先关闭占用的session。

step1,查看被lock的session:

select t2.username, t2.sid, t2.serial#, t2.logon_time

from v$locked_obj

- javascript学习笔记

tntxia

JavaScript

javascript里面有6种基本类型的值:number、string、boolean、object、function和undefined。number:就是数字值,包括整数、小数、NaN、正负无穷。string:字符串类型、单双引号引起来的内容。boolean:true、false object:表示所有的javascript对象,不用多说function:我们熟悉的方法,也就是

- Java enum的用法详解

xieke90

enum枚举

Java中枚举实现的分析:

示例:

public static enum SEVERITY{

INFO,WARN,ERROR

}

enum很像特殊的class,实际上enum声明定义的类型就是一个类。 而这些类都是类库中Enum类的子类 (java.l