- 【心灵鸡汤】深度学习技能形成树:从零基础到AI专家的成长路径全解析

智算菩萨

人工智能深度学习

引言:技能树的生长哲学在这个人工智能浪潮汹涌的时代,深度学习犹如一棵参天大树,其根系深深扎入数学与计算科学的沃土,主干挺拔地承载着机器学习的核心理念,而枝叶则繁茂地延伸至计算机视觉、自然语言处理、强化学习等各个应用领域。对于初入此领域的新手而言,理解这棵技能树的生长规律,掌握其形成过程中的关键节点和发展阶段,将直接决定其在人工智能道路上能够走多远、攀多高。技能树的概念源于游戏设计,但在学习深度学习

- 【计算机毕业设计】基于Springboot的办公用品管理系统+LW

枫叶学长(专业接毕设)

Java毕业设计实战案例课程设计springboot后端

博主介绍:✌全网粉丝3W+,csdn特邀作者、CSDN新星计划导师、Java领域优质创作者,掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和学生毕业项目实战,高校老师/讲师/同行前辈交流✌技术范围:SpringBoot、Vue、SSM、HLMT、Jsp、PHP、Nodejs、Python、爬虫、数据可视化、小程序、安卓app、大数据、物联网、机器学习等设计与开发。主要内容:

- 【TVM 教程】如何处理 TVM 报错

ApacheTVM是一个深度的深度学习编译框架,适用于CPU、GPU和各种机器学习加速芯片。更多TVM中文文档可访问→https://tvm.hyper.ai/运行TVM时,可能会遇到如下报错:---------------------------------------------------------------AnerroroccurredduringtheexecutionofTVM.F

- 【PaddleOCR】OCR文本检测与文本识别数据集整理,持续更新......

博主简介:曾任某智慧城市类企业算法总监,目前在美国市场的物流公司从事高级算法工程师一职,深耕人工智能领域,精通python数据挖掘、可视化、机器学习等,发表过AI相关的专利并多次在AI类比赛中获奖。CSDN人工智能领域的优质创作者,提供AI相关的技术咨询、项目开发和个性化解决方案等服务,如有需要请站内私信或者联系任意文章底部的的VX名片(ID:xf982831907)博主粉丝群介绍:①群内初中生、

- ImportError: /nvidia/cusparse/lib/libcusparse.so.12: undefined symbol: __nvJitLinkComplete_12_4

爱编程的喵喵

Python基础课程pythonImportErrortorchnvJitLink解决方案

大家好,我是爱编程的喵喵。双985硕士毕业,现担任全栈工程师一职,热衷于将数据思维应用到工作与生活中。从事机器学习以及相关的前后端开发工作。曾在阿里云、科大讯飞、CCF等比赛获得多次Top名次。现为CSDN博客专家、人工智能领域优质创作者。喜欢通过博客创作的方式对所学的知识进行总结与归纳,不仅形成深入且独到的理解,而且能够帮助新手快速入门。 本文主要介绍了ImportError:/home/

- 【机器学习笔记 Ⅱ】11 决策树模型

巴伦是只猫

机器学习机器学习笔记决策树

决策树模型(DecisionTree)详解决策树是一种树形结构的监督学习模型,通过一系列规则对数据进行分类或回归。其核心思想是模仿人类决策过程,通过不断提问(基于特征划分)逐步逼近答案。1.核心概念节点类型:根节点:起始问题(最佳特征划分点)。内部节点:中间决策步骤(特征判断)。叶节点:最终预测结果(类别或数值)。分支:对应特征的取值或条件判断(如“年龄≥30?”)。2.构建决策树的关键步骤(1)

- 【机器学习笔记 Ⅱ】10 完整周期

机器学习的完整生命周期(End-to-EndPipeline)机器学习的完整周期涵盖从问题定义到模型部署的全过程,以下是系统化的步骤分解和关键要点:1.问题定义(ProblemDefinition)目标:明确业务需求与机器学习任务的匹配性。关键问题:这是分类、回归、聚类还是强化学习问题?成功的标准是什么?(如准确率>90%、降低10%成本)输出:项目目标文档(含评估指标)。2.数据收集(DataC

- 【机器学习笔记Ⅰ】13 正则化代价函数

正则化代价函数(RegularizedCostFunction)详解正则化代价函数是机器学习中用于防止模型过拟合的核心技术,通过在原始代价函数中添加惩罚项,约束模型参数的大小,从而提高泛化能力。以下是系统化的解析:1.为什么需要正则化?过拟合问题:当模型过于复杂(如高阶多项式回归、深度神经网络)时,可能完美拟合训练数据但泛化性能差。解决方案:在代价函数中增加对参数的惩罚,抑制不重要的特征权重。2.

- 【机器学习笔记Ⅰ】6 多类特征

巴伦是只猫

机器学习机器学习笔记人工智能

多类特征(Multi-classFeatures)详解多类特征是指一个特征(变量)可以取多个离散的类别值,且这些类别之间没有内在的顺序关系。这类特征是机器学习中常见的数据类型,尤其在分类和回归问题中需要特殊处理。1.核心概念(1)什么是多类特征?定义:特征是离散的、有限的类别,且类别之间无大小或顺序关系。示例:颜色:红、绿、蓝(无顺序)。城市:北京、上海、广州(无数学意义的大小关系)。动物类别:猫

- 图像分割技术详解:从原理到实践

lanjieying

本文还有配套的精品资源,点击获取简介:图像分割是图像处理领域将图像分解为多个区域的过程,用于图像分析、特征提取等。文章介绍了图像分割的原理,并通过一个将图像划分为2*4子块的示例,展示了如何使用Python和matplotlib库中的tight_subplot函数进行图像分割和展示。文章还探讨了图像分割在不同领域的应用,以及如何在机器学习项目中作为数据预处理步骤。1.图像分割基本概念在图像处理领域

- 机器学习笔记——支持向量机

star_and_sun

机器学习笔记支持向量机

支持向量机参数模型对分布需要假设(这也是与非参数模型的区别之一)间隔最大化,形式转化为凸二次规划问题最大化间隔间隔最大化是意思:对训练集有着充分大的确信度来分类训练数据,最难以分的点也有足够大的信度将其分开间隔最大化的分离超平面的的求解怎么求呢?最终的方法如下1.线性可分的支持向量机的优化目标其实就是找得到分离的的超平面求得参数w和b的值就可以了注意,最大间隔分离超平面是唯一的,间隔叫硬间隔1.1

- 【机器学习&深度学习】多分类评估策略

一叶千舟

深度学习【理论】深度学习【应用必备常识】大数据人工智能

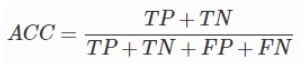

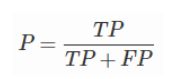

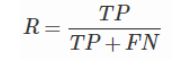

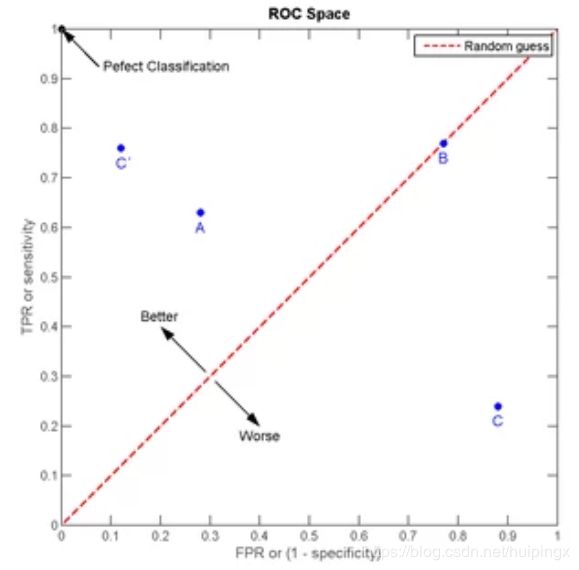

目录前言一、多分类3大策略✅宏平均(MacroAverage)✅加权平均(WeightedAverage)✅微平均(MicroAverage)二、类比理解2.1宏平均(MacroAverage)2.1.1计算方式2.1.2适合场景2.1.3宏平均不适用的场景2.1.4宏平均一般用在哪些指标上?2.1.5怎么看macroavg指标?2.1.6宏平均值低说明了什么?2.1.7从宏平均指标中定位模型短板

- 【机器学习笔记Ⅰ】7 向量化

巴伦是只猫

机器学习机器学习笔记人工智能

向量化(Vectorization)详解向量化是将数据或操作转换为向量(或矩阵)形式,并利用并行计算高效处理的技术。它是机器学习和数值计算中的核心优化手段,能显著提升代码运行效率(尤其在Python中避免显式循环)。1.为什么需要向量化?(1)传统循环的缺陷低效:Python的for循环逐元素操作,速度慢。代码冗长:需手动处理每个元素。示例:计算两个数组的点积(非向量化)a=[1,2,3]b=[4

- 李宏毅2025《机器学习》第四讲-Transformer架构的演进

Transformer架构的演进与替代方案:从RNN到Mamba的技术思辨Transformer作为当前AI领域的标准架构,其设计并非凭空而来,也并非没有缺点。本次讨论的核心便是:新兴的架构,如MAMA,是如何针对Transformer的弱点进行改进,并试图提供一个更优的解决方案的。要理解架构的演进,我们必须首先明确一个核心原则:每一种神经网络架构,都有其存在的技术理由。CNN(卷积神经网络):为

- 条件概率:不确定性决策的基石

大千AI助手

人工智能Python#OTHER决策树算法机器学习人工智能条件概率概率论

条件概率是概率论中的核心概念,用于描述在已知某一事件发生的条件下,另一事件发生的概率。它量化了事件之间的关联性,是贝叶斯推理、统计建模和机器学习的基础。本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、定义与公式设(A)和(B)是两个随机事件,且(P(B)>0):条件概率(P(A\midB))表示

- 人工智能动画展示人类的特征

AGI大模型与大数据研究院

AI大模型应用开发实战javapythonjavascriptkotlingolang架构人工智能

人工智能,动画,人类特征,情感识别,行为模拟,机器学习,深度学习,自然语言处理1.背景介绍人工智能(AI)技术近年来发展迅速,已渗透到生活的方方面面。从智能语音助手到自动驾驶汽车,AI正在改变着我们的世界。然而,尽管AI技术取得了令人瞩目的成就,但它仍然难以完全模拟人类的复杂行为和特征。人类的特征是多方面的,包括情感、认知、社交和创造力等。这些特征是人类区别于其他生物的重要标志,也是人类社会文明发

- 《支持向量机(SVM)在医疗领域的变革性应用》

CodeJourney.

支持向量机算法机器学习

在医疗科技日新月异的今天,先进的数据分析与机器学习技术正逐渐成为提升诊疗水平、助力医学研究的关键力量。支持向量机(SVM),凭借其独特的优势,在医疗这片复杂且对精准度要求极高的领域崭露头角,带来诸多令人瞩目的应用成果。一、疾病诊断:癌症早期筛查的“火眼金睛”癌症,作为全球健康的“头号杀手”,早期诊断对提升患者生存率意义非凡。在乳腺癌筛查领域,SVM发挥着重要作用。医疗科研人员收集大量乳腺组织的影像

- 机器学习20-线性网络思考

坐吃山猪

机器学习机器学习人工智能线性网络

机器学习20-线性网络思考针对线性网络的基础问题,使用基础示例进行解释1-核心知识点1-线性模型家族的线性回归和逻辑回归分别是什么,线性模型家族还有没有其他的模型线性模型家族是一系列基于线性假设的统计模型,它们假设因变量和自变量之间存在线性关系。线性模型家族中的两个最常见模型是线性回归和逻辑回归。线性回归(LinearRegression):线性回归是一种用于预测连续因变量的模型。它假设因变量yy

- 机器学习18-强化学习RLHF

坐吃山猪

机器学习机器学习人工智能

机器学习18-强化学习RLHF1-什么是RLHFRLHF(ReinforcementLearningfromHumanFeedback)即基于人类反馈的强化学习算法,以下是详细介绍:基本原理RLHF是一种结合了强化学习和人类反馈的机器学习方法。传统的强化学习通常依赖于预定义的奖励函数来指导智能体的学习,而RLHF则通过引入人类的反馈来替代或补充传统的奖励函数。在训练过程中,人类会对智能体的行为或输

- 机器学习19-Transformer和AlexNet思考

坐吃山猪

机器学习机器学习transformer人工智能

Transformer和AlexNet思考关于Transformer和AlexNet发展的一些思考1-核心知识点Word2Vec的作用是什么,和Transformer的诞生有什么关系吗?AlexNet的主要核心思路是什么,为什么表现那么好?现在有什么比AlexNet更优秀的算法2-思路整理1-Word2Vec的作用是什么,和Transformer的诞生有什么关系吗?Word2Vec的作用Word2

- 机器学习21-线性网络思考

坐吃山猪

机器学习机器学习人工智能线性网络

机器学习21-线性网络思考针对线性网络的发展问题,进行补充学习1-核心知识点1-传统机器学习针对线性分类算法求解的方式有哪些?请详细列举不同的算法对应的损失函数和计算思路在传统机器学习中,线性分类算法是一种非常重要的方法,用于将数据划分为不同的类别。以下是几种常见的线性分类算法,包括它们的损失函数和计算思路:1.感知机(Perceptron)损失函数感知机的损失函数是基于误分类点的,其目标是最小化

- Spring AI 第二讲 之 Chat Model API 第五节HuggingFace Chat

HuggingFaceInferenceEndpoints允许您在云中部署和提供机器学习模型,并通过API对其进行访问。开始使用有关HuggingFaceInferenceEndpoints的更多详细信息,请访问此处。前提条件添加spring-ai-huggingface依赖关系:org.springframework.aispring-ai-huggingface获取HuggingFaceAPI

- Python设置国内镜像教程

wh3933

python开发语言

####引言Python是一种广泛使用的高级编程语言,用于各种编程任务,从简单的脚本到复杂的机器学习算法。在安装Python包时,通常需要从Python包索引(PyPI)下载。由于网络原因,直接从PyPI下载可能速度较慢,因此,使用国内的镜像源可以显著提高下载速度。本文将详细介绍如何在Python中设置国内镜像。####文章目的本篇文章旨在指导用户如何将Python的包管理工具`pip`的默认源切

- 机器学习宝典——第6章

爱看烟花的码农

机器学习人工智能

第6章:聚类算法(Clustering)你好,同学!欢迎来到无监督学习的世界。与监督学习不同,这里的我们没有“标准答案”(标签),我们的目标是在数据中发现隐藏的、内在的结构。聚类算法就是实现这一目标的核心工具,它试图将数据集中的样本划分为若干个不相交的子集,我们称之为“簇”(cluster)。本章我们将深入探讨三种最具代表性的聚类算法:K-均值(K-Means)、层次聚类(Hierarchical

- 结构型智能科技的关键可行性——信息型智能向结构型智能的转变(修改提纲)

刘海东刘海东

人工智能机器学习算法

结构型智能科技的关键可行性——信息型智能向结构型智能的转变1.信息型智能科技概述1.1传统计算机科技的信息型继承者1.2信息型智能环境1.3信息型智能主体1.4机器学习创造的智能1.5信息型智能科技的缺陷2.结构型智能科技概述2.1传统计算机科技向生命结构的发展2.2结构型智能科技的环境2.3结构型智能科技创造的机器生命2.4结构型智能科技的科学性3.结构型智能科技的关键可行性——信息型智能向结构

- 多模态大模型:技术原理与实战 看清GPT的进化史和创新点

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

多模态大模型:技术原理与实战看清GPT的进化史和创新点1.背景介绍1.1人工智能的发展历程1.1.1早期人工智能1.1.2机器学习时代1.1.3深度学习的崛起1.2自然语言处理的演进1.2.1基于规则的方法1.2.2统计机器学习方法1.2.3深度学习方法1.3大语言模型的出现1.3.1Transformer架构的提出1.3.2GPT系列模型的发展1.3.3多模态大模型的兴起2.核心概念与联系2.1

- 【机器学习|学习笔记】组合特征(Feature Combinations)是提升模型性能、挖掘特征交互信息、增强非线性表达能力的有效手段。

努力毕业的小土博^_^

机器学习学习笔记机器学习学习笔记人工智能神经网络深度学习

【机器学习|学习笔记】组合特征(FeatureCombinations)是提升模型性能、挖掘特征交互信息、增强非线性表达能力的有效手段。【机器学习|学习笔记】组合特征(FeatureCombinations)是提升模型性能、挖掘特征交互信息、增强非线性表达能力的有效手段。文章目录【机器学习|学习笔记】组合特征(FeatureCombinations)是提升模型性能、挖掘特征交互信息、增强非线性表达

- R语言的软件开发工具

纪霁然

包罗万象golang开发语言后端

R语言的软件开发工具引言R语言因其强大的数据分析能力和丰富的统计包,自发布以来便广受欢迎。随着数据科学和分析的迅猛发展,R语言也逐渐成为数据分析、机器学习和统计建模领域的重要工具。为了更好地利用R语言进行软件开发,许多软件开发工具和环境应运而生。本文将深入探讨R语言的主要开发工具,帮助开发者更高效地进行数据处理和分析。1.R和RStudio基础R语言本身是一个用于统计计算和图形绘制的编程语言,而R

- 结合创新idea:机器学习+运筹优化=CCF高端局

Ai多利

机器学习人工智能

2024深度学习发论文&模型涨点之——机器学习+运筹优化机器学习是人工智能的一个分支,它使计算机系统能够从数据中学习并改进其性能,而无需进行明确的编程。运筹优化,也称为运筹学或运营管理,是应用数学的一个分支,它使用数学模型和算法来支持复杂决策过程的制定。机器学习与运筹优化的结合是一个前沿且活跃的研究领域,它们相互补充,为解决复杂问题提供了新的思路和方法。小编整理了一些机器学习+运筹优化【论文+代码

- Jupyter安装指南及Python配置

CodeWG

pythonjupyteridePython

Jupyter是一个非常流行的交互式计算环境,广泛用于数据分析、机器学习和科学计算等领域。本文将详细介绍如何安装Jupyter并配置Python环境。步骤1:安装Python首先,我们需要安装Python。请按照以下步骤进行操作:打开Python官方网站(https://www.python.org)并下载适用于您操作系统的最新版本的Python。运行下载的安装程序,并按照向导的指示进行安装。在安

- SAX解析xml文件

小猪猪08

xml

1.创建SAXParserFactory实例

2.通过SAXParserFactory对象获取SAXParser实例

3.创建一个类SAXParserHander继续DefaultHandler,并且实例化这个类

4.SAXParser实例的parse来获取文件

public static void main(String[] args) {

//

- 为什么mysql里的ibdata1文件不断的增长?

brotherlamp

linuxlinux运维linux资料linux视频linux运维自学

我们在 Percona 支持栏目经常收到关于 MySQL 的 ibdata1 文件的这个问题。

当监控服务器发送一个关于 MySQL 服务器存储的报警时,恐慌就开始了 —— 就是说磁盘快要满了。

一番调查后你意识到大多数地盘空间被 InnoDB 的共享表空间 ibdata1 使用。而你已经启用了 innodbfileper_table,所以问题是:

ibdata1存了什么?

当你启用了 i

- Quartz-quartz.properties配置

eksliang

quartz

其实Quartz JAR文件的org.quartz包下就包含了一个quartz.properties属性配置文件并提供了默认设置。如果需要调整默认配置,可以在类路径下建立一个新的quartz.properties,它将自动被Quartz加载并覆盖默认的设置。

下面是这些默认值的解释

#-----集群的配置

org.quartz.scheduler.instanceName =

- informatica session的使用

18289753290

workflowsessionlogInformatica

如果希望workflow存储最近20次的log,在session里的Config Object设置,log options做配置,save session log :sessions run ;savesessio log for these runs:20

session下面的source 里面有个tracing

- Scrapy抓取网页时出现CRC check failed 0x471e6e9a != 0x7c07b839L的错误

酷的飞上天空

scrapy

Scrapy版本0.14.4

出现问题现象:

ERROR: Error downloading <GET http://xxxxx CRC check failed

解决方法

1.设置网络请求时的header中的属性'Accept-Encoding': '*;q=0'

明确表示不支持任何形式的压缩格式,避免程序的解压

- java Swing小集锦

永夜-极光

java swing

1.关闭窗体弹出确认对话框

1.1 this.setDefaultCloseOperation (JFrame.DO_NOTHING_ON_CLOSE);

1.2

this.addWindowListener (

new WindowAdapter () {

public void windo

- 强制删除.svn文件夹

随便小屋

java

在windows上,从别处复制的项目中可能带有.svn文件夹,手动删除太麻烦,并且每个文件夹下都有。所以写了个程序进行删除。因为.svn文件夹在windows上是只读的,所以用File中的delete()和deleteOnExist()方法都不能将其删除,所以只能采用windows命令方式进行删除

- GET和POST有什么区别?及为什么网上的多数答案都是错的。

aijuans

get post

如果有人问你,GET和POST,有什么区别?你会如何回答? 我的经历

前几天有人问我这个问题。我说GET是用于获取数据的,POST,一般用于将数据发给服务器之用。

这个答案好像并不是他想要的。于是他继续追问有没有别的区别?我说这就是个名字而已,如果服务器支持,他完全可以把G

- 谈谈新浪微博背后的那些算法

aoyouzi

谈谈新浪微博背后的那些算法

本文对微博中常见的问题的对应算法进行了简单的介绍,在实际应用中的算法比介绍的要复杂的多。当然,本文覆盖的主题并不全,比如好友推荐、热点跟踪等就没有涉及到。但古人云“窥一斑而见全豹”,希望本文的介绍能帮助大家更好的理解微博这样的社交网络应用。

微博是一个很多人都在用的社交应用。天天刷微博的人每天都会进行着这样几个操作:原创、转发、回复、阅读、关注、@等。其中,前四个是针对短博文,最后的关注和@则针

- Connection reset 连接被重置的解决方法

百合不是茶

java字符流连接被重置

流是java的核心部分,,昨天在做android服务器连接服务器的时候出了问题,就将代码放到java中执行,结果还是一样连接被重置

被重置的代码如下;

客户端代码;

package 通信软件服务器;

import java.io.BufferedWriter;

import java.io.OutputStream;

import java.io.O

- web.xml配置详解之filter

bijian1013

javaweb.xmlfilter

一.定义

<filter>

<filter-name>encodingfilter</filter-name>

<filter-class>com.my.app.EncodingFilter</filter-class>

<init-param>

<param-name>encoding<

- Heritrix

Bill_chen

多线程xml算法制造配置管理

作为纯Java语言开发的、功能强大的网络爬虫Heritrix,其功能极其强大,且扩展性良好,深受热爱搜索技术的盆友们的喜爱,但它配置较为复杂,且源码不好理解,最近又使劲看了下,结合自己的学习和理解,跟大家分享Heritrix的点点滴滴。

Heritrix的下载(http://sourceforge.net/projects/archive-crawler/)安装、配置,就不罗嗦了,可以自己找找资

- 【Zookeeper】FAQ

bit1129

zookeeper

1.脱离IDE,运行简单的Java客户端程序

#ZkClient是简单的Zookeeper~$ java -cp "./:zookeeper-3.4.6.jar:./lib/*" ZKClient

1. Zookeeper是的Watcher回调是同步操作,需要添加异步处理的代码

2. 如果Zookeeper集群跨越多个机房,那么Leader/

- The user specified as a definer ('aaa'@'localhost') does not exist

白糖_

localhost

今天遇到一个客户BUG,当前的jdbc连接用户是root,然后部分删除操作都会报下面这个错误:The user specified as a definer ('aaa'@'localhost') does not exist

最后找原因发现删除操作做了触发器,而触发器里面有这样一句

/*!50017 DEFINER = ''aaa@'localhost' */

原来最初

- javascript中showModelDialog刷新父页面

bozch

JavaScript刷新父页面showModalDialog

在页面中使用showModalDialog打开模式子页面窗口的时候,如果想在子页面中操作父页面中的某个节点,可以通过如下的进行:

window.showModalDialog('url',self,‘status...’); // 首先中间参数使用self

在子页面使用w

- 编程之美-买书折扣

bylijinnan

编程之美

import java.util.Arrays;

public class BookDiscount {

/**编程之美 买书折扣

书上的贪心算法的分析很有意思,我看了半天看不懂,结果作者说,贪心算法在这个问题上是不适用的。。

下面用动态规划实现。

哈利波特这本书一共有五卷,每卷都是8欧元,如果读者一次购买不同的两卷可扣除5%的折扣,三卷10%,四卷20%,五卷

- 关于struts2.3.4项目跨站执行脚本以及远程执行漏洞修复概要

chenbowen00

strutsWEB安全

因为近期负责的几个银行系统软件,需要交付客户,因此客户专门请了安全公司对系统进行了安全评测,结果发现了诸如跨站执行脚本,远程执行漏洞以及弱口令等问题。

下面记录下本次解决的过程以便后续

1、首先从最简单的开始处理,服务器的弱口令问题,首先根据安全工具提供的测试描述中发现应用服务器中存在一个匿名用户,默认是不需要密码的,经过分析发现服务器使用了FTP协议,

而使用ftp协议默认会产生一个匿名用

- [电力与暖气]煤炭燃烧与电力加温

comsci

在宇宙中,用贝塔射线观测地球某个部分,看上去,好像一个个马蜂窝,又像珊瑚礁一样,原来是某个国家的采煤区.....

不过,这个采煤区的煤炭看来是要用完了.....那么依赖将起燃烧并取暖的城市,在极度严寒的季节中...该怎么办呢?

&nbs

- oracle O7_DICTIONARY_ACCESSIBILITY参数

daizj

oracle

O7_DICTIONARY_ACCESSIBILITY参数控制对数据字典的访问.设置为true,如果用户被授予了如select any table等any table权限,用户即使不是dba或sysdba用户也可以访问数据字典.在9i及以上版本默认为false,8i及以前版本默认为true.如果设置为true就可能会带来安全上的一些问题.这也就为什么O7_DICTIONARY_ACCESSIBIL

- 比较全面的MySQL优化参考

dengkane

mysql

本文整理了一些MySQL的通用优化方法,做个简单的总结分享,旨在帮助那些没有专职MySQL DBA的企业做好基本的优化工作,至于具体的SQL优化,大部分通过加适当的索引即可达到效果,更复杂的就需要具体分析了,可以参考本站的一些优化案例或者联系我,下方有我的联系方式。这是上篇。

1、硬件层相关优化

1.1、CPU相关

在服务器的BIOS设置中,可

- C语言homework2,有一个逆序打印数字的小算法

dcj3sjt126com

c

#h1#

0、完成课堂例子

1、将一个四位数逆序打印

1234 ==> 4321

实现方法一:

# include <stdio.h>

int main(void)

{

int i = 1234;

int one = i%10;

int two = i / 10 % 10;

int three = i / 100 % 10;

- apacheBench对网站进行压力测试

dcj3sjt126com

apachebench

ab 的全称是 ApacheBench , 是 Apache 附带的一个小工具 , 专门用于 HTTP Server 的 benchmark testing , 可以同时模拟多个并发请求。前段时间看到公司的开发人员也在用它作一些测试,看起来也不错,很简单,也很容易使用,所以今天花一点时间看了一下。

通过下面的一个简单的例子和注释,相信大家可以更容易理解这个工具的使用。

- 2种办法让HashMap线程安全

flyfoxs

javajdkjni

多线程之--2种办法让HashMap线程安全

多线程之--synchronized 和reentrantlock的优缺点

多线程之--2种JAVA乐观锁的比较( NonfairSync VS. FairSync)

HashMap不是线程安全的,往往在写程序时需要通过一些方法来回避.其实JDK原生的提供了2种方法让HashMap支持线程安全.

- Spring Security(04)——认证简介

234390216

Spring Security认证过程

认证简介

目录

1.1 认证过程

1.2 Web应用的认证过程

1.2.1 ExceptionTranslationFilter

1.2.2 在request之间共享SecurityContext

1

- Java 位运算

Javahuhui

java位运算

// 左移( << ) 低位补0

// 0000 0000 0000 0000 0000 0000 0000 0110 然后左移2位后,低位补0:

// 0000 0000 0000 0000 0000 0000 0001 1000

System.out.println(6 << 2);// 运行结果是24

// 右移( >> ) 高位补"

- mysql免安装版配置

ldzyz007

mysql

1、my-small.ini是为了小型数据库而设计的。不应该把这个模型用于含有一些常用项目的数据库。

2、my-medium.ini是为中等规模的数据库而设计的。如果你正在企业中使用RHEL,可能会比这个操作系统的最小RAM需求(256MB)明显多得多的物理内存。由此可见,如果有那么多RAM内存可以使用,自然可以在同一台机器上运行其它服务。

3、my-large.ini是为专用于一个SQL数据

- MFC和ado数据库使用时遇到的问题

你不认识的休道人

sqlC++mfc

===================================================================

第一个

===================================================================

try{

CString sql;

sql.Format("select * from p

- 表单重复提交Double Submits

rensanning

double

可能发生的场景:

*多次点击提交按钮

*刷新页面

*点击浏览器回退按钮

*直接访问收藏夹中的地址

*重复发送HTTP请求(Ajax)

(1)点击按钮后disable该按钮一会儿,这样能避免急躁的用户频繁点击按钮。

这种方法确实有些粗暴,友好一点的可以把按钮的文字变一下做个提示,比如Bootstrap的做法:

http://getbootstrap.co

- Java String 十大常见问题

tomcat_oracle

java正则表达式

1.字符串比较,使用“==”还是equals()? "=="判断两个引用的是不是同一个内存地址(同一个物理对象)。 equals()判断两个字符串的值是否相等。 除非你想判断两个string引用是否同一个对象,否则应该总是使用equals()方法。 如果你了解字符串的驻留(String Interning)则会更好地理解这个问题。

- SpringMVC 登陆拦截器实现登陆控制

xp9802

springMVC

思路,先登陆后,将登陆信息存储在session中,然后通过拦截器,对系统中的页面和资源进行访问拦截,同时对于登陆本身相关的页面和资源不拦截。

实现方法:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23