搭建三台高可用hadoop服务器集群

如果只有3台主机,可以按照如下规划来部署安装

weekend01 zookeeper journalnode namenode zkfc resourcemanager datanode

weekend02 zookeeper journalnode namenode zkfc resourcemanager datanode

weekend03 zookeeper journalnode datanode

hadoop2.0已经发布了稳定版本了,增加了很多特性,比如HDFS HA、YARN等。最新的hadoop-2.4.1又增加了YARN HA

注意:apache提供的hadoop-2.4.1的安装包是在32位操作系统编译的,因为hadoop依赖一些C++的本地库,所以如果在64位的操作上安装hadoop-2.4.1就需要重新在64操作系统上重新编译,建议第一次安装用32位的系统,我将编译好的64位的也上传到群共享里了,如果有兴趣的可以自己编译一下)

说明:

1.在hadoop2.0中通常由两个NameNode组成,一个处于active状态,另一个处于standby状态。Active NameNode对外提供服务,而Standby NameNode则不对外提供服务,仅同步active namenode的状态,以便能够在它失败时快速进行切换。

hadoop2.0官方提供了两种HDFS HA的解决方案,一种是NFS,另一种是QJM。这里我们使用简单的QJM。在该方案中,主备NameNode之间通过一组JournalNode同步元数据信息,一条数据只要成功写入多数JournalNode即认为写入成功。通常配置奇数个JournalNode

这里还配置了一个zookeeper集群,用于ZKFC(DFSZKFailoverController)故障转移,当Active NameNode挂掉了,会自动切换Standby NameNode为standby状态

2.hadoop-2.2.0中依然存在一个问题,就是ResourceManager只有一个,存在单点故障,hadoop-2.4.1解决了这个问题,有两个ResourceManager,一个是Active,一个是Standby,状态由zookeeper进行协调

首先要准备好三台服务器,安装和配置好所有需要的软件和配置

前期准备就不详细说了

1.修改Linux主机名

2.修改IP

3.修改主机名和IP的映射关系

######注意######如果你们公司是租用的服务器或是使用的云主机(如华为用主机、阿里云主机等)

/etc/hosts里面要配置的是内网IP地址和主机名的映射关系

4.关闭防火墙

5.ssh免登陆

6.安装JDK,配置环境变量等

接着我们配置ssh免密登录,我们要怎么配置免密登录呢?

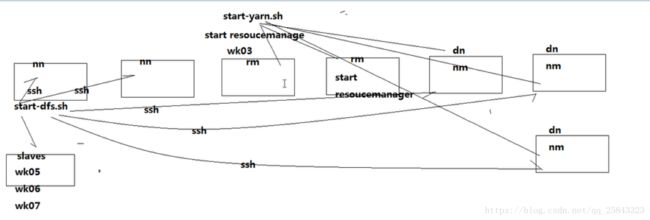

1)我们在一个namenode启动start脚本的时候,会ssh启动standby的namenode,然后读取一个文件查看slave的位置是哪里,然后一个一个去ssh启动datanode

2)我们启动yarn的一个resourcemanage的start脚本的时候,会ssh启动standby的resourcemanage,然后读取一个文件查看,然后一个一个去ssh'启动nodemanage

集群的安装步骤:

1.安装配置zooekeeper集群 --weekend01

1.1解压

tar -zxvf zookeeper-3.4.5.tar.gz -C /weekend/

1.2修改配置

cd /weekend/zookeeper-3.4.5/conf/

cp zoo_sample.cfg zoo.cfg

vim zoo.cfg

# The number of milliseconds of each tick

tickTime=2000

# The number of ticks that the initial

# synchronization phase can take

initLimit=10

# The number of ticks that can pass between

# sending a request and getting an acknowledgement

syncLimit=5

# the directory where the snapshot is stored.

# do not use /tmp for storage, /tmp here is just

# example sakes.

dataDir=/rootzookeeper/data

dataLogDir=/root/zookeeper/logs

# the port at which the clients will connect

clientPort=2181

# the maximum number of client connections.

# increase this if you need to handle more clients

#maxClientCnxns=60

#

# Be sure to read the maintenance section of the

# administrator guide before turning on autopurge.

#

# http://zookeeper.apache.org/doc/current/zookeeperAdmin.html#sc_maintenance

#

# The number of snapshots to retain in dataDir

#autopurge.snapRetainCount=3

# Purge task interval in hours

# Set to "0" to disable auto purge feature

#autopurge.purgeInterval=1

server.1=weekend01:2888:3888

server.2=weekend02:2888:3888

server.3=weekend03:2888:3888

保存退出

说明:

- dataDir 和 dataLogDir 需要在启动前创建完成

- clientPort 为 zookeeper的服务端口

- server.0、server.1、server.2 为 zk 集群中三个 node 的信息,定义格式为 hostname:port1:port2,其中 port1 是 node 间通信使用的端口,port2 是node 选举使用的端口,需确保三台主机的这两个端口都是互通的。

再创建一个空文件

touch /rootzookeeper/data/myid

最后向该文件写入ID

echo 1 > /rootzookeeper/data/myid

1.3将配置好的zookeeper拷贝到其他节点(首先分别在weekend02、weekend03根目录下创建一个weekend目录:mkdir /weekend)

scp -r /weekend/zookeeper-3.4.5/ weekend06:/weekend/

scp -r /weekend/zookeeper-3.4.5/ weekend07:/weekend/

注意:修改weekend02、weekend03对应/rootzookeeper/data/myid内容

weekend02:

echo 2 > /rootzookeeper/data/myid

weekend03:

echo 3 > /rootzookeeper/data/myid

更改日志配置

Zookeeper 默认会将控制台信息输出到启动路径下的 zookeeper.out 中,通过如下方法,可以让 Zookeeper 输出按尺寸切分的日志文件:

1)修改conf/log4j.properties文件,将

zookeeper.root.logger=INFO, CONSOLE

改为

zookeeper.root.logger=INFO, ROLLINGFILE

2)修改bin/zkEnv.sh文件,将

ZOO_LOG4J_PROP="INFO,CONSOLE"

改为

ZOO_LOG4J_PROP="INFO,ROLLINGFILE"

2.安装配置hadoop集群(在weekend01上操作)

2.1解压

tar -zxvf hadoop-2.4.1.tar.gz -C /weekend/

2.2配置HDFS(hadoop2.0所有的配置文件都在$HADOOP_HOME/etc/hadoop目录下)

#将hadoop添加到环境变量中

vim /etc/profile

export JAVA_HOME=/usr/java/jdk1.7.0_55

export HADOOP_HOME=/weekend/hadoop-2.4.1

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin

#hadoop2.0的配置文件全部在$HADOOP_HOME/etc/hadoop下

cd /home/hadoop/app/hadoop-2.4.1/etc/hadoop

2.2.1修改hadoo-env.sh

export JAVA_HOME=/uinnova/jdk1.7.0_80

2.2.2修改core-site.xml

2.2.3修改hdfs-site.xml

sshfence

shell(/bin/true)

2.2.4修改mapred-site.xml

2.2.5修改yarn-site.xml

2.2.6修改slaves(slaves是指定子节点的位置,因为要在weekend01上启动HDFS、在weekend03启动yarn,所以weekend01上的slaves文件指定的是datanode的位置,weekend03上的slaves文件指定的是nodemanager的位置)(因为这设计的都在同一台机器,所以设置的是一样的)

weekend01

weekend02

weekend03

2.2.7配置免密码登陆

#首先要配置weekend01到weekend02、weekend03的免密码登陆

#在weekend01上生产一对钥匙

ssh-keygen -t rsa

#将公钥拷贝到其他节点,包括自己

cd ./ssh

scp id_rsa.pub mask1:/home/zeng

ssh-coyp-id weekend01

ssh-coyp-id weekend02

ssh-coyp-id weekend03

#配置weekend02到weekend01、weekend03的免密码登陆

#在weekend03上生产一对钥匙

ssh-keygen -t rsa

#将公钥拷贝到其他节点

ssh-coyp-id weekend01

ssh-coyp-id weekend02

#注意:两个namenode之间要配置ssh免密码登陆,别忘了配置weekend02到weekend01的免登陆

在weekend02上生产一对钥匙

ssh-keygen -t rsa

ssh-coyp-id -i weekend01

2.4将配置好的hadoop拷贝到其他节点

scp -r /weekend/hadoop-2.4.1 / hadoop@weekend01:/weekend/

scp -r /weekend/hadoop-2.4.1 / hadoop@weekend2:/weekend/

scp -r /weekend/hadoop-2.4.1 / hadoop@weekend03:/weekend/

###注意:严格按照下面的步骤

2.5启动zookeeper集群(分别在weekend01、weekend02、weekend03上启动zk)

cd /home/hadoop/app/zookeeper-3.4.5/bin/

./zkServer.sh start

#查看状态:一个leader,两个follower

./zkServer.sh status

2.6启动journalnode(edis元数据日志)(分别在在weekend01、weekend02、weekend03上执行)

cd /home/hadoop/app/hadoop-2.4.1

sbin/hadoop-daemon.sh start journalnode

#运行jps命令检验,weekend01、weekend02、weekend03上多了JournalNode进程

natstat -nltp |grep 进程的端口

2.7格式化HDFS

#在weekend01上执行命令:

hdfs namenode -format

#格式化后会在根据core-site.xml中的hadoop.tmp.dir配置生成个文件,这里我配置的是/weekend/hadoop-2.4.1/tmp,然后将/weekend/hadoop-2.4.1/tmp拷贝到weekend02(namenode机器)的/weekend/hadoop-2.4.1/下。

scp -r tmp/ weekend02:/home/hadoop/app/hadoop-2.4.1/

##也可以这样,建议hdfs namenode -bootstrapStandby

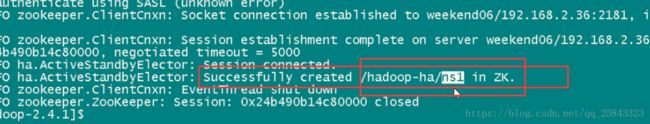

2.8格式化ZKFC(在weekend01上执行即可)(实际上是在zk上写一些数据节点,因为需要利用zk来做状态管理的)

hdfs zkfc -formatZK 初始化数据节点

2.9启动HDFS(在weekend01上执行)

sbin/start-dfs.sh

检查发现如果有dataNode没有启动起来,需要手动重启一下

2.10启动YARN(#####注意#####:是在weekend03上执行start-yarn.sh,把namenode和resourcemanager分开是因为性能问题,因为他们都要占用大量资源,所以把他们分开了,他们分开了就要分别在不同的机器上启动)

sbin/start-yarn.sh

到此,hadoop-2.4.1配置完毕,可以统计浏览器访问:

http://192.168.1.201:50070

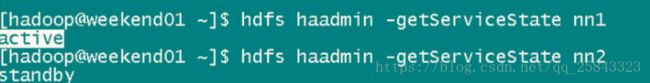

NameNode 'weekend01:9000' (active)

http://192.168.1.202:50070

NameNode 'weekend02:9000' (standby)

验证HDFS HA

首先向hdfs上传一个文件

hadoop fs -put /etc/profile /profile

hadoop fs -ls /

然后再kill掉active的NameNode

kill -9

通过浏览器访问:http://192.168.1.202:50070

NameNode 'weekend02:9000' (active)

这个时候weekend02上的NameNode变成了active在执行命令:

hadoop fs -ls /

-rw-r--r-- 3 root supergroup 1926 2014-02-06 15:36 /profile

刚才上传的文件依然存在!!!

手动启动那个挂掉的NameNode

sbin/hadoop-daemon.sh start namenode

通过浏览器访问:http://192.168.1.201:50070

NameNode 'weekend01:9000' (standby)

验证YARN:

运行一下hadoop提供的demo中的WordCount程序:

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.4.1.jar wordcount /profile /out

管理ha的指令

OK,大功告成!!!

测试集群工作状态的一些指令 :

bin/hdfs dfsadmin -report 查看hdfs的各节点状态信息

bin/hdfs haadmin -getServiceState nn1 获取一个namenode节点的HA状态

sbin/hadoop-daemon.sh start namenode 单独启动一个namenode进程

./hadoop-daemon.sh start zkfc 单独启动一个zkfc进程

如果是7台机器的集群规划:

主机名 IP 安装的软件 运行的进程

weekend01 192.168.1.201 jdk、hadoop NameNode、DFSZKFailoverController(zkfc)

weekend02 192.168.1.202 jdk、hadoop NameNode、DFSZKFailoverController(zkfc)

weekend03 192.168.1.203 jdk、hadoop ResourceManager

weekend04 192.168.1.204 jdk、hadoop ResourceManager

weekend05 192.168.1.205 jdk、hadoop、zk DataNode、NodeManager, ······································································JournalNode、QuorumPeerMain

weekend06 192.168.1.206 jdk、hadoop、zk DataNode、NodeManager、······································································JournalNode、QuorumPeerMain

weekend07 192.168.1.207 jdk、hadoop、zk DataNode、NodeManager、······································································JournalNode、QuorumPeerMain