无人驾驶失败案例汇总

慌不慌?无人驾驶的命案都在这儿!

原创: 陈潇慕 贝克街探案官 5天前

作者:陈潇慕

11月21日,也就在昨天,美国国家运输安全委员会(NTSB)公布了去年发生的一起Uber致命车祸案件的调查结果。

这起广为人知并牵动了所有关注无人驾驶的目光的案件,在时隔一年后终于画上了句号。调查结果显示,主责在驾驶员,Uber的自动驾驶系统所担责任并不主要。

这正应了那句老话:人定胜天。

但是大众和行业人士等待的并不仅仅只是这样一个调查结果,更多的,是期待一个指引无人驾驶未来发展和引导的方向。

作为无人驾驶的最大助力,5G的商用越来越近。而摆在大众和行业人士眼前的问题是,如何让无人驾驶能够切实地保障行车安全,并且有效降低目前人为驾驶的车祸概率,让无人驾驶真实发挥它的最大效用。

一方面是无人驾驶的概念和公司的宣传日益陡增,另一方面是政府监管部门和公众对于无人驾驶的安全性和可靠性的广泛质疑。二者意识流的不断冲突,其实是在促进整个无人驾驶行业的向前推进。

那么,无人驾驶在今后的时间里,将会朝着何方前进?

1.

命案何起?

2018年3月9日晚,美国亚利桑那州一条普通的公路。

一起并不寻常的车祸就这么发生了:一名女性在过马路时被一辆SUV撞到并最终死亡。它不寻常的一点在于,这辆撞人的SUV事发时是处于无人驾驶状态,而该无人驾驶系统由Uber开发。

尽管车内当时有一名安全驾驶员,但是车祸还是这么发生了。事发后,亚利桑那州警方要求Uber停止其无人驾驶项目。受到该影响,Uber在坦佩、旧金山、匹兹堡以及多伦多都停止了他们的无人驾驶项目。

这起事故,被认为是世界上第一起自动驾驶汽车撞人死亡案件。

事故一出,对于无人驾驶可靠性的争论又一次摆上台前。无人驾驶究竟是否能够满足要求?为何事故频出?作为无人驾驶系统的开发商是否应该承担责任?

NTSB在一年半后终于给出了答案,虽然这个答案并不完全。

NTSB调查认为,事故主因由于车内司机(即安全驾驶人)在事故发生前的几分钟内都在聚精会神地观看手机上的节目。过分的关注手机导致她在行人出现时无法及时反应做出规避动作,最终导致惨案的发生。

目前的无人驾驶系统在运行时需要依靠车内有人充当安全驾驶人,起到监督作用。“监控驾驶环境和自动驾驶系统的运行”,这是Uber在无人驾驶系统的使用手册里明确写明的。

但是当人开启无人驾驶后,系统并没有响应措施检测安全驾驶人是否在履行职责以及相应的减速停车措施。

因此最终NTSB认为司机承担主要责任,但是Uber也有责要担,需要进一步改进系统。换句话来说,当前的无人驾驶系统存在着非常多的漏洞。

NTSB某成员表示:“在我看来,Uber把技术进步放在拯救生命之前。”Uber对于无人驾驶没有安全计划和指导文件,也缺乏安全部门,没有专人负责安全部分。

在事故发生前的几周,Uber将无人驾驶开启时的安全驾驶人数要求从2降为1,其系统在车祸发生时也没有检测出行人的状态。

事故总是惨痛的。

在付出了人命的代价后才发现,监管部门在目前无人驾驶系统的开发和应用中起到的作用过于被动。只有在出事之后,才能起到调查事故的作用。

这起事故将无人驾驶系统的开发公司缺点暴露无遗。开发公司没有履行在开发过程中的安全监管职责,仅仅是在不断地意图削减系统成本以及降低使用局限。此举带来的后果,就是安全性能的不断下滑。

Uber等众多公司没有在开发过程中加大投入,以多次上路实际测试来检验开发的无人驾驶系统的可靠性。在没有相应法律的约束下,科技公司的行为体现地更多的是一种“良心”意识。

无人驾驶“撞死人”的调查结果,不是开始,也不是结束。

2.

频发的车祸

根据NTSB的调查,Uber的无人驾驶系统汽车在该事故发生前的18个月里,总计发生了37起车祸。

鉴于如今无人驾驶是否安全的讨论正处于风口浪尖,37起车祸这个数字无疑是反对派抨击无人驾驶的最好理由。

虽然在今年3月,亚利桑那州的法官判定Uber无需承担刑事责任,但是在事故发生的过程中,Uber的无人驾驶系统明显出现了判定太晚(撞车前1.2秒才判定出是人体)、安全驾驶人没有履行职责的情况下没有后备安全措施等失误。

Uber其实作为无人驾驶系统领域的后来者,车祸的数量已经是较少。而作为该领域的先行者,特斯拉无疑最具焦点。

早在2016年,美国的一辆特斯拉Model S汽车在途经十字路口时,自动驾驶系统未能准确地识别出在路口左转的白色卡车,导致特斯拉直接撞击而上从卡车底穿过,司机当场死亡。

事后特斯拉进行了详尽的调查,最终给出结论:主要是当时的情形特殊而导致的车祸发生。在强烈的日照条件下,驾驶员和自动驾驶系统都未能准确地识别出卡车的白色车身。日光的强烈反光使得Autopilot没有启动刹车系统,最终导致Model S直接从卡车底穿过。

这起车祸致死案件可能是第一例无人驾驶致死的车祸事件。

但这并不是特斯拉的唯一一次车祸。

就在Uber系统出事后的两个月,特斯拉的Model X在高速公路上行驶时,由于未能判定出公路上的隔离墩,导致Model X直接撞上,司机随后命陨公路。

事后的调查结果显示该起车祸的主要原因在于车主在发生碰撞前,足足有6秒钟时间没有握住方向盘,在系统警示后车主选择了无视。在Autopilot系统说明中,也明确写明了目前在高速行驶中可能无法识别出静止物体。

没过几天,一辆特斯拉在美国加州地区撞上了一辆巡逻警车,当时特斯拉正处于Autopilot系统控制中。所幸只是轻伤,没有人员伤亡。

但是这些事故都体现出哪怕是业内顶尖的无人驾驶系统开发者特斯拉,也在系统的智能性上存在重大问题。

无独有偶,各家自动驾驶公司事故层出不穷。

2018年1月,福特投资的Argo AI 公司在美国宾夕法尼亚州测试自动驾驶车时,与一辆货车发生碰撞。

5月份时,谷歌的Waymo自动驾驶汽车在亚利桑那州钱德勒市测试过程中,与一辆小轿车发生撞车事故。车祸造成无人驾驶车司机轻伤,车辆出现一定损毁。但该起事故完全由对方车辆担责。

谷歌在测试Waymo中错误百出。一辆测试车在时速只有2英里的情况下撞上了一辆巴士。这是一起无人驾驶车百分百担责的事故。

根据报告显示,在去年,谷歌的Waymo每9600公里就会发生一起事故,名列各家无人驾驶系统之首。

8月,苹果的自动驾驶系统测试时也跌下马来。其被一辆轿车追尾造成损坏。

回到国内,在蔚来正式上路后,苏州、广州等地区车祸频发。对于蔚来的主动安全和自动防撞系统是否真正有效,不论是使用者还是看客都十分怀疑。

细观各家无人驾驶系统发生的车祸事件,一部分是由于其他客观原因,但是也凸显出无人驾驶系统如今的主动安全性堪忧。

3.

扑朔迷离

无人驾驶系统在近两年开始频繁上路后,开始密集地进入到人们的视野中。

无人驾驶其实相对于人为驾驶,具有诸多优点。高度智能化的自动驾驶系统可以系统性的规避掉绝大部分车祸的发生,保证在绝对安全的范围内驾驶。并且这也符合未来智能化社会的发展规律。

但是摆在各家开发公司面前的困局是,在大环境如此针对的情形下,如何才能继续发展?

在Uber发生车祸命案后,彼时美国各地的无人驾驶车都被愤怒的民众恶意破坏。公众对于无人驾驶目前还处于怀疑状态,而各类车祸事件的发生更是加剧了这种怀疑。

无人驾驶开发公司如今在面对开发系统时,面对的窘境不止于此。无人驾驶系统没有大规模铺开的原因,既有目前系统成熟度还有待检测,另一方面是加装成本高昂,大部分公众无法负担。

以特斯拉的Autopilot系统为例,如Model 3车型在国内加装Autopilot系统的费用为4.8万元左右。这一数字对于很多购买者是无法负担的。

Uber在此次事件中被广泛批评的点也正在于对于设备成本的削减。将安全驾驶人的数量由2减为1,削减车身配置摄像头、传感器数量,降低雷达和红外线设备的等级。这一系列的措施,目的即在于Uber千方百计想削减当前无人驾驶系统的安装成本,否则价格太高没有车主装载,仅仅依靠投资人不断投资,开发之路会难以为继。

无人驾驶系统已经逐渐进入密集测试和上路阶段,但是频发的事故让监管部门对其日益关注。大洋彼岸的美国已经针对无人驾驶在拟定第四版相关规则,而我们还需要很长的路要走。也只有持之以恒的投入和监管,才能让公众对于无人驾驶日后的应用放下戒备的心态。

那些被自动驾驶“杀死”的人

原创: 陈念航 汽车之心 昨天

作者 / 陈念航

编辑 / 王德芙

出品 / 汽车之心(微信 ID:Auto-Bit)

法国哲学家阿尔伯特·加缪曾经说过,没有哪种死法比车祸更荒谬。然而 1960 年,加缪死于车祸。

半个多世纪过去了,这样的「随机性残忍」时有发生。

驾驶机动车已成为大多数成年人做的最危险的事情之一,2018 年,全球因车祸事故造成的死亡人数超过 140 万。

这几年自动驾驶在全球范围内燎原式发展,这一技术据称能消除 94% 由人为失误造成的车祸。

某种程度上,自动驾驶汽车有机会成为救命良方。但我们还没有走到那一步,自动驾驶的发展还处在中古时期,充满了太多的不确定性和未知。

我们缅怀这些在自动驾驶历史进程中,因为技术不够完善而遭遇不幸的人们,发展自动驾驶,每一个参与其中的人都应心存敬畏。

事故一

时间:2016 年 1 月 20 日

地点:京港澳高速河北邯郸段

事故车辆:2014 款白色特斯拉 Model S

罹难者:高雅宁(23 岁)

2016 年 1 月 20 日,京港澳高速河北邯郸段发生了一起追尾事故。

一辆特斯拉 Model S 直接撞上正在作业的道路清扫车,Model S 当场损毁,司机高雅宁不幸身亡。

根据车辆行车记录仪拍下的画面显示:

2016 年 1 月 20 日 14 时整,高雅宁驾驶车辆从河北邯郸入口进入高速,沿着左侧第一车道行驶。

当天天气晴好,车辆速度也不是很快,14 时 08 分,高雅宁还哼了几句歌。

14 时 09 分,行车记录仪的画面中可以看到前方的道路清扫车正在作业的指示灯,随后开在前面的黑色轿车向右并线到第二车道。

但高雅宁驾驶的特斯拉在距离道路清扫车越来越近时,没有进行减速或者变道,而是径直撞上了前方的道路清扫车。事故发生后,道路清扫车司机报了警。

经过警方的调查,他们发现在发生事故前,高雅宁驾驶的特斯拉轿车没有进行任何的紧急制动和躲避措施,直接发生了追尾事故。

事故发生时,高雅宁刚刚 23 岁,他的父亲高巨斌始终无法理解在行车记录仪里明明早就看到了道路清扫车,为什么儿子高雅宁既没有刹车也没有躲避而是直接撞了上去?

高巨斌介绍,高雅宁早在 2011 年就考取了驾照。

2013 年,他以大学生的身份参军入伍,在部队中担任大型军用车辆的驾驶员,一直表现优秀。在 2015 年 9 月,高雅宁复员回家。

事发后,高雅宁部队的战友和上级都表示,高雅宁的驾驶技术完全没问题,安全驾驶的公里数为几万公里。

既然是这样,为何高雅宁没有采取任何动作?父亲高巨斌表示:「如果不找找这个问题,孩子死不瞑目。」

于是高巨斌将这起事故的行车记录视频发给了一些专业人士进行分析,他们得出的一致结论是:这辆特斯拉当时应该处在定速的状态。

后续,特斯拉方面也承认车辆在事故发生前其 Autopilot 系统是开启的状态,这导致了高雅宁在高速上行驶时没有把注意力放在前方道路上,而且 Autopilot 系统也没有识别出前方的道路清扫车,最后导致了这起悲剧。

高雅宁是在 2014 年购买的特斯拉 Model S,当时车上并没有自动驾驶功能,但是相应的硬件已经配齐,包括 1 个前置的摄像头和 Mobileye EyeQ3 芯片负责视觉感知;车前方装配了一个非隐藏式毫米波雷达;车辆周身配备了 360 度超声波传感器。

2015 年 10 月,特斯拉开始向全球车主陆续推送 V7.0 版本的软件更新,Autopilot 的主要功能得以解锁,加入了自动车道保持、自动变道和自动泊车三大辅助驾驶功能。Autopilot 也成为特斯拉着力宣传的卖点。

事故发生的 2016 年 1 月,Autopilot 系统在大部分情况下能够较好识别路况(包括车道线和其他车辆的位置)并进行处置。

但是针对锥桶、行人这样的小型障碍物,系统还识别不了。这起事故中,Autopilot 系统没有识别到前方的道路清扫车,所以在碰撞前没有采取任何措施。

2016 年 7 月,高雅宁的家人将特斯拉的经销商起诉至北京市朝阳区人民法院,要求赔偿损失 10000 元,理由是特斯拉在其自动驾驶系统尚不完善过关的情况下仍然通过诱导宣传让用户信任这套系统,应该承担相应的法律责任。

针对赔偿金额,高雅宁家人的代理律师表示,赔偿的多少并不是本案所追求的目的,而是通过这起案件带来一些社会价值:

让公众知道目前自动驾驶的缺陷,希望特斯拉公司能够在宣传、产品营销过程中有一个慎重的态度,不要把自动驾驶作为吸引年轻人的卖点。

在高雅宁事故之后,特斯拉的 Autopilot 系统似乎进入到了事故的怪圈中,接二连三出现开启 Autopilot 功能后致死致伤、车辆财产损失的事故。

这起事故在发生之后很长一段时间里,没有被太多报道,致使公众对这起事故的认知少之又少。

后来我们知道,2016 年 5 月 7 日发生在美国佛罗里达州的特斯拉 Autopilot 致死事故引起了广泛关注,被称为「全球范围内第一起自动驾驶致死事故」。

但事实上,高雅宁案要比之更早,但在当时只被认为是一起普通追尾事故,没有引起自动驾驶业内足够的重视和警惕,这是非常令人遗憾的。

事故二

时间:2016 年 5 月 7 日

地点:美国佛罗里达州 Wiliston 27 号高速

事故车辆:2015 款黑色特斯拉 Model S

罹难者:Joshua Brown(40 岁)

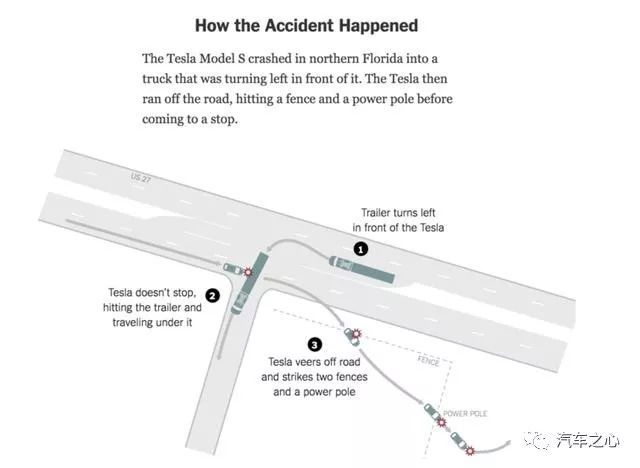

时间来到 2016 年 5 月 7 日,距离高雅宁事故发生不到 4 个月后,在美国佛罗里达州一段没有完全封闭的高速公路上,40 岁的俄亥俄州居民 Joshua Brown 驾驶的一辆 2015 款黑色特斯拉 Model S,撞上了一辆正在左拐的拖挂式卡车。

Joshua Brown 是一位狂热的特斯拉粉、科技爱好者,为自己的爱车取名「Tessy」。他经常在 Youtube 上发一些与特斯拉有关的视频,是个小有影响力的视频博主。

他曾经在推特上发布了一段特斯拉 Autopilot 系统帮助他避免一场车祸的视频,还得到了 Elon Musk 的转推。

据 Brown 的邻居回忆,Brown 曾跟她聊天时谈到:「如果有幸能得到 Elon Musk 的关注,我死也值了。」

没想到一语成谶。

事故那天天气晴好,头顶是蓝天白云,心情不错的 Joshua Brown 驾驶着他心爱的 Model S 飞驰在佛罗里达州 27 号高速上。

他开启了车上的 Autopilot 系统,将自适应巡航的速度调至每小时 74 英里。因为对 Autopilot 系统足够信任,他没有将全部注意力放在车辆前方的道路上。

差不多时间,货运司机 Frank Baressi 驾驶着他的白色拖挂式卡车也行驶在 27 号高速上,但他在 Joshua Brown 的对向车道上。

行至一个路口时,Frank Baressi 进行左转准备下高速。就在这时,Joshua Brown 和他的特斯拉 Model S 都没有注意到前方正在转弯的的白色卡车。

在没有任何反应的情况下,Model S 朝着卡车车厢撞了上去,车辆挡风玻璃首先撞上车厢底部,车顶被掀掉后从卡车车厢底部穿出,因为速度过快,Model S 还连撞了几个道路围栏、树木还有电话亭后才最终停下。

Joshua Brown 在这场车祸中丧生。

一个鲜为人知的细节是,卡车司机 Frank Baressi 后来向美联社回忆,事故发生后当他靠近事故车时,听见车里正在播放电影《哈利·波特》,当时警察也在事故车上找到了一台便携式的 DVD 播放机。

若他所言为真,这就解释了为什么 Joshua Brown 在碰撞发生前没有进行任何接管车辆和踩刹车的动作。

这起致死事故引发了全球范围的关注,面对铺天盖地的报道和讨论,特斯拉再也不能像处理高雅宁案那样镇定自若了。

针对这起事故,特斯拉在其官方博客发表了声明,他们认为这起事故的特殊之处在于:拖挂车正在横穿公路,且车身较高,这一情况导致了 Model S 的前挡风玻璃与挂车底部首先发生撞击。

假使当时车辆发生的是正面撞击或追尾事故,即便在高速行驶条件下,Model S 的防撞系统都极有可能避免人员伤亡的发生。

特斯拉同时强调,每一次自动驾驶启动时,车辆都会提醒驾驶员「请始终握住方向盘,准备随时接管」。

言下之意就是 Joshua Brown 并未按照系统的提示手握方向盘,所以特斯拉系统不负主要责任。

而针对车辆系统未检测到白色的拖挂卡车车厢、AEB 系统也没有及时起作用的情况,特斯拉的供应商 Mobileye 也发布了官方声明:

「当前的防碰撞技术或者自动紧急制动系统 AEB 的设计,是为了防止与前车车尾的碰撞。在这起事故中,涉及到对横向行驶车辆的处理,不属于这一代 AEB 的设计目标。」

就此将事故责任与自己撇清。

汽车之心基于多位业内专业人士的分析认为:

在 Joshua Brown 的事故中,毫米波雷达已经检测到前方卡车车厢的存在,但它无法判断车厢的高度,结合视觉感知把卡车白色的「车厢」当成了天上的「白云」,最终系统倾向认为车厢是一块悬在道路上方的路牌。

2017 年 1 月 20 日,美国 NHTSA 给出的事故最终结论是:

没有足够有力的证据表明特斯拉的自动驾驶系统直接导致了 Joshua Brown 的不幸,将不会对任何一辆特斯拉进行召回。至此,为期 8 个月的事故调查告一段落。

这起事故受到了全球关注和讨论,也带来了一些深远的影响。

特斯拉和 Mobileye 在这起事故后的 2 个月宣布合作关系破裂,Mobileye 将不再向特斯拉供应 EyeQ 芯片以及相应的视觉算法。

特斯拉对此的解释是 Mobileye 难以跟上其产品的发展步伐,双方分手不可避免;还有传闻说是特斯拉想自己开发视觉算法而 Mobileye 不同意才导致双方关系破裂。

后来的故事大家都知道,特斯拉转向与英伟达进行合作,并且在视觉算法上转向自研,内部成立 Tesla Vision 团队。

2016 年 10 月,特斯拉还发布了全新的 Autopilot 2.0 版本硬件:

英伟达 Drive PX2 芯片;12 个超声波雷达;1 个毫米波雷达;8 个全车摄像头(三目前视、正侧方、侧后方、后置摄像头)。

另一方面,2016 年 7 月特斯拉在中国的经销商被高雅宁家属告上法庭,加上佛罗里达事故被全球关注——双重压力下,2016 年 8 月份,特斯拉中文官网将「自动驾驶」改为「自动辅助驾驶」。

特斯拉中国公司员工还需接受额外培训,在演示相关功能时,必须将双手放在方向盘上。

之后很长一段时间,特斯拉 Autopilot 没有出过大问题。

但在当地时间 2018 年 3 月 1 日,一起与 Joshua Brown 事故如出一辙的悲剧又发生了。

事故三

时间:2018 年 3 月 1 日

地点:美国佛罗里达州棕榈滩

事故车辆:红色特斯拉 Model 3

罹难者:Jeremy Banner

3 月 1 日,Jeremy Banner 从睡梦中醒来,开上他的红色特斯拉 Model 3,沿着佛罗里达的大沼泽地的边缘向南行驶,车窗外的沼泽和农田快速掠过。

他轻拨了两下方向盘下的操纵杆,车内响起提示音,他启动了车上的 Autopilot 系统。

行至一处路口的时,Banner 没能发现正前方有一辆拖挂卡车正穿过四车道的高速公路,Model 3 的 Autopilot 系统也没有注意到,车辆以 109 公里的时速撞了上去,车顶直接被掀翻,这位有三个孩子的 50 岁父亲当场死亡。

这次事故的场景与 2016 年 5 月发生的 Joshua Brown 事故如出一辙,两年的时间,特斯拉 Autopilot 依然对这样的驾驶场景束手无策。

这一特殊场景,值得所有自动驾驶研发公司进行针对性研究。

Banner 的家人根据佛罗里达州的《非正常死亡法案》起诉了特斯拉,要求产品责任索赔。

前文我们提到,特斯拉针对 2016 年 5 月份发生的事故曾经声明:车辆与拖挂卡车车厢底部相撞后直接穿过去的情况是「极其少见」的。但同样的事故,在特斯拉身上已经发生了两起。

事实是,在美国,这样场景的事故每年都会发生几百起,而且基本都是撞向车厢的侧面然后从底部钻了出来,但是业界一直没有采取有效措施来避免类似的事故。

后来,有一些创业者提出一些改进措施,就是在拖挂卡车的车厢两侧安装一个类似于护翼的装置,能够避免车辆在撞向卡车车厢侧面时窜入车底而引发更大的伤害。

人们给这样的装置起了一个很美好的名字「AngelWings(天使之翼)」。

![]()

2017 年,IIHS 针对 AngelWings 装置进行了测试,在车辆时速 35-40 英里时表现良好。

事故四

时间:2018 年 3 月 18 日

地点:美国亚利桑那州坦佩市

事故车辆:Uber 自动驾驶测试车

罹难者:Elaine Herzberg(49 岁)

同样在 3 月,Uber 自动驾驶测试车致死事故引发了全球行业震荡。

在一个看似寻常的周日晚上,一辆基于 2017 款沃尔沃 XC90 打造的 Uber 自动驾驶汽车正在亚利桑那州坦佩的一条既定路线进行道路测试,车辆驾驶位上是一名 44 岁的白人女性,她是这辆车的安全员。

晚上 9 时 39 分,这辆车开启了自动驾驶模式,系统接管了所有操作。19 分钟后,车辆撞上了一位正推着自行车横穿马路的白人女性 Elaine Herzberg 并致其死亡。这是全球第一起自动驾驶测试车撞死行人事故。

事故发生的道路有 4 条车道,Uber 的自动驾驶汽车行驶在最右侧的车道上,道路两侧是有路灯的。

但是 Elaine Herzberg 选择横穿马路的地方并不是斑马线区域,而且正好是路灯照不太到的位置。她推着车从左至右穿行,在快要穿过马路时,Uber 的自动驾驶车撞倒了她。

车上的自动驾驶系统以及安全员都没有及时发挥作用,导致被撞者身亡。车内的摄像头录下的视频显示,碰撞前几秒,安全员还低头往右下方看了两眼。

Uber 为这辆车配备了前向、后向、内视摄像头共 10 枚摄像头,还有毫米波雷达以及激光雷达,车内还集成了计算单元和数据存储单元。

而且,沃尔沃在出厂前也为这辆车配备了一系列驾驶辅助功能,其中包括 AEB 系统。但是 Uber 的设计逻辑是,一旦其自动驾驶系统接管了车辆,这辆 XC90 本身具备的一些驾驶辅助功能就无法使用。

美国 NTSB 针对这起事故发布了两份调查报告,汽车之心对其关键信息进行提取发现:

在碰撞前 6 秒,车上的毫米波雷达和激光雷达检测到了前方行人的存在,当时车辆的时速是 43 英里。随着行人和车辆越来越接近,自动驾驶系统不断改变其判断「结果」:

-

碰撞发生前 5.2 秒,系统将 Herzberg 划归为「未知物体」;

-

碰撞发生前 4.2 秒,系统又将 Herzberg 重新归类为「车辆」;

-

碰撞发生前 3.8-2.7 秒的时间段中,软件的分类功能在「车辆」与「未知物体」的分类结果中跳动了好多次;

-

碰撞发生前 2.6 秒,系统又变了,将 Herzberg 和她的自行车识别为「自行车」;

-

碰撞发生前 1.5 秒,Herzberg 被识别为「未知物体」;

-

碰撞发生前 1.2 秒,Herzberg 又被识别成了「自行车」;

碰撞前 1.2 秒时,Herzberg 进入了测试车的行车路线,自动系统才反应过来需要进行紧急制动。

但在这关键的 1.2 秒时间里,因为 Uber 方面为系统设置了一个紧急情况动作抑制程序,需要花费 1 秒钟时间来执行,所以车辆最后虽然进行了制动但已于事无补,Herzberg 被撞时车辆速度是每小时 39 英里。

Uber 后来解释,在系统中加入动作抑制程序是因为担心在车辆进行测试时会系统频繁误报,给车辆带来一些不必要的紧急制动。

致死事故发生后,Uber 叫停了在美国坦佩、匹兹堡、旧金山和多伦多等城市的自动驾驶汽车测试。

7 月底,Uber 宣布终止开发自动驾驶卡车,从而把精力更加聚焦到自动驾驶乘用车上。

8 月份,Uber 重新开启自动驾驶乘用车路测,但在一段时间内车辆必须由人工驾驶,主要是为算法训练和地图收集信息数据。

而且,为了让这项技术重回公众视野,Uber 在前美国国家交通安全局主席及交通专家的指导下,展开了大规模的「安全检查」。

这起事故对于 Uber 自动驾驶来说,无疑是沉重的打击。但是人命关天,Uber 的教训也为全世界范围来所进行的自动驾驶研发和测试敲响了警钟。

诸多企业甚至因此调整了开发策略,叫停了自动驾驶路测转而更专心于打磨技术,丰田便是其中之一。

事故五

时间:2018 年 3 月 23 日

地点:美国加州山景城 101 高速

事故车辆:2017 款蓝色特斯拉 Model X P100D

罹难者:黄伟伦(38 岁)

当人们还未从 Uber 自动驾驶致死案中缓过神来,特斯拉 Autopilot 又出事了。

3 月 23 日周五上午 9 时 27 分,38 岁的苹果工程师黄伟伦(Walter Huang)驾驶着他的 2017 款特斯拉 Model X P100D 行驶在加州山景城的 101 号高速上,正往南开。

加州 101 号高速山景城段有 6 条向南的车道,其中最左侧的多乘员车道(HOV)正好连着 85 号州际公路。

两条公路的分流处有建好的混凝土隔离带进行分隔,隔离带上装有碰撞减速装置(Crash Attenuator),目的就是为了减小车辆撞上隔离带的冲击力,避免更大的伤害。

但就在 3 月 12 日,该隔离带发生了一次车祸,当时是一辆丰田普锐斯以时速 75 英里的速度撞上隔离带。

所幸,车上的安全带和安全气囊以及隔离带的碰撞减速装置同时发挥作用,普锐斯车主幸免于难。该事故发生后,隔离带上的碰撞减速装置因为各种原因迟迟没有修复好。

当黄伟伦驾驶着特斯拉在 101 号高速左起第二车道上行驶时,根据车上的行车数据显示,黄伟伦当时开启了 Autopilot 系统,车辆正在进行自适应巡航,速度设定为每小时 75 英里。

美国 NTSB 在 2018 年 6 月发布的一份初步调查报告中称:

黄伟伦的特斯拉在事故发生前 8 秒,以每小时 65 英里的速度跟在另一辆车后面;1 秒钟后,特斯拉开始向左行驶,同时仍然跟在那辆车后面。

但在事故发生前的 4 秒钟,特斯拉已经不再跟随前方车辆,在撞击前 3 秒,车辆加速到大约 71 英里每小时,最终撞上了碰撞减速装置破损的隔离带。根据 NTSB 对该车记录的性能数据的总结,没有检测到碰撞前的刹车或规避转向动作。

因撞击力太大,特斯拉车身发生了逆时针旋转,致使前车身结构和与车辆后部分离。

车辆在撞击后因电池承压过大而起火,黄伟伦被困在车内,一旁的群众将他从起火的车中转移出来并联系救护车将其送到最近的医院。

不幸的是,黄伟伦因伤势过重而不治身亡。

事故还导致了后续两辆车的追尾,马自达车主轻微受伤、奥迪车主无大碍。

事故后,特斯拉发布声明称,发生碰撞前 6 秒没有检测到驾驶员的手有触碰过方向盘,驾驶员约有 5 秒时间、距离 150 米 的无遮挡视野,可以看到混凝土隔离带和坏掉的碰撞减速装置。

特斯拉的言下之意就是,事故与己无关,是驾驶员黄伟伦没有专心看路,未能及时接管车辆踩下刹车才酿成了致命事故。

特斯拉方面还认为,破损的碰撞减速装置加重了撞击的严重性。

黄伟伦家属对特斯拉发起了诉讼,原告律师在声明中表示,事发时特斯拉的系统误读了车道线,未能发现混凝土隔离带,未能及时刹车。

原告律师声称,特斯拉利用客户真实驾驶来对其系统进行测试,导致妻子失去了丈夫,两个孩子失去了父亲。遇难者家人希望通过诉讼,防止这种悲剧再次发生在其他特斯拉车主的身上。

黄伟伦于 2017 年 11 月入职苹果,而后购买了特斯拉 Model X 庆祝。按照特斯拉 Autopilot 硬件的装车时间,这款车上至少是 Autopilot 2.0 版本硬件,甚至有可能是 Autopilot 2.5 版本硬件,其软件能力也已进化至 V8 版本。

按理说,从硬件和软件的配置来看,车辆不应该出现偏离车道的情形,而且车上配备的 AEB 系统,也应该在碰撞前进行紧急制动,但最终的结果是这些主动安全系统没有发挥作用。

为了验证这起车祸是否为偶然,另一名特斯拉车主以身试险,进行了一次还原测试。这位特斯拉车主在芝加哥一条高速公路上找到了和事故路段几乎完全相同的路况。

他在开启自动驾驶模式后,车速保持在每小时 59 英里,而当接近一处岔口时汽车仪表盘开始预警,提示司机将双手放到方向盘上,车辆随后径直驶向了分岔路中央的隔离带。

好在司机注意力集中,及时人为完成刹车制动,汽车勉强停在隔离带前。

从这次还原测试来看,特斯拉 Autopilot 系统在面对这样的驾驶场景时,确实会出现偏离车道的问题,这无疑是系统致命的缺陷。

这也暴露出特斯拉在算法层面针对这样的场景的测试并不够完善。

对于这样不够完善的系统,黄伟伦和之前多位特斯拉车主一样,太过于信任它,最终酿成了悲剧。