- 蚂蚁集团可转正实习算法岗内推-自然语言

飞300

业界资讯自然语言处理

具备极佳的工程实现能力,精通C/C++、Java、Pvthon、Perl等至少一门语言:对目前主流的深度学习平台:tensorflow、pytorch、mxnet等,至少对其中一个有上手经验;熟悉深度学习以及常见机器学习算法的原理与算法,能熟练运用聚类、分类、回归、排序等模型解决有挑战性的问题,有大数据处理的实战经验;有强烈求知欲,对人工智能领域相关技术有热情,内推链接:https://u.ali

- 深圳传音控股AI算法岗内推

飞300

人工智能pythonjava业界资讯

1扎实的数学基础,熟练掌握机器学习相关的数学知识。2熟悉常用的机器学习算法,掌握常用的深度学习模型与编程实践。3熟悉Pytorch或TensorFlow等深度学习框架,有一定项目经验。4良好的沟通协调能力,执着的专业精神。5参与部门AI创新项目,包括自动化测试平台、BPM流程管理等项目开发登录链接:transsion.zhiye.com/campus/jobs填写我的推荐码:EVHPB3投递,简历

- 基于NLP的客户意见分析:从数据到洞察

Echo_Wish

Python算法Python笔记自然语言处理人工智能

友友们好!我的新专栏《Python进阶》正式启动啦!这是一个专为那些渴望提升Python技能的朋友们量身打造的专栏,无论你是已经有一定基础的开发者,还是希望深入挖掘Python潜力的爱好者,这里都将是你不可错过的宝藏。在这个专栏中,你将会找到:●深入解析:每一篇文章都将深入剖析Python的高级概念和应用,包括但不限于数据分析、机器学习、Web开发等。●实战案例:通过丰富的实战案例,带你一步步实现

- R语言机器学习系列-随机森林回归代码解读

Mrrunsen

R语言大学作业机器学习回归r语言

回归问题指的是因变量或者被预测变量是连续性变量的情形,比如预测身高体重的具体数值是多少的情形。整个代码大致可以分为包、数据、模型、预测评估4个部分,接下来逐一解读。1、包部分,也就是加载各类包,包括随机森林包randomForest,数据相关包tidyverse、skimr、DataExplorer,模型评估包caret。2、数据部分,主要是读取数据,处理缺失值,转换变量类型。3、模型部分。为了对

- 神经网络VS决策树

Persistence is gold

神经网络决策树人工智能

神经网络(NeuralNetworks)和决策树(DecisionTrees)是两种不同的机器学习算法,各自具有独特的优点和适用场景。以下是它们的详细比较:神经网络优点:强大的学习能力:神经网络,尤其是深度神经网络,能够自动学习数据中的复杂特征,可以处理高维和非线性的问题。适用性广泛:神经网络适用于分类、回归、图像处理、语音识别、自然语言处理等多种任务。多层结构:通过增加隐藏层,神经网络可以逐层提

- 深度神经网络——决策树的实现与剪枝

知来者逆

人工智能dnn决策树人工智能神经网络深度学习机器学习

概述决策树是一种有用的机器学习算法,用于回归和分类任务。“决策树”这个名字来源于这样一个事实:算法不断地将数据集划分为越来越小的部分,直到数据被划分为单个实例,然后对实例进行分类。如果您要可视化算法的结果,类别的划分方式将类似于一棵树和许多叶子。这是决策树的快速定义,但让我们深入了解决策树的工作原理。更好地了解决策树的运作方式及其用例,将帮助您了解何时在机器学习项目中使用它们。决策树的结构决策树的

- 【Gaussian Model】高斯分布模型

HP-Succinum

机器学习机器学习算法人工智能

目录高斯分布模型用于异常检测(GaussianModelforAnomalyDetection)1.高斯分布简介2.高斯分布模型用于异常检测(1)训练阶段:估计数据分布(2)检测阶段:计算概率判断异常点3.示例代码4.高斯分布异常检测的优缺点优点缺点5.适用场景6.结论高斯分布模型用于异常检测(GaussianModelforAnomalyDetection)在数据分析和机器学习任务中,异常检测(

- 深入浅出地理解-随机森林与XGBoost模型

HP-Succinum

机器学习随机森林集成学习机器学习

目录一、决策树的不足与集成学习的优势1.1决策树的缺点1.2集成学习:通过集成多个模型提升稳定性二、随机森林:通过多棵决策树减少方差2.1随机森林的基本原理2.2随机森林的优势2.3随机森林的参数调整三、XGBoost:高效且强大的Boosting方法3.1Boosting的基本原理3.2XGBoost的优化3.3XGBoost的优点四、随机森林与XGBoost的对比五、总结在机器学习的实战中,决

- 芯科科技通过全新并发多协议SoC重新定义智能家居连接

电子科技圈

SiliconLabs智能家居边缘计算mcu物联网iot人工智能机器学习

MG26系列SoC现已全面供货,为开发人员提供最高性能和人工智能/机器学习功能致力于以安全、智能无线连接技术,建立更互联世界的全球领导厂商SiliconLabs(亦称“芯科科技”,NASDAQ:SLAB),日前宣布其MG26系列无线片上系统(SoC)现已通过芯科科技及其分销合作伙伴全面供货。作为业界迄今为止最先进、高性能的Matter和并发多协议解决方案,MG26SoC的闪存和RAM容量是芯科科技

- 【Python编程】Python交互式应用框架巅峰对决 —— Streamlit vs Gradio

木亦汐丫

Python编程StreamlitGradioJupyterHuggingFacePandasPyTorchTensorFlow

Streamlit和Gradio都是非常受欢迎的Python交互式应用框架,但在构建Python交互式Web应用时该如何选择?它们各有独特的设计理念和适用场景,以下是基于功能特性、开发效率和应用场景的对比分析:一、核心定位与功能对比特性GradioStreamlit核心目标快速部署机器学习模型交互界面构建数据科学和复杂交互应用输入/输出支持支持文本、图像、音频、视频等基础组件支持更丰富的交互组件(

- 机器学习平台系列(一) - 初探 Jupyter Notebook 认证机制

窝窝和牛牛

机器学习平台PythonJupyterNotebookJupyterHub安全多租户

最近准备调研下JupyterNotebook的单用户安全机制(认证)以及如何实现多租户,以便集成到公司的云平台,进而作为基于大数据平台的机器学习平台的一部分。1.问题分析数据分析以及算法团队的同学使用JupyterNotebook进行数据分析和建模等工作,其工作流程如下所示:业务部门以组为单位申请一台物理服务器搭建Python环境,启动JupyterNotebook,每个同学创建自己的工程,进行代

- 《机器学习实战:从数据清洗到云端部署的可视化进阶指南(三)》

庸俗今天不摸鱼

机器学习人工智能python

▍前言:阶段核心突破当前已完成模型开发与优化升级核心任务,成功将理论模型转化为工业级解决方案。本阶段基于前期标准化数据,实现从基础模型构建到高性能算法迭代的跨越式发展。▍章节回顾:攻坚与优化成果3.模型开发阶段算法实现:逻辑回归:搭建分类基线(LogisticRegression,准确率基准)支持向量机:对比线性核与RBF核性能差异(F1-score提升12%)K近邻:动态优化邻居数(k=5时验证

- 2025全球机器学习技术大会即将召开:汇聚全球AI顶尖专家,共话未来技术趋势

量子位

由CSDN与Boolan联合主办的「2025全球机器学习技术大会」(MLSummit2025)将于4月18日至19日在上海虹桥西郊庄园丽笙大酒店隆重举行。本次大会汇聚全球AI领域的顶级学者、行业领袖和技术专家,共同探讨大模型技术演进、智能体、代码大模型、多模态技术等前沿话题,为参会者提供全方位的技术解读与行业洞察。大会亮点:顶级嘉宾阵容,前沿议题聚焦本次大会的主会环节将邀请多位全球AI领域的重量级

- 详解:Grok中文版 _Grok 3 国内中文版本在线使用

人工智能

GrokAI是由XAI公司推出的一款尖端人工智能系统。作为该公司核心技术之一,GrokAI专注于推动人工智能在各行各业的实际应用,尤其在数据分析、自然语言处理(NLP)、自动化决策、机器学习等领域表现出色。Grok的最大亮点在于其强大的数据处理能力。它能够高效地从大量复杂数据中提取有价值的信息,并做出精准预测。借助深度学习与强化学习等先进技术,GrokAI具备自我学习的能力,可以通过不断的训练来优

- 【好书推荐7】《机器学习平台架构实战》

是Yu欸

粉丝福利机器学习架构人工智能awsk8sdocker

【好书推荐7】《机器学习平台架构实战》写在最前面《机器学习平台架构实战》编辑推荐内容简介作者简介目录前言本书读者内容介绍充分利用本书下载示例代码文件下载彩色图像本书约定你好呀!我是是Yu欸2024每日百字篆刻时光,感谢你的陪伴与支持~欢迎一起踏上探险之旅,挖掘无限可能,共同成长!写在最前面感谢大家的陪伴和支持,2024年争取每周二开展粉丝福利送书活动,欢迎关注~第7波福利感谢清华出版社的大力支持本

- Python 机器学习 基础 之 模型评估与改进 【评估指标与评分】的简单说明

仙魁XAN

Python机器学习基础+实战案例python机器学习模型评估与改进评估指标与评分召回率

Python机器学习基础之模型评估与改进【评估指标与评分】的简单说明目录Python机器学习基础之模型评估与改进【评估指标与评分】的简单说明一、简单介绍二、评估指标与评分1、牢记最终目标2、二分类指标1)错误类型2)不平衡数据集3)混淆矩阵4)考虑不确定性5)准确率-召回率曲线6)受试者工作特征(ROC)与AUC3、多分类指标4、回归指标5、在模型选择中使用评估指标附录一、参考文献一、简单介绍Py

- 基于hive的电信离线用户的行为分析系统

赵谨言

论文经验分享毕业设计

标题:基于hive的电信离线用户的行为分析系统内容:1.摘要随着电信行业的快速发展,用户行为数据呈现出海量、复杂的特点。为了深入了解用户行为模式,提升电信服务质量和精准营销能力,本研究旨在构建基于Hive的电信离线用户行为分析系统。通过收集电信用户的通话记录、上网行为、短信使用等多源数据,利用Hive数据仓库工具进行数据存储和处理,采用数据挖掘和机器学习算法对用户行为进行分析。实验结果表明,该系统

- 【精华推荐】AI大模型学习必逛的十大顶级网站

大模型入门学习

人工智能学习大模型入门llama大模型教程大模型学习大模型

随着人工智能技术的快速发展,AI大模型(如GPT-3、BERT等)在自然语言处理、计算机视觉等领域取得了显著的成果。对于希望深入学习AI大模型的开发者和研究者来说,找到合适的学习资源至关重要。本文将为大家推荐十大必备网站,帮助你更好地理解和应用AI大模型。1.CourseraCoursera是一个在线学习平台,提供各类AI和机器学习课程,包括斯坦福大学的机器学习课程和深度学习专项课程。通过视频讲解

- 【大模型学习】第八章 深入理解机器学习技术细节

好多渔鱼好多

AI大模型机器学习AI大模型人工智能

目录引言一、监督学习(SupervisedLearning)1.定义与工作原理2.常见任务3.应用场景示例:房价预测二、无监督学习(UnsupervisedLearning)1.定义与工作原理2.常见任务3.应用场景示例:客户细分三、强化学习(ReinforcementLearning)1.定义与工作原理2.常见应用场景3.应用场景示例:游戏AI四、集成学习(EnsembleLearning)1.

- Milvus 数据批量导入实战:Python代码解析

修破立生

Milvusmilvuspython人工智能

1引言在处理大规模数据的存储和检索时,向量数据库逐渐成为一种热门的解决方案。Milvus作为一款高性能的向量数据库,在人工智能、机器学习等领域有着广泛的应用。本文将介绍如何使用Python代码将数据批量导入到Milvus数据库中,通过实际的代码示例来帮助大家理解导入过程和相关的技术要点。2代码功能概述我们的代码主要实现了从本地文件读取数据,并将其批量导入到Milvus数据库的功能。代码涉及到命令行

- L1与L2正则化:防止过拟合的双刃剑

XianxinMao

人工智能人工智能机器学习算法

标题:L1与L2正则化:防止过拟合的双刃剑文章信息摘要:L1和L2正则化是防止机器学习模型过拟合的两种关键技术。L1正则化(Lasso)通过将不重要的特征权重归零来实现特征选择,适用于稀疏模型和高维数据集,但可能导致欠拟合。L2正则化(Ridge)则通过减少权重的大小来防止过拟合,适用于处理高度相关特征和噪声数据,提高模型稳定性。两者各有优势,选择哪种正则化技术取决于数据集特性和模型需求。有时,结

- 手写数字识别项目:从原理到实践

北屿升:

微信新浪微博facebook微信公众平台百度

在当今数字化时代,手写数字识别作为模式识别和人工智能领域的重要应用,有着广泛的用途,如邮政信封上的邮编识别、银行支票上的数字处理等。本文将详细介绍手写数字识别项目的相关内容,包括原理、数据集、实现步骤和应用前景。一、手写数字识别原理手写数字识别主要依赖于模式识别和机器学习技术。其基本原理是将手写数字的图像转换为计算机能够处理的数字信号,然后通过特征提取和分类算法来判断该数字的具体值。常用的特征提取

- Python从0到100(十八):面向对象编程应用

是Dream呀

python开发语言

前言:零基础学Python:Python从0到100最新最全教程。想做这件事情很久了,这次我更新了自己所写过的所有博客,汇集成了Python从0到100,共一百节课,帮助大家一个月时间里从零基础到学习Python基础语法、Python爬虫、Web开发、计算机视觉、机器学习、神经网络以及人工智能相关知识,成为学习学习和学业的先行者!欢迎大家订阅专栏:零基础学Python:Python从0到100最新

- 智能云图库项目实战(4)---空间模块

rain雨雨编程

项目实战权限管理锁机制事务云图库Spring

♂️个人主页:@rain雨雨编程微信公众号:rain雨雨编程✍作者简介:持续分享机器学习,爬虫,数据分析希望大家多多支持,我们一起进步!如果文章对你有帮助的话,欢迎评论点赞收藏加关注+目录本节重点一、需求分析二、方案设计空间的必要性空间库表设计1.空间表2、图片表公共图库和空间的关系三、后端开发空间管理1、数据模型2、基础服务开发3、接口开发用户创建私有空间1、创建空间流程2、创建空间服务扩展知

- 【西瓜书《机器学习》七八九章内容通俗理解】

游戏乐趣

人工智能机器学习人工智能

第七章:贝叶斯分类器7.1贝叶斯决策论基础核心概念:贝叶斯分类器是基于概率来做分类决策的。简单来说,就是根据已知的一些条件,去计算每个类别出现的概率,然后选择概率最大的那个类别作为分类结果。就好比你在猜一个盒子里装的是红球还是蓝球,你可以根据之前从这个盒子里摸球的一些经验(比如摸出红球的次数多),来判断这次盒子里更有可能是红球还是蓝球。例子:假如你要判断一幅图片是猫还是狗。你知道在所有的图片数据里

- 机器学习笔记

有涯小学生

赵卫东机器学习笔记机器学习人工智能

1概述1.1简介机器学习(MachineLearning)是计算机科学的子领域,也是人工智能的一个分支和实现方式。“对于某类任务T和性能度量P,如果一个计算机程序在T上以P衡量的性能随着经验E而自我完善,那么就称这个计算机程序在从经验E学习。”(汤姆·米切尔(TomMitchell),1997,MachineLearning)1.2机器学习、人工智能、数据挖掘从本质上看,数据科学的目标是通过处理各

- 机器学习—赵卫东阅读笔记(一)

走在考研路上

深度学习了解机器学习笔记人工智能

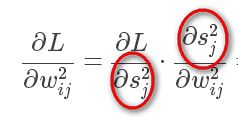

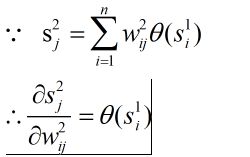

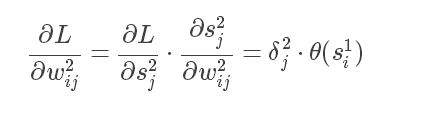

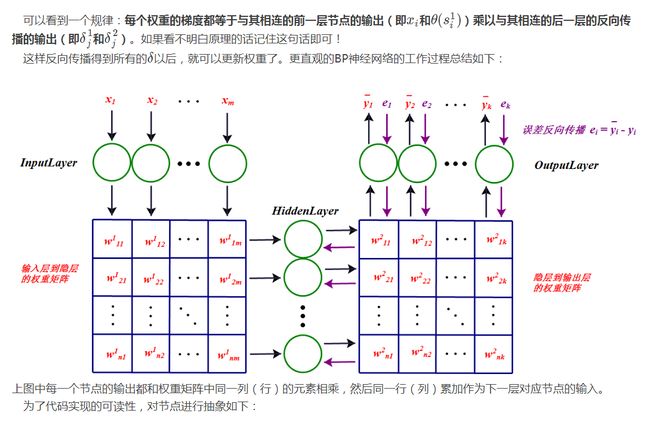

第一章:机器学习基础1.1.2机器学习主要流派1.符号主义2.贝叶斯分类——基础是贝叶斯定理3.联结主义——源于神经学,主要算法是神经网络。——BP算法:作为一种监督学习算法,训练神经网络时通过不断反馈当前网络计算结果与训练数据之间的误差来修正网络权重,使误差足够小。4.进化计算——通过迭代优化,找到最佳结果。——具有自组织、自适应、自学习的特性,能够有效处理传统优化算法难以解决的复杂问题(例如N

- Python在机器学习与数据分析领域的深度应用:从基础到实战

CodeJourney.

python算法

在当今数字化时代,数据如同宝贵的矿产资源,蕴含着无尽的价值等待挖掘。Python作为一门强大而灵活的编程语言,凭借其丰富的库和工具,在机器学习和数据分析领域扮演着举足轻重的角色。它不仅为数据科学家和开发者提供了高效处理和分析数据的手段,还助力构建各种智能模型,实现精准预测和决策支持。本文将深入探讨Python在机器学习和数据分析领域的应用,涵盖机器学习基础概念、Pandas库的使用技巧、数据分析实

- Python神器 Jupyter Notebook

懒大王爱吃狼

pythonpython开发语言Python基础python学习服务器

JupyterNotebook是Python领域中备受推崇的一款神器,以下是对其的详细介绍:一、概述JupyterNotebook是一款开放源代码的Web应用程序,它允许用户创建和共享包含实时代码、方程式、可视化和叙述文本的文档。它适用于数据分析、可视化、机器学习等多种场景,尤其在数据科学领域中广受欢迎。二、安装与配置JupyterNotebook可以通过多种方式进行安装,其中最常见的是通过安装A

- 费曼学习法11 - NumPy 的 “线性代数” 之力:矩阵运算与应用 (应用篇)

修昔底德

Python费曼学习法线性代数学习numpypython人工智能深度学习

第六篇:NumPy的“线性代数”之力:矩阵运算与应用(应用篇)开篇提问:考虑一个实际问题:图像的旋转。当你使用图像编辑软件旋转照片时,背后是什么在驱动图像像素的精确移动?答案是线性代数。图像可以表示为数值矩阵,而旋转、缩放、剪切等图像变换,都可以通过矩阵运算来实现。线性代数不仅是图像处理的基石,也在机器学习、物理模拟、工程计算等众多领域扮演着核心角色。它提供了一套强大的数学工具,用于描述和解决多维

- LeetCode[Math] - #66 Plus One

Cwind

javaLeetCode题解AlgorithmMath

原题链接:#66 Plus One

要求:

给定一个用数字数组表示的非负整数,如num1 = {1, 2, 3, 9}, num2 = {9, 9}等,给这个数加上1。

注意:

1. 数字的较高位存在数组的头上,即num1表示数字1239

2. 每一位(数组中的每个元素)的取值范围为0~9

难度:简单

分析:

题目比较简单,只须从数组

- JQuery中$.ajax()方法参数详解

AILIKES

JavaScriptjsonpjqueryAjaxjson

url: 要求为String类型的参数,(默认为当前页地址)发送请求的地址。

type: 要求为String类型的参数,请求方式(post或get)默认为get。注意其他http请求方法,例如put和 delete也可以使用,但仅部分浏览器支持。

timeout: 要求为Number类型的参数,设置请求超时时间(毫秒)。此设置将覆盖$.ajaxSetup()方法的全局

- JConsole & JVisualVM远程监视Webphere服务器JVM

Kai_Ge

JVisualVMJConsoleWebphere

JConsole是JDK里自带的一个工具,可以监测Java程序运行时所有对象的申请、释放等动作,将内存管理的所有信息进行统计、分析、可视化。我们可以根据这些信息判断程序是否有内存泄漏问题。

使用JConsole工具来分析WAS的JVM问题,需要进行相关的配置。

首先我们看WAS服务器端的配置.

1、登录was控制台https://10.4.119.18

- 自定义annotation

120153216

annotation

Java annotation 自定义注释@interface的用法 一、什么是注释

说起注释,得先提一提什么是元数据(metadata)。所谓元数据就是数据的数据。也就是说,元数据是描述数据的。就象数据表中的字段一样,每个字段描述了这个字段下的数据的含义。而J2SE5.0中提供的注释就是java源代码的元数据,也就是说注释是描述java源

- CentOS 5/6.X 使用 EPEL YUM源

2002wmj

centos

CentOS 6.X 安装使用EPEL YUM源1. 查看操作系统版本[root@node1 ~]# uname -a Linux node1.test.com 2.6.32-358.el6.x86_64 #1 SMP Fri Feb 22 00:31:26 UTC 2013 x86_64 x86_64 x86_64 GNU/Linux [root@node1 ~]#

- 在SQLSERVER中查找缺失和无用的索引SQL

357029540

SQL Server

--缺失的索引

SELECT avg_total_user_cost * avg_user_impact * ( user_scans + user_seeks ) AS PossibleImprovement ,

last_user_seek ,

- Spring3 MVC 笔记(二) —json+rest优化

7454103

Spring3 MVC

接上次的 spring mvc 注解的一些详细信息!

其实也是一些个人的学习笔记 呵呵!

- 替换“\”的时候报错Unexpected internal error near index 1 \ ^

adminjun

java“\替换”

发现还是有些东西没有刻子脑子里,,过段时间就没什么概念了,所以贴出来...以免再忘...

在拆分字符串时遇到通过 \ 来拆分,可是用所以想通过转义 \\ 来拆分的时候会报异常

public class Main {

/*

- POJ 1035 Spell checker(哈希表)

aijuans

暴力求解--哈希表

/*

题意:输入字典,然后输入单词,判断字典中是否出现过该单词,或者是否进行删除、添加、替换操作,如果是,则输出对应的字典中的单词

要求按照输入时候的排名输出

题解:建立两个哈希表。一个存储字典和输入字典中单词的排名,一个进行最后输出的判重

*/

#include <iostream>

//#define

using namespace std;

const int HASH =

- 通过原型实现javascript Array的去重、最大值和最小值

ayaoxinchao

JavaScriptarrayprototype

用原型函数(prototype)可以定义一些很方便的自定义函数,实现各种自定义功能。本次主要是实现了Array的去重、获取最大值和最小值。

实现代码如下:

<script type="text/javascript">

Array.prototype.unique = function() {

var a = {};

var le

- UIWebView实现https双向认证请求

bewithme

UIWebViewhttpsObjective-C

什么是HTTPS双向认证我已在先前的博文 ASIHTTPRequest实现https双向认证请求

中有讲述,不理解的读者可以先复习一下。本文是用UIWebView来实现对需要客户端证书验证的服务请求,网上有些文章中有涉及到此内容,但都只言片语,没有讲完全,更没有完整的代码,让人困扰不已。但是此知

- NoSQL数据库之Redis数据库管理(Redis高级应用之事务处理、持久化操作、pub_sub、虚拟内存)

bijian1013

redis数据库NoSQL

3.事务处理

Redis对事务的支持目前不比较简单。Redis只能保证一个client发起的事务中的命令可以连续的执行,而中间不会插入其他client的命令。当一个client在一个连接中发出multi命令时,这个连接会进入一个事务上下文,该连接后续的命令不会立即执行,而是先放到一个队列中,当执行exec命令时,redis会顺序的执行队列中

- 各数据库分页sql备忘

bingyingao

oraclesql分页

ORACLE

下面这个效率很低

SELECT * FROM ( SELECT A.*, ROWNUM RN FROM (SELECT * FROM IPAY_RCD_FS_RETURN order by id desc) A ) WHERE RN <20;

下面这个效率很高

SELECT A.*, ROWNUM RN FROM (SELECT * FROM IPAY_RCD_

- 【Scala七】Scala核心一:函数

bit1129

scala

1. 如果函数体只有一行代码,则可以不用写{},比如

def print(x: Int) = println(x)

一行上的多条语句用分号隔开,则只有第一句属于方法体,例如

def printWithValue(x: Int) : String= println(x); "ABC"

上面的代码报错,因为,printWithValue的方法

- 了解GHC的factorial编译过程

bookjovi

haskell

GHC相对其他主流语言的编译器或解释器还是比较复杂的,一部分原因是haskell本身的设计就不易于实现compiler,如lazy特性,static typed,类型推导等。

关于GHC的内部实现有篇文章说的挺好,这里,文中在RTS一节中详细说了haskell的concurrent实现,里面提到了green thread,如果熟悉Go语言的话就会发现,ghc的concurrent实现和Go有点类

- Java-Collections Framework学习与总结-LinkedHashMap

BrokenDreams

LinkedHashMap

前面总结了java.util.HashMap,了解了其内部由散列表实现,每个桶内是一个单向链表。那有没有双向链表的实现呢?双向链表的实现会具备什么特性呢?来看一下HashMap的一个子类——java.util.LinkedHashMap。

- 读《研磨设计模式》-代码笔记-抽象工厂模式-Abstract Factory

bylijinnan

abstract

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

package design.pattern;

/*

* Abstract Factory Pattern

* 抽象工厂模式的目的是:

* 通过在抽象工厂里面定义一组产品接口,方便地切换“产品簇”

* 这些接口是相关或者相依赖的

- 压暗面部高光

cherishLC

PS

方法一、压暗高光&重新着色

当皮肤很油又使用闪光灯时,很容易在面部形成高光区域。

下面讲一下我今天处理高光区域的心得:

皮肤可以分为纹理和色彩两个属性。其中纹理主要由亮度通道(Lab模式的L通道)决定,色彩则由a、b通道确定。

处理思路为在保持高光区域纹理的情况下,对高光区域着色。具体步骤为:降低高光区域的整体的亮度,再进行着色。

如果想简化步骤,可以只进行着色(参看下面的步骤1

- Java VisualVM监控远程JVM

crabdave

visualvm

Java VisualVM监控远程JVM

JDK1.6开始自带的VisualVM就是不错的监控工具.

这个工具就在JAVA_HOME\bin\目录下的jvisualvm.exe, 双击这个文件就能看到界面

通过JMX连接远程机器, 需要经过下面的配置:

1. 修改远程机器JDK配置文件 (我这里远程机器是linux).

- Saiku去掉登录模块

daizj

saiku登录olapBI

1、修改applicationContext-saiku-webapp.xml

<security:intercept-url pattern="/rest/**" access="IS_AUTHENTICATED_ANONYMOUSLY" />

<security:intercept-url pattern=&qu

- 浅析 Flex中的Focus

dsjt

htmlFlexFlash

关键字:focus、 setFocus、 IFocusManager、KeyboardEvent

焦点、设置焦点、获得焦点、键盘事件

一、无焦点的困扰——组件监听不到键盘事件

原因:只有获得焦点的组件(确切说是InteractiveObject)才能监听到键盘事件的目标阶段;键盘事件(flash.events.KeyboardEvent)参与冒泡阶段,所以焦点组件的父项(以及它爸

- Yii全局函数使用

dcj3sjt126com

yii

由于YII致力于完美的整合第三方库,它并没有定义任何全局函数。yii中的每一个应用都需要全类别和对象范围。例如,Yii::app()->user;Yii::app()->params['name'];等等。我们可以自行设定全局函数,使得代码看起来更加简洁易用。(原文地址)

我们可以保存在globals.php在protected目录下。然后,在入口脚本index.php的,我们包括在

- 设计模式之单例模式二(解决无序写入的问题)

come_for_dream

单例模式volatile乱序执行双重检验锁

在上篇文章中我们使用了双重检验锁的方式避免懒汉式单例模式下由于多线程造成的实例被多次创建的问题,但是因为由于JVM为了使得处理器内部的运算单元能充分利用,处理器可能会对输入代码进行乱序执行(Out Of Order Execute)优化,处理器会在计算之后将乱序执行的结果进行重组,保证该

- 程序员从初级到高级的蜕变

gcq511120594

框架工作PHPandroidhtml5

软件开发是一个奇怪的行业,市场远远供不应求。这是一个已经存在多年的问题,而且随着时间的流逝,愈演愈烈。

我们严重缺乏能够满足需求的人才。这个行业相当年轻。大多数软件项目是失败的。几乎所有的项目都会超出预算。我们解决问题的最佳指导方针可以归结为——“用一些通用方法去解决问题,当然这些方法常常不管用,于是,唯一能做的就是不断地尝试,逐个看看是否奏效”。

现在我们把淫浸代码时间超过3年的开发人员称为

- Reverse Linked List

hcx2013

list

Reverse a singly linked list.

/**

* Definition for singly-linked list.

* public class ListNode {

* int val;

* ListNode next;

* ListNode(int x) { val = x; }

* }

*/

p

- Spring4.1新特性——数据库集成测试

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- C# Ajax上传图片同时生成微缩图(附Demo)

liyonghui160com

1.Ajax无刷新上传图片,详情请阅我的这篇文章。(jquery + c# ashx)

2.C#位图处理 System.Drawing。

3.最新demo支持IE7,IE8,Fir

- Java list三种遍历方法性能比较

pda158

java

从c/c++语言转向java开发,学习java语言list遍历的三种方法,顺便测试各种遍历方法的性能,测试方法为在ArrayList中插入1千万条记录,然后遍历ArrayList,发现了一个奇怪的现象,测试代码例如以下:

package com.hisense.tiger.list;

import java.util.ArrayList;

import java.util.Iterator;

- 300个涵盖IT各方面的免费资源(上)——商业与市场篇

shoothao

seo商业与市场IT资源免费资源

A.网站模板+logo+服务器主机+发票生成

HTML5 UP:响应式的HTML5和CSS3网站模板。

Bootswatch:免费的Bootstrap主题。

Templated:收集了845个免费的CSS和HTML5网站模板。

Wordpress.org|Wordpress.com:可免费创建你的新网站。

Strikingly:关注领域中免费无限的移动优

- localStorage、sessionStorage

uule

localStorage

W3School 例子

HTML5 提供了两种在客户端存储数据的新方法:

localStorage - 没有时间限制的数据存储

sessionStorage - 针对一个 session 的数据存储

之前,这些都是由 cookie 完成的。但是 cookie 不适合大量数据的存储,因为它们由每个对服务器的请求来传递,这使得 cookie 速度很慢而且效率也不