达观数据比赛 第三天任务

清明节结束,恢复上班日常啦。

【任务2.2】时长: 2天

学习word2vec词向量原理并实践,用来表示文本。

我们可以把word2vec模型简单化地看成是神经网络。如下图所示, 输入是一个one-hot向量,通过中间层(不含激活函数),输出层和输入层纬度一样

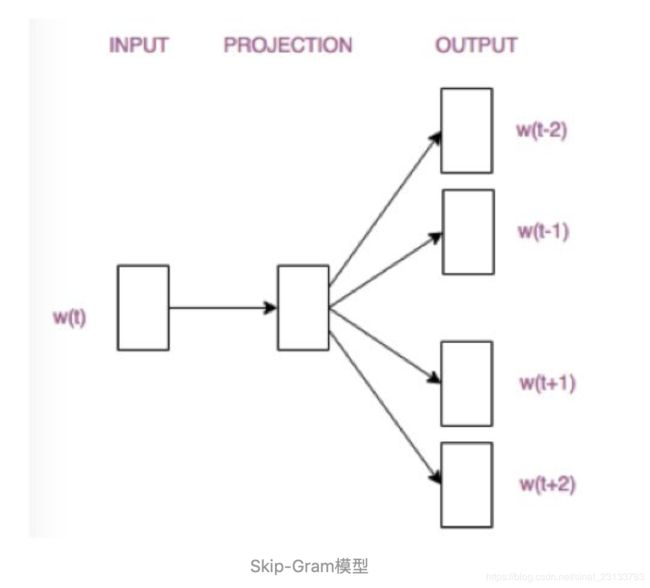

Word2Vec一般分为CBOW(Continuous Bag-of-Words )与Skip-Gram两种模型。CBOW模型的训练输入是某一个特征词的上下文相关的词对应的词向量,而输出就是这特定的一个词的词向量。Skip-Gram模型和CBOW的思路是反着来的,即输入是特定的一个词的词向量,而输出是特定词对应的上下文词向量。CBOW对小型数据库比较合适,而Skip-Gram在大型语料中表现更好。模型示意图如下所示:

在Python中,我们可以使用gensim库中的word2vec。函数中的参数如下所示:

sentences: 我们要分析的语料,可以是一个列表,或者从文件中遍历读出。后面我们会有从文件读出的例子。

size: 词向量的维度,默认值是100。这个维度的取值一般与我们的语料的大小相关,如果是不大的语料,比如小于100M的文本语料,则使用默认值一般就可以了。如果是超大的语料,建议增大维度。

window:即词向量上下文最大距离,这个参数在我们的算法原理篇中标记为cc,window越大,则和某一词较远的词也会产生上下文关系。默认值为5。在实际使用中,可以根据实际的需求来动态调整这个window的大小。如果是小语料则这个值可以设的更小。对于一般的语料这个值推荐在[5,10]之间。

sg: 即我们的word2vec两个模型的选择了。如果是0, 则是CBOW模型,是1则是Skip-Gram模型,默认是0即CBOW模型。

hs: 即我们的word2vec两个解法的选择了,如果是0, 则是Negative Sampling,是1的话并且负采样个数negative大于0, 则是Hierarchical Softmax。默认是0即Negative Sampling。

negative:即使用Negative Sampling时负采样的个数,默认是5。推荐在[3,10]之间。这个参数在我们的算法原理篇中标记为neg。

cbow_mean: 仅用于CBOW在做投影的时候,为0,则算法中的xwxw为上下文的词向量之和,为1则为上下文的词向量的平均值。在我们的原理篇中,是按照词向量的平均值来描述的。个人比较喜欢用平均值来表示xwxw,默认值也是1,不推荐修改默认值。

min_count:需要计算词向量的最小词频。这个值可以去掉一些很生僻的低频词,默认是5。如果是小语料,可以调低这个值。

iter: 随机梯度下降法中迭代的最大次数,默认是5。对于大语料,可以增大这个值。

alpha: 在随机梯度下降法中迭代的初始步长。算法原理篇中标记为ηη,默认是0.025。

min_alpha: 由于算法支持在迭代的过程中逐渐减小步长,min_alpha给出了最小的迭代步长值。随机梯度下降中每轮的迭代步长可以由iter,alpha, min_alpha一起得出。这部分由于不是word2vec算法的核心内容,因此在原理篇我们没有提到。对于大语料,需要对alpha, min_alpha,iter一起调参,来选择合适的三个值。

在学习完主要函数之后,我们在Pycharm中做了简单地尝试,代码如下:

导入所需要的库

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction.text import TfidfVectorizer

import gensim

import time

import pickle

import numpy as np

# read data

df = pd.read_csv('data/train_set.csv', nrows=5000)

def sentence2list(sentence):

return sentence.strip().split()

sentences_train = list(df.loc[:, 'word_seg'].apply(sentence2list))

sentences = sentences_train

model = gensim.models.Word2Vec(sentences=sentences, size=100, window=5, min_count=5, workers=8, sg=1, iter=5)

wv = model.wv

vocab_list = wv.index2word

word_idx_dict = {}

for idx, word in enumerate(vocab_list):

word_idx_dict[word] = idx

vectors_arr = wv.vectors

vectors_arr = np.concatenate((np.zeros(100)[np.newaxis, :], vectors_arr), axis=0) # 第0位置的vector为'unk'的vector

print(word_idx_dict)

print(vectors_arr)

f_wordidx = open('word_seg_word_idx_dict.pkl', 'wb')

f_vectors = open('word_seg_vectors_arr.pkl', 'wb')

pickle.dump(word_idx_dict, f_wordidx)

pickle.dump(vectors_arr, f_vectors)

f_wordidx.close()

f_vectors.close()

参考文献:

1. 简书 缺省之名 https://www.jianshu.com/p/471d9bfbd72f

2. 博客园 刘建平Pinard https://www.cnblogs.com/pinard/p/7278324.html

3. Github Heitao5200 https://github.com/Heitao5200/DGB/blob/master/feature/feature_code/train_word2vec.py