1.简述人工智能、机器学习和深度学习三者的联系与区别。

人工智能:它是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。

2. 全连接神经网络与卷积神经网络的联系与区别。

卷积神经网络也是通过一层一层的节点组织起来的。和全连接神经网络一样,卷积神经网络中的每一个节点就是一个神经元。在全连接神经网络中,每相邻两层之间的节点都有边相连,于是会将每一层的全连接层中的节点组织成一列,这样方便显示连接结构。而对于卷积神经网络,相邻两层之间只有部分节点相连,为了展示每一层神经元的维度,一般会将每一层卷积层的节点组织成一个三维矩阵。

除了结构相似,卷积神经网络的输入输出以及训练的流程和全连接神经网络也基本一致,以图像分类为列,卷积神经网络的输入层就是图像的原始图像,而输出层中的每一个节点代表了不同类别的可信度。这和全连接神经网络的输入输出是一致的。类似的,全连接神经网络的损失函数以及参数的优化过程也都适用于卷积神经网络。因此,全连接神经网络和卷积神经网络的唯一区别就是神经网络相邻两层的连接方式。

3.理解卷积计算。

以digit0为例,进行手工演算。

from sklearn.datasets import load_digits #小数据集8*8

digits = load_digits()

| 0 | 0 | 5 | 13 | 9 | 1 | 0 | 0 |

| 0 | 0 | 13 | 15 | 10 | 15 | 5 | 0 |

| 0 | 3 | 15 | 2 | 0 | 11 | 8 | 0 |

| 0 | 4 | 12 | 0 | 0 | 8 | 8 | 0 |

| 0 | 5 | 8 | 0 | 0 | 9 | 8 | 0 |

| 0 | 4 | 11 | 0 | 1 | 12 | 7 | 0 |

| 0 | 2 | 14 | 5 | 10 | 12 | 0 | 0 |

| 0 | 0 | 6 | 13 | 10 | 0 | 0 | 0 |

卷积核

结果:

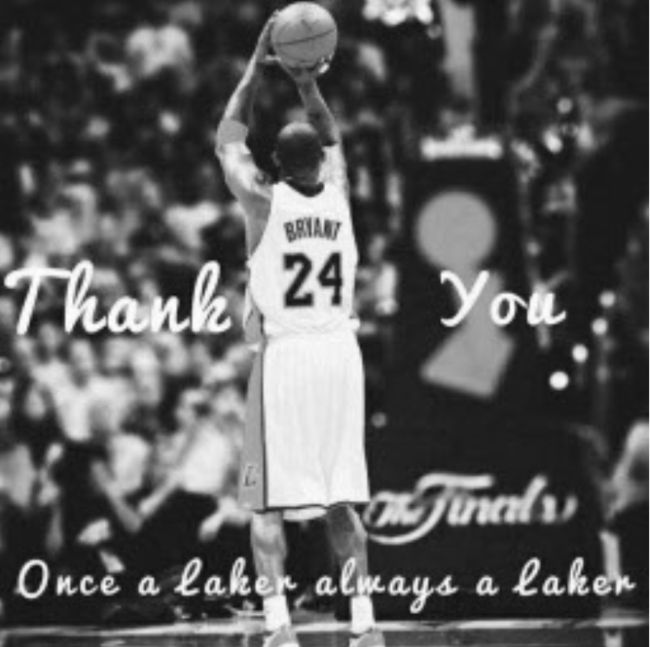

4.理解卷积如何提取图像特征。

读取一个图像;

以下矩阵为卷积核进行卷积操作;

显示卷积之后的图像,观察提取到什么特征。

| 1 | 0 | -1 |

| 1 | 0 | -1 |

| 1 | 0 | -1 |

| 1 | 1 | 1 |

| 0 | 0 | 0 |

| -1 | -1 | -1 |

| -1 | -1 | -1 |

| -1 | 8 | -1 |

| -1 | -1 | -1 |

卷积API

scipy.signal.convolve2d

tf.keras.layers.Conv2D

5. 安装Tensorflow,keras

参考:https://blog.csdn.net/u011119817/article/details/88309256

from scipy.signal import convolve2d import numpy as np from PIL import Image import matplotlib.pyplot as plt I=Image.open(r'G:\博客\timg.JFIF') I.show() L=I.convert('L') L.show() c=np.array(I) cg=np.array(L) k1=np.array([[1,0,-1],[1,0,-1],[1,0,-1]]) k2=np.array([[1,1,1],[0,0,0],[-1,-1,-1]]) k3=np.array([[-1,-1,-1],[-1,8,-1],[-1,-1,-1]]) duolaAmeng1=convolve2d(cg,k1,boundary='symm',mode='same') duolaAmeng2=convolve2d(cg,k2,boundary='symm',mode='same') duolaAmeng3=convolve2d(cg,k3,boundary='symm',mode='same') plt.matshow(duolaAmeng1) plt.show() plt.matshow(duolaAmeng2) plt.show() plt.matshow(duolaAmeng3) plt.show()

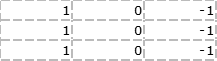

原图