ResNet神经网络简介与代码实战

1.介绍

ResNet(Residual Neural Network)由微软研究院的何恺明等四名华人提出,通过使用ResNet 单元训练出了152层的神经网络,并在ILSVRC2015比赛中取得冠军,在top5上的错误率为3.57%,同时参数量比VGGNet低,效果非常突出。具体可以参加论文“Deep Residual Learning for Image Recognition”。

2.模型结构

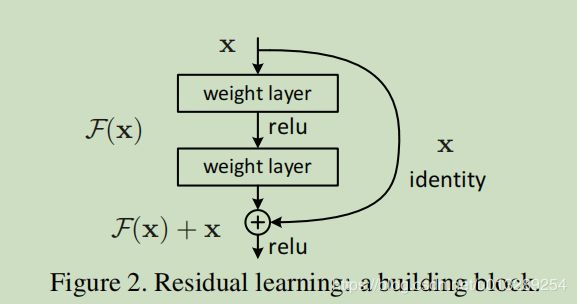

ResNet 单元

两层及三层的残差网络学习模块

3.模型特点

传统的卷积网络或者全连接网络在信息传递的时候或多或少会存在信息丢失,损耗等问题,同时还会产生梯度消失或者梯度爆炸问题,导致很深的网络无法训练。ResNet在一定程度上解决了这个问题(一个直观的表现,如果学习到的残差F(x)为0,网络层数就可以无限增加,因为传递的数据始终是x),通过直接将输入信息绕道传到输出,保护信息的完整性,整个网络只需要学习输入、输出差别的那一部分,简化学习目标和难度。

4.代码实现 keras

def Conv2d_a(x, nb_filter, kernel_size, padding='same', strides=(1, 1)):

x = Conv2D(nb_filter, kernel_size, padding=padding, strides=strides)(x)

x = BatchNormalization(axis=3)(x)

x = Activation('relu')(x)

return x

def Conv2d_b(x, nb_filter, kernel_size, padding='same', strides=(1, 1)):

x = Conv2D(nb_filter, kernel_size, padding=padding, strides=strides)(x)

return x

def Res_a(x, nb_filter=64):

res = x

res = Conv2d_a(res, nb_filter, (3, 3), padding='same', strides=(1, 1))

res = Conv2d_b(res, nb_filter, (3, 3), padding='same', strides=(1, 1))

y = Add()([res, x])

y = Activation('relu')(y)

return y

def Res_b(x, nb_filter=[64, 256]):

res = x

res = Conv2d_a(res, nb_filter[0], (1, 1), padding='same', strides=(1, 1))

res = Conv2d_a(res, nb_filter[0], (3, 3), padding='same', strides=(1, 1))

res = Conv2d_b(res, nb_filter[1], (1, 1), padding='same', strides=(1, 1))

y = Add()([res, x])

y = Activation('relu')(y)

return y