kinect 2的数据获取与深度相机的标定

我需要通过kinect 2获取深度信息 ,进而转化为点云进行点云预处理实现实时三维重构,获取深度相机的内参有利于提高三维重建的精度。要想获取kinect深度相机的内参,首先必须获取深度相机拍摄的图像,由深度相机拍摄的图像有深度图和红外图两种,深度图难以识别,所以我需要过去kinect的红外数据。(kinect 2里面有两个摄像头,一个是彩色相机,一个是深度相机,由于我只需要深度数据所以我只标定深度相机。)

标定原理:张正友标定法原理

标定工具:Matlab

1 Kinect数据获取

数据获取我参考了一位博主的代码,原博客链接:https://blog.csdn.net/jiaojialulu/article/details/53087988

该博客写得非常详细,代码完整,可以直接运行(为了能够保存红外图片,程序我在原基础上加了一行)。

1.1六种数据源

Kinect Data Sources – 6种数据源

- ColorFrameSource

彩色图 - InfraredFrameSource

红外图(16-bit) - DepthFrameSource

深度图(16-bit,单位:mm)

kinect采的深度数据是short型,即每个像素深度占2个字节,但是16位中只有12位是有用的,2^12 = 4096,单位是毫米,所以范围是4m - BodyIndexFrameSource

人物索引图(用一个字节代表人体,最多支持6个人体) - BodyFrameSource

人体关节图 - AudioSource

声音

1.2完整代码

#include "kinect.h"

#include (depthData[i] % 256);

// reinterpret_cast(i_depth.data)[i] = intensity;

//}

// 实际是16位unsigned int数据

hr = m_pDepthFrame->CopyFrameDataToArray(424 * 512, reinterpret_cast<UINT16*>(i_src_depth.data));

}

// infrared拷贝到图片中

if (SUCCEEDED(hr))

{

hr = m_pInfraredFrame->CopyFrameDataToArray(424 * 512, reinterpret_cast<UINT16*>(i_ir.data));

}

Mat i_rgb_resize = i_rgb.clone(); // 缩小方便看

cv::resize(i_rgb_resize, i_rgb_resize, Size(512, 424));

// 显示

imshow("rgb", i_rgb_resize);

if (waitKey(1) == VK_ESCAPE)

break;

imshow("i_src_depth", i_src_depth);

if (waitKey(1) == VK_ESCAPE)

break;

imshow("ir", i_ir);

if (waitKey(1) == VK_ESCAPE)

break;

imwrite("D:\\Document\\biaoding\\infrared20.tif", i_ir);//红外图保存路径吗,这个写入图片需要自己拍一张更改一下图片序号

// 释放资源

SafeRelease(m_pColorFrame);

SafeRelease(m_pDepthFrame);

SafeRelease(m_pInfraredFrame);

SafeRelease(m_pColorFrameReference);

SafeRelease(m_pDepthFrameReference);

SafeRelease(m_pInfraredFrameReference);

SafeRelease(m_pMultiFrame);

}

// 关闭窗口,设备

cv::destroyAllWindows();

m_pKinectSensor->Close();

std::system("pause");

return 0;

}

上面这个程序能获取彩色图、深度图和红外图三个种数据类型,我只保存红外图。

2 用openCV自制标定板

参考博客:https://blog.csdn.net/weixin_43053387/article/details/84957042

该博主生成的标定板没达到一边奇数一边偶数的要求(一边奇数一边偶数才能定位准确),我做了简单的修改,代码如下。

#include 3 用matlab标定

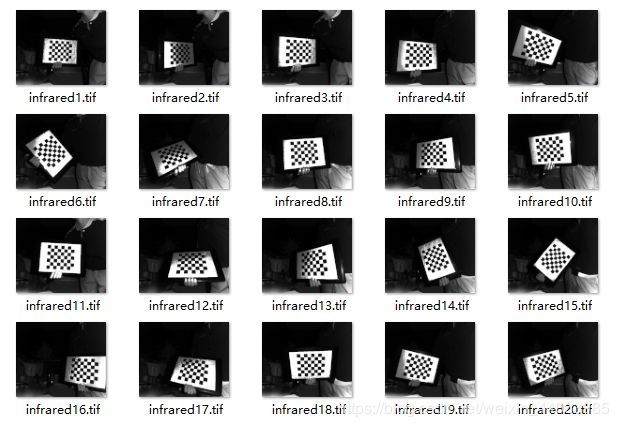

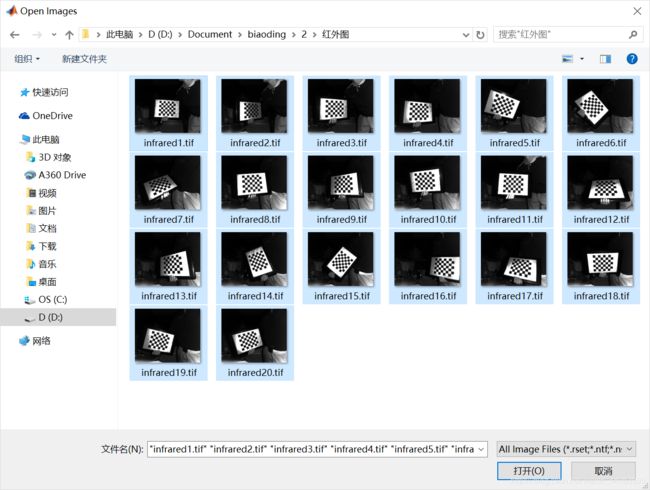

(1)用上面程序获得20张不同角度不同距离的红外照片

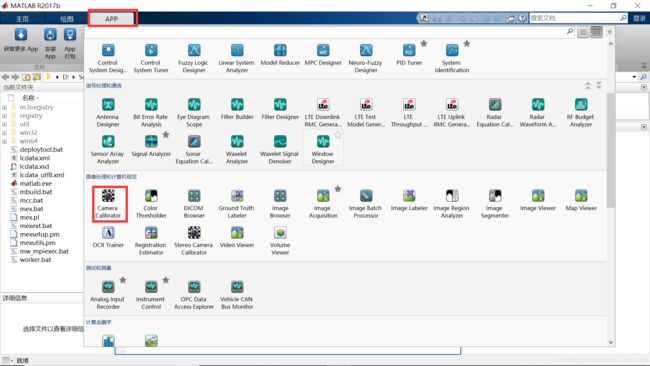

(2)打开matlab,app>>camera calibrator

(3)将你获得的图片导入matlab中去

这步可能会出现自动删除失真严重的图片,确认就行。

(4)确定每个格子的边长,单位;我的时25mm。

(5)选择三个径向畸变量和切向基变量,如下图所示,再点击校准。

(6)计算

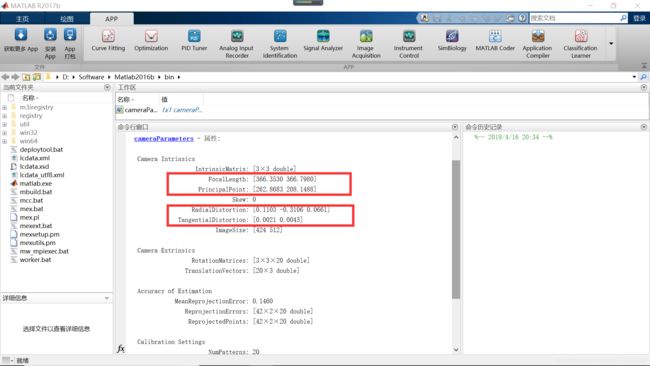

(7)得到焦距(单位:像素)、主点(单位:像素)、畸变系数(无量纲)等多个参数