每个产品经理都应该知道的机器学习术语

摘要: 公司正在上马AI项目?想要熟悉机器学习的世界,想要了解所有关于机器学习的术语,看看本文吧!

公司正在上马AI项目?或许你已经熟悉了机器学习的世界,但是仍然希望扩展你的知识面,并且了解你所听到的所有关于机器学习的术语,争取在和别人交流的时候不会呆呆的站在那里哑口无言。

本机器学习术语表旨在简要介绍最重要的机器学习术语,无论你是对商业还是技术感兴趣。这绝不是详尽无遗,而是在与AI总监或供应商会面前能够进行简单的交流——或者是在面试前快速回顾这些重要的知识点!

概述:

1.NLP - 自然语言处理。

2.数据集。

3.计算机视觉。

4.监督学习。

5.无监督学习。

6.强化学习。

7.神经网络。

8.过度拟合。

1. NLP - 自然语言处理:

自然语言处理(NLP)是各种机器学习方法的一种常用概念,它使得计算机可以使用人类(即自然)语言来理解和执行操作。

自然语言处理最重要的用例是:

1.1文本分类和排名:

此任务的目标是预测文档的类别(标签),或根据文档的相关性将文档排列在列表中。它可以用于垃圾邮件过滤(判别电子邮件是否是垃圾邮件)或内容分类(从网络上选择有关你竞争对手正在做什么事情的文章)。

1.2情绪分析:

情感分析旨在确定某个人对于某个主题的态度或情绪反应——例如正面或负面的态度、愤怒、讽刺。它正在广泛用于客户满意度研究(例如分析产品评论),这对于每一家公司都是非常重要的。

1.3文件汇总:

文件汇总是一组用于创建对长文本(即文件或研究论文)的简短而有意义的描述的方法。

1.4命名实体识别(NER):

命名实体提取算法处理的是非结构化文本流,并识别其中的对象(实体)的预定义类别,例如人员、公司名称、日期、价格、标题等。它通过将非结构化信息转换为结构化,表格式(或JSON)形式。

1.5语音识别:

语音识别技术用于确定说话人的音频信号的文本表示。你可能听说过Siri,天猫精灵,他们都是如何使用语音识别的一个很好的例子。

1.6自然语言理解和生成:

自然语言理解用于将人类生成的文本转换为计算机可解释的表示形式,反之亦然:自然语言生成技术支持将形式逻辑表示转换为人类生成的文本。目前,NLG和NLU主要用于聊天机器人和自动报告生成,也有一些大神,将它们应用于艺术创作。从概念上讲,它与命名实体识别相反。

1.7机器翻译:

机器翻译是将文本或语音从一种人类语言自动翻译成另一种语言的任务,今天的谷歌翻译已经利用机器学习做的很不错了。

2.数据集:

数据是机器学习的重要组成部分。如果你想建立任何机器学习系统,你需要获取数据(例如来自某些公共资源)或自行收集数据。所有用于构建或测试ML模型的数据都称为数据集。基本上,数据科学家将他们的数据集分成三个独立的组:

· 训练数据:

训练数据用于训练模型。这意味着ML模型可以获得数据并学习检测模式或确定哪些特征在预测期间最为重要,训练数据的任务是帮助机器学习模型定参数。

· 验证数据:

验证数据用于调整模型参数并比较不同模型以确定最佳模型参数。验证数据应与训练数据不同,它不应在训练阶段使用。否则,该模型会过度拟合,并且不能很好地推广到新的(生产)数据。

· 测试数据:

这个过程看起来可能很乏味,但总是有第三个最终测试集(通常也称为“Hold-Out”)。一旦选择最终模型来模拟模型在完全看不见的数据上的行为,即在构建模型时不使用的数据点,或者甚至在决定选择哪个模型时使用它。

3.计算机视觉:

计算机视觉(CV)是一个人工智能比较关键的领域,它涉及提供分析和高级图像和视频数据理解的工具。CV中最常见的问题包括:

3.1图像分类:

图像分类是教模型以识别给定图像上的内容的CV任务。例如,可以训练模型来区分公共空间中的各种物体(可用于自驾车)。

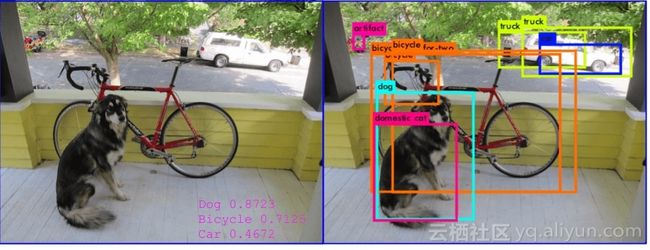

3.2对象检测:

对象检测是一种CV任务,通过在给定类的每个实例周围提供边界框来教导模型从一组预定义类别中检测对象的实例。例如,可以使用对象检测来构建人脸识别系统。然后该模型能够在图片上检测到的每个脸部周围绘制边界框。(顺便说一下,图像分类系统只能识别图像上是否存在人脸,而不能检测到物体在哪里,就像物体检测系统所能做的那样)。

3.3图像分割:

图像分割是一个CV任务,其中某个人训练一个模型,用一个给定像素最可能属于的预定义集合中的类对每个像素进行注释。

3.4显着性检测:

显着性检测是训练模型以提供最有可能引起观看者注意的区域的CV任务(即检测人类最感兴趣的区域)。这可以用来确定视频中的广告展示位置。

4.监督学习:

监督学习是一个机器学习模型家族,通过一些示例自我教导。这意味着监督ML任务的数据需要标记。例如,如果我们想建立一个机器学习模型来识别给定的文本是否与市场营销有关,那么我们需要为模型提供一组标注示例(文本+信息,如果是关于市场营销与否)。给定一个新的,看不见的例子,该模型预测其目标 - 例如,对于所述示例,标签(例如,如果文本是关于市场营销,则为1,否则为0)。

5.无监督学习:

与监督学习相反,无监督学习模式通过观察来自我学习。提供给这种算法的数据是未标记的(算法没有给出真实值)。无监督学习模型能够找到不同输入之间的结构或关系,最重要的一种无监督学习技术是“聚类”。在聚类中,给定数据后,模型创建不同的输入集群(“相似”输入在同一个集群中),并且能够将任何新的,以前未见过的输入放入适当的集群中。

6.强化学习:

强化学习与我们之前描述的方法不同。在RL中,该算法起着“游戏”的作用,其目的是最大化奖励。该算法通过反复试验尝试不同的方法“移动”,并查看哪个方法提高了最大的利润。

最常见的RL使用案例是教计算机解决魔方或下棋,但更多的是强化学习而不仅仅是游戏。最近,实时出价中的RL解决方案数量不断增加,其中模型负责为广告投标,其回报是客户的转化率。

7.神经网络:

神经网络是一个非常广泛的机器学习模型。它们背后的主要想法来源是模仿人脑在处理数据时的行为。就像连接人脑中真实神经元的网络一样,人造神经网络由层组成。每一层都是一组神经元,所有这些神经元都负责检测不同的事物。神经网络按顺序处理数据,这意味着只有第一层直接连接到输入。随后的所有图层都基于前一层的输出检测特征,这使得模型随着层数的增加可以学习更多更复杂的数据模式。当许多图层快速增加时,该模型通常被称为深度学习模型。现在很难确定一个网络被认为很深的特定层数,10年前它曾经是3层,现在是20层左右。

神经网络有许多不同的变体。最常用的是:

· 卷积神经网络:这是计算机视觉领域中的一个巨大突破(但最近,它在NLP问题中也被证明非常有用)。

· 经常性神经网络(RNN):设计用于处理具有序列性质的数据,例如文本或股票价格。它们相对较旧,但随着近20年来现代计算机的计算能力急剧增加,它们变得可以在合理的时间内进行训练和使用。

· 完全连接的神经网络:在静态/表格数据上使用的最简单的模型。

8.过度拟合:

当模型从数据量不足的角度建立假设偏差时,这是一种负面影响而且是一个相当常见和非常重要的问题。

假设你几次访问过一家面包店,而且还没有你最喜欢的蛋糕在那里!你可能会对面包店感到失望,即使其他一千个客户可能会对该产品满意。如果你是一个机器学习模型,那么说你对一些例子过度适应是公平的,开发出一个有偏见的模型,这是你的头脑中的一个表示,与事实相比,这是不准确的。

发生过拟合时,通常意味着该模型将数据中的随机噪声视为重要信号并对其进行调整,这就是为什么随着新数据的恶化(因为噪声不同)。在神经网络或梯度增强等非常复杂的模型中,情况通常如此。

想象一下,建立一个模型来检测提及奥林匹克运动期间特定体育学科的文章。由于你的训练集偏向于有关奥林匹克的文章,因此该模型可能会学习诸如“奥林匹克”这样的词的特征,并且无法检测到不包含该词的正确文章。

本文由阿里云云栖社区组织翻译。

文章原标题《Machine Learning Terms every manager should know》

作者:sigmoidal

译者:虎说八道,审校:。

原文链接

阅读更多干货好文,请关注扫描以下二维码: