车道曲率和中心点偏离距离计算

日萌社

日萌社

人工智能AI:Keras PyTorch MXNet TensorFlow PaddlePaddle 深度学习实战(不定时更新)

CNN:RCNN、SPPNet、Fast RCNN、Faster RCNN、YOLO V1 V2 V3、SSD、FCN、SegNet、U-Net、DeepLab V1 V2 V3、Mask RCNN

车道线检测

相机校正、张氏标定法、极大似然估计/极大似然参数估计、牛顿法、高斯牛顿法、LM算法、sin/cos/tan/cot

相机校正和图像校正:图像去畸变

车道线提取:Sobel边缘提取算法

透视变换

车道线定位及拟合:直方图确定车道线位置

车道曲率和中心点偏离距离计算

在视频中检测车道线

5.5. 车道曲率和中心点偏离距离计算

学习目标

- 知道车道曲率计算的方法

- 知道计算中心点偏离距离的计算

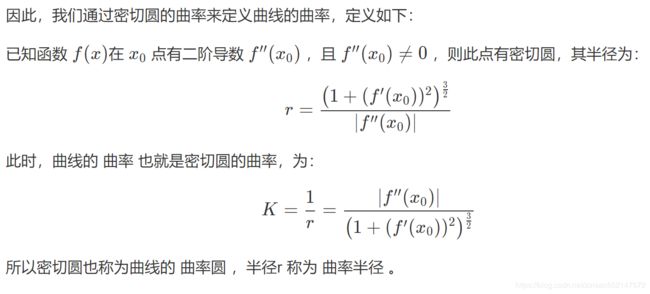

1.曲率的介绍

曲线的曲率就是针对曲线上某个点的切线方向角对弧长的转动率,通过微分来定义,表明曲线偏离直线的程度。数学上表明曲线在某一点的弯曲程度的数值。曲率越大,表示曲线的弯曲程度越大。曲率的倒数就是曲率半径。

1.1.圆的曲率

下面有三个球体,网球、篮球、地球,半径越小的越容易看出是圆的,所以随着半径的增加,圆的程度就越来越弱了。

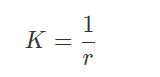

定义球体或者圆的“圆”的程度,就是 曲率 ,计算方法为:

其中r为球体或者圆的半径,这样半径越小的圆曲率越大,直线可以看作半径为无穷大的圆,其曲率为:

1.2.曲线的曲率

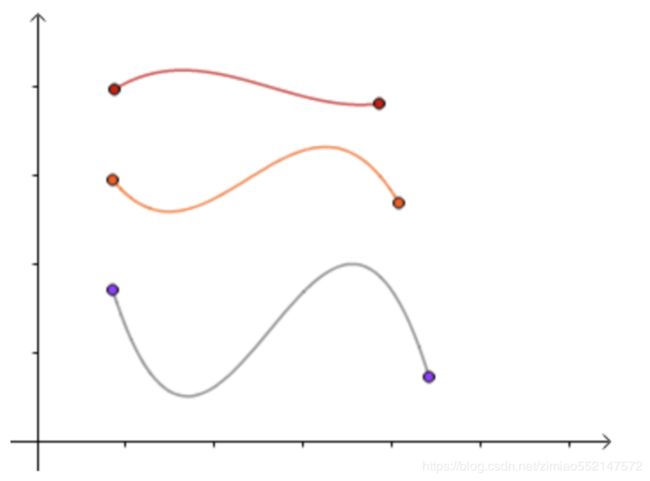

不同的曲线有不同的弯曲程度:

怎么来表示某一条曲线的弯曲程度呢?

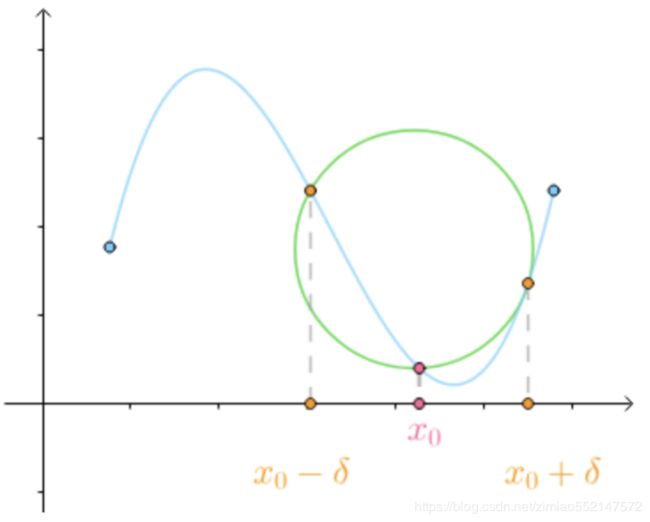

我们知道三点确定一个圆:

另外我们也可以观察到,在曲线比较平坦的位置,密切圆较大,在曲线比较弯曲的地方,密切圆较小,

2.实现

我们根据上述的计算曲率半径的方法,代码实现如下:

def cal_radius(img, left_fit, right_fit):

# 图像中像素个数与实际中距离的比率

# 沿车行进的方向长度大概覆盖了30米,按照美国高速公路的标准,宽度为3.7米(经验值)

ym_per_pix = 30 / 720 # y方向像素个数与距离的比例

xm_per_pix = 3.7 / 700 # x方向像素个数与距离的比例

# 计算得到曲线上的每个点

left_y_axis = np.linspace(0, img.shape[0], img.shape[0] - 1)

left_x_axis = left_fit[0] * left_y_axis ** 2 + left_fit[1] * left_y_axis + left_fit[2]

right_y_axis = np.linspace(0, img.shape[0], img.shape[0] - 1)

right_x_axis = right_fit[0] * right_y_axis ** 2 + right_fit[1] * right_y_axis + right_fit[2]

# 获取真实环境中的曲线

left_fit_cr = np.polyfit(left_y_axis * ym_per_pix, left_x_axis * xm_per_pix, 2)

right_fit_cr = np.polyfit(right_y_axis * ym_per_pix, right_x_axis * xm_per_pix, 2)

# 获得真实环境中的曲线曲率半径

left_curverad = ((1 + (2 * left_fit_cr[0] * left_y_axis * ym_per_pix + left_fit_cr[1]) ** 2) ** 1.5) / np.absolute(

2 * left_fit_cr[0])

right_curverad = ((1 + (

2 * right_fit_cr[0] * right_y_axis * ym_per_pix + right_fit_cr[1]) ** 2) ** 1.5) / np.absolute(

2 * right_fit_cr[0])

# 在图像上显示曲率半径

cv2.putText(img, 'Radius of Curvature = {}(m)'.format(np.mean(left_curverad)), (20, 50), cv2.FONT_ITALIC, 1,

(255, 255, 255), 5)

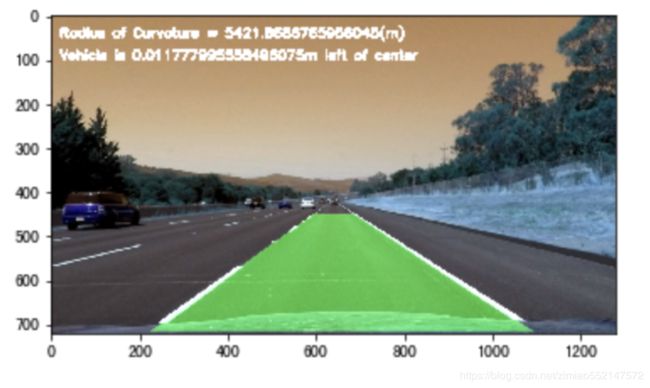

return img显示效果:

计算偏离中心的距离:

# 1. 定义函数计算图像的中心点位置

def cal_line__center(img):

undistort_img = img_undistort(img, mtx, dist)

rigin_pipline_img = pipeline(undistort_img)

transform_img = img_perspect_transform(rigin_pipline_img, M)

left_fit, right_fit = cal_line_param(transform_img)

y_max = img.shape[0]

left_x = left_fit[0] * y_max ** 2 + left_fit[1] * y_max + left_fit[2]

right_x = right_fit[0] * y_max ** 2 + right_fit[1] * y_max + right_fit[2]

return (left_x + right_x) / 2

# 2. 假设straight_lines2_line.jpg,这张图片是位于车道的中央,实际情况可以根据测量验证.

img =cv2.imread("./test/straight_lines2_line.jpg")

lane_center = cal_line__center(img)

print("车道的中心点为:{}".format(lane_center))

# 3. 计算偏离中心的距离

def cal_center_departure(img, left_fit, right_fit):

# 计算中心点

y_max = img.shape[0]

left_x = left_fit[0] * y_max ** 2 + left_fit[1] * y_max + left_fit[2]

right_x = right_fit[0] * y_max ** 2 + right_fit[1] * y_max + right_fit[2]

xm_per_pix = 3.7 / 700

center_depart = ((left_x + right_x) / 2 - lane_center) * xm_per_pix

# 在图像上显示偏移

if center_depart > 0:

cv2.putText(img, 'Vehicle is {}m right of center'.format(center_depart), (20, 100), cv2.FONT_ITALIC, 1,

(255, 255, 255), 5)

elif center_depart < 0:

cv2.putText(img, 'Vehicle is {}m left of center'.format(-center_depart), (20, 100), cv2.FONT_ITALIC, 1,

(255, 255, 255), 5)

else:

cv2.putText(img, 'Vehicle is in the center', (20, 100), cv2.FONT_ITALIC, 1, (255, 255, 255), 5)

return img显示效果如下:

总结

- 曲率是表示曲线的弯曲程度,在这里是计算车道的弯曲程度

- 偏离中心的距离:利用已知的在中心的图像计算其他图像的偏离距离