4. Hadoop伪分布式运行模式

文章目录

- Hadoop伪分布式运行模式

- 1. 启动HDFS并运行MapReduce程序

- 1.1 配置集群

- 配置hadoop-env.sh

- 配置core-site.xml

- 配置hdfs-site.xml

- 1.2 启动集群

- 格式化NameNode

- 启动NameNode和DataNode

- 查看是否启动成功

- web端查看HDFS文件系统

- 查看日志的方式

- 1.3 操作集群

- 启动程序

- 查看运行结果

- 2. 启动YARN并运行MapReduce程序

- 2.1 配置集群

- 配置yarn-env.sh

- 配置yarn-site.xml

- 配置mapred-env.sh

- 配置mapred-site.xml

- 2.2 启动集群

- 启动ResourceManager和NodeManager

- 2.3 集群操作

- Yarn的浏览器页面查看

- 使用Yarn执行程序

- 查看运行结果

- 3. 配置历史服务器

- 3.1 配置mapred-site.xml

- 3.2 启动历史服务器

- 3.3 查看JobHistory

- 4. 配置日志的聚集

- 4.1 配置yarn-site.xml

- 4.2 关闭NodeManager 、ResourceManager和HistoryManager

- 4.3 启动NodeManager 、ResourceManager和HistoryManager

- 4.4 删除HDFS上已经存在的输出文件

- 4.5 执行WordCount程序

- 4.6 查看日志

- ☆

Hadoop伪分布式运行模式

下面涉及到简单的shell脚本的编写,如果不清楚shell脚本的书写可以先看一下这篇文章:Shell编程基础

1. 启动HDFS并运行MapReduce程序

- 配置集群(伪分布式模式下,只配置配置文件)

- 启动、测试集群增、删、查

- 执行WordCount案例

1.1 配置集群

配置hadoop-env.sh

# 在hadoop目录执行以下命令,修改hadoop-env.sh

vi ./etc/hadoop/hadoop-env.sh

配置core-site.xml

# 在hadoop目录执行以下命令,修改core-site.xml vi ./etc/hadoop/core-site.xml将以下内容拷贝到core-site.xml文件的

中,保存退出

<property>

<name>fs.defaultFSname>

<value>hdfs://hadoop101:9000value>

property>

<property>

<name>hadoop.tmp.dirname>

<value>/opt/module/hadoop-2.7.2/data/tmpvalue>

property>

配置hdfs-site.xml

# 在hadoop目录执行以下命令,修改hdfs-site.xml vi ./etc/hadoop/hdfs-site.xml将以下内容拷贝到hdfs-site.xml文件的

中,保存退出<property> <name>dfs.replicationname> <value>1value> property>

1.2 启动集群

格式化NameNode

第一次启动时格式化,以后就不要总格式化为什么不能一直格式化NameNode,格式化NameNode要注意什么?

格式化NameNode,会产生新的集群id,导致NameNode和DataNode的集群id不一致,集群找不到已往数据。所以,格式NameNode时,一定要先删除data数据和log日志,然后再格式化NameNode。

# 在hadoop目录执行以下命令,格式化NameNode

bin/hdfs namenode -format

启动NameNode和DataNode

# 通过shell脚本启动NameNode和DataNode

touch StartNameAndDataNode.sh

chmod 777 StartNameAndDataNode.sh

vim StartNameAndDataNode.sh

#StartNameAndDataNode.sh脚本内容如下:

#!/bin/bash

sbin/hadoop-daemon.sh start namenode;

sbin/hadoop-daemon.sh start datanode;

查看是否启动成功

#查看是否启动成功

#jps是JDK中的命令,不是Linux命令。不安装JDK不能使用jps

jps

web端查看HDFS文件系统

http://hadoop:50070/dfshealth.html#tab-overview

页面介绍:注意:如果通过上面链接不能查看,看以下这篇文章 http://www.cnblogs.com/zlslch/p/6604189.html

查看日志的方式

在企业中遇到Bug时,经常根据日志提示信息去分析问题、解决Bug。

举例说明,在启动NameNode后通过jps命令并没有查到NameNode是运行状态,我就通过以下方法定位到出问题的地方:#在hadoop目录中,先进入logs目录,在查看日志 cd /logs cat hadoop-atguigu-namenode-hadoop.log

结果发现是在配置core-site.xm的fs.defaultFS时候把,hadoop配成了hadoop101(因为本机是hadoop)

1.3 操作集群

在HDFS文件系统中的命令与Linux中的命令相似

启动程序

#在HDFS文件系统上创建一个input文件夹

bin/hdfs dfs -mkdir -p /user/atguigu/input

#将测试文件wc.input上传到HDFS文件系统上的/user/atguigu/input/目录下

bin/hdfs dfs -put wcinput/wc.input /user/atguigu/input/

#查看上传的文件是否正确

bin/hdfs dfs -ls /user/atguigu/input/

bin/hdfs dfs -cat /user/atguigu/ input/wc.input

#运行MapReduce程序,这次运行是对HDFS文件系统里面的wc.input文件进行分析,并且把结果输出到HDFS文件系统下的/user/atguigu/output目录下

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/atguigu/input/ /user/atguigu/output

也可以将此步骤做成shell脚本–

HDFSStartWordCount.shtouch HDFSStartWordCount.sh chmod 777 HDFSStartWordCount.sh vim HDFSStartWordCount.sh #!/bin/bash #在HDFS文件系统上创建一个input文件夹 bin/hdfs dfs -mkdir -p /user/atguigu/input; #将测试文件wc.input上传到HDFS文件系统上的/user/atguigu/input/目录下 bin/hdfs dfs -put wcinput/wc.input /user/atguigu/input/; #查看上传的文件是否正确 bin/hdfs dfs -ls /user/atguigu/input/; bin/hdfs dfs -cat /user/atguigu/ input/wc.input; #运行MapReduce程序,这次运行是对HDFS文件系统里面的wc.input文件进行分析,并且把结果输出到HDFS文件系统下的/user/atguigu/output目录下 bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/atguigu/input/ /user/atguigu/output;

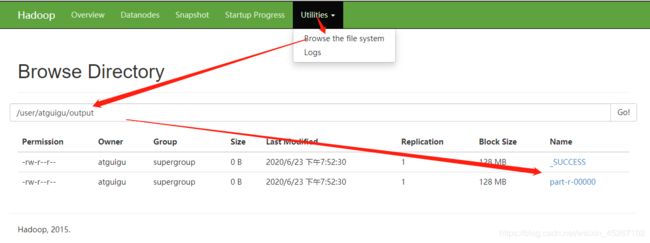

查看运行结果

在Web页面上查看http://hadoop:50070/dfshealth.html#tab-overview

命令行查看bin/hdfs dfs -cat /user/atguigu/output/*

2. 启动YARN并运行MapReduce程序

- 配置集群在YARN上运行MR

- 启动、测试集群增、删、查

- 在YARN上执行WordCount案例

2.1 配置集群

配置yarn-env.sh

# 在hadoop目录下,执行以下命令

vim ./etc/hadoop/yarn-env.sh

# 在文件23行左右的JAVA_HOME,改成以下内容

export JAVA_HOME=/opt/module/jdk1.8.0_212

配置yarn-site.xml

# 在hadoop目录下,执行以下命令

vim ./etc/hadoop/yarn-site.xml

在

里添加以下内容:

<property>

<name>yarn.nodemanager.aux-servicesname>

<value>mapreduce_shufflevalue>

property>

<property>

<name>yarn.resourcemanager.hostnamename>

<value>hadoopvalue>

property>

配置mapred-env.sh

# 在hadoop目录下,执行以下命令

vim ./etc/hadoop/mapred-env.sh

# 在文件16行左右的JAVA_HOME,改成以下内容

export JAVA_HOME=/opt/module/jdk1.8.0_212

配置mapred-site.xml

#在hadoop目录下,执行以下命令,对mapred-site.xml.template重新命名为mapred-site.xml

mv ./etc/hadoop/mapred-site.xml.template ./etc/hadoop/mapred-site.xml

#在hadoop目录下,执行以下命令

vi ./etc/hadoop/mapred-site.xml

在

里添加以下内容:

<property>

<name>mapreduce.framework.namename>

<value>yarnvalue>

property>

2.2 启动集群

启动前必须保证NameNode和DataNode已经启动

启动ResourceManager和NodeManager

#在hadoop目录下,执行以下命令,启动ResourceManager

sbin/yarn-daemon.sh start resourcemanager

#在hadoop目录下,执行以下命令,启动NodeManager

sbin/yarn-daemon.sh start nodemanager

也可以将此步骤做成shell脚本–

ResourceAndNodeManagerStart.sh# 通过shell脚本启动ResourceManager和NodeManager touch ResourceAndNodeManagerStart.sh chmod 777 ResourceAndNodeManagerStart.sh vim ResourceAndNodeManagerStart.sh #StartNameAndDataNode.sh脚本内容如下: #!/bin/bash sbin/yarn-daemon.sh start resourcemanager sbin/yarn-daemon.sh start nodemanager

2.3 集群操作

Yarn的浏览器页面查看

http://hadoop:8088/cluster

使用Yarn执行程序

#删除HDFS文件系统上的output文件

bin/hdfs dfs -rm -R /user/atguigu/output

#执行MapReduce程序

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/atguigu/input/ /user/atguigu/output

查看运行结果

#使用HDFS命令,查看运行结果

bin/hdfs dfs -cat /user/atguigu/output/*

3. 配置历史服务器

为了查看程序的历史运行情况,需要配置一下历史服务器。具体配置步骤如下:

3.1 配置mapred-site.xml

vi ./etc/hadoop/mapred-site.xml

在

里添加以下内容:

<property>

<name>mapreduce.jobhistory.addressname>

<value>hadoop:10020value>

property>

<property>

<name>mapreduce.jobhistory.webapp.addressname>

<value>hadoop:19888value>

property>

3.2 启动历史服务器

sbin/mr-jobhistory-daemon.sh start historyserver

查看历史服务器是否启动

3.3 查看JobHistory

http://hadoop:19888/jobhistory

4. 配置日志的聚集

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到HDFS系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动NodeManager 、ResourceManager和HistoryManager。

4.1 配置yarn-site.xml

#在hadoop目录下,执行以下命令

vi ./etc/hadoop/yarn-site.xml

在

里添加以下内容:

<property>

<name>yarn.log-aggregation-enablename>

<value>truevalue>

property>

<property>

<name>yarn.log-aggregation.retain-secondsname>

<value>604800value>

property>

4.2 关闭NodeManager 、ResourceManager和HistoryManager

# 通过shell脚本关闭ResourceManager和NodeManager以及HistoryManager

touch ResourceAndNodeManagerHisStop.sh

chmod 777 ResourceAndNodeManagerHisStop.sh

vim ResourceAndNodeManagerHisStop.sh

#!/bin/bash

sbin/yarn-daemon.sh stop resourcemanager

sbin/yarn-daemon.sh stop nodemanager

sbin/mr-jobhistory-daemon.sh stop historyserver

4.3 启动NodeManager 、ResourceManager和HistoryManager

# 启动ResourceManager

sbin/yarn-daemon.sh start resourcemanager

# 启动NodeManager

sbin/yarn-daemon.sh start nodemanager

# 启动HistoryManager

sbin/mr-jobhistory-daemon.sh start historyserver

4.4 删除HDFS上已经存在的输出文件

bin/hdfs dfs -rm -R /user/atguigu/output

4.5 执行WordCount程序

vim StartWordCount.sh

#脚本内容

#!/bin/

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/atguigu/input /user/atguigu/output

#赋予权限

chmod 777 StartWordCount.sh

#执行WordCount程序

./StartWordCount.sh

4.6 查看日志

http://hadoop:19888/jobhistory