日志采集框架Flume 与 数据迁移sqoop

Flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统。

Flume可以采集文件,socket数据包等各种形式源数据,又可以将采集到的数据输出到HDFS、hbase、hive、kafka等众多外部存储系统中

一般的采集需求,通过对flume的简单配置即可实现

Flume针对特殊场景也具备良好的自定义扩展能力,因此,flume可以适用于大部分的日常数据采集场景

2, 运行机制

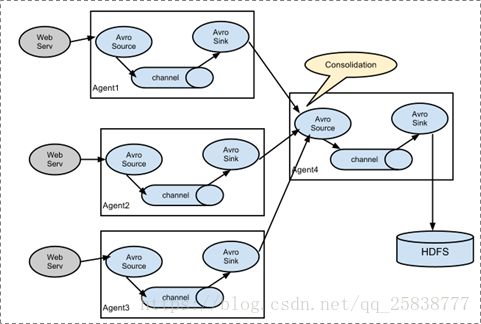

Flume分布式系统中最核心的角色是agent,flume采集系统就是由一个个agent所连接起来形成

每一个agent相当于一个数据传递员,内部有三个组件:

Source:采集源,用于跟数据源对接,以获取数据

Sink:下沉地,采集数据的传送目的,用于往下一级agent传递数据或者往最终存储系统传递数据

Channel:angent内部的数据传输通道,用于从source将数据传递到sink

多级agent之间串联

3, Flume的安装部署Flume的安装非常简单,只需要解压即可,当然,前提是已有hadoop环境

上传安装包到数据源所在节点上

然后解压 tar -zxvfapache-flume-1.6.0-bin.tar.gz

然后进入flume的目录,修改conf下的flume-env.sh,在里面配置

export JAVA_HOME=/usr/java/jdk1.7.0_67(输入你自己的jdk路径)#输入你本地 flume-kafka-source-xx.jar包路径,注意flume1.6之前的版本好像没有这个jar, 只是要1.6及以上版本

FLUME_CLASSPATH="/usr/app/apache-flume-1.6.0-bin/lib/flume-kafka-source-1.6.0.jar" 指定采集方案配置文件,在相应的节点上启动flume agent

先用一个最简单的例子来测试一下程序环境是否正常

1、先在flume的conf目录下新建一个文件

vi netcat-logger.conf

# 定义这个agent中各组件的名字

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# 描述和配置source组件:r1

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# 描述和配置sink组件:k1

a1.sinks.k1.type = logger

# 描述和配置channel组件,此处使用是内存缓存的方式

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# 描述和配置source channel sink之间的连接关系

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

2、启动agent去采集数据

bin/flume-ng agent -c conf -f conf/netcat-logger.conf-n a1 -Dflume.root.logger=INFO,console

-c conf 指定flume自身的配置文件所在目录

-f conf/netcat-logger.con 指定我们所描述的采集方案

-n a1 指定我们这个agent的名字

3、测试

先要往agent采集监听的端口上发送数据,让agent有数据可采

随便在一个能跟agent节点联网的机器上

telnet anget-hostname port (telnet localhost 44444)

上面只是介绍了一种flume案例,实际上flume用处太多,具体用到的话大家可以去官网等等查看。

sqoop数据迁移

sqoop是apache旗下一款“Hadoop和关系数据库服务器之间传送数据”的工具。

导入数据:MySQL,Oracle导入数据到Hadoop的HDFS、HIVE、HBASE等数据存储系统;

导出数据:从Hadoop的文件系统中导出数据到关系数据库

工作机制

将导入或导出命令翻译成mapreduce程序来实现

在翻译出的mapreduce中主要是对inputformat和outputformat进行定制

sqoop安装

安装sqoop的前提是已经具备java和hadoop的环境

下载并解压

最新版下载地址http://ftp.wayne.edu/apache/sqoop 自行下载安装不解释

修改配置文件

进入sqoop的conf目录

$ mv sqoop-env-template.sh sqoop-env.sh

打开sqoop-env.sh并编辑下面几行:

export HADOOP_COMMON_HOME=/home/hadoop/apps/hadoop-2.6.1/ (输入你自己的hadoop安装目录)

export HADOOP_MAPRED_HOME=/home/hadoop/apps/hadoop-2.6.1/

exportHIVE_HOME=/home/hadoop/apps/hive-1.2.1

加入mysql的jdbc驱动包,放到sqoop的lib目录下, 没有的自己下载不解释

cp ~/app/hive/lib/mysql-connector-java-5.1.28.jar $SQOOP_HOME/lib/

验证启动

$ cd $SQOOP_HOME/bin

$ sqoop-version

预期的输出:

15/12/17 14:52:32 INFO sqoop.Sqoop: RunningSqoop version: 1.4.6

Sqoop 1.4.6 git commit id5b34accaca7de251fc91161733f906af2eddbe83

Compiled by abe on Fri Aug 1 11:19:26 PDT2015

到这里,整个Sqoop安装工作完成。

语法(这里不解释太多了,语法很多,需要的自行百度)

下面的语法用于将数据导入HDFS。

$ sqoop import (generic-args) (import-args) |

下面的命令用于从MySQL数据库服务器中的emp表导入HDFS。

$bin/sqoop import \ --connect jdbc:mysql://sqooptest:3306/test \ --username root \ --password root \ --table emp \ --m 1 |

为了验证在HDFS导入的数据,请使用以下命令查看导入的数据

$ $HADOOP_HOME/bin/hadoop fs -cat /user/hadoop/emp/part-m-00000 |