1.基础知识

爬虫

爬虫,是一种自动获取网页内容的程序,是搜索引擎的重要组成部分,因此搜索引擎优化很大程度上就是针对爬虫而做出的优化。

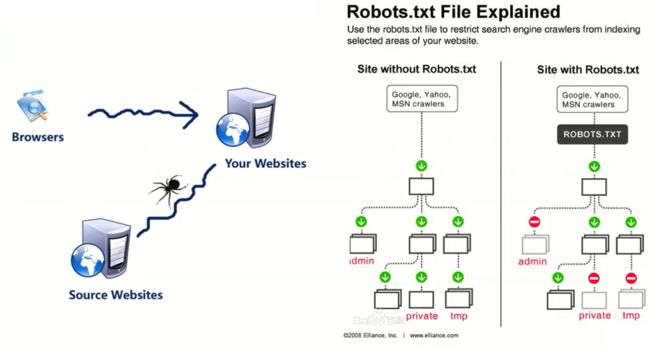

Robots协议

robots.txt是一个文本文件,也是一个协议,不是一个命令。

robots.txt是爬虫要查看的第一个文件。

robots.txt告诉爬虫在服务器上什么文件是可以被查看的,搜索机器人就会按照文件中的内容来确定访问的范围。

配置环境

- Express http://www.expressjs.com.cn/

- Request https://github.com/request/request

- Cheerio https://github.com/cheeriojs/cheerio

express spider && cd spider && npm install 创建项目spider并安装依赖

cd bin && node www 启动服务器

npm install request --save-dev 安装request模块并放入项目

npm install cheerio --save-dev 安装cheerio模块并放入项目

模块相关

superagent :发起http请求

cheerio :解析http返回的html内容

async :多线程并发控制

2.原理分析

步骤1:app.js

var express = require('express');

var app = express();

app.get('', function(req,res){

res.send('hi,world!');

});

app.listen(3000);

测试

supervisor start app.js

3.实战案例

3.1 爬取图片并保存到本地

var http = require('http');

var fs = require('fs');

var request = require('request');

var cheerio = require('cheerio');

var url = 'http://tu.duowan.com/tag/5037.html';

function saveImg($){

var arr = [];

$('.box').each(function(index,item){

//获取图片的标题

var obj = {

'name':$(this).find('em a').text(),

'img':$(this).find('img').attr('src')

};

arr.push(obj);

//采用request模块,向服务器发起一次请求,获取图片资源

request.head(obj.img, function(err, res, body){

if(err){

console.log(err);

}

});

//通过流的方式,把图片写到本地目录下

request(obj.img).pipe(

fs.createWriteStream('./imgs/'+obj.name+'.jpg')

);

// 在本地存储所爬取的内容资源

var file = './imgs/note.log';

var content = obj.name+'\n';

fs.appendFile(file, content, 'utf-8', function(err){

if(err){

console.log(err);

}

});

});

console.log(arr);

}

function startRequest(url){

//采用http模块向服务器发起一次get请求

http.get(url,function(res){

var html = '';

//防止中文乱码

res.setEncoding('utf-8');

res.on('data', function(chunk){

//监听data事件,每次取一块数据

html += chunk;

}).on('end', function(){

//监听end事件,如果整个网页内容的html都获取完毕,就执行回调函数

//采用cheerio模块解析html

var $ = cheerio.load(html);

//在本地存储所爬取到的图片资源

saveImg($);

}).on('error', function(err){

console.log(err);

});

});

}

function getPage(url){

startRequest(url);

}

getPage(url);

3.2 爬取博客

环境配置

npm install async -save-dev

npm install url-save-dev

npm install superagent -save-dev

npm install eventproxy -save-dev

代码解析

var cheerio = require('cheerio');

var async = require('async');

var url = require('url');

var superagent = require('superagent');

var express = require('express');

var app = express();

var eventproxy = require('eventproxy');

var ep = eventproxy();

var pageurl = [];

var pagenum = 3;

for(var i=0; iul>li>h2>a').each(function(){

var href = $(this).attr('href');

posturl.push(href);

});

//使用eventproxy来并发抓取

ep.emit('getPost', 'get article');

});

});

});

//监听服务器端口

app.listen(3001, function(req,res){

console.log('app is running');

});

4.爬虫小结

4.1http.get+cheerio+iconv-lite

直接使用http的get方法进行请求url,将得到的内容给cheerio解析,用jquery的方式解析。得到的结果中文乱码如何解决呢,用iconv-lite模块将得到的内容进行转码即可。

http.get(options,function(result){

var body = [];

result.on('data',function(chunk){

body.push(chunk);

});

result.on('end', function () {

var html = iconv.decode(Buffer.concat(body), 'gb2312'); //注意这里body是数组

var $ = cheerio.load(html);

...

});

});

4.2request+cheerio+iconv-lite

直接获取到Buffer类型的数据。然后将得到的内容给cheerio解析,用jquery的方式解析出我们要东西即可。

request(options,function(err,res,body){

if(err)console.log(err);

if(!err&&res.statusCode==200){

var html = iconv.decode(body, 'gb2312'); //这里body是直接拿到的是Buffer类型的数据,可以直接解码。

var $ = cheerio.load(html);

...

}

});

4.3 superagent+cheerio+superagent-charset

用了superagent的get方法发起请求,解码的时候用到了superagent-charse,用法还是很简单的,之后再将获取到的内容给cheerio解析,用jquery的方式解析出我们要东西即可。结果中文乱码解决用superagent-charset模块进行转码。

var charset = require("superagent-charset");

var superagent = charset(require("superagent")); //将superagent模块传递给superagent-charset

superagent.get(url)

.charset('gb2312') //用charset方法达到解码效果。

.end(function(err,result){

if(err) console.log(err);

var $ = cheerio.load(result.text);

...

});