对抗样本(论文解读十四): advPattern Physical World Attacks on Deep Person Re-Identification via Adversarially T

advPattern Physical World Attacks on Deep Person Re-Identification via Adversarially Transformable

Zhibo Wang†, Siyan Zheng†, Mengkai Song†, Qian Wang†,∗, Alireza Rahimpour‡, Hairong Qi‡

†Key Laboratory of Aerospace Information Security and Trusted Computing, Ministry of Education, School of Cyber Science and Engineering, Wuhan University, P. R. China

‡Dept. of Electrical Engineering and Computer Science, University of Tennessee, Knoxville, USA

发表于:ICCV_2019_paper

摘要

人再识别(re-ID)是一项跨摄像头视图匹配人的任务。

我们第一次尝试对深度re-id实施健壮的物理世界攻击。

我们提出了一种新的攻击算法,称为advPattern,用于生成衣服上的对抗性图案,

该算法通过学习不同相机之间图像对的变化,将来自同一相机的图像特征拉近,同时将来自不同相机的特征推远。

数据集:Market1501 and our established PRCS dataset

Introduction

To the best of our knowledge, we are the first to investigate:

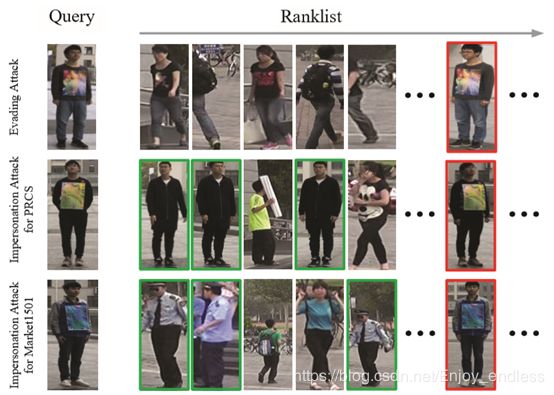

展示了2种攻击:Evading Attack (无目标) and Impersonation Attack.(有目标)。

The main challenge:

如何在相同的图案衣服不同相机视角下,使re-ID系统不能正确匹配对手的图像,

针对一种位置产生的对抗模式很难在其他不同的位置中保持有效

如何让相机感知到敌对的模式,但又避免引起人类监督的怀疑

如何使产生的对立图案在印刷过程、动态环境、相机拍摄失真等各种物理条件下存活

To address these challenges, 我们提出的advPattern将针对深度re-ID模型生成敌对模式的问题公式化为一个优化问题,该优化问题的目的是使敌对方的图像在不同相机视图中的相似度得分最小化。 思想非常简单。

Scalability and robustn:

为了实现对抗性模式的可扩展性,我们采用多位置采样策略来近似观察变换的分布。我们通过建模物理动力学(如天气变化,射击失真)来进一步提高对抗性模式的健壮性,以确保它们在物理世界场景中生存。

Evading Attack.

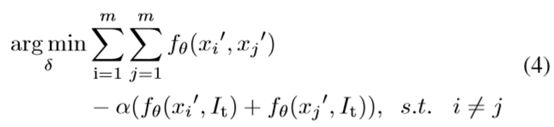

损失函数:

![]()

对抗图像δ,D(.)表示对抗图像的真实性,p、g分别表示不同相机视角下的图像,f()表示不同图像间的相似度,Rank对相似度降序排序,使得排序结果>K。

i, j 表示不同相机视角下的图像,Ti表示对对抗块δ的相机视角变换;

最小化不同视角下对抗图像的相似度;实现攻击。

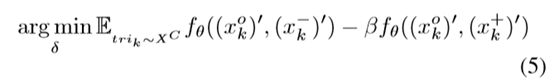

Impersonation Attack…

有目标攻击,目标图像I_t.

4.2. Scalable Patterns in Varying Positions

For the Evading Attack,

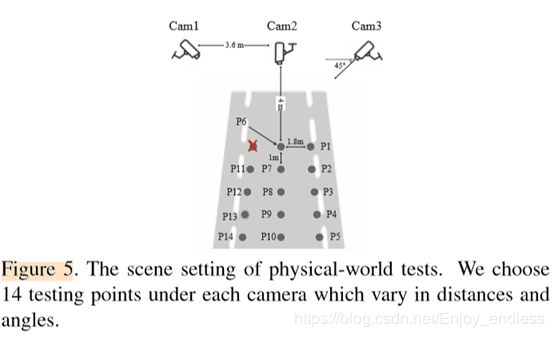

由于我们无法捕捉到观察变换的精确分布,我们通过多位置采样策略来增大数据集,以近似图像的分布来生成可伸缩的对抗模式。敌手的增强生成集XC是通过收集敌手在每个摄像头视角下不同距离、不同角度的图像,并对原始采集的图像进行平移、缩放等图像变换生成实例。

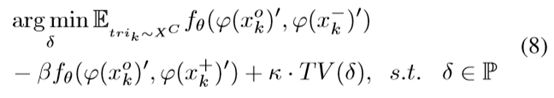

X0与x+来自相同相机,与x-来自不同相机。最小化不同相机相似度,同时最大化相同相机的相似度。

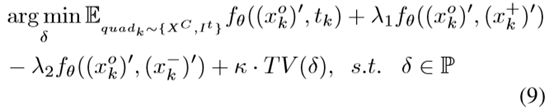

For the Impersonation Attack,

4.3. Robust Patterns for Physically Realizable Attack

我们设计不显眼的对抗图案,这些图案是可见的,但人类很难将它们与衣服上的装饰图案区分开来。具体来说,我们选择一个mask Mx来将生成的图案投射到一个看起来像衣服上装饰图案的形状(例如,普通的logo或创造性的涂鸦)。

为了生成平滑一致的patch,引入 total variation (TV):

我们设计一个退化函数ϕ(·)随机改变亮度或模糊图像集, 增强鲁棒性;

引入non-printability score (NPS),将生成的对抗图像限制在一个更小的间隔P内,以避免不可打印的颜色(例如,高亮度和高饱和度)。

最终的优化函数:

无目标:

5. Experiments

5.1. Datasets

PRCS Dataset. We built a Person Re-identification in Campus Streets (PRCS) dataset for evaluating the attack method. PRCS contains 10,800 cropped images of 30 identities. During dataset collection, three cameras were deployed to capture pedestrians in different campus streets. Each identity in PRCS was captured by both three cameras and has at least 100 cropped images per camera. 自己搞了一个数据集。。

攻击效果:躲避攻击及目标攻击,ranklist返回目标对象。

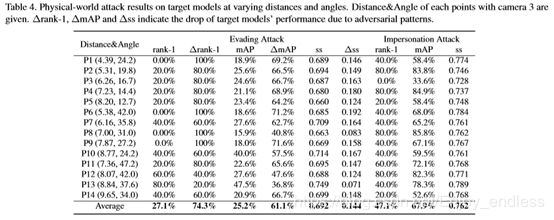

具体不同距离、不同角度下的攻击结果:

逃避攻击aver为1/4左右,还是比较高的。

本篇论文对于基本的攻击loss (相似度)、鲁棒性控制、可打印、平滑控制TV,是比较通用的方法;

对于具体的细节,包括隐蔽性、图像不同视角及位置生成集,有值得借鉴的地方。对于这一部分可能还得需要进一步理解、包括代码的参考等。

∗The code is avaliable at https://github.com/whuAdv/ AdvPattern